7 مخاطر جسيمة تواجهك باستخدام الذكاء الاصطناعي للتسويق

نشرت: 2023-07-06قبل عامين ، لم يكن لدى معظمنا نحن المسوقون فكرة ضبابية حول كيفية استخدام الذكاء الاصطناعي في التسويق. فجأة ، نكتب منشورات LinkedIn حول أفضل المطالبات التي يمكن أن تهمس في أذن ChatGPT.

هناك الكثير للاحتفال به بشأن التسريب المفاجئ للذكاء الاصطناعي في عملنا. يعتقد ماكنزي أن الذكاء الاصطناعي سيحرر 2.6 تريليون دولار من القيمة للمسوقين.

لكن اعتمادنا السريع للذكاء الاصطناعي قد يسبق الأسئلة الأخلاقية والقانونية والتشغيلية المهمة - والتي ستترك المسوقين معرضين لمخاطر لم يكن علينا التفكير فيها من قبل (أي هل يمكن مقاضاتنا لإخبار الذكاء الاصطناعي بأن "يكتب مثل ستيفن كينج؟ ").

هناك طن متري من غبار الذكاء الاصطناعي في جو التسويق الذي لن يستقر لسنوات. بغض النظر عن مدى صعوبة التحديق ، فلن تتمكن من اكتشاف كل مأزق محتمل في استخدام نماذج اللغة الكبيرة والتعلم الآلي لإنشاء المحتوى وإدارة الإعلانات.

لذا فإن هدفنا في هذه المقالة هو عرض سبعة من أبرز مخاطر استخدام الذكاء الاصطناعي للتسويق من أرضية مرتفعة للغاية. لقد جمعنا نصائح الخبراء للمساعدة في التخفيف من هذه المخاطر. وقد أضفنا الكثير من الموارد حتى تتمكن من التعمق أكثر في الأسئلة التي تهمك أكثر.

الخطر رقم 1: تحيز التعلم الآلي

في بعض الأحيان ، تعطي خوارزميات التعلم الآلي نتائج غير عادلة لصالح أو ضد شخص أو شيء ما. يطلق عليه تحيز التعلم الآلي ، أو انحياز الذكاء الاصطناعي ، وهي مشكلة منتشرة حتى مع أكثر الشبكات العصبية العميقة تقدمًا.

إنها مشكلة بيانات

ليس الأمر أن شبكات الذكاء الاصطناعي متعصبة بطبيعتها. إنها مشكلة في البيانات التي يتم تغذيتها بها.

تعمل خوارزميات التعلم الآلي من خلال تحديد الأنماط لحساب احتمال نتيجة ، مثل ما إذا كانت مجموعة معينة من المتسوقين ستحب منتجك أم لا.

ولكن ماذا لو كانت البيانات التي يتدرب عليها الذكاء الاصطناعي تميل نحو عرق أو جنس أو فئة عمرية معينة؟ سوف يتوصل الذكاء الاصطناعي إلى استنتاج مفاده أن هؤلاء الأشخاص أفضل تطابقًا ويحولون تصميم الإعلان أو موضعه وفقًا لذلك.

طبعة غسيل التحيز pic.twitter.com/YQLRcq59lQ

- جانيل شين (JanelleCShane) 17 يونيو 2021

هنا مثال. اختبر الباحثون مؤخرًا التحيز الجنساني في أنظمة استهداف الإعلانات على Facebook. وضع المحققون إعلانًا لتجنيد سائقي توصيل لبيتزا هت ، وإعلانًا مشابهًا له نفس المؤهلات لـ Instacart.

تتسبب مجموعة سائقي بيتزا هت الحالية في انحراف الذكور ، لذلك عرض Facebook هذه الإعلانات بشكل غير متناسب للرجال. يوجد في Instacart عدد أكبر من السائقات من النساء ، لذلك تم وضع إعلانات لوظائفهن أمام المزيد من النساء. ولكن لا يوجد سبب ملازم يمنع النساء من معرفة وظائف بيتزا هت ، لذا فهذه خطوة خاطئة كبيرة في استهداف الإعلانات.

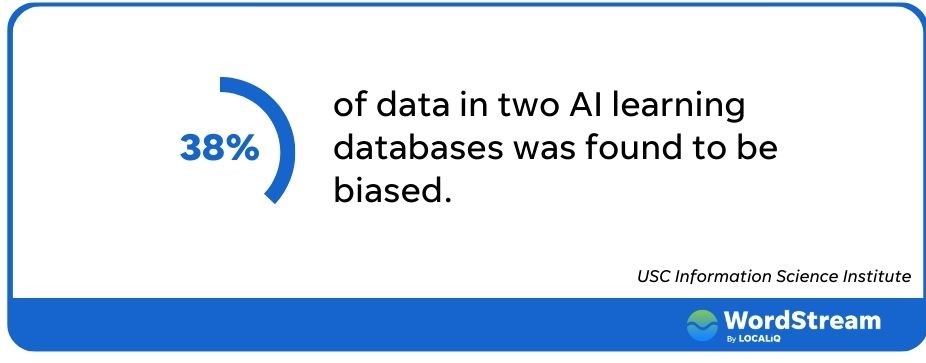

التحيز للذكاء الاصطناعي أمر شائع

تمتد المشكلة إلى ما هو أبعد من Facebook. نظر باحثون من جامعة جنوب كاليفورنيا في قاعدتي بيانات كبيرتين للذكاء الاصطناعي ووجدوا أن أكثر من 38٪ من البيانات الموجودة فيهما كانت متحيزة. حتى أن وثائق ChatGPT تحذر من أن الخوارزميات الخاصة بهم قد تربط "الصور النمطية السلبية بالنساء السود".

يقدم تحيز التعلم الآلي العديد من الآثار المترتبة على جهات التسويق ؛ أقلها ضعف أداء الإعلان. إذا كنت تأمل في الوصول إلى أكبر عدد ممكن من العملاء المحتملين ، فإن النظام الأساسي لاستهداف الإعلانات الذي يستبعد مجموعات كبيرة من السكان يكون أقل من مثالي.

بالطبع هناك تداعيات أكبر إذا كانت إعلاناتنا تستهدف أو تستبعد بشكل غير عادل مجموعات معينة. إذا كان إعلانك عن العقارات يميز ضد الأقليات المحمية ، فيمكنك الوصول إلى النهاية الخاطئة لقانون الإسكان العادل ولجنة التجارة الفيدرالية. ناهيك عن فقدان قارب التسويق الشامل تمامًا.

كيفية تجنب تحيز الذكاء الاصطناعي

إذن ماذا نفعل عندما تنفجر أدوات الذكاء الاصطناعي لدينا؟ هناك خطوتان يمكنك اتباعهما للتأكد من أن إعلاناتك تعامل الجميع بشكل منصف.

أولاً وقبل كل شيء ، تأكد من قيام شخص ما بمراجعة المحتوى الخاص بك ، كما يكتب Alaura Weaver ، كبير مديري المحتوى والمجتمع في Writer. تشرح قائلة: "بينما تقدمت تقنية الذكاء الاصطناعي بشكل كبير ، إلا أنها تفتقر إلى التفكير النقدي وقدرات اتخاذ القرار التي يتمتع بها البشر". "من خلال قيام المحررين البشريين بمراجعة المحتوى المكتوب بالذكاء الاصطناعي والتحقق منه ، يمكنهم التأكد من أنه خالٍ من التحيز ويتبع المعايير الأخلاقية."

سيقلل الإشراف البشري من مخاطر النتائج السلبية في الحملات الإعلانية المدفوعة أيضًا.

يقول بريت ماكهيل ، مؤسس التسويق التجريبي: "في الوقت الحالي ، وربما إلى أجل غير مسمى ، لا يُنصح بترك منظمة العفو الدولية تتولى بالكامل الحملات أو أي شكل من أشكال التسويق". "يعمل الذكاء الاصطناعي على النحو الأمثل عندما يتلقى مدخلات دقيقة من الذكاء العضوي الذي جمع بالفعل كميات هائلة من البيانات والخبرات."

الخطر الثاني: مغالطات واقعية

كلفت Google مؤخرًا تقييمها لشركتها الأم 100 مليار دولار عندما قدم برنامج الدردشة الآلي الجديد ، Bard ، إجابة غير صحيحة في تغريدة ترويجية.

Bard هي خدمة حوارية للذكاء الاصطناعي ، مدعومة من LaMDA. تم تصميمها باستخدام نماذج اللغة الكبيرة لدينا والاعتماد على المعلومات من الويب ، وهي منصة انطلاق للفضول ويمكن أن تساعد في تبسيط الموضوعات المعقدة → https://t.co/fSp531xKy3 pic.twitter.com/JecHXVmt8l

- Google (Google) 6 فبراير 2023

يسلط غوغل الأبله الضوء على أحد أكبر قيود الذكاء الاصطناعي ، وأحد أكبر المخاطر التي يواجهها المسوقون الذين يستخدمونه: الذكاء الاصطناعي لا يقول الحقيقة دائمًا.

هلوسة الذكاء الاصطناعي

وصف إيثان موليك ، الأستاذ في كلية وارتون للأعمال ، مؤخرًا الأنظمة التي تعمل بالذكاء الاصطناعي مثل ChatGPT بأنها "متدرب كلي العلم ومتشوق لإرضاء الكذب أحيانًا".

بالطبع ، الذكاء الاصطناعي ليس واعيًا ، على الرغم مما قد يدعي البعض. لا ينوي خداعنا. ومع ذلك ، يمكن أن يعاني من "الهلوسة" التي تؤدي به إلى اختلاق الأشياء.

الذكاء الاصطناعي هو آلة تنبؤ. يبدو أنه تملأ الكلمة أو العبارة التالية التي ستجيب على استفسارك. لكنها ليست مدركة لذاتها. لا يمتلك الذكاء الاصطناعي منطقًا للتحقق مما إذا كان ما يربطه معًا أمرًا منطقيًا.

على عكس التحيز ، لا يبدو أن هذه مشكلة في البيانات. حتى عندما تحتوي الشبكة على جميع المعلومات الصحيحة ، لا يزال بإمكانها إخبارنا بالشيء الخطأ.

ضع في اعتبارك هذا المثال حيث سأل المستخدم ChatGPT "كم مرة فازت الأرجنتين بكأس العالم FIFA؟" قال مرة واحدة وأشار إلى فوز الفريق في 1978. ثم سأل مكبر الصوت عن الفريق الفائز في عام 1986.

سُئلت #ChatGPT abt من فاز بكأس العالم لكرة القدم 2022. لم تستطع الإجابة. هذا متوقع. ومع ذلك ، يبدو أنه يقدم معلومات خاطئة (في مقابل الفوزين الآخرين) على الرغم من وجود المعلومات في النظام. أي # تفسيرات؟ pic.twitter.com/fvxe05N12p

- indranil sinharoy (indranil_leo) 29 ديسمبر 2022

اعترف الشات بوت بأنه الأرجنتين دون أي تفسير لخطأه السابق.

الجزء المثير للقلق هو أن الإجابات الخاطئة للذكاء الاصطناعي غالبًا ما تُكتب بثقة شديدة ، فهي تمتزج في النص المحيط بها ، مما يجعلها تبدو معقولة تمامًا. يمكن أن تكون أيضًا شاملة ، كما هو مفصل في دعوى قضائية مرفوعة ضد Open.ai ، حيث يُزعم أن ChatGPT اختلق قصة اختلاس كاملة شاركها صحفي بعد ذلك.

كيف تتجنب هلوسة الذكاء الاصطناعي

بينما يمكن للذكاء الاصطناعي أن يضللك بإجابات من كلمة واحدة ، فمن المرجح أن تنحرف عن المسار عند كتابة نصوص أطول.

"من موجه واحد ، يمكن للذكاء الاصطناعي إنشاء مدونة أو كتاب إلكتروني. نعم ، هذا مذهل - ولكن هناك مشكلة ، "يحذر ويفر. "كلما زاد إنتاجه ، كلما كان عليك إجراء المزيد من التحرير والتحقق من الحقائق."

لتقليل فرص قيام أداة الذكاء الاصطناعي الخاصة بك بتدوير الروايات الهلوسة ، يقول ويفر إنه من الأفضل إنشاء مخطط تفصيلي وجعل الروبوت يعالجها قسمًا واحدًا في كل مرة. وبعد ذلك ، بالطبع ، اطلب من شخص ما مراجعة الحقائق والإحصائيات التي يضيفها.

الخطر رقم 3: إساءة استخدام أدوات الذكاء الاصطناعي

نستيقظ كل صباح على مجموعة جديدة من أدوات الذكاء الاصطناعي التي ظهرت على ما يبدو بين عشية وضحاها مثل عيش الغراب بعد عاصفة ممطرة.

ولكن لم يتم تصميم كل منصة لجميع وظائف التسويق ، ولا يمكن (حتى الآن) حل بعض تحديات التسويق بواسطة الذكاء الاصطناعي.

أدوات الذكاء الاصطناعي لها قيود

يعد ChatGPT مثالًا رائعًا. إن لعبة Belle of AI هي متعة للعب بها (مثل كتابة كيفية إزالة شطيرة زبدة الفول السوداني من VCR بأسلوب King James Bible). ويمكن أن ينتج عنه بعض الإجابات القصيرة المكتوبة جيدًا بشكل مدهش والتي تفسد كتلة الكاتب. لكن لا تطلب منه مساعدتك في إجراء بحث عن الكلمات الرئيسية.

فشل ChatGPT بسبب مجموعة بياناته القديمة نسبيًا والتي لا تتضمن سوى معلومات ما قبل عام 2022. اطلب منه تقديم كلمات رئيسية لـ "تسويق AI" ولن تتوافق إجاباته مع ما تجده في أدوات أخرى مثل Thinword أو Contextminds.

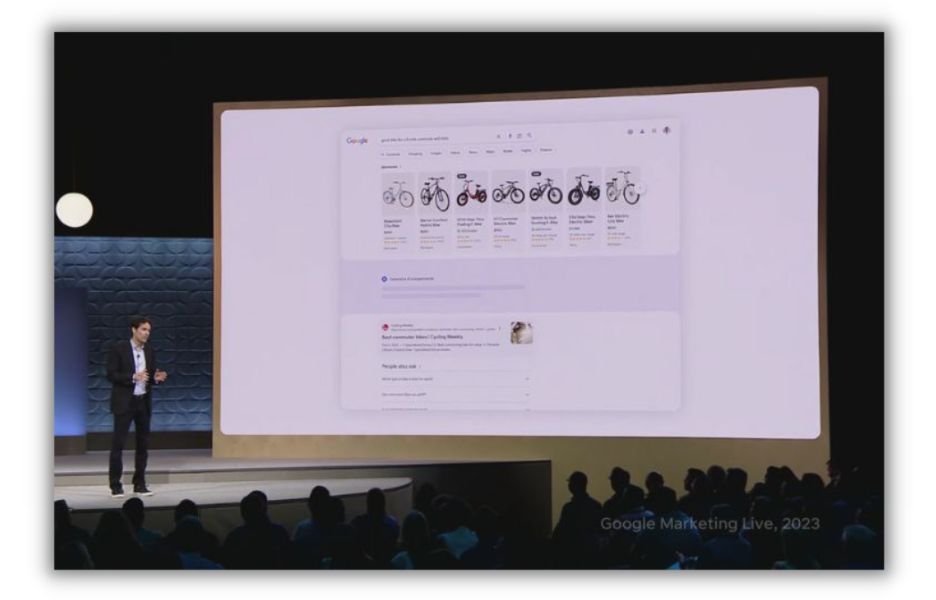

وبالمثل ، يمتلك كل من Google و Facebook أدوات جديدة مدعومة بالذكاء الاصطناعي لمساعدة جهات التسويق في إنشاء الإعلانات ، وتحسين الإنفاق الإعلاني ، وتخصيص تجربة الإعلان. لا يستطيع برنامج الدردشة الآلي حل هذه التحديات.

أعلنت Google عن عدد كبير من ترقيات الذكاء الاصطناعي لمنتجات إدارة البحث والإعلانات في حدث Google Marketing Live 2023.

يمكنك الإفراط في استخدام الذكاء الاصطناعي

إذا أعطيت أداة من أدوات الذكاء الاصطناعي مهمة فردية ، فيمكنها الفهرسة على هدف واحد فقط. يرى Nick Abbene ، خبير أتمتة التسويق ، هذا غالبًا مع الشركات التي تركز على تحسين مُحسّنات محرّكات البحث.

يقول أبيني: "المشكلة الأكبر التي أراها هي استخدام أدوات تحسين محركات البحث بشكل أعمى ، والإفراط في تحسين محركات البحث ، وتجاهل هدف البحث عن العملاء". "تعتبر أدوات تحسين محركات البحث (SEO) رائعة للإشارة إلى محتوى عالي الجودة لمحركات البحث. ولكن في النهاية ، تريد Google مطابقة طلب الباحث ".

كيفية تجنب سوء تطبيق أدوات الذكاء الاصطناعي

مفتاح الربط ليس الخيار الأفضل لقصف الأظافر. وبالمثل ، قد لا يكون مساعد الكتابة بالذكاء الاصطناعي مفيدًا لإنشاء صفحات الويب. قبل الدخول في أي خيار واحد من خيارات الذكاء الاصطناعي ، يقول Abbene للحصول على تعليقات من مُنشئ الأداة والمستخدمين الآخرين.

يقول: "لتجنب سوء اختيار أدوات الذكاء الاصطناعي ، افهم ما إذا كان المسوقون الآخرون يستخدمون الأداة لحالة الاستخدام الخاصة بك". "لا تتردد في طلب عرض توضيحي للمنتج أو تجربته جنبًا إلى جنب مع بعض الأدوات الأخرى التي تقدم نفس الوظيفة."

تتيح لك مواقع الويب مثل Capterra مقارنة العديد من منصات الذكاء الاصطناعي بسرعة.

وبمجرد أن تجد مجموعة أدوات الذكاء الاصطناعي الصحيحة ، استخدمها للمساعدة في العملية ، وليس الاستيلاء عليها. يقول أبيني: "لا تخف من استخدام أدوات الذكاء الاصطناعي لزيادة سير عملك ، ولكن استخدمها فقط من أجل ذلك". "ابدأ كل جزء من المحتوى من المبادئ الأولى ، من خلال البحث الجيد عن الكلمات الرئيسية وفهم هدف البحث."

الخطر رقم 4: محتوى متجانس

يمكن لمنظمة العفو الدولية كتابة مقال كامل في حوالي 10 ثوانٍ. ولكن بقدر ما أصبح الذكاء الاصطناعي التوليدي مثيرًا للإعجاب ، إلا أنه يفتقر إلى الفروق الدقيقة ليكون مبدعًا حقًا ، مما يجعل مخرجاته غالبًا ما تبدو آلية.

يقول ويفر: "في حين أن الذكاء الاصطناعي رائع في إنتاج محتوى غني بالمعلومات ، فإنه غالبًا ما يفتقر إلى الذوق الإبداعي والمشاركة التي يجلبها البشر إلى الطاولة".

صُنع الذكاء الاصطناعي لتقليده

اطلب من روبوت كتابة يعمل بالذكاء الاصطناعي كتابة تقرير عن كتابك ، وسوف يقوم بسهولة بتدوير 500 كلمة تشرح بكفاءة الموضوع الرئيسي لـ Catcher in the Rye (على افتراض أنه لا يهلوس هولدن كولفيلد باعتباره سارق بنك).

يمكنه فعل ذلك لأنه استوعب آلاف النصوص حول تحفة جي دي سالينجر.

اطلب الآن من صديقك في منظمة العفو الدولية كتابة منشور مدونة يشرح جوهر المفهوم لعملك بطريقة تلخص علامتك التجارية وجمهورك وعرض القيمة. قد تصاب بخيبة أمل. يقول ويفر: "لا يراعي المحتوى الذي يتم إنشاؤه بواسطة الذكاء الاصطناعي دائمًا الفروق الدقيقة في شخصية العلامة التجارية وقيمها ، وقد ينتج محتوى يخطئ الهدف".

بعبارة أخرى ، يعد الذكاء الاصطناعي رائعًا في استيعاب ما تم إنشاؤه بالفعل ودمجه وإعادة تكوينه. إنه ليس رائعًا في إنشاء شيء يبرز مقابل المحتوى الحالي.

أدوات الذكاء الاصطناعي التوليدية ليست جيدة أيضًا في جعل المحتوى جذابًا. سوف يقومون بسعادة بإخراج كتل ضخمة من الكلمات مع صورة أو رسم بياني أو نقطة رصاصة لإعطاء العيون المرهقة راحة. لن يسحبوا قصص العملاء أو الأمثلة الافتراضية لجعل النقطة أكثر ارتباطًا. وسيجدون صعوبة في ربط قصة إخبارية من صناعتك بالفائدة التي يوفرها منتجك.

كيفية تجنب المحتوى المتجانس

تحتوي بعض أدوات الذكاء الاصطناعي ، مثل Writer ، على ميزات مدمجة لمساعدة الكتاب في الحفاظ على شخصية علامة تجارية متسقة. ولكنك ستظل بحاجة إلى محرر "لمراجعة وتحرير المحتوى الخاص بصوت ونبرة العلامة التجارية للتأكد من أنها تلقى صدى لدى الجمهور وتعزز رسائل المنظمة وأهدافها" ، كما ينصح ويفر.

يمكن للمحررين والكتاب أيضًا رؤية مقال مثل البشر الآخرين. إذا كانت هناك كتلة غير قابلة للاختراق من الكلمات ، فسيكونون هم من يفصلونها ويضيفون القليل من الزوجة المرئية.

استخدم محتوى AI كنقطة بداية - كطريقة للمساعدة في إطلاق إبداعك وأبحاثك. لكن دائما أضف لمستك الشخصية.

المخاطرة رقم 5: فقدان تحسين محركات البحث (SEO)

كان موقف Google بشأن محتوى الذكاء الاصطناعي غامضًا بعض الشيء. في البداية ، بدا أن محرك البحث سيعاقب المنشورات المكتوبة باستخدام الذكاء الاصطناعي.

[الصورة: تغريدة من جون مولر على الذكاء الاصطناعي]

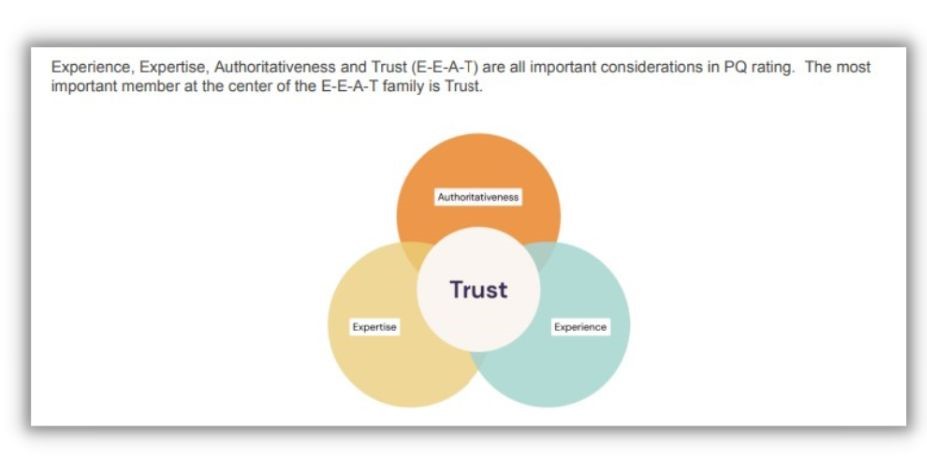

في الآونة الأخيرة ، قالت مدونة مطوري Google أن الذكاء الاصطناعي لا بأس به في كتابهم. لكن هناك غمزة كبيرة مع هذا التأكيد. فقط "المحتوى الذي يوضح صفات ما نسميه EEAT: الخبرة والتجربة والمصداقية والجدارة بالثقة" هو الذي سيثير إعجاب مقيمي البحث البشري الذين يقيّمون باستمرار أنظمة تصنيف Google.

الثقة هي القابض للسيو

من بين EEAT من Google ، العامل الوحيد الذي يحكمهم جميعًا هو الثقة.

[مصدر]

لقد ناقشنا بالفعل أن محتوى الذكاء الاصطناعي عرضة للمغالطات ، مما يجعله غير جدير بالثقة بطبيعته دون إشراف بشري. كما أنه يفشل في تلبية المتطلبات الداعمة لأنه ، بطبيعته ، لا يكتبه شخص لديه خبرة أو سلطة أو خبرة في هذا الموضوع.

خذ منشور مدونة حول خبز خبز الموز. سيعطيك روبوت AI وصفة في حوالي ثانيتين. لكنها لا تستطيع شمع شعري في أيام الشتاء الباردة التي تقضي في الخبز لعائلتها. أو تحدث عن السنوات التي قضاها في تجربة أنواع مختلفة من الدقيق كخباز تجاري. هذه المنظورات هي ما يبحث عنه مقيمو بحث Google.

يبدو أيضًا أنه ما يتوق إليه الناس أيضًا. لهذا السبب يلجأ الكثير منهم إلى أشخاص حقيقيين على مقاطع فيديو TikTok لمعرفة الأشياء التي اعتادوا العثور عليها على Google.

كيفية تجنب فقدان تحسين محركات البحث

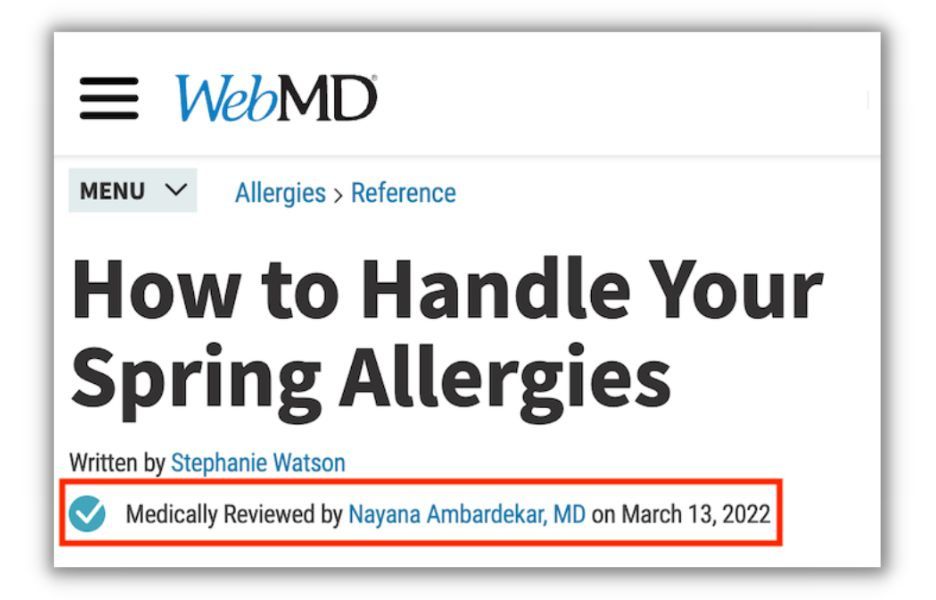

إن الشيء العظيم في الذكاء الاصطناعي هو أنه لا يمانع في مشاركة الخطوط الثانوية. لذلك عندما تستخدم chatbot لتسريع إنتاج المحتوى ، تأكد من إحالة مؤلف بشري بأوراق اعتماد.

ينطبق هذا بشكل خاص على الموضوعات الحساسة مثل الرعاية الصحية والتمويل الشخصي ، والتي تسميها Google مواضيع Your Money ، Your Life. "إذا كنت في مجال YMYL ، فامنح الأولوية للسلطة والثقة والدقة قبل كل شيء في المحتوى الخاص بك ،" تنصح إليسا جاببرت ، مديرة المحتوى وتحسين محركات البحث في WordStream و LocaliQ.

عند الكتابة عن الرعاية الصحية ، على سبيل المثال ، قم بمراجعة مشاركاتك بواسطة أخصائي طبي وقم بالإشارة إليها في المنشور. هذه إشارة قوية إلى Google على أن المحتوى الخاص بك جدير بالثقة ، حتى لو بدأ في chatbot.

المخاطرة رقم 6: التحديات القانونية

يتعلم الذكاء الاصطناعي التوليدي من العمل الذي ابتكره البشر ، ثم يخلق شيئًا جديدًا (العش). إن مسألة حقوق النشر غير واضحة لكل من مدخلات ومخرجات نموذج محتوى الذكاء الاصطناعي.

من المحتمل أن يكون العمل الحالي لعبة عادلة للذكاء الاصطناعي

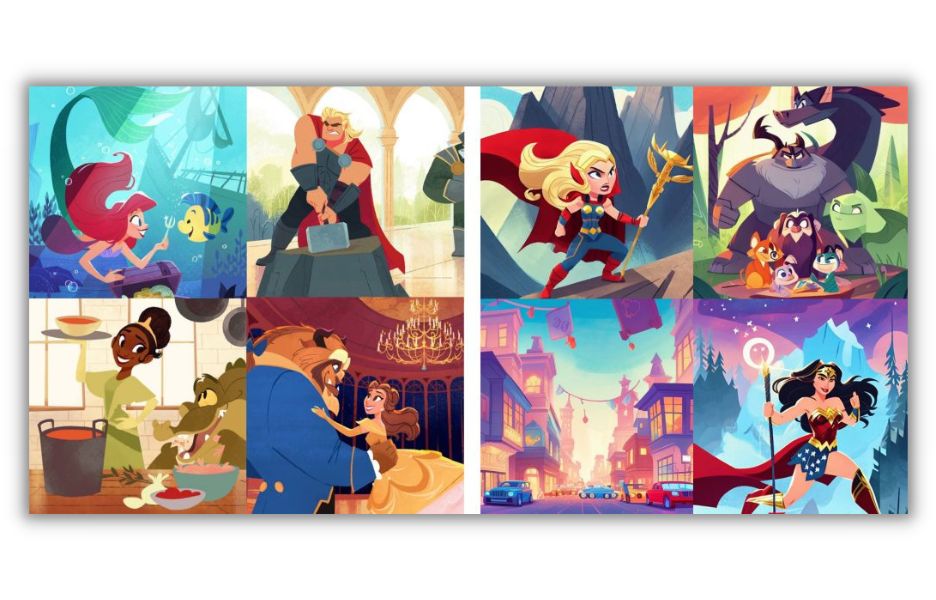

لتوضيح (يقصد التورية) سؤال حقوق الطبع والنشر للأعمال التي تغذي نماذج التعلم الكبيرة ، ننتقل إلى حالة أبلغ عنها التقني آندي بايو. كما تشرح بايو ، علمت فنانة مقرها لوس أنجلوس تدعى هولي مينجرت أن 32 من الرسوم التوضيحية الخاصة بها قد تم استيعابها في نموذج AI ، ثم تم تقديمها عبر ترخيص مفتوح لأي شخص يريد إعادة إنشاء أسلوبها.

التسمية التوضيحية: مجموعة من الرسوم التوضيحية للفنانة Hollie Mengert (على اليسار) مقارنة بالرسوم التوضيحية التي تم إنشاؤها بواسطة AI بناءً على أسلوبها ، كما قام برعاية Andy Baio .

تصبح القصة أكثر تعقيدًا عندما تعلم أنها صنعت العديد من صورها لعملاء مثل ديزني ، الذين يمتلكون بالفعل حقوقها.

هل يمكن للرسامين (أو الكتاب أو المبرمجين) الذين يجدون أنفسهم في نفس المكان مع Mengert أن يقاضوا بنجاح انتهاك حقوق النشر؟

لا توجد إجابة واضحة على السؤال حتى الآن. قال بايو لموقع The Verge: "أرى الناس على كلا الجانبين واثقين للغاية في مواقفهم ، لكن الحقيقة لا أحد يعرفها". "وأي شخص يقول إنه يعرف بثقة كيف سيتم ذلك في المحكمة هو مخطئ."

إذا تم تدريب الذكاء الاصطناعي الذي تستخدمه لإنشاء صورة أو مقالة على آلاف الأعمال من العديد من المبدعين ، فمن غير المحتمل أن تخسر دعوى قضائية. ولكن إذا قمت بإطعام الجهاز عشرة كتب لستيفن كينج وأخبرت الروبوت أن يكتب كتابًا جديدًا بهذا الأسلوب ، فقد تكون في مشكلة.

إخلاء المسؤولية: نحن لسنا محامين ، لذا يرجى الحصول على استشارة قانونية إذا لم تكن متأكدًا.

قد لا يكون محتوى AI الخاص بك محميًا أيضًا

ماذا عن المحتوى الذي تنشئه باستخدام chatbot ، هل تغطيه قوانين حقوق النشر؟ بالنسبة للجزء الأكبر ، لا يحدث ذلك إلا إذا قمت بعمل كبير لتحريره. مما يعني أنه سيكون لديك القليل من اللجوء إذا أعاد شخص ما (اقرأ: يسرق) منشوراتك لمدونته الخاصة.

بالنسبة للمحتوى المحمي ، قد يكون مبرمج الذكاء الاصطناعي ، وليس أنت ، صاحب الحقوق. تعتبر العديد من البلدان أن صانع الأداة التي أنتجت العمل هو منشئه ، وليس الشخص الذي كتب في الموجه.

كيف تتجنب التحديات القانونية

ابدأ باستخدام أداة إنشاء محتوى ذكاء اصطناعي حسنة السمعة. ابحث عن واحد يحتوي على الكثير من المراجعات الإيجابية التي تنتجها شركة تتناول بوضوح موقفها من قوانين حقوق النشر.

أيضًا ، استخدم حكمك الجيد لتقرير ما إذا كنت تنسخ عمداً عمل منشئ محتوى أو تستخدم الذكاء الاصطناعي لزيادة عملك.

وإذا كنت تريد فرصة قتال في المحكمة لحماية ما تنتجه ، فقم بإجراء الكثير من التغييرات الجوهرية. أو استخدم الذكاء الاصطناعي للمساعدة في إنشاء مخطط تفصيلي ، ولكن اكتب معظم الكلمات بنفسك.

الخطر رقم 7: انتهاكات الأمان والخصوصية

تقدم أدوات الذكاء الاصطناعي للمسوقين مجموعة واسعة من التهديدات المحتملة لأمن أنظمتهم وخصوصية البيانات. بعضها هجمات مباشرة من جهات ضارة. والبعض الآخر مجرد مستخدمين يقدمون عن غير قصد معلومات حساسة إلى نظام مصمم لمشاركتها.

مخاطر الأمان من أدوات الذكاء الاصطناعي

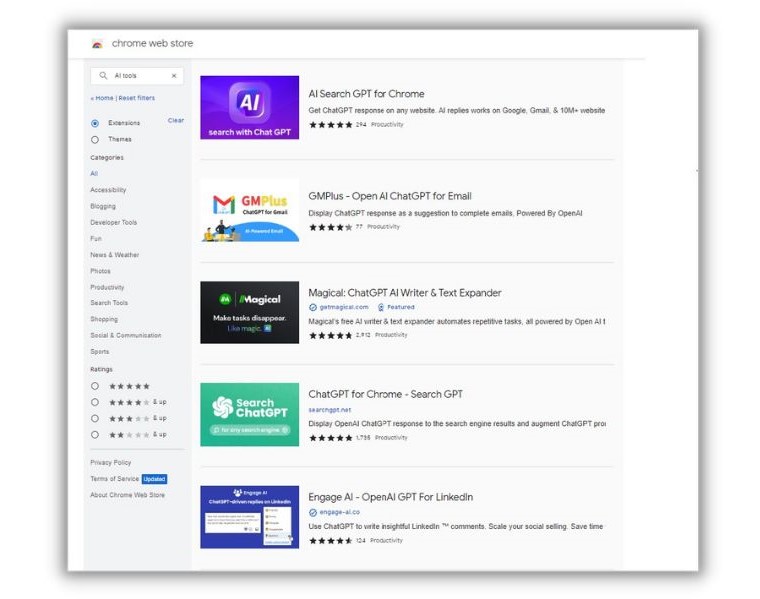

"هناك الكثير من المنتجات التي تبدو وتشعر وتتصرف كأدوات شرعية ، لكنها في الحقيقة برامج ضارة" ، هكذا أخبرتنا إلين أتويل ، كبيرة محرري تسويق المحتوى في موفر أمان نقطة النهاية Kolide. "من الصعب للغاية التمييز بينها وبين الأدوات الشرعية ويمكنك العثور عليها في متجر Chrome الآن."

اكتب أي إصدار من "أدوات الذكاء الاصطناعي" في متجر Google Chrome ولن تجد نقصًا في الخيارات.

كتب أتويل عن هذه المخاطر على مدونة Kolide. في مقالتها ، أشارت إلى حادثة كانت فيها إضافة Chrome تسمى "الوصول السريع إلى Chat GPT" خدعة في الواقع. بمجرد التنزيل ، قام البرنامج باختراق حسابات المستخدمين على Facebook ومرر جميع ملفات تعريف الارتباط الخاصة بالضحية - حتى تلك من أجل الأمان. أفاد أتويل أن أكثر من 2000 شخص قاموا بتنزيل الامتداد كل يوم.

الخصوصية غير محمية

يقول أتويل إنه حتى أداة الذكاء الاصطناعي المشروعة يمكن أن تشكل خطرًا أمنيًا. "... في الوقت الحالي ، ليس لدى معظم الشركات حتى سياسات مطبقة لتقييم أنواع ومستويات المخاطر التي تشكلها الامتدادات المختلفة. وفي غياب إرشادات واضحة ، يقوم الأشخاص في جميع أنحاء العالم بتثبيت هؤلاء المساعدين الصغار وتزويدهم ببيانات حساسة ".

لنفترض أنك تكتب تقريرًا ماليًا داخليًا لمشاركته مع المستثمرين. تذكر أن شبكات الذكاء الاصطناعي تتعلم مما يُعطى لها لإنتاج مخرجات للمستخدمين الآخرين. يمكن أن تكون جميع البيانات التي تضعها في روبوت الدردشة المدعوم بالذكاء الاصطناعي لعبة عادلة للأشخاص خارج شركتك. وقد تظهر فجأة إذا سأل أحد المنافسين عن أرباحك النهائية.

كيفية تجنب مخاطر الخصوصية والأمان

أول خط دفاع هو التأكد من أن البرنامج هو ما يدعي أنه موجود. أبعد من ذلك ، كن حذرًا بشأن كيفية استخدامك للأدوات التي تختارها. يقول أتويل: "إذا كنت ستستخدم أدوات الذكاء الاصطناعي (ولديها بالفعل استخدامات!) فلا تغذيها بأي بيانات يمكن اعتبارها حساسة".

أيضًا ، أثناء قيامك بمراجعة أدوات الذكاء الاصطناعي لمعرفة الفائدة والتحيز ، اسأل عن سياسات الخصوصية والأمان الخاصة بها.

التخفيف من مخاطر استخدام الذكاء الاصطناعي للتسويق

يتقدم الذكاء الاصطناعي بمعدل مذهل. في أقل من عام ، شهد Chat GTP بالفعل تعزيزات كبيرة في قدراته. من المستحيل معرفة ما يمكننا فعله باستخدام الذكاء الاصطناعي في الأشهر الستة إلى الاثني عشر القادمة. ولا يمكننا توقع المشاكل المحتملة.

فيما يلي عدة طرق يمكنك من خلالها تحسين نتائج التسويق باستخدام الذكاء الاصطناعي مع تجنب بعض المخاطر الأكثر شيوعًا:

- اطلب من المحررين البشريين مراجعة المحتوى من حيث الجودة وسهولة القراءة وصوت العلامة التجارية

- قم بفحص كل أداة تستخدمها للأمان والقدرة

- راجع بانتظام استهداف الإعلانات الموجه بالذكاء الاصطناعي لمعرفة التحيز

- تقييم النسخ والصور لاحتمال انتهاك حقوق النشر

نود أن نشكر Elain Attwell و Brett McHale و Nick Abenne و Alaura Weaver على المساهمة في هذا المنشور.

للتلخيص ، دعنا نراجع قائمة المخاطر التي تأتي مع استخدام الذكاء الاصطناعي للتسويق:

- تحيز التعلم الآلي

- مغالطات واقعية

- إساءة استخدام أدوات الذكاء الاصطناعي

- محتوى متجانس

- فقدان السيو

- التحديات القانونية

- انتهاكات الأمن والخصوصية