Ética de la IA: cómo los especialistas en marketing deberían adoptar la innovación de manera responsable

Publicado: 2023-08-21La inteligencia artificial (IA) no es solo un fenómeno de ciencia ficción convertido en realidad, es un pilar tecnológico, desarrollado durante décadas justo debajo de nuestras narices. La IA ha hecho realidad los sueños de una mayor eficiencia y muchas marcas ya han aprovechado el marketing de IA en los últimos años.

Aunque ha despertado entusiasmo y entusiasmo, existen preocupaciones en torno a la ética de la IA. Como muchas innovaciones, la visión de la industria tecnológica para el metaverso tenía similitudes inquietantes con medios como Black Mirror y Snow Crash . Y con trabajos como La parábola del sembrador, la máquina y Yo, robot dentro del espíritu cultural, es comprensible por qué los fanáticos de la ciencia ficción, los investigadores y los tecnólogos advierten sobre los peligros de ignorar la ética de la IA.

En este artículo, definiremos qué es la ética de la IA, por qué las marcas deberían preocuparse y los principales problemas éticos que enfrentan los especialistas en marketing, incluida la seguridad laboral, la desinformación y el sesgo algorítmico. También compartiremos cinco pasos para ayudarlo a mantener prácticas éticas de IA dentro de los equipos y en toda la organización.

¿Qué es la ética de la IA?

La ética de la IA es un sistema de principios morales y prácticas profesionales que se utilizan para informar de manera responsable el desarrollo y los resultados de la tecnología de inteligencia artificial. También se refiere al estudio de cómo optimizar el impacto y reducir los riesgos y/o consecuencias de la IA.

Las principales empresas tecnológicas, entidades gubernamentales como las Naciones Unidas y las comunidades de investigación y ciencia de datos han trabajado para dar forma y publicar pautas para abordar problemas éticos. Por ejemplo, la Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura (UNESCO) publicó el primer estándar mundial sobre ética de la IA en noviembre de 2021: la Recomendación sobre la ética de la inteligencia artificial.

Existen algunas regulaciones de IA a nivel nacional y local, pero a medida que crecen la IA y otras tecnologías emergentes, las empresas deben esperar más regulaciones gubernamentales. A medida que la IA se integra más en nuestras vidas, la ética de la IA se convierte en una parte fundamental de la alfabetización digital.

Por qué es importante la ética de la IA

Las empresas ya están invirtiendo en IA, pero la dificultad es garantizar un uso responsable.

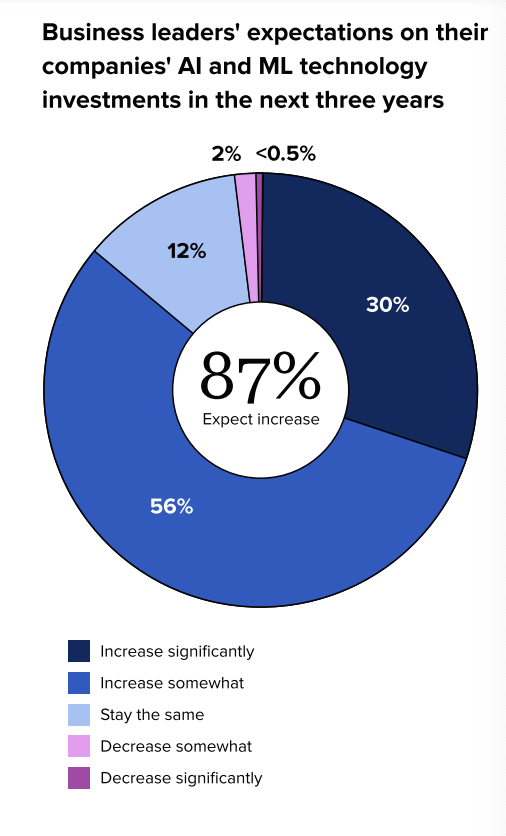

Según el informe 2023 State of Social Media: AI and Data Take Center Stage, los líderes empresariales esperan mayores inversiones en IA en los próximos años. Nuestro informe también encontró que el 98 % de los líderes empresariales están de acuerdo en que las empresas deben comprender mejor el potencial de la IA y la tecnología de aprendizaje automático (ML) para lograr el éxito a largo plazo.

Si bien la IA puede mejorar el rendimiento, aumentar la eficiencia y generar resultados comerciales positivos, las marcas también están experimentando consecuencias imprevistas de su aplicación. Esto puede deberse a la falta de investigación o conjuntos de datos sesgados, entre otras razones. El mal uso de la IA o el descuido de las preocupaciones éticas puede resultar en una reputación de marca dañada, fallas en los productos, litigios y problemas regulatorios.

El primer paso para mantener los estándares éticos en todos los equipos dentro de su organización comienza con la comprensión de los problemas que enfrentan los especialistas en marketing, de modo que pueda diseñar un plan para mitigar estos riesgos comerciales y proteger su marca.

¿Qué problemas de ética de la IA son lo más importante para los especialistas en marketing?

Hay una variedad de preocupaciones éticas de IA en la industria de la tecnología que incluyen, entre otras, las siguientes:

- Generación de contenido falso

- Explicabilidad

- Impacto social

- Mal uso de la tecnología

- Inclinación

- Responsabilidad y privacidad de los datos

- Justicia

- Robustez

- Transparencia

- Sostenibilidad del medio ambiente

- Diversidad e inclusión

- Agencia moral y alineación de valores

- Confianza y responsabilidad

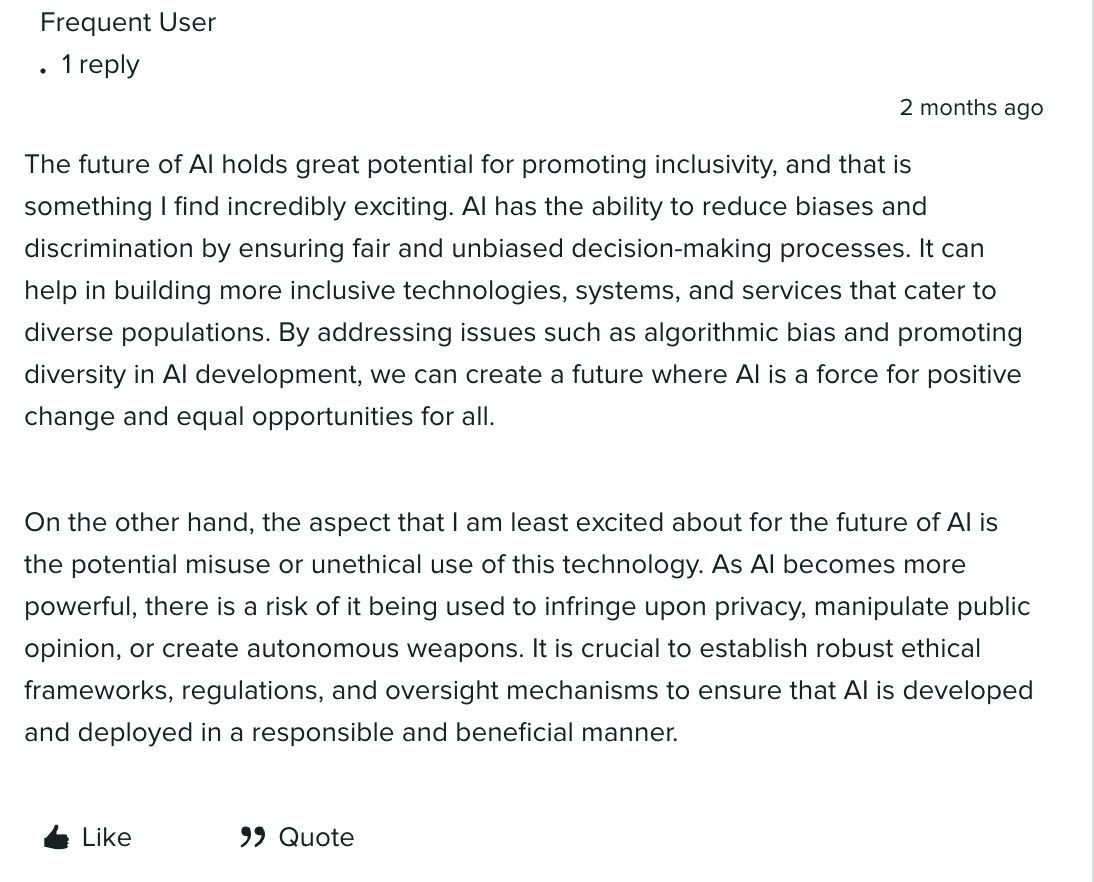

Algunos creen que la IA puede ayudar a construir tecnologías, sistemas y servicios más inclusivos que puedan atender a poblaciones diversas. La clave es establecer marcos éticos, regulaciones y mecanismos para asegurar un uso responsable.

Un miembro del Arboretum, el foro comunitario de Sprout, señaló que la IA tiene el potencial de promover la inclusión y reducir los sesgos y la discriminación al garantizar procesos de toma de decisiones justos e imparciales. Al abordar problemas como el sesgo algorítmico en el desarrollo de la IA, podría ser posible dar forma a un futuro en el que la IA sea una fuerza positiva de cambio.

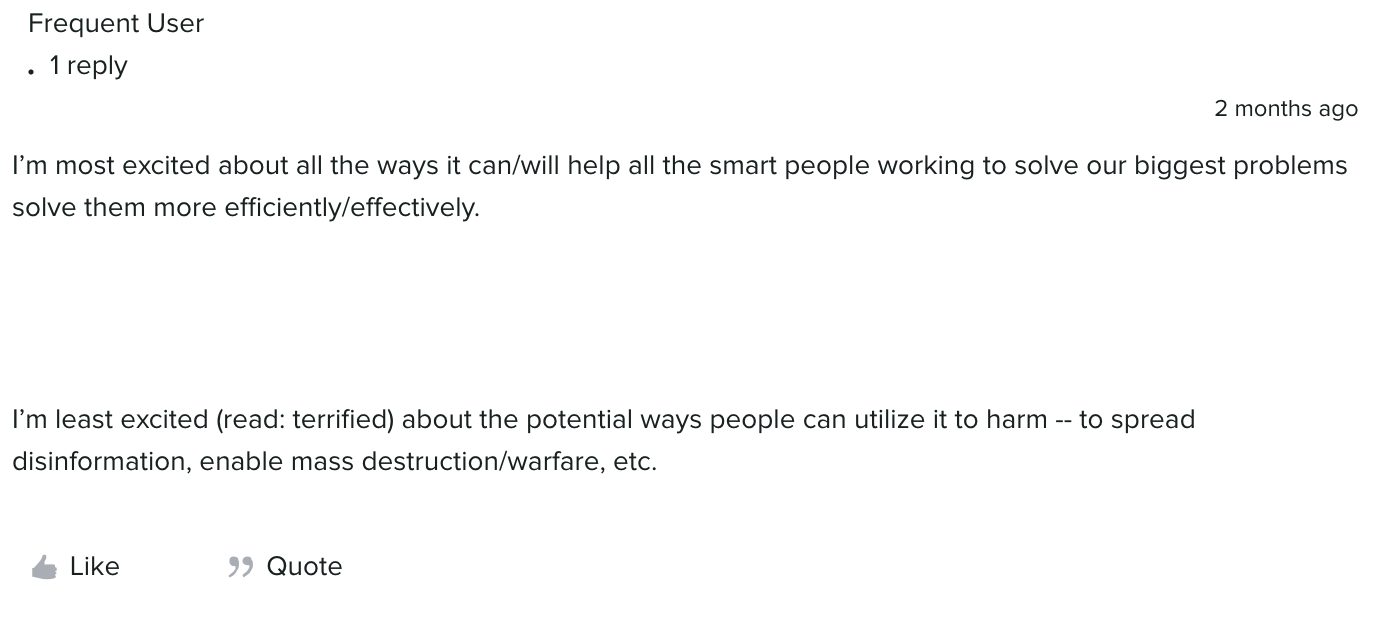

Junto con el potencial de cambio positivo, también existen oportunidades para el uso indebido o poco ético de la IA a medida que se vuelve más poderosa. Nuestra comunidad discutió varios riesgos, incluida la violación de la privacidad, la manipulación de la opinión pública y las armas autónomas.

Comentarios como estos solo arañan la superficie de las preocupaciones éticas en todas las industrias, pero los principales problemas para los especialistas en marketing incluyen: seguridad laboral, privacidad, prejuicios y discriminación, información errónea y desinformación, y problemas de propiedad intelectual/derechos de autor, que analizaremos en detalle en el Siguiente sección.

Impacto en el empleo y desplazamiento laboral

Los robots que aseguran la dominación mundial son la menor de nuestras preocupaciones, al menos por ahora.

Y eso se debe a que los investigadores y expertos no se ven amenazados por la singularidad de la tecnología o la idea de que la IA superará a la inteligencia humana y replicará rasgos como las habilidades sociales. Son conscientes de las limitaciones de la IA y las posibles ramificaciones del reemplazo de puestos de trabajo.

El objetivo de investigar e invertir en IA no es reemplazar a los humanos, es ayudarnos a ahorrar tiempo y esfuerzo para hacer cosas más impactantes. El director de redes sociales y asociaciones de Flock Freight, Bob Wolfley, compartió una gran analogía para la IA: “La IA es como el lavavajillas o la lavadora en nuestros hogares. Piensa en todo el tiempo que ahorras al no lavar los platos o la ropa a mano”.

En nuestra serie Unread, los miembros del equipo creativo y de marketing de Sprout discutieron cómo usan actualmente la IA, desde permitirse compras personalizadas hasta usar funciones como ViralPost para ayudar a programar publicaciones en redes sociales. Mire el vídeo a continuación para escuchar sus opiniones sobre los beneficios y los temores de la IA, incluido el reemplazo de empleo:

Preocupaciones sobre la privacidad

Las preocupaciones en torno a la privacidad, la protección y la seguridad de los datos son una prioridad para las marcas. Las inversiones en seguridad son una prioridad cada vez mayor para las empresas, ya que buscan evitar cualquier oportunidad de vigilancia, piratería y ataques cibernéticos. A medida que la personalización se vuelve más popular, las marcas implementan las mejores prácticas para recopilar, almacenar y analizar datos para proteger a los clientes y las organizaciones.

Sesgo algorítmico y discriminación

Dado que aprende de los datos, una IA mal construida o entrenada puede demostrar sesgo contra subconjuntos de datos subrepresentados. Ha habido varios casos importantes de sesgo con obras de arte generadas por IA, chatbots, software de reconocimiento facial, algoritmos y herramientas de IA para prácticas de contratación.

Por ejemplo, varios usuarios de TikTok y Twitter [rebautizados como X a partir de julio de 2023] mencionaron un hilo que presentaba "#SouthSudan Barbie" adornada con armas, un estereotipo negativo asociado con una región que lidia con problemas sociopolíticos como el genocidio y las crisis de refugiados. .

![Una respuesta de un usuario a una foto generada por IA de "#SouthSudan Barbie" en un hilo de Twitter [rebautizado como X a partir de julio de 2023]. La publicación dice: "Seguimos diciéndoles a todos que el sesgo está integrado en esta basura generada por IA".](/uploads/article/221435/S1hZxuJ0KyrnC8ur.png)

Con el sesgo entrando en juego aún más bajo, la IA usa casos como este, la pregunta es ¿cómo trabajamos contra el sesgo y la discriminación cuando los conjuntos de datos de entrenamiento pueden prestarse al sesgo?

Desinformación y desinformación

Al igual que los humanos, la IA no es perfecta. Las respuestas de la IA a las indicaciones pueden ser inexactas y existe el temor de que las personas difundan información errónea con intenciones maliciosas. Junto con las amenazas de desinformación, existe la posibilidad de una crisis de marca y un daño a la reputación, especialmente sin las medidas de seguridad y los protocolos adecuados.

Problemas de propiedad intelectual y derechos de autor

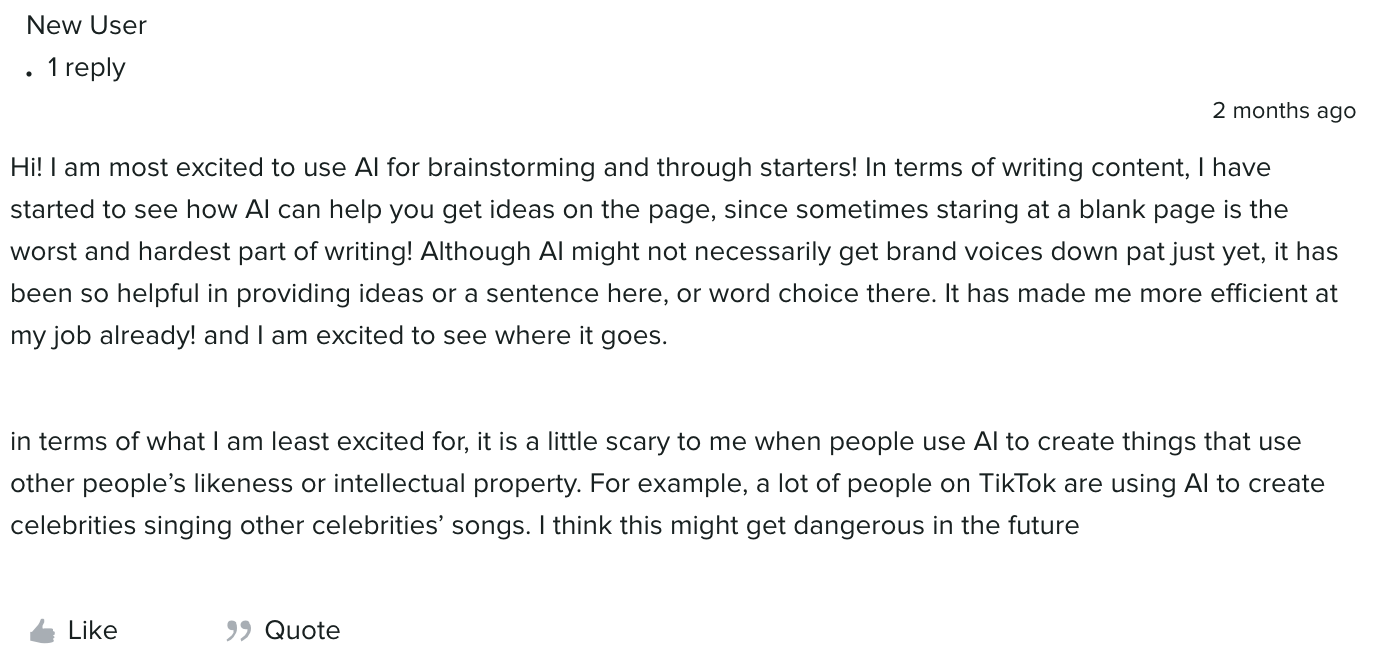

Probablemente hayas visto al elenco de Harry Potter como personajes de una película de Wes Anderson o a los ciudadanos de Fondo de Bikini cantando interpretaciones de canciones populares. Estos son ejemplos de cuántos están utilizando la IA para utilizar la imagen y semejanza de las personas o la propiedad intelectual.

La IA es un excelente compañero de entrenamiento para tareas creativas como la lluvia de ideas y la creación de esquemas, pero dependiendo de cómo se utilicen los resultados, podría dar lugar a infracciones de derechos de autor, plagio y violaciones de propiedad intelectual. Por ejemplo, un grupo de artistas presentó una demanda contra Midjourney y Stability AI en enero de 2023 alegando que las herramientas infringían los derechos de millones de artistas. La IA generativa abre una lata de gusanos legal y todavía queda mucho camino por recorrer, pero la creación de reglas y marcos proactivos ayudará a mitigar los riesgos éticos.

5 pasos para mantener la ética de la IA dentro de los equipos

A continuación se presentan cinco pasos que le ayudarán a guiar su plan para mitigar los riesgos éticos de la IA:

1. Establecer reglas básicas internas y responsabilidades para el uso de la IA.

Considere la posibilidad de establecer un equipo de ética de IA formado por especialistas en ética, expertos legales, tecnólogos y líderes para ayudar a establecer reglas básicas para su organización. Por ejemplo, utilizar únicamente IA generativa para borradores y lluvias de ideas, pero no para contenido publicado externamente, es una excelente regla básica.

Junto con estas reglas básicas, defina el rol y las responsabilidades de cada miembro del equipo involucrado en la IA, incluido el equipo de ética. Establece también tus objetivos y valores para la IA. Esto ayudará a sentar las bases de su política de ética y mejores prácticas de IA.

2. Definir y auditar el papel de la IA

La IA no puede reemplazar a los creadores de contenido, a los estrategas de redes sociales ni a ningún rol en el marketing. Identifique las tareas de IA que requieren supervisión o intervención humana y señale los objetivos de su política de ética de IA para ayudar a diseñar procesos para desarrollar, gestionar y comunicar sobre la IA.

Una vez que identifique los objetivos de su política de ética, identifique las brechas y oportunidades para la IA en su organización. Considere las siguientes preguntas:

- ¿Cómo utiliza actualmente la organización la IA y cómo queremos utilizarla en el futuro?

- ¿Qué software y análisis pueden ayudarnos a mitigar los riesgos comerciales?

- ¿Qué brechas crean la tecnología y el análisis? ¿Cómo los llenamos?

- ¿Qué pruebas o experimentos necesitamos realizar?

- ¿Qué soluciones existentes podemos utilizar con las mejores prácticas actuales para nuestros equipos de productos?

- ¿Cómo utilizará los datos y los conocimientos?

- ¿Cómo estableceremos el posicionamiento de nuestra marca y los mensajes para las tecnologías y la ética de la IA?

3. Desarrollar un proceso hermético de evaluación de proveedores

Asóciese con sus equipos legales y de TI para examinar adecuadamente cualquier herramienta con capacidades de IA y establecer un proceso de riesgo ético. Su experiencia le ayudará a evaluar nuevas consideraciones, como el conjunto de datos en el que está entrenada una herramienta y los controles que tienen los proveedores para mitigar el sesgo de la IA. Un proceso de debida diligencia para cada herramienta antes de lanzarla externa o internamente le ayudará a mitigar riesgos futuros.

4. Mantener la transparencia con las divulgaciones

Colabore con sus equipos legales y/o de privacidad para desarrollar mensajes externos y/o descargos de responsabilidad para indicar dónde y cuándo su marca depende de la IA. Estos mensajes se pueden utilizar para contenido, atención al cliente, etc. Por ejemplo, TikTok actualizó sus pautas comunitarias para exigir a los creadores que etiqueten el contenido generado por IA. Comunicar sus estándares y marcos éticos para defender la ética de la IA ayudará a ganarse la confianza de sus pares, clientes potenciales y clientes.

5. Continuar la educación entre líderes y equipos.

La IA no es algo a lo que el liderazgo empresarial pueda apresurarse. Como cualquier nueva ola de innovación emergente, habrá una curva de aprendizaje, además de nuevos hitos tecnológicos. Ayude a nivelar el campo de juego organizando capacitaciones y talleres internos para educar a todos los miembros del equipo, líderes y partes interesadas sobre la ética de la IA y cómo construirla de manera responsable.

Haz lo correcto con la ética de la IA

Considerar que la ética no es sólo lo correcto: es un componente crítico para aprovechar la tecnología de IA en los negocios.

Conozca más perspectivas de líderes y especialistas en marketing sobre cómo la IA afectará el futuro de las redes sociales en nuestro seminario web, junto con otros hallazgos del Informe sobre el estado de las redes sociales de 2023 y consejos para crear contenido social impactante.