Éthique de l'IA : comment les spécialistes du marketing devraient adopter l'innovation de manière responsable

Publié: 2023-08-21L'intelligence artificielle (IA) n'est pas seulement un phénomène de science-fiction devenu réalité : c'est un pilier technologique, développé au fil des décennies, sous nos yeux. L'IA a concrétisé les rêves d'efficacité accrue, de nombreuses marques ayant déjà tiré parti du marketing de l'IA au cours des dernières années.

Bien que cela ait suscité de l'enthousiasme et de l'enthousiasme, l'éthique de l'IA suscite des inquiétudes. Comme de nombreuses innovations, la vision de l'industrie technologique pour le métaverse présentait d'étranges similitudes avec des médias comme Black Mirror et Snow Crash . Et avec des œuvres comme La Parabole du Semeur, la Machine et Moi, Robot dans l'air du temps culturel, il est compréhensible que les fans de science-fiction, les chercheurs et les technologues mettent en garde contre les dangers d'ignorer l'éthique de l'IA.

Dans cet article, nous définirons ce qu'est l'éthique de l'IA, pourquoi les marques devraient s'inquiéter et les principaux problèmes éthiques auxquels sont confrontés les spécialistes du marketing, notamment la sécurité de l'emploi, la désinformation et les biais algorithmiques. Nous partagerons également cinq étapes pour vous aider à maintenir des pratiques d'IA éthiques au sein des équipes et dans toute l'organisation.

Qu’est-ce que l’éthique de l’IA ?

L’éthique de l’IA est un système de principes moraux et de pratiques professionnelles utilisé pour éclairer de manière responsable le développement et les résultats de la technologie de l’intelligence artificielle. Il renvoie également à l'étude de la manière d'optimiser l'impact et de réduire les risques et/ou les conséquences de l'IA.

Les principales entreprises technologiques, les entités gouvernementales comme les Nations Unies et les communautés de recherche et de science des données ont travaillé pour façonner et publier des lignes directrices visant à résoudre les problèmes éthiques. Par exemple, l’Organisation des Nations Unies pour l’éducation, la science et la culture (UNESCO) a publié la première norme mondiale sur l’éthique de l’IA en novembre 2021 : la Recommandation sur l’éthique de l’intelligence artificielle.

Certaines réglementations en matière d'IA sont en place aux niveaux national et local, mais à mesure que l'IA et d'autres technologies émergentes se développent, les entreprises doivent s'attendre à davantage de réglementation gouvernementale. À mesure que l'IA s'intègre davantage dans nos vies, l'éthique de l'IA devient un élément essentiel de la littératie numérique.

Pourquoi l'éthique de l'IA est importante

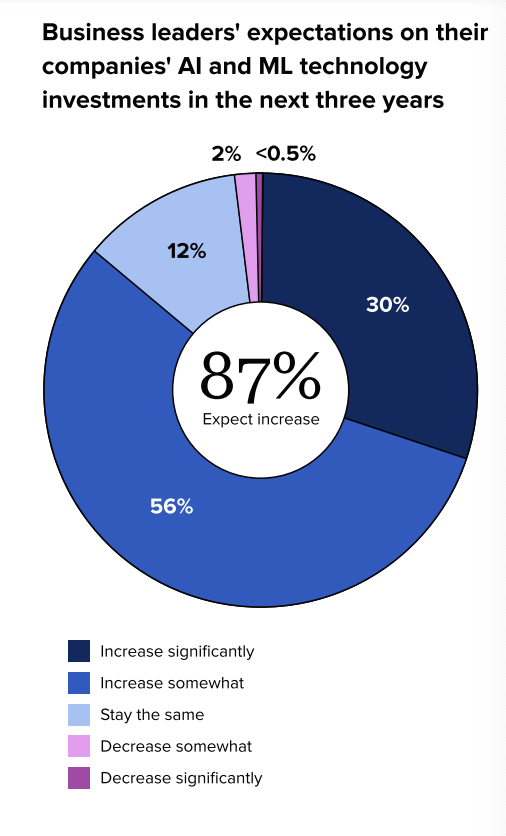

Les entreprises investissent déjà dans l'IA, mais la difficulté est d'en assurer une utilisation responsable.

Selon le rapport The 2023 State of Social Media: AI and Data Take Center Stage, les chefs d’entreprise s’attendent à une augmentation des investissements dans l’IA au cours des prochaines années. Notre rapport révèle également que 98 % des chefs d'entreprise conviennent que les entreprises doivent mieux comprendre le potentiel de la technologie de l'IA et de l'apprentissage automatique (ML) pour réussir à long terme.

Si l’IA peut améliorer les performances, accroître l’efficacité et générer des résultats commerciaux positifs, les marques subissent également des conséquences imprévues de son application. Cela peut provenir d'un manque de recherche ou d'ensembles de données biaisés, entre autres raisons. L'utilisation abusive de l'IA ou la négligence des préoccupations éthiques peuvent entraîner une réputation de marque endommagée, des défaillances de produits, des litiges et des problèmes réglementaires.

La première étape pour faire respecter les normes éthiques au sein des équipes de votre organisation commence par comprendre les problèmes auxquels les spécialistes du marketing sont confrontés, afin que vous puissiez élaborer un plan pour atténuer ces risques commerciaux et protéger votre marque.

Quelles sont les questions d'éthique de l'IA qui sont au cœur des préoccupations des spécialistes du marketing

Il existe une variété de préoccupations éthiques liées à l'IA dans l'industrie technologique, notamment, mais sans s'y limiter, les suivantes :

- Génération de faux contenus

- Explicabilité

- Impact sociétal

- Utilisation abusive de la technologie

- Biais

- Responsabilité et confidentialité des données

- Justice

- Robustesse

- Transparence

- La durabilité environnementale

- Diversité et inclusion

- Agentivité morale et alignement des valeurs

- Confiance et responsabilité

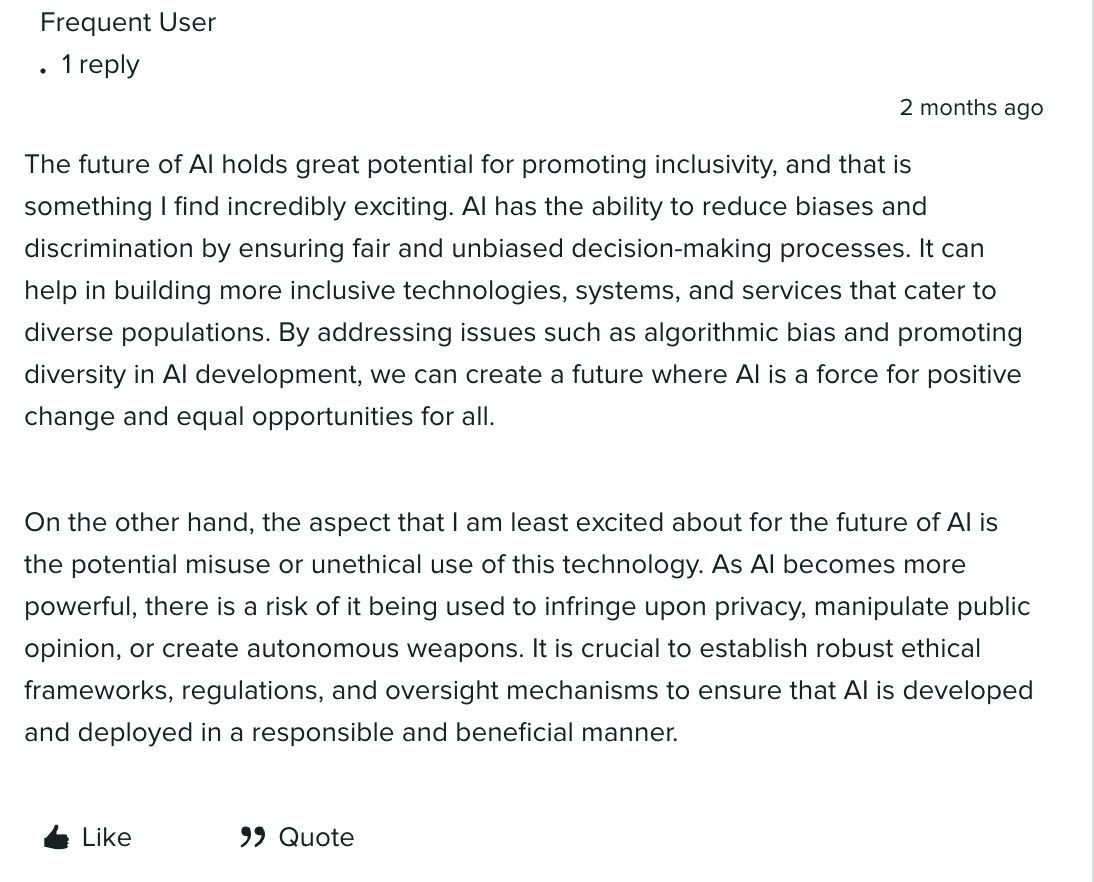

Certains pensent que l'IA peut aider à créer des technologies, des systèmes et des services plus inclusifs qui peuvent répondre aux besoins de diverses populations. La clé est d'établir des cadres éthiques, des réglementations et des mécanismes pour garantir une utilisation responsable.

Un membre de l'Arboretum, le forum communautaire de Sprout, a noté que l'IA a le potentiel de promouvoir l'inclusivité et de réduire les préjugés et la discrimination en garantissant des processus décisionnels justes et impartiaux. En abordant des problèmes tels que les biais algorithmiques dans le développement de l'IA, il pourrait être possible de façonner un avenir où l'IA serait une force de changement positive.

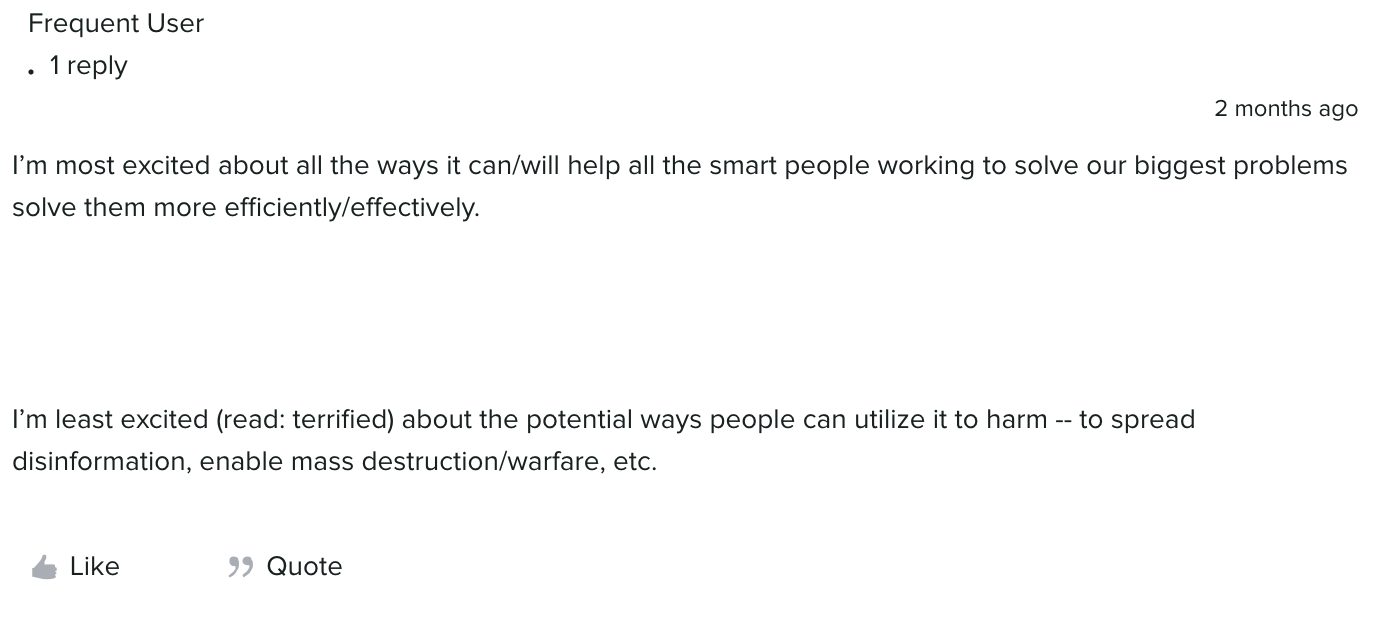

Outre le potentiel de changement positif, il existe également des possibilités d'utilisation abusive ou contraire à l'éthique de l'IA à mesure qu'elle devient plus puissante. Notre communauté a discuté de plusieurs risques, notamment la violation de la vie privée, la manipulation de l'opinion publique et les armes autonomes.

Des commentaires comme ceux-ci ne font qu'effleurer la surface des préoccupations éthiques dans tous les secteurs, mais les principaux problèmes pour les spécialistes du marketing incluent : la sécurité de l'emploi, la confidentialité, les préjugés et la discrimination, la désinformation et la désinformation, ainsi que les problèmes de propriété intellectuelle et de droits d'auteur, que nous aborderons en détail dans le section suivante.

Impact sur les emplois et suppression d'emplois

Les robots assurant la domination du monde sont le cadet de nos soucis, du moins pour le moment.

Et c’est parce que les chercheurs et les experts ne sont pas menacés par la singularité technologique, ni par l’idée selon laquelle l’IA dépassera l’intelligence humaine et reproduira des caractéristiques telles que les compétences sociales. Ils sont conscients des limites de l'IA et des ramifications potentielles du remplacement d'emploi.

L'objectif de la recherche et de l'investissement dans l'IA n'est pas de remplacer les humains, mais de nous aider à économiser du temps et des efforts pour faire des choses plus percutantes. Bob Wolfley, directeur des médias sociaux et des partenariats chez Flock Freight, a partagé une excellente analogie avec l'IA : « L'IA est comme le lave-vaisselle ou la machine à laver dans nos maisons. Pensez à tout le temps que vous économisez en ne lavant pas la vaisselle ou les vêtements à la main.

Dans notre série Unread, les membres de l'équipe marketing et créative de Sprout ont expliqué comment ils utilisent actuellement l'IA, depuis les achats personnalisés jusqu'à l'utilisation de fonctionnalités telles que ViralPost pour aider à planifier des publications sur les réseaux sociaux. Regardez la vidéo ci-dessous pour entendre leurs points de vue sur les avantages et les craintes de l'IA, y compris le remplacement d'emploi :

Problèmes de confidentialité

Les préoccupations concernant la confidentialité, la protection et la sécurité des données sont au cœur des préoccupations des marques. Les investissements en matière de sécurité sont une priorité croissante pour les entreprises qui cherchent à éviter toute opportunité de surveillance, de piratage et de cyberattaques. À mesure que la personnalisation devient plus populaire, les marques mettent en œuvre les meilleures pratiques de collecte, de stockage et d’analyse des données afin de protéger les clients et les organisations.

Biais algorithmique et discrimination

Puisqu'elle apprend à partir des données, une IA mal construite ou mal formée peut démontrer un biais par rapport à des sous-ensembles de données sous-représentés. Il y a eu plusieurs cas importants de biais concernant les illustrations générées par l’IA, les chatbots, les logiciels de reconnaissance faciale, les algorithmes et les outils d’IA pour les pratiques de recrutement.

Par exemple, plusieurs utilisateurs de TikTok et de Twitter [rebaptisés X à partir de juillet 2023] ont critiqué un fil de discussion présentant « #SouthSudan Barbie » ornée d'armes à feu, un stéréotype négatif associé à une région aux prises avec des problèmes sociopolitiques tels que le génocide et la crise des réfugiés. .

![Une réponse d'utilisateur à une photo générée par l'IA de "#SouthSudan Barbie" dans un fil Twitter [rebaptisé X à partir de juillet 2023]. Le message se lit comme suit : "Nous n'arrêtons pas de vous dire que les préjugés sont intégrés dans ces ordures générées par l'IA."](/uploads/article/221435/S1hZxuJ0KyrnC8ur.png)

Avec des préjugés entrant dans des enjeux encore plus faibles, l'IA utilise des cas comme celui-ci, la question est de savoir comment lutter contre les préjugés et la discrimination lorsque les ensembles de données de formation peuvent se prêter à des biais ?

Désinformation et désinformation

Comme les humains, l'IA n'est pas parfaite. Les réponses de l'IA aux invites peuvent être inexactes et on craint que des personnes ne diffusent des informations erronées avec une intention malveillante. Outre les menaces de désinformation, il existe un risque de crise de marque et d'atteinte à la réputation, en particulier sans la mise en place des garanties et des protocoles appropriés.

Problèmes de propriété intellectuelle et de droit d'auteur

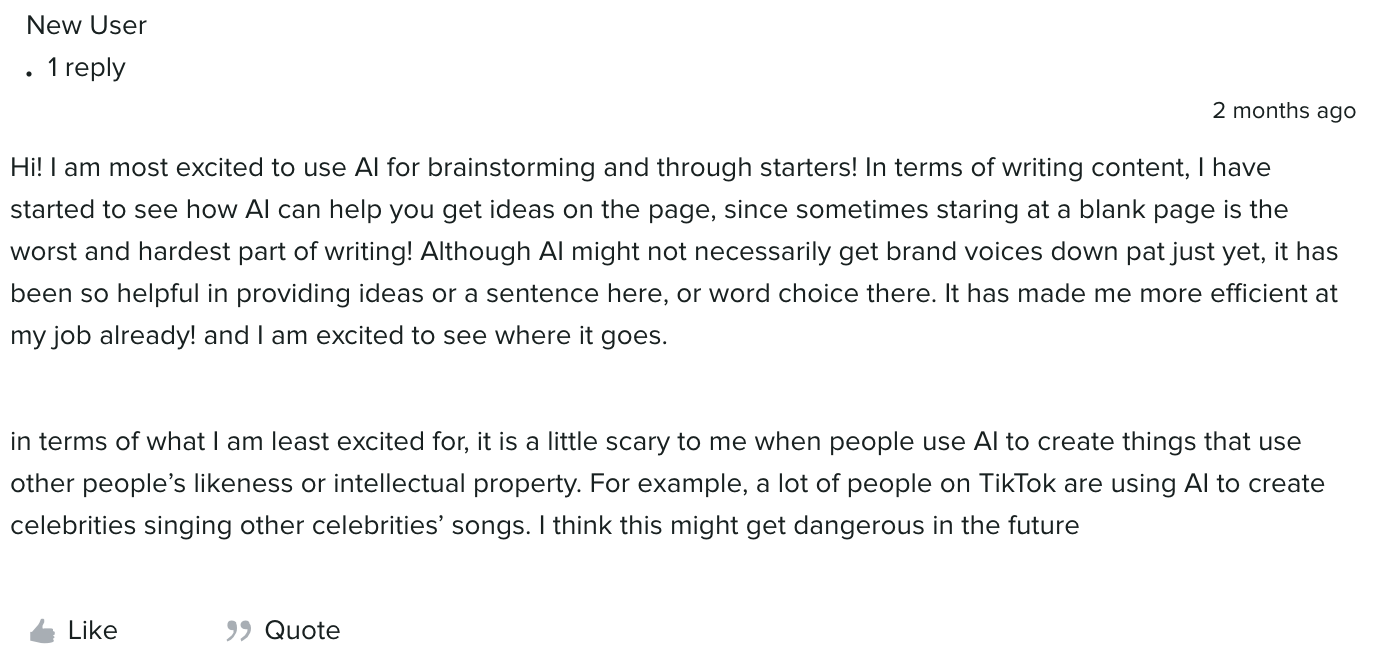

Vous avez probablement vu les personnages d'Harry Potter dans un film de Wes Anderson ou les citoyens de Bikini Bottom chanter des interprétations de chansons populaires. Ce sont des exemples du nombre de personnes qui utilisent l'IA pour utiliser l'image et la ressemblance des gens ou la propriété intellectuelle.

L'IA est un excellent partenaire pour les tâches créatives telles que le brainstorming et la création de plans, mais selon la manière dont les résultats sont utilisés, elle peut entraîner une violation du droit d'auteur, du plagiat et des violations de la propriété intellectuelle. Par exemple, un groupe d’artistes a intenté une action en justice contre Midjourney et Stability AI en janvier 2023, affirmant que les outils violaient les droits de millions d’artistes. L'IA générative ouvre une boîte de Pandore juridique et il reste encore beaucoup de chemin à parcourir, mais la création de règles et de cadres proactifs contribuera à atténuer les risques éthiques.

5 étapes pour maintenir l'éthique de l'IA au sein des équipes

Voici cinq étapes pour guider votre plan d'atténuation des risques éthiques liés à l'IA :

1. Définir des règles de base internes et des responsabilités pour l'utilisation de l'IA

Envisagez de créer une équipe d'éthique en IA composée d'éthiciens, d'experts juridiques, de technologues et de dirigeants pour vous aider à établir des règles de base pour votre organisation. Par exemple, utiliser uniquement l'IA générative pour les brouillons et le brainstorming, mais pas pour le contenu publié en externe, est une excellente règle de base.

Parallèlement à ces règles de base, définissez le rôle et les responsabilités de chaque membre de l'équipe impliqué dans l'IA, y compris l'équipe d'éthique. Définissez également vos objectifs et vos valeurs pour l'IA. Cela aidera à jeter les bases de votre politique d’éthique en matière d’IA et de vos meilleures pratiques.

2. Définir et auditer le rôle de l'IA

L'IA ne peut pas remplacer les créateurs de contenu, les stratèges des médias sociaux ou tout autre rôle dans le marketing. Identifiez les tâches d'IA qui nécessitent une surveillance ou une intervention humaine et identifiez les objectifs de votre politique d'éthique en matière d'IA pour aider à élaborer des processus de développement, de gestion et de communication sur l'IA.

Une fois que vous avez identifié les objectifs de votre politique d’éthique, identifiez les lacunes et les opportunités pour l’IA dans votre organisation. Considérez les questions suivantes :

- Comment l’organisation utilise-t-elle actuellement l’IA et comment souhaitons-nous l’utiliser à l’avenir ?

- Quels logiciels et analyses peuvent nous aider à atténuer les risques commerciaux ?

- Quelles lacunes la technologie et l'analyse créent-elles ? Comment les remplir ?

- Quels tests ou expériences devons-nous mener ?

- Quelles solutions existantes pouvons-nous utiliser avec les meilleures pratiques actuelles pour nos équipes produit ?

- Comment allez-vous utiliser les données et les informations ?

- Comment allons-nous établir notre positionnement de marque et nos messages en matière de technologies et d’éthique de l’IA ?

3. Développer un processus d'évaluation des fournisseurs hermétique

Collaborez avec vos équipes informatiques et juridiques pour examiner correctement tous les outils dotés de capacités d'IA et établir un processus de risque éthique. Leur expertise vous aidera à évaluer de nouvelles considérations telles que l'ensemble de données sur lequel un outil est formé et les contrôles que les fournisseurs ont mis en place pour atténuer les biais de l'IA. Un processus de diligence raisonnable pour chaque outil avant son lancement en externe ou en interne vous aidera à atténuer les risques futurs.

4. Maintenir la transparence avec les divulgations

Collaborez avec vos équipes juridiques et/ou de confidentialité pour développer des messages externes et/ou des clauses de non-responsabilité pour indiquer où et quand votre marque s'appuie sur l'IA. Ces messages peuvent être utilisés pour le contenu, le service client, etc. Par exemple, TikTok a mis à jour les directives de sa communauté pour obliger les créateurs à étiqueter le contenu généré par l'IA. Communiquer vos normes et cadres éthiques pour défendre l’éthique de l’IA vous aidera à gagner la confiance de vos pairs, prospects et clients.

5. Poursuivre la formation des dirigeants et des équipes

L’IA n’est pas une chose dans laquelle les dirigeants d’entreprise peuvent se précipiter. Comme toute nouvelle vague d’innovation émergente, il y aura une courbe d’apprentissage, en plus des nouvelles étapes technologiques. Aidez à uniformiser les règles du jeu en organisant des formations et des ateliers internes pour éduquer tous les membres de l'équipe, les dirigeants et les parties prenantes sur l'éthique de l'IA et sur la manière de la construire de manière responsable.

Faites ce qu'il faut avec l'éthique de l'IA

Prendre en compte l’éthique n’est pas seulement la bonne chose à faire : c’est un élément essentiel pour tirer parti de la technologie de l’IA en entreprise.

Découvrez plus de points de vue de dirigeants et de spécialistes du marketing sur l'impact de l'IA sur l'avenir des réseaux sociaux dans notre webinaire, ainsi que d'autres conclusions du rapport sur l'état des médias sociaux 2023 et des conseils pour créer un contenu social percutant.