7 risques sérieux auxquels vous faites face en utilisant l'IA pour le marketing

Publié: 2023-07-06Il y a quelques années, la plupart d'entre nous, spécialistes du marketing, n'avions pas la moindre idée de la façon d'utiliser l'IA pour le marketing. Soudain, nous écrivons des articles sur LinkedIn sur les meilleures invites à chuchoter à l'oreille de ChatGPT.

Il y a de quoi se réjouir de l'infusion soudaine de l'intelligence artificielle dans notre travail. McKenzie estime que l'IA débloquera 2,6 billions de dollars de valeur pour les spécialistes du marketing.

Mais notre adoption rapide de l'IA peut devancer d'importantes questions éthiques, juridiques et opérationnelles, ce qui exposera les spécialistes du marketing à des risques auxquels nous n'avions jamais eu à penser auparavant (par exemple, pouvons-nous être poursuivis pour avoir dit à l'IA d'« écrire comme Stephen King ? ”).

Il y a une tonne de poussière d'IA dans l'atmosphère marketing qui ne s'installera pas avant des années. Peu importe à quel point vous louchez, vous ne découvrirez pas tous les pièges potentiels de l'utilisation de grands modèles de langage et de l'apprentissage automatique pour créer du contenu et gérer des publicités.

Notre objectif dans cet article est donc de voir sept des risques les plus importants liés à l'utilisation de l'IA pour le marketing à partir d'un niveau très élevé. Nous avons rassemblé les conseils d'experts pour aider à atténuer ces risques. Et nous avons ajouté de nombreuses ressources pour que vous puissiez approfondir les questions qui vous préoccupent le plus.

Risque n° 1 : biais d'apprentissage automatique

Parfois, les algorithmes d'apprentissage automatique donnent des résultats qui sont injustement en faveur ou contre quelqu'un ou quelque chose. C'est ce qu'on appelle le biais d'apprentissage automatique, ou biais d'IA, et c'est un problème omniprésent, même avec les réseaux de neurones profonds les plus avancés.

C'est un problème de données

Ce n'est pas que les réseaux d'IA sont intrinsèquement sectaires. C'est un problème avec les données qui y sont introduites.

Les algorithmes d'apprentissage automatique fonctionnent en identifiant des modèles pour calculer la probabilité d'un résultat, par exemple si un groupe particulier d'acheteurs aimera ou non votre produit.

Mais que se passe-t-il si les données sur lesquelles l'IA s'entraîne sont biaisées en faveur d'une race, d'un sexe ou d'un groupe d'âge particulier ? L'IA arrivera à la conclusion que ces personnes correspondent mieux et faussera la création ou le placement publicitaire en conséquence.

édition sur le blanchiment des préjugés pic.twitter.com/YQLRcq59lQ

– Janelle Shane (@JanelleCShane) 17 juin 2021

Voici un exemple. Des chercheurs ont récemment testé les préjugés sexistes dans les systèmes de ciblage publicitaire de Facebook. Les enquêteurs ont placé une annonce pour recruter des chauffeurs-livreurs pour Pizza Hut, et une annonce similaire avec les mêmes qualifications pour Instacart.

Le groupe existant de chauffeurs de Pizza Hut est biaisé par les hommes, donc Facebook a montré ces publicités de manière disproportionnée aux hommes. Instacart a plus de femmes conductrices, donc les annonces pour leur travail ont été placées devant plus de femmes. Mais il n'y a aucune raison intrinsèque pour que les femmes ne veuillent pas connaître les emplois de Pizza Hut, c'est donc un gros faux pas dans le ciblage publicitaire.

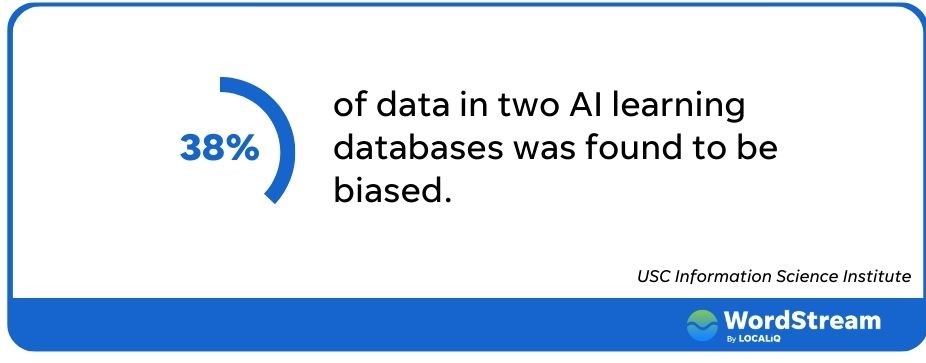

Le biais de l'IA est courant

Le problème s'étend bien au-delà de Facebook. Des chercheurs de l'USC ont examiné deux grandes bases de données d'IA et ont découvert que plus de 38 % des données qu'elles contenaient étaient biaisées. La documentation de ChatGPT avertit même que leur algorithme peut associer "des stéréotypes négatifs aux femmes noires".

Le biais d'apprentissage automatique présente plusieurs implications pour les spécialistes du marketing ; dont le moindre est la mauvaise performance des annonces. Si vous espérez atteindre le plus de clients potentiels possible, une plate-forme de ciblage publicitaire qui exclut de larges pans de la population n'est pas idéale.

Bien sûr, il y a des ramifications plus importantes si nos publicités ciblent ou excluent injustement certains groupes. Si votre annonce immobilière est discriminatoire à l'égard des minorités protégées, vous pourriez tomber du mauvais côté du Fair Housing Act et de la Federal Trade Commission. Sans parler de manquer complètement le bateau du marketing inclusif.

Comment éviter les biais de l'IA

Alors, que faisons-nous lorsque nos outils d'IA se déchaînent ? Vous pouvez suivre quelques étapes pour vous assurer que vos annonces traitent tout le monde de manière équitable.

Tout d'abord, assurez-vous que quelqu'un examine votre contenu, écrit Alaura Weaver, responsable principale du contenu et de la communauté chez Writer. "Bien que la technologie de l'IA ait considérablement progressé, elle n'a pas les capacités de réflexion critique et de prise de décision dont disposent les humains", explique-t-elle. "En demandant à des éditeurs humains d'examiner et de vérifier les faits du contenu écrit par l'IA, ils peuvent s'assurer qu'il est exempt de préjugés et respecte les normes éthiques."

La surveillance humaine réduira également le risque de résultats négatifs dans les campagnes publicitaires payantes.

"Actuellement, et peut-être indéfiniment, il n'est pas conseillé de laisser l'IA prendre complètement le contrôle des campagnes ou de toute forme de marketing", déclare Brett McHale, le fondateur d'Empiric Marketing. "L'IA fonctionne de manière optimale lorsqu'elle reçoit des informations précises de l'intelligence organique qui a déjà accumulé de grandes quantités de données et d'expériences."

Risque n° 2 : Erreurs factuelles

Google a récemment coûté 100 milliards de dollars à sa société mère lorsque son nouveau chatbot IA, Bard, a donné une réponse incorrecte dans un tweet promotionnel.

Bard est un service d'IA conversationnel expérimental, propulsé par LaMDA. Construit à l'aide de nos grands modèles de langage et s'appuyant sur des informations provenant du Web, c'est une rampe de lancement pour la curiosité et peut aider à simplifier des sujets complexes → https://t.co/fSp531xKy3 pic.twitter.com/JecHXVmt8l

– Google (@Google) 6 février 2023

La gaffe de Google met en évidence l'une des plus grandes limites de l'IA et l'un des plus grands risques pour les spécialistes du marketing qui l'utilisent : l'IA ne dit pas toujours la vérité.

L'IA hallucine

Ethan Mollic, professeur à la Wharton School of Business, a récemment décrit les systèmes alimentés par l'IA comme ChatGPT comme un "stagiaire omniscient, désireux de plaire qui ment parfois".

Bien sûr, l'IA n'est pas sensible, malgré ce que certains peuvent prétendre. Il n'a pas l'intention de nous tromper. Il peut cependant souffrir d'"hallucinations" qui l'amènent à inventer des choses.

L'IA est une machine à prédiction. Il cherche à remplir le mot ou la phrase suivante qui répondra à votre requête. Mais ce n'est pas conscient de soi; L'IA n'a pas de logique de vérification pour savoir si ce qu'elle enchaîne a du sens.

Contrairement au biais, cela ne semble pas être un problème de données. Même lorsque le réseau dispose de toutes les bonnes informations, il peut toujours nous dire la mauvaise chose.

Considérez cet exemple où un utilisateur a demandé à ChatGPT "combien de fois l'Argentine a-t-elle remporté la coupe du monde de la FIFA ?" Il a dit une fois et fait référence à la victoire de l'équipe en 1978. Le tweeter a ensuite demandé quelle équipe avait gagné en 1986.

A demandé #ChatGPT à propos de qui a remporté la coupe du monde de la FIFA en 2022. Il n'a pas pu répondre. C'est prévu. Cependant, il semble fournir des informations erronées (sur les 2 autres victoires) même si les informations sont présentes dans le système. Des #explications ? pic.twitter.com/fvxe05N12p

– indranil sinharoy (@indranil_leo) 29 décembre 2022

Le chatbot a admis qu'il s'agissait de l'Argentine sans aucune explication pour son ancienne gaffe.

Ce qui est troublant, c'est que les réponses erronées de l'IA sont souvent écrites avec tant de confiance qu'elles se fondent dans le texte qui les entoure, ce qui les rend complètement plausibles. Ils peuvent également être complets, comme détaillé dans un procès intenté contre Open.ai, où ChatGPT aurait concocté toute une histoire de détournement de fonds qui a ensuite été partagée par un journaliste.

Comment éviter les hallucinations de l'IA

Bien que l'IA puisse vous égarer même avec des réponses d'un seul mot, elle est plus susceptible de dérailler lors de la rédaction de textes plus longs.

« À partir d'une seule invite, l'IA peut générer un blog ou un livre électronique. Oui, c'est incroyable, mais il y a un hic », prévient Weaver. "Plus il en génère, plus vous aurez à faire d'édition et de vérification des faits."

Pour réduire les risques que votre outil d'IA commence à créer des récits hallucinatoires, Weaver dit qu'il est préférable de créer un plan et que le bot s'y attaque une section à la fois. Et puis, bien sûr, demandez à une personne d'examiner les faits et les statistiques qu'elle ajoute.

Risque #3 : mauvaise application des outils d'IA

Chaque matin, nous nous réveillons avec une nouvelle génération d'outils d'IA qui ont apparemment poussé du jour au lendemain comme des champignons après une tempête de pluie.

Mais toutes les plateformes ne sont pas conçues pour toutes les fonctions marketing, et certains défis marketing ne peuvent pas (encore) être résolus par l'IA.

Les outils d'IA ont des limites

ChatGPT est un excellent exemple. La belle de la balle AI est amusante à jouer (comme écrire comment retirer un sandwich au beurre de cacahuète d'un magnétoscope dans le style de la Bible King James). Et il peut produire des réponses courtes étonnamment bien écrites qui font sauter le blocage de l'écrivain. Mais ne lui demandez pas de vous aider à faire des recherches de mots-clés.

ChatGPT échoue en raison de son ensemble de données relativement ancien qui n'inclut que des informations antérieures à 2022. Demandez-lui de proposer des mots-clés pour le "marketing IA" et ses réponses ne correspondront pas à ce que vous trouverez dans d'autres outils comme Thinword ou Contextminds.

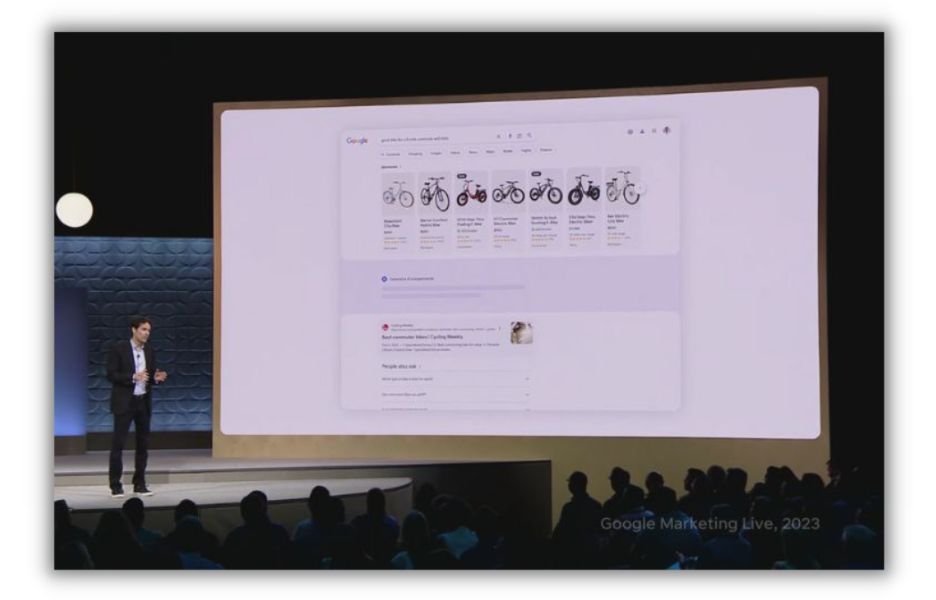

De même, Google et Facebook disposent de nouveaux outils basés sur l'IA pour aider les spécialistes du marketing à créer des publicités, à optimiser les dépenses publicitaires et à personnaliser l'expérience publicitaire. Un chatbot ne peut pas résoudre ces problèmes.

Google a annoncé une série de mises à niveau de l'IA pour ses produits de gestion de recherche et d'annonces lors de l'événement Google Marketing Live 2023.

Vous pouvez abuser de l'IA

Si vous confiez à un outil d'IA une tâche singulière, il peut surindexer sur un seul objectif. Nick Abbene, un expert en automatisation du marketing, le voit souvent avec des entreprises axées sur l'amélioration de leur référencement.

"Le plus gros problème que je vois est d'utiliser les outils de référencement à l'aveugle, de sur-optimiser les moteurs de recherche et de ne pas tenir compte de l'intention de recherche des clients", déclare Abbene. "Les outils de référencement sont parfaits pour signaler aux moteurs de recherche un contenu de qualité. Mais en fin de compte, Google veut correspondre à la demande du chercheur. »

Comment éviter une mauvaise application des outils d'IA

Une clé n'est pas la meilleure option pour enfoncer les clous. De même, un assistant d'écriture IA peut ne pas être bon pour créer des pages Web. Avant de vous lancer dans une option d'IA, Abbene recommande d'obtenir les commentaires du constructeur de l'outil et des autres utilisateurs.

"Afin d'éviter une mauvaise sélection des outils d'IA, comprenez si d'autres spécialistes du marketing utilisent l'outil pour votre cas d'utilisation", dit-il. "N'hésitez pas à demander une démonstration du produit ou à l'essayer avec d'autres outils offrant les mêmes fonctionnalités."

Des sites Web comme Capterra vous permettent de comparer rapidement plusieurs plates-formes d'IA.

Et une fois que vous avez trouvé la bonne pile d'outils d'IA, utilisez-la pour faciliter le processus, pas pour la prendre en charge. "N'ayez pas peur d'utiliser des outils d'IA pour augmenter votre flux de travail, mais utilisez-les uniquement pour cela", déclare Abbene. "Commencez chaque élément de contenu par les premiers principes, avec une recherche de mots clés de qualité et une compréhension de l'intention de recherche."

Risque #4 : contenu homogène

L'IA peut écrire un essai entier en 10 secondes environ. Mais aussi impressionnante que soit devenue l'IA générative, elle n'a pas la nuance nécessaire pour être vraiment créative, laissant sa sortie se sentir souvent, eh bien, robotique.

"Bien que l'IA soit excellente pour produire du contenu informatif, elle manque souvent du flair créatif et de l'engagement que les humains apportent à la table", déclare Weaver.

L'IA est faite pour imiter

Demandez à un robot d'écriture d'IA génératif de rédiger votre rapport de livre, et il fera facilement tourner 500 mots qui expliqueront avec compétence le thème principal de Catcher in the Rye (en supposant qu'il n'hallucine pas Holden Caulfield en tant que voleur de banque).

Il peut le faire car il a absorbé des milliers de textes sur le chef-d'œuvre de JD Salinger.

Demandez maintenant à votre ami IA d'écrire un article de blog qui explique un concept de base de votre entreprise d'une manière qui résume votre marque, votre public et votre proposition de valeur. Vous pourriez être déçu. "Le contenu généré par l'IA ne tient pas toujours compte des nuances de la personnalité et des valeurs d'une marque et peut produire un contenu qui rate la cible", déclare Weaver.

En d'autres termes, l'IA est excellente pour digérer, combiner et reconfigurer ce qui a déjà été créé. Ce n'est pas génial pour créer quelque chose qui se démarque du contenu existant.

Les outils d'IA générative ne sont pas non plus efficaces pour rendre le contenu attrayant. Ils se feront un plaisir de produire d'énormes blocs de mots sans une image, un graphique ou une puce pour donner du repos aux yeux fatigués. Ils n'ajouteront pas d'histoires de clients ou d'exemples hypothétiques pour rendre un point plus pertinent. Et ils auraient du mal à faire le lien entre une nouvelle de votre secteur et un avantage offert par votre produit.

Comment éviter un contenu homogène

Certains outils d'IA, comme Writer, ont des fonctionnalités intégrées pour aider les rédacteurs à maintenir une personnalité de marque cohérente. Mais vous aurez toujours besoin d'un éditeur pour "examiner et modifier le contenu de la voix et du ton de la marque afin de vous assurer qu'il résonne avec le public et renforce le message et les objectifs de l'organisation", conseille Weaver.

Les éditeurs et les écrivains peuvent également voir un article comme les autres humains le feront. S'il y a un bloc de mots impénétrable, ce seront eux qui le briseront et ajouteront un petit zhuzh visuel.

Utilisez le contenu de l'IA comme point de départ, comme un moyen de stimuler votre créativité et vos recherches. Mais ajoutez toujours votre touche personnelle.

Risque #5 : Perte de SEO

La position de Google sur le contenu de l'IA est un peu floue. Au début, il semblait que le moteur de recherche pénaliserait les publications écrites avec l'IA.

[Image : tweet de John Mueller sur AI]

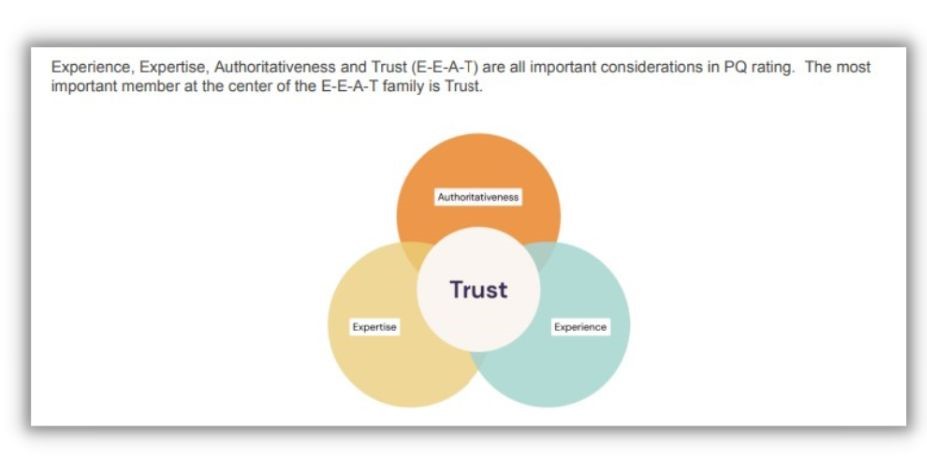

Plus récemment, le blog des développeurs de Google a déclaré que l'IA est OK dans leur livre. Mais il y a un clin d'œil significatif avec cette confirmation. Seul "un contenu qui démontre les qualités de ce que nous appelons EEAT : expertise, expérience, autorité et fiabilité" impressionnera les évaluateurs humains qui évaluent en permanence les systèmes de classement de Google.

La confiance est l'embrayage du SEO

Parmi les EEAT de Google, le seul facteur qui les gouverne tous est la confiance.

[source]

Nous avons déjà discuté du fait que le contenu de l'IA est sujet aux erreurs, ce qui le rend intrinsèquement indigne de confiance sans supervision humaine. Il ne répond pas non plus aux exigences de support car, par nature, il n'est pas écrit par une personne ayant une expertise, une autorité ou une expérience sur le sujet.

Prenez un article de blog sur la cuisson du pain aux bananes. Un bot AI vous donnera une recette en environ deux secondes. Mais il ne peut pas devenir poétique pendant les froides journées d'hiver passées à cuisiner pour sa famille. Ou parlez des années qu'il a passées à expérimenter différents types de farine en tant que boulanger commercial. Ces perspectives sont ce que recherchent les évaluateurs de recherche de Google.

Cela semble aussi être ce que les gens recherchent aussi. C'est pourquoi tant d'entre eux se tournent vers de vraies personnes sur les vidéos TikTok pour apprendre des choses qu'ils avaient l'habitude de trouver sur Google.

Comment éviter de perdre le référencement

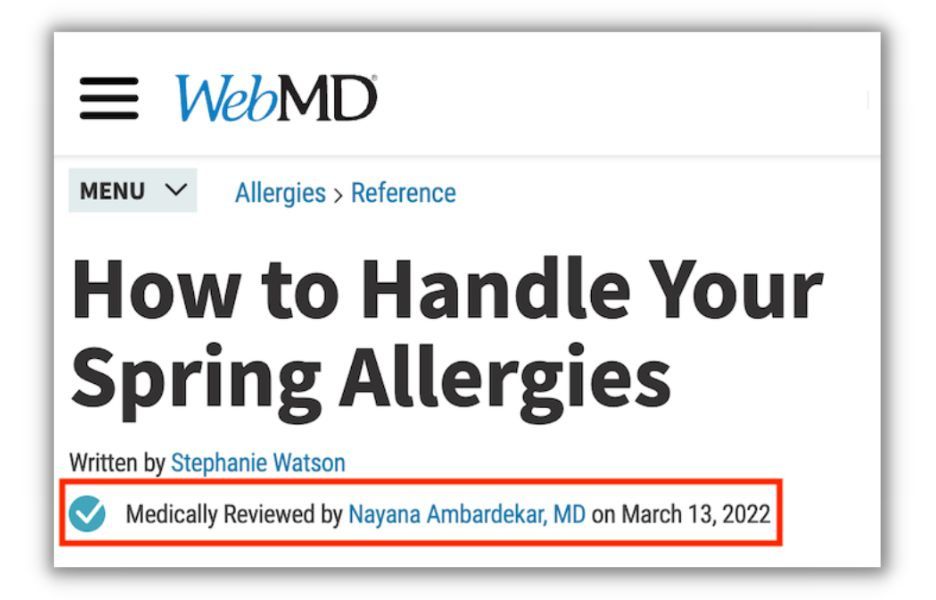

La grande chose à propos de l'IA est que cela ne dérange pas de partager des signatures. Ainsi, lorsque vous utilisez un chatbot pour accélérer la production de contenu, assurez-vous de référencer un auteur humain avec des informations d'identification.

Cela est particulièrement vrai pour les sujets sensibles comme la santé et les finances personnelles, que Google appelle les sujets Your Money, Your Life. "Si vous êtes dans une verticale YMYL, privilégiez l'autorité, la confiance et la précision avant tout dans votre contenu", conseille Elisa Gabbert, directrice du contenu et du référencement pour WordStream et LocaliQ.

Lorsque vous écrivez sur les soins de santé, par exemple, faites réviser vos messages par un professionnel de la santé et faites-y référence dans le message. C'est un signal fort pour Google que votre contenu est digne de confiance, même s'il a été lancé dans un chatbot.

Risque n° 6 : Défis juridiques

L'IA générative apprend du travail créé par les humains, puis crée quelque chose de nouveau (plutôt). La question du droit d'auteur n'est pas claire à la fois pour l'entrée et la sortie du modèle de contenu de l'IA.

Le travail existant est probablement un jeu équitable pour l'IA

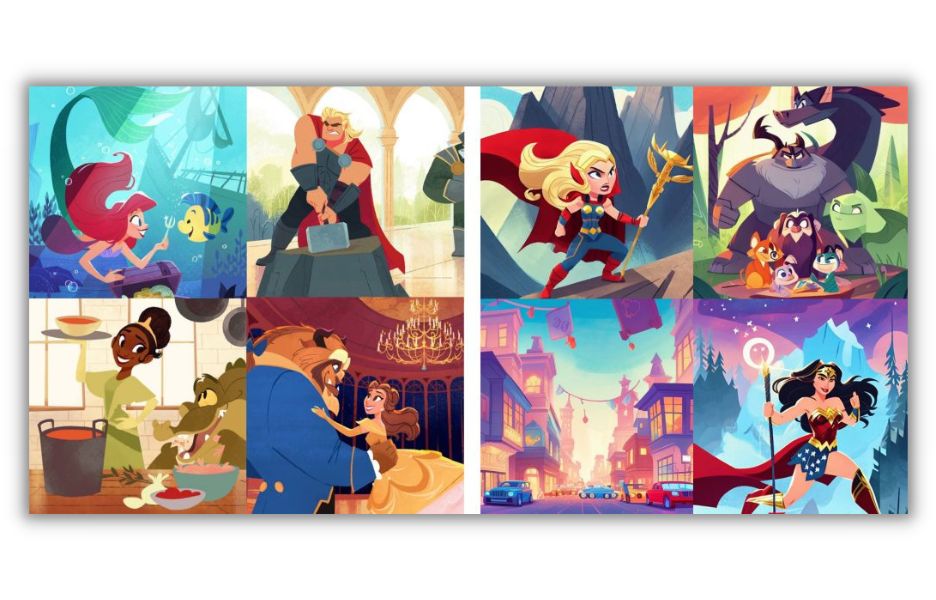

Pour illustrer (jeu de mots) la question du droit d'auteur pour les œuvres qui alimentent de grands modèles d'apprentissage, nous nous tournons vers un cas rapporté par le technologue Andy Baio. Comme l'explique Baio, une artiste basée à Los Angeles nommée Hollie Mengert a appris que 32 de ses illustrations avaient été absorbées dans un modèle d'IA, puis proposées via une licence ouverte à quiconque souhaitait recréer son style.

Légende : une collection d'illustrations de l'artiste Hollie Mengert (à gauche) comparées à des illustrations générées par l'IA basées sur son style, organisées par Andy Baio .

L'histoire se complique lorsque vous apprenez qu'elle a créé plusieurs de ses images pour des clients comme Disney, qui en détiennent les droits.

Les illustrateurs (ou écrivains ou codeurs) qui se trouvent au même endroit que Mengert peuvent-ils poursuivre avec succès pour violation du droit d'auteur ?

Il n'y a pas encore de réponse claire à la question. "Je vois des gens des deux côtés extrêmement confiants dans leurs positions, mais la réalité est que personne ne le sait", a déclaré Baio à The Verge. "Et quiconque dit qu'il sait avec confiance comment cela se déroulera devant le tribunal a tort."

Si l'IA que vous utilisez pour créer une image ou un article a été formée sur des milliers d'œuvres de nombreux créateurs, vous ne risquez pas de perdre un procès. Mais si vous alimentez la machine avec dix livres de Stephen King et dites au bot d'en écrire un nouveau dans ce style, vous pourriez avoir des ennuis.

Avis de non-responsabilité : nous ne sommes pas des avocats, veuillez donc obtenir des conseils juridiques si vous n'êtes pas sûr.

Votre contenu IA peut ne pas être protégé non plus

Qu'en est-il du contenu que vous créez à l'aide d'un chatbot, est-il couvert par les lois sur le droit d'auteur ? Pour la plupart, ce n'est pas le cas, sauf si vous avez fait un travail considérable pour le modifier. Ce qui signifie que vous n'aurez que peu de recours si quelqu'un réutilise (lire : vole) vos messages pour son propre blog.

Pour le contenu protégé, c'est peut-être le programmeur de l'IA, et non vous, qui détient les droits. De nombreux pays considèrent que le fabricant de l'outil qui a produit une œuvre est son créateur, et non la personne qui a tapé l'invite.

Comment éviter les contestations judiciaires

Commencez par utiliser un outil de création de contenu IA réputé. Trouvez-en un avec de nombreuses critiques positives produites par une entreprise qui exprime clairement sa position sur les lois sur le droit d'auteur.

Utilisez également votre bon jugement pour décider si vous copiez intentionnellement le travail d'un créateur ou si vous utilisez simplement l'IA pour augmenter le vôtre.

Et si vous voulez avoir une chance de vous battre devant les tribunaux pour protéger ce que vous produisez, apportez de nombreux changements substantiels. Ou utilisez l'IA pour vous aider à créer un plan, mais écrivez vous-même la plupart des mots.

Risque #7 : Violations de la sécurité et de la confidentialité

Les outils d'intelligence artificielle présentent aux spécialistes du marketing un large éventail de menaces potentielles pour la sécurité de leur système et la confidentialité des données. Certaines sont des attaques directes d'acteurs malveillants. D'autres sont simplement des utilisateurs qui donnent involontairement des informations sensibles à un système conçu pour les partager.

Risques de sécurité liés aux outils d'IA

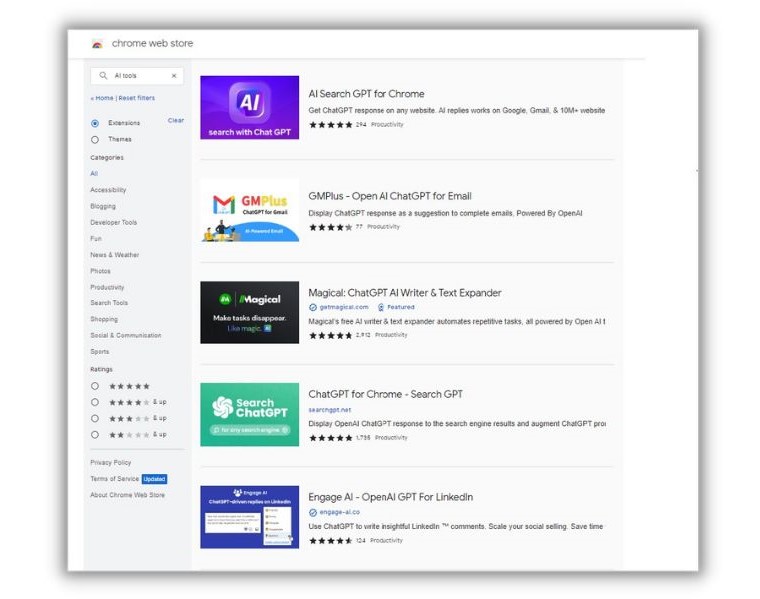

"Il existe de nombreux produits qui ressemblent, se sentent et se comportent comme des outils légitimes, mais sont en fait des logiciels malveillants", nous a déclaré Elaine Atwell, rédactrice en chef du marketing de contenu chez le fournisseur de sécurité des terminaux Kolide. "Ils sont extrêmement difficiles à différencier des outils légitimes et vous pouvez les trouver dans la boutique Chrome dès maintenant."

Tapez n'importe quelle version des "outils AI" dans la boutique Google Chrome et vous ne manquerez pas d'options.

Atwell a écrit sur ces risques sur le blog Kolide. Dans son article, elle a fait référence à un incident où une extension Chrome appelée "Accès rapide au chat GPT" était en fait une ruse. Une fois téléchargé, le logiciel a piraté les comptes Facebook des utilisateurs et a volé tous les cookies de la victime, même ceux de sécurité. Plus de 2 000 personnes ont téléchargé l'extension chaque jour, a rapporté Atwell.

Confidentialité non protégée

Atwell dit que même un outil d'IA légitime peut présenter un risque pour la sécurité. « … à l'heure actuelle, la plupart des entreprises n'ont même pas mis en place de politiques pour évaluer les types et les niveaux de risque posés par les différentes extensions. Et en l'absence de directives claires, des gens du monde entier installent ces petits assistants et leur fournissent des données sensibles. »

Disons que vous rédigez un rapport financier interne à partager avec les investisseurs. N'oubliez pas que les réseaux d'IA apprennent de ce qu'ils reçoivent pour produire des résultats pour d'autres utilisateurs. Toutes les données que vous placez dans le chatbot AI pourraient être un jeu équitable pour les personnes extérieures à votre entreprise. Et peut apparaître si un concurrent pose des questions sur votre résultat net.

Comment éviter les risques de confidentialité et de sécurité

La première ligne de défense consiste à s'assurer qu'un logiciel est ce qu'il prétend être. Au-delà de cela, soyez prudent quant à la façon dont vous utilisez les outils que vous choisissez. "Si vous allez utiliser des outils d'IA (et ils ont des utilisations !), Ne leur fournissez pas de données qui pourraient être considérées comme sensibles", déclare Atwell.

De plus, pendant que vous examinez les outils d'IA pour leur utilité et leur parti pris, renseignez-vous sur leurs politiques de confidentialité et de sécurité.

Atténuer les risques liés à l'utilisation de l'IA pour le marketing

L'IA progresse à une vitesse incroyable. En moins d'un an, Chat GTP a déjà vu ses capacités augmenter considérablement. Il est impossible de savoir ce que nous pourrons faire avec l'IA même dans les six à douze prochains mois. Nous ne pouvons pas non plus anticiper les problèmes potentiels.

Voici plusieurs façons d'améliorer vos résultats marketing en matière d'IA tout en évitant certains des risques les plus courants :

- Demandez à des éditeurs humains d'examiner le contenu pour en vérifier la qualité, la lisibilité et la voix de la marque

- Examinez chaque outil que vous utilisez pour la sécurité et la capacité

- Examinez régulièrement le ciblage publicitaire dirigé par l'IA pour détecter les biais

- Évaluer la copie et les images pour une violation potentielle du droit d'auteur

Nous tenons à remercier Elain Attwell, Brett McHale, Nick Abenne et Alaura Weaver pour leur contribution à cet article.

Pour récapituler, passons en revue notre liste de risques liés à l'utilisation de l'IA pour le marketing :

- Biais d'apprentissage automatique

- Erreurs factuelles

- Mauvaise application des outils d'IA

- Contenu homogène

- Perte de référencement

- Défis juridiques

- Atteintes à la sécurité et à la confidentialité