AI dalam SEO: Cara mengatasi tantangan hukum dan memastikan kepatuhan

Diterbitkan: 2023-09-26Kecerdasan buatan (AI) siap menjadi alat penting bagi merek yang ingin meningkatkan kehadiran online mereka.

Namun, mengintegrasikan AI ke dalam strategi pemasaran pasti akan menimbulkan pertimbangan hukum dan peraturan baru yang harus dinavigasi secara hati-hati oleh lembaga.

Dalam artikel ini, Anda akan menemukan:

- Bagaimana bisnis, SEO, dan agensi media dapat meminimalkan risiko hukum dalam menerapkan strategi yang disempurnakan dengan AI.

- Alat yang berguna untuk mengurangi bias AI dan proses praktis untuk meninjau kualitas konten yang dihasilkan AI.

- Bagaimana agensi dapat mengatasi tantangan utama penerapan AI untuk memastikan efisiensi dan kepatuhan bagi klien mereka.

Pertimbangan kepatuhan hukum

Kekayaan intelektual dan hak cipta

Masalah hukum yang penting saat menggunakan AI dalam SEO dan media adalah kepatuhan terhadap undang-undang kekayaan intelektual dan hak cipta.

Sistem AI sering kali mengumpulkan dan menganalisis data dalam jumlah besar, termasuk materi berhak cipta.

Sudah ada banyak tuntutan hukum terhadap OpenAI atas pelanggaran hak cipta dan privasi.

Perusahaan tersebut menghadapi tuntutan hukum atas tuduhan penggunaan tidak sah atas buku berhak cipta untuk pelatihan ChatGPT dan secara ilegal mengumpulkan informasi pribadi dari pengguna internet menggunakan model pembelajaran mesin mereka.

Masalah privasi pada pemrosesan dan penyimpanan data pengguna OpenAI juga menyebabkan Italia memblokir sepenuhnya penggunaan ChatGPT pada akhir Maret.

Larangan tersebut kini telah dicabut setelah perusahaan melakukan perubahan untuk meningkatkan transparansi pada pemrosesan data pengguna chatbot dan menambahkan opsi untuk tidak ikut serta dalam percakapan ChatGPT yang digunakan untuk algoritma pelatihan.

Namun, dengan peluncuran GPTBot, crawler OpenAI, kemungkinan besar akan timbul pertimbangan hukum lebih lanjut.

Untuk menghindari potensi masalah hukum dan klaim pelanggaran, lembaga harus memastikan setiap model AI dilatih pada sumber data resmi dan menghormati batasan hak cipta:

- Pastikan data diperoleh secara sah dan lembaga tersebut mempunyai hak yang sesuai untuk menggunakannya.

- Saring data yang tidak memiliki izin hukum yang diperlukan atau kualitasnya buruk.

- Melakukan audit rutin terhadap data dan model AI untuk memastikan keduanya mematuhi hak dan undang-undang penggunaan data.

- Mengadakan konsultasi hukum mengenai hak data dan privasi untuk memastikan tidak ada yang bertentangan dengan kebijakan hukum.

Tim hukum agensi dan klien mungkin perlu dilibatkan dalam diskusi di atas sebelum model AI dapat diintegrasikan ke dalam alur kerja dan proyek.

Privasi dan perlindungan data

Teknologi AI sangat bergantung pada data, yang mungkin mencakup informasi pribadi yang sensitif.

Pengumpulan, penyimpanan, dan pemrosesan data pengguna harus sejalan dengan undang-undang privasi yang relevan, seperti Peraturan Perlindungan Data Umum (GDPR) di Uni Eropa.

Selain itu, UU AI UE yang baru-baru ini diperkenalkan juga menekankan pada penanganan masalah privasi data yang terkait dengan sistem AI.

Ini bukannya tanpa alasan. Perusahaan besar, seperti Samsung, telah melarang AI sepenuhnya karena terungkapnya data rahasia yang diunggah ke ChatGPT.

Oleh karena itu, jika agensi menggunakan data pelanggan bersamaan dengan teknologi AI, mereka harus:

- Mengutamakan transparansi dalam pengumpulan data.

- Dapatkan persetujuan pengguna.

- Menerapkan langkah-langkah keamanan yang kuat untuk melindungi informasi sensitif.

Dalam kasus ini, lembaga dapat memprioritaskan transparansi dalam pengumpulan data dengan mengkomunikasikan secara jelas kepada pengguna data apa yang akan dikumpulkan, bagaimana data tersebut akan digunakan, dan siapa yang dapat mengaksesnya.

Untuk mendapatkan persetujuan pengguna, pastikan bahwa persetujuan tersebut diinformasikan dan diberikan secara bebas melalui formulir persetujuan yang jelas dan mudah dipahami yang menjelaskan tujuan dan manfaat pengumpulan data.

Selain itu, langkah-langkah keamanan yang kuat meliputi:

- Enkripsi data.

- Kontrol akses.

- Anonimisasi data (jika memungkinkan).

- Audit dan pembaruan rutin.

Misalnya, kebijakan OpenAI selaras dengan kebutuhan akan privasi dan perlindungan data serta fokus pada peningkatan transparansi, izin pengguna, dan keamanan data dalam aplikasi AI.

Keadilan dan bias

Algoritme AI yang digunakan dalam SEO dan media berpotensi melanggengkan bias atau mendiskriminasi individu atau kelompok tertentu secara tidak sengaja.

Lembaga harus proaktif dalam mengidentifikasi dan memitigasi bias algoritmik. Hal ini sangat penting dalam UU AI UE yang baru, yang melarang sistem AI mempengaruhi perilaku manusia secara tidak adil atau menampilkan perilaku diskriminatif.

Untuk memitigasi risiko ini, lembaga-lembaga harus memastikan bahwa beragam data dan perspektif disertakan dalam desain model AI dan terus memantau hasilnya untuk mengetahui potensi bias dan diskriminasi.

Salah satu cara untuk mencapai hal ini adalah dengan menggunakan alat yang membantu mengurangi bias, seperti AI Fairness 360, IBM Watson Studio, dan Alat What-If Google.

Konten palsu atau menyesatkan

Alat AI, termasuk ChatGPT, dapat menghasilkan konten sintetis yang mungkin tidak akurat, menyesatkan, atau palsu.

Misalnya, kecerdasan buatan sering kali membuat ulasan online palsu untuk mempromosikan tempat atau produk tertentu. Hal ini dapat menimbulkan konsekuensi negatif bagi bisnis yang mengandalkan konten yang dihasilkan AI.

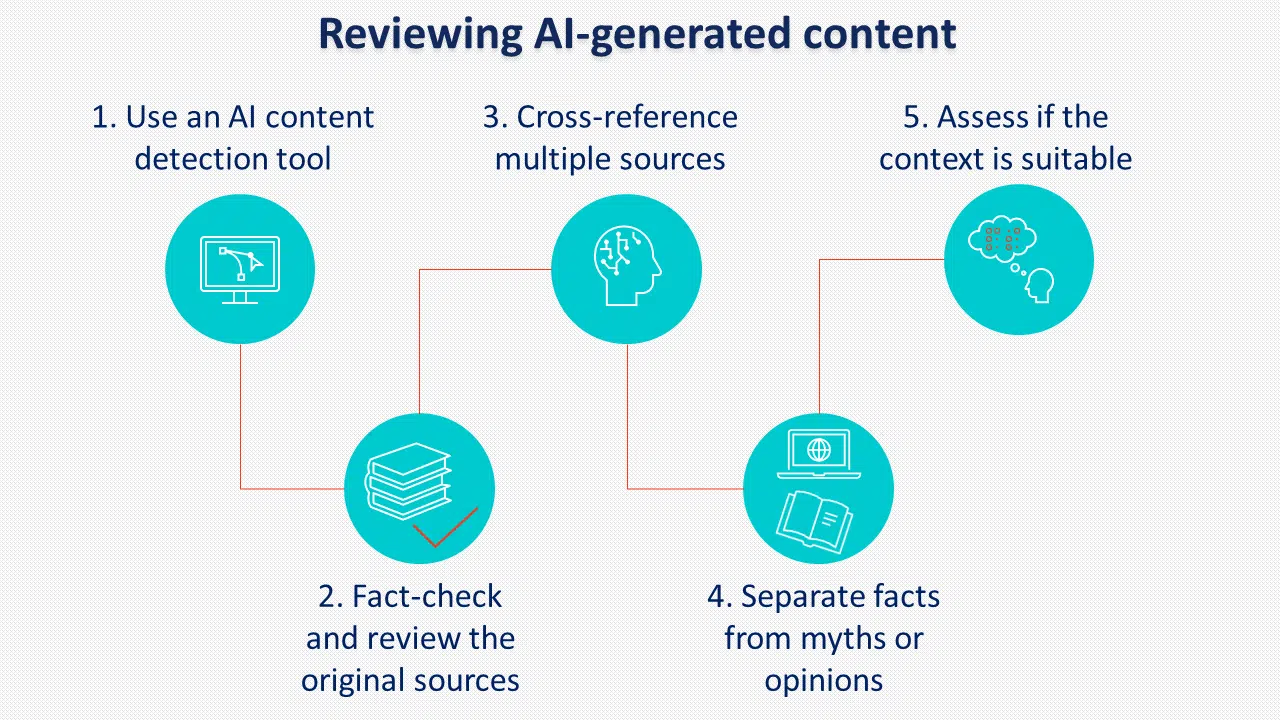

Menerapkan kebijakan dan prosedur yang jelas untuk meninjau konten yang dihasilkan AI sebelum dipublikasikan sangatlah penting untuk mencegah risiko ini.

Praktik lain yang perlu dipertimbangkan adalah memberi label pada konten yang dihasilkan AI. Meskipun Google tampaknya tidak menerapkannya, banyak pembuat kebijakan mendukung pelabelan AI.

Tanggung jawab dan akuntabilitas

Ketika sistem AI menjadi lebih kompleks, pertanyaan mengenai tanggung jawab pun muncul.

Instansi yang memanfaatkan AI harus siap bertanggung jawab atas segala konsekuensi yang tidak diinginkan akibat penggunaannya, termasuk:

- Bias dan diskriminasi saat menggunakan AI untuk menyortir kandidat yang akan direkrut.

- Potensi penyalahgunaan kekuatan AI untuk tujuan jahat seperti serangan siber.

- Hilangnya privasi jika informasi dikumpulkan tanpa persetujuan.

Undang-Undang AI UE memperkenalkan ketentuan baru mengenai sistem AI berisiko tinggi yang dapat berdampak signifikan terhadap hak-hak pengguna, menyoroti mengapa lembaga dan klien harus mematuhi persyaratan dan kebijakan yang relevan saat menggunakan teknologi AI.

Beberapa syarat dan kebijakan OpenAI yang paling penting berkaitan dengan konten yang disediakan oleh pengguna, keakuratan respons, dan pemrosesan data pribadi.

Kebijakan konten menyatakan bahwa OpenAI memberikan hak atas konten yang dihasilkan kepada pengguna. Perjanjian ini juga menetapkan bahwa konten yang dihasilkan dapat digunakan untuk tujuan apa pun, termasuk tujuan komersial, asalkan mematuhi batasan hukum.

Namun, laporan tersebut juga menyatakan bahwa keluarannya mungkin tidak sepenuhnya unik atau akurat, artinya konten yang dihasilkan AI harus selalu ditinjau secara menyeluruh sebelum digunakan.

Pada catatan data pribadi, OpenAI mengumpulkan semua informasi yang dimasukkan pengguna, termasuk unggahan file.

Saat menggunakan layanan untuk memproses data pribadi, pengguna harus memberikan pemberitahuan privasi yang memadai secara hukum dan mengisi formulir untuk meminta pemrosesan data.

Lembaga-lembaga harus secara proaktif mengatasi masalah akuntabilitas, memantau keluaran AI, dan menerapkan langkah-langkah pengendalian kualitas yang kuat untuk memitigasi potensi tanggung jawab hukum.

Dapatkan buletin harian yang diandalkan oleh pemasar pencarian.

Lihat persyaratan.

Tantangan penerapan AI bagi lembaga

Sejak OpenAI merilis ChatGPT tahun lalu, ada banyak pembicaraan tentang bagaimana AI generatif akan mengubah SEO sebagai sebuah profesi dan dampaknya secara keseluruhan terhadap industri media.

Meskipun perubahan disertai dengan peningkatan beban kerja sehari-hari, ada beberapa tantangan yang harus dipertimbangkan lembaga ketika menerapkan AI ke dalam strategi klien.

Pendidikan dan kesadaran

Banyak klien mungkin kurang memahami AI dan implikasinya secara komprehensif.

Oleh karena itu, lembaga menghadapi tantangan untuk mendidik klien tentang potensi manfaat dan risiko yang terkait dengan penerapan AI.

Lanskap peraturan yang terus berkembang memerlukan komunikasi yang jelas dengan klien mengenai langkah-langkah yang diambil untuk memastikan kepatuhan hukum.

Untuk mencapai hal ini, lembaga harus:

- Memiliki pemahaman yang jelas tentang tujuan klien mereka.

- Mampu menjelaskan manfaatnya.

- Tunjukkan keahlian dalam mengimplementasikan AI.

- Mengatasi tantangan dan risiko.

Salah satu cara untuk melakukannya adalah dengan membagikan lembar fakta kepada klien yang berisi semua informasi yang diperlukan dan, jika mungkin, memberikan studi kasus atau contoh lain tentang bagaimana mereka dapat memperoleh manfaat dari penggunaan kecerdasan buatan.

Alokasi sumber daya

Mengintegrasikan AI ke dalam SEO dan strategi media memerlukan sumber daya yang besar, termasuk investasi finansial, personel terampil, dan peningkatan infrastruktur.

Agensi harus hati-hati menilai kebutuhan dan kemampuan klien mereka untuk menentukan kelayakan penerapan solusi AI sesuai keterbatasan anggaran mereka, karena mereka mungkin memerlukan spesialis AI, analis data, SEO, dan spesialis konten yang dapat berkolaborasi secara efektif.

Kebutuhan infrastruktur dapat mencakup alat AI, pemrosesan data, dan platform analitik untuk mengekstraksi wawasan. Apakah akan memberikan layanan atau memfasilitasi sumber daya eksternal bergantung pada kemampuan dan anggaran masing-masing lembaga.

Mengalihdayakan lembaga lain mungkin menghasilkan implementasi yang lebih cepat, sementara berinvestasi pada kemampuan AI internal mungkin lebih baik untuk kontrol jangka panjang dan penyesuaian layanan yang ditawarkan.

Keahlian teknis

Implementasi AI menuntut pengetahuan dan keahlian teknis khusus.

Lembaga-lembaga mungkin perlu merekrut atau meningkatkan keterampilan tim mereka untuk mengembangkan, menerapkan, dan mengelola sistem AI secara efektif sejalan dengan persyaratan peraturan baru.

Untuk memanfaatkan AI secara maksimal, anggota tim harus memiliki:

- Pengetahuan pemrograman yang bagus.

- Pemrosesan data dan keterampilan analitis untuk mengelola data dalam jumlah besar.

- Pengetahuan praktis tentang pembelajaran mesin.

- Keterampilan pemecahan masalah yang sangat baik.

Pertimbangan etis

Agensi harus mempertimbangkan implikasi etis penggunaan AI terhadap klien mereka.

Kerangka kerja dan pedoman etis harus ditetapkan untuk memastikan praktik AI yang bertanggung jawab di seluruh proses, mengatasi permasalahan yang diangkat dalam peraturan yang diperbarui.

Ini termasuk:

- Transparansi, keterbukaan, dan akuntabilitas ketika AI digunakan.

- Menghormati privasi pengguna dan kekayaan intelektual.

- Mendapatkan persetujuan klien untuk menggunakan kecerdasan buatan.

- Kendali manusia atas AI dengan komitmen berkelanjutan untuk meningkatkan dan beradaptasi dengan teknologi AI yang sedang berkembang.

Akuntabilitas penting: Memenuhi tantangan hukum dalam penerapan AI

Meskipun AI menghadirkan peluang menarik untuk meningkatkan SEO dan praktik media, agensi harus mengatasi tantangan hukum dan mematuhi peraturan terbaru yang terkait dengan penerapannya.

Dunia usaha dan lembaga dapat meminimalkan risiko hukum dengan:

- Memastikan data diperoleh secara sah dan lembaga mempunyai hak yang sesuai untuk menggunakannya.

- Memfilter data yang tidak memiliki izin hukum yang diperlukan atau berkualitas buruk.

- Melakukan audit terhadap data dan model AI untuk memastikan kepatuhannya terhadap hak dan undang-undang penggunaan data.

- Mengadakan konsultasi hukum mengenai hak data dan privasi untuk memastikan tidak ada yang bertentangan dengan kebijakan hukum.

- Mengutamakan transparansi dalam pengumpulan data dan memperoleh persetujuan pengguna dengan formulir persetujuan yang jelas dan mudah dipahami.

- Menggunakan alat yang membantu mengurangi bias, seperti AI Fairness 360, IBM Watson Studio, dan Alat What-If Google.

- Menerapkan kebijakan dan prosedur yang jelas untuk meninjau kualitas konten yang dihasilkan AI sebelum dipublikasikan.

Pendapat yang diungkapkan dalam artikel ini adalah milik penulis tamu dan belum tentu Search Engine Land. Penulis staf tercantum di sini.