Etica dell’intelligenza artificiale: come gli esperti di marketing dovrebbero abbracciare l’innovazione in modo responsabile

Pubblicato: 2023-08-21L'intelligenza artificiale (AI) non è solo un fenomeno fantascientifico trasformato in realtà: è un pilastro tecnologico, sviluppato nel corso di decenni proprio sotto i nostri nasi. L’intelligenza artificiale ha realizzato sogni di maggiore efficienza, con molti marchi che hanno già sfruttato il marketing dell’intelligenza artificiale negli ultimi anni.

Sebbene abbia suscitato eccitazione ed entusiasmo, ci sono preoccupazioni riguardo all’etica dell’IA. Come molte innovazioni, la visione del metaverso dell’industria tecnologica aveva inquietanti somiglianze con media come Black Mirror e Snow Crash . E con opere come La parabola del seminatore, della macchina e io, Robot all'interno dello zeitgeist culturale, è comprensibile il motivo per cui fan di fantascienza, ricercatori e tecnologi mettono in guardia dai pericoli derivanti dall'ignorare l'etica dell'IA.

In questo articolo definiremo cos'è l'etica dell'intelligenza artificiale, perché i marchi dovrebbero essere preoccupati e le principali questioni etiche che i professionisti del marketing devono affrontare, tra cui la sicurezza del lavoro, la disinformazione e i pregiudizi algoritmici. Condivideremo inoltre cinque passaggi per aiutarti a mantenere pratiche etiche di intelligenza artificiale all'interno dei team e nell'intera organizzazione.

Cos’è l’etica dell’IA?

L’etica dell’intelligenza artificiale è un sistema di principi morali e pratiche professionali utilizzati per informare in modo responsabile sullo sviluppo e sui risultati della tecnologia dell’intelligenza artificiale. Si riferisce anche allo studio di come ottimizzare l’impatto e ridurre i rischi e/o le conseguenze dell’IA.

Le principali aziende tecnologiche, enti governativi come le Nazioni Unite e le comunità di ricerca e scienza dei dati hanno lavorato per modellare e pubblicare linee guida per affrontare le questioni etiche. Ad esempio, l’Organizzazione delle Nazioni Unite per l’educazione, la scienza e la cultura (UNESCO) ha pubblicato nel novembre 2021 il primo standard globale sull’etica dell’IA: la Raccomandazione sull’etica dell’intelligenza artificiale.

Esistono alcune normative sull’intelligenza artificiale in vigore a livello nazionale e locale, ma con la crescita dell’intelligenza artificiale e di altre tecnologie emergenti, le aziende dovrebbero aspettarsi una maggiore regolamentazione da parte del governo. Man mano che l’intelligenza artificiale si integra sempre più nelle nostre vite, l’etica dell’intelligenza artificiale diventa una parte fondamentale dell’alfabetizzazione digitale.

Perché l’etica dell’IA è importante

Le aziende stanno già investendo nell’IA, ma la difficoltà è garantirne un utilizzo responsabile.

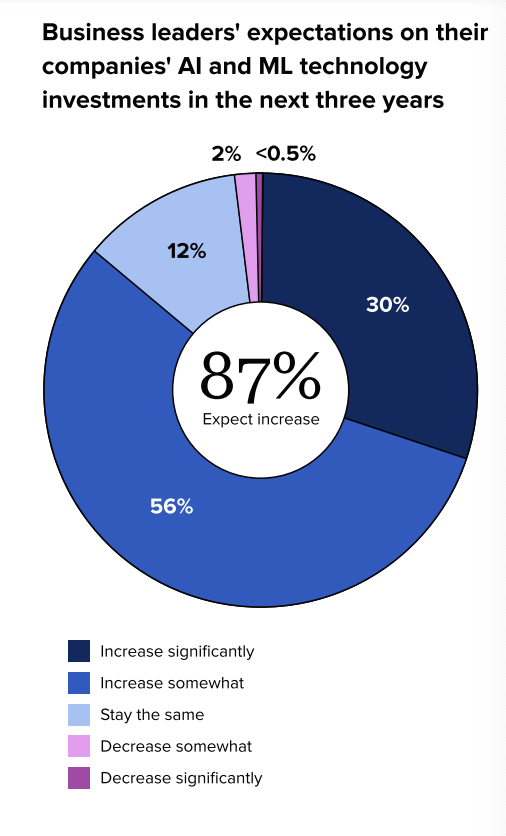

Secondo il rapporto The 2023 State of Social Media: AI and Data Take Center Stage, i leader aziendali si aspettano maggiori investimenti nell’intelligenza artificiale nei prossimi anni. Il nostro report ha inoltre rilevato che il 98% dei leader aziendali concorda sul fatto che le aziende debbano comprendere meglio il potenziale dell’intelligenza artificiale e della tecnologia di machine learning (ML) per avere successo a lungo termine.

Sebbene l’intelligenza artificiale possa migliorare le prestazioni, aumentare l’efficienza e generare risultati aziendali positivi, anche i brand stanno sperimentando conseguenze impreviste derivanti dalla sua applicazione. Ciò può derivare, tra le altre ragioni, dalla mancanza di ricerca o da set di dati distorti. L’uso improprio dell’intelligenza artificiale o il mancato rispetto delle preoccupazioni etiche possono comportare un danno alla reputazione del marchio, guasti ai prodotti, contenziosi e problemi normativi.

Il primo passo per sostenere gli standard etici tra i team all'interno della tua organizzazione inizia con la comprensione dei problemi che gli operatori di marketing devono affrontare, in modo da poter definire un piano per mitigare questi rischi aziendali e salvaguardare il tuo marchio.

Quali questioni etiche legate all'intelligenza artificiale sono prioritarie per gli esperti di marketing

Esistono diverse preoccupazioni etiche relative all’intelligenza artificiale nel settore tecnologico, tra cui, ma non limitate a, quanto segue:

- Generazione di contenuti falsi

- Spiegabilità

- Impatto sociale

- Uso improprio della tecnologia

- Pregiudizio

- Responsabilità dei dati e privacy

- Equità

- Robustezza

- Trasparenza

- Sostenibilità ambientale

- Diversità e inclusione

- Agentività morale e allineamento dei valori

- Fiducia e responsabilità

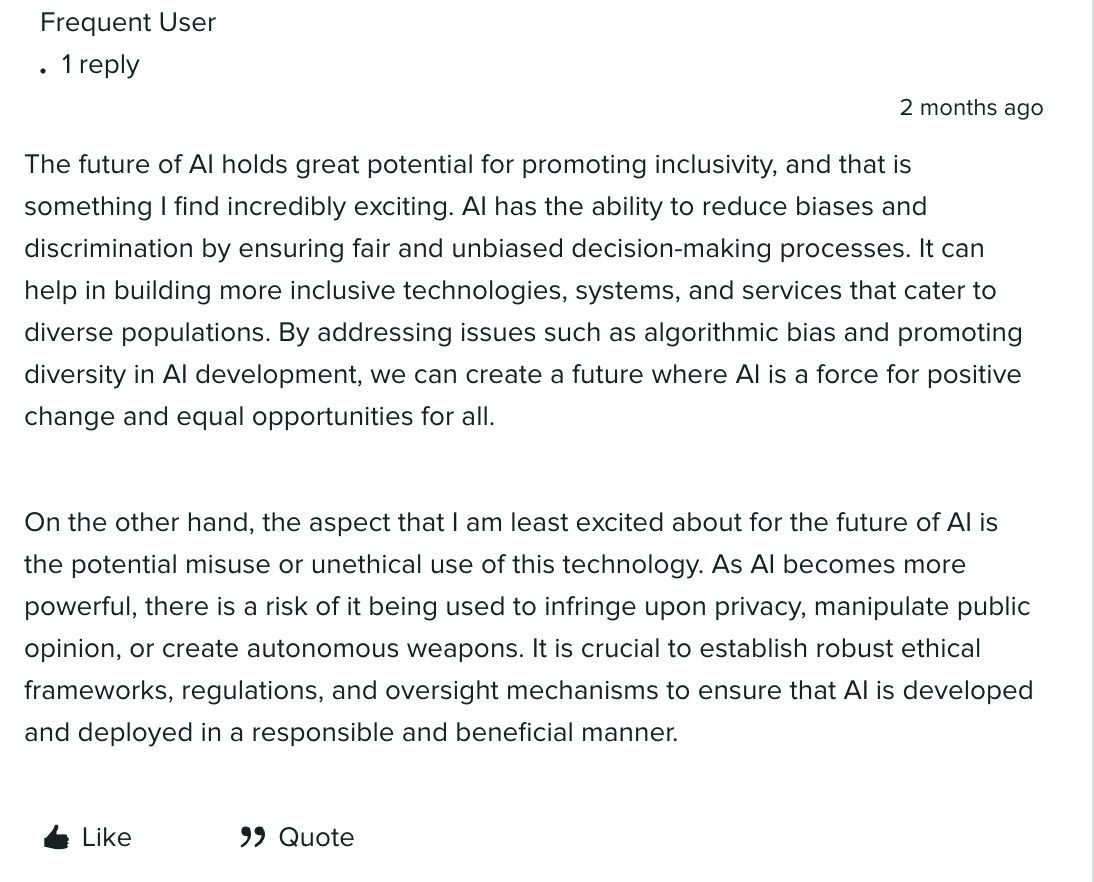

Alcuni credono che l’intelligenza artificiale possa aiutare a costruire tecnologie, sistemi e servizi più inclusivi in grado di soddisfare popolazioni diverse. La chiave è stabilire quadri etici, regolamenti e meccanismi per garantire un uso responsabile.

Un membro dell'Arboretum, il forum della comunità di Sprout, ha osservato che l'intelligenza artificiale ha il potenziale per promuovere l'inclusività e ridurre pregiudizi/discriminazioni garantendo processi decisionali equi e imparziali. Affrontando questioni come i pregiudizi algoritmici nello sviluppo dell’intelligenza artificiale, potrebbe essere possibile plasmare un futuro in cui l’intelligenza artificiale sia una forza positiva di cambiamento.

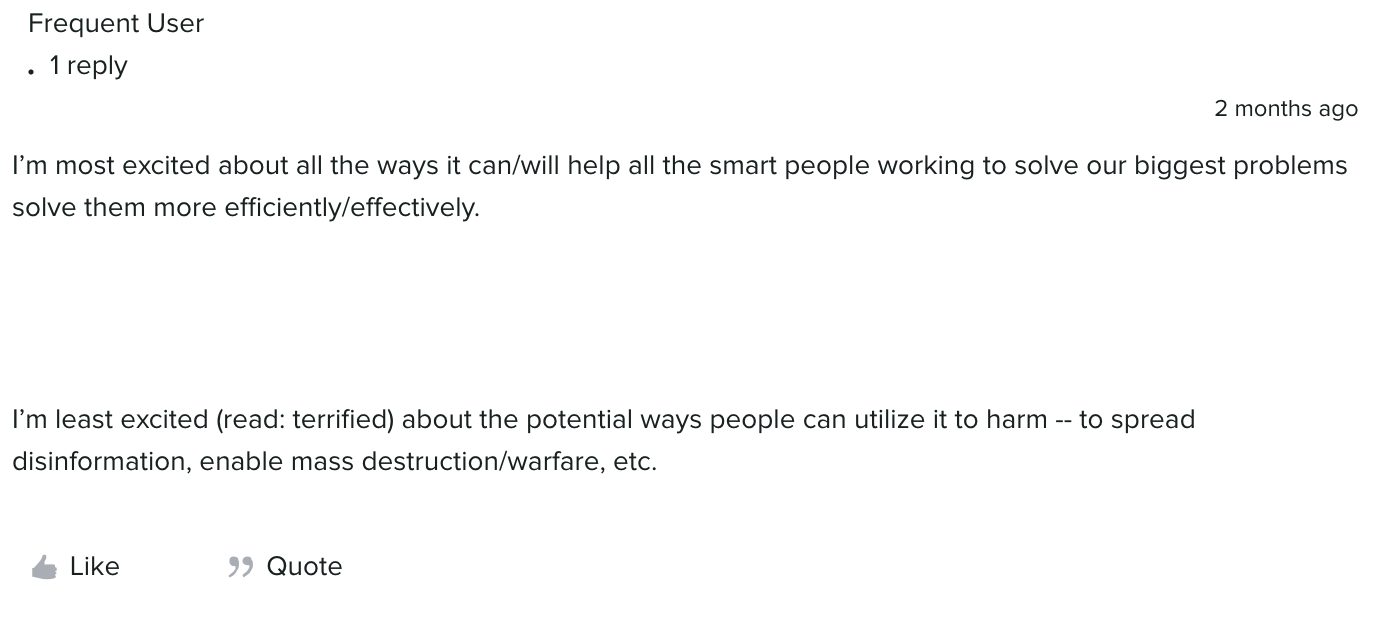

Insieme al potenziale di cambiamento positivo, ci sono anche opportunità di uso improprio o non etico dell’IA man mano che diventa più potente. La nostra comunità ha discusso di diversi rischi, tra cui la violazione della privacy, la manipolazione dell’opinione pubblica e le armi autonome.

Commenti come questi scalfiscono solo la superficie delle preoccupazioni etiche in tutti i settori, ma le questioni principali per i professionisti del marketing includono: sicurezza del lavoro, privacy, pregiudizi e discriminazioni, disinformazione e disinformazione, nonché questioni di proprietà intellettuale/copyright, che approfondiremo in dettaglio nell'articolo. sezione successiva.

Impatto sull’occupazione e spostamento dei posti di lavoro

I robot che assicurano il dominio del mondo sono l’ultima delle nostre preoccupazioni, almeno per ora.

E questo perché ricercatori ed esperti non sono minacciati dalla singolarità tecnologica, o dall’idea che l’intelligenza artificiale supererà l’intelligenza umana e replicherà caratteristiche come le abilità sociali. Sono consapevoli dei limiti dell’intelligenza artificiale e delle potenziali conseguenze della sostituzione del lavoro.

L’obiettivo della ricerca e degli investimenti nell’intelligenza artificiale non è sostituire gli esseri umani, ma aiutarci a risparmiare tempo e fatica per fare cose di maggiore impatto. Bob Wolfley, direttore dei social media e delle partnership di Flock Freight, ha condiviso una grande analogia con l'intelligenza artificiale: “L'intelligenza artificiale è come la lavastoviglie o la lavatrice nelle nostre case. Pensa a tutto il tempo che risparmi non lavando i piatti o i vestiti a mano”.

Nella nostra serie Unread, i membri del team creativo e marketing di Sprout hanno discusso di come utilizzano attualmente l'intelligenza artificiale, dallo shopping personalizzato all'utilizzo di funzionalità come ViralPost per pianificare i post sui social. Guarda il video qui sotto per ascoltare le loro opinioni sui vantaggi e sui timori dell'intelligenza artificiale, inclusa la sostituzione del lavoro:

Preoccupazioni relative alla privacy

Le preoccupazioni relative alla privacy, alla protezione e alla sicurezza dei dati sono le principali preoccupazioni dei marchi. Gli investimenti in sicurezza rappresentano una priorità crescente per le aziende che cercano di evitare qualsiasi opportunità di sorveglianza, pirateria informatica e attacchi informatici. Man mano che la personalizzazione diventa più popolare, i marchi stanno implementando le migliori pratiche per raccogliere, archiviare e analizzare i dati per proteggere clienti e organizzazioni.

Bias algoritmici e discriminazione

Poiché impara dai dati, un’intelligenza artificiale mal costruita o addestrata può dimostrare pregiudizi nei confronti di sottoinsiemi di dati sottorappresentati. Si sono verificati numerosi casi di pregiudizio con opere d’arte generate dall’intelligenza artificiale, chatbot, software di riconoscimento facciale, algoritmi e strumenti di intelligenza artificiale per le pratiche di assunzione.

Ad esempio, diversi utenti di TikTok e Twitter [rinominato X a partire da luglio 2023] hanno richiamato un thread in cui si vedeva "#SouthSudan Barbie" adornata con pistole, uno stereotipo negativo associato a una regione alle prese con questioni socio-politiche come il genocidio e la crisi dei rifugiati. .

![La risposta di un utente a una foto generata dall'intelligenza artificiale di "#SouthSudan Barbie" in un thread su Twitter[rinominato X a partire da luglio 2023]. Il post recita: "Continuiamo a dirvi che i pregiudizi sono incorporati in questa spazzatura generata dall'intelligenza artificiale".](/uploads/article/221435/S1hZxuJ0KyrnC8ur.png)

Con i pregiudizi che entrano in gioco ancora più in basso L’intelligenza artificiale utilizza casi come questo, la domanda diventa: come possiamo lavorare contro pregiudizi e discriminazioni quando i set di dati di addestramento possono prestarsi a pregiudizi?

Disinformazione e disinformazione

Come gli esseri umani, l’intelligenza artificiale non è perfetta. Le risposte dell’intelligenza artificiale ai suggerimenti possono essere imprecise e si teme che le persone diffondano disinformazione con intenti dannosi. Insieme alle minacce di disinformazione, esiste il rischio di crisi del marchio e danni alla reputazione, soprattutto senza le adeguate garanzie e protocolli in atto.

Proprietà intellettuale e questioni relative al diritto d'autore

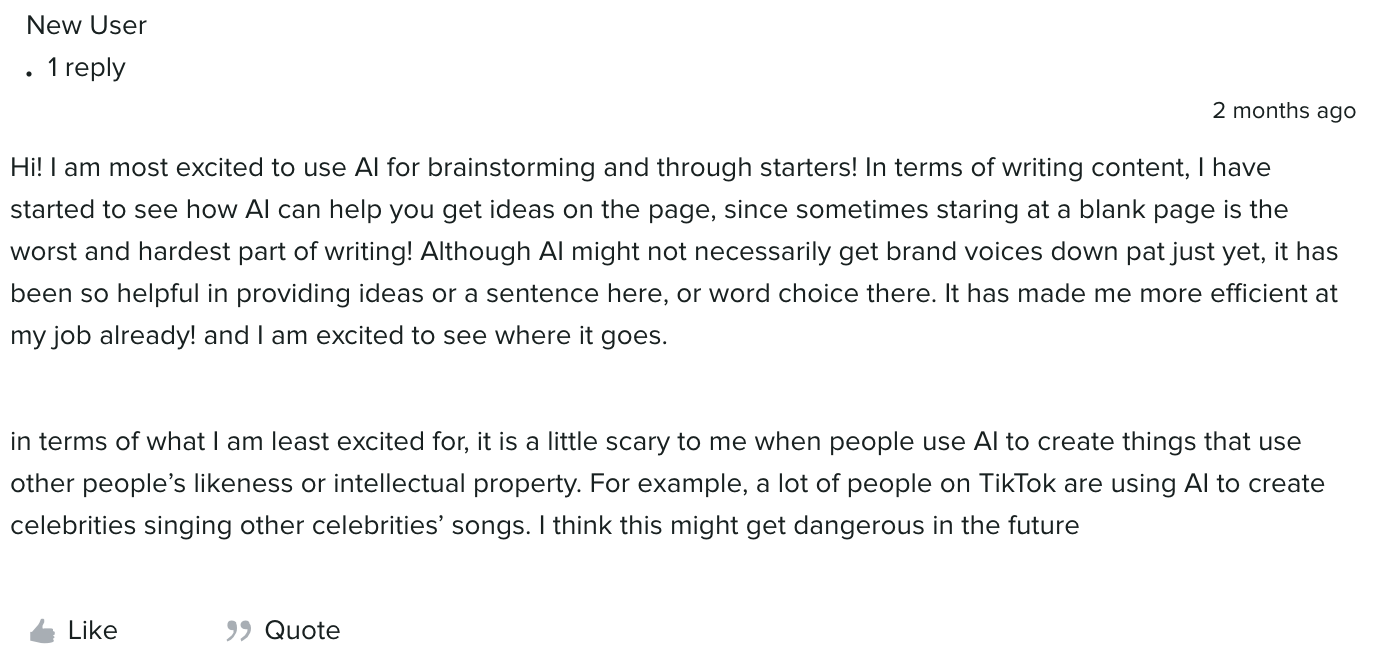

Probabilmente hai visto il cast di Harry Potter nei panni dei personaggi di un film di Wes Anderson o dei cittadini di Bikini Bottom cantare interpretazioni di canzoni popolari. Questi sono esempi di quanti utilizzano l’intelligenza artificiale per sfruttare l’immagine e la somiglianza delle persone o la proprietà intellettuale.

L’intelligenza artificiale è un eccellente sparring partner per attività creative come il brainstorming e la creazione di bozze, ma a seconda di come vengono utilizzati i risultati, potrebbe portare alla violazione del copyright, al plagio e alla violazione della proprietà intellettuale. Ad esempio, nel gennaio 2023 un gruppo di artisti ha intentato una causa contro Midjourney e Stability AI sostenendo che gli strumenti violavano i diritti di milioni di artisti. L’intelligenza artificiale generativa apre un vaso di fiori legale e c’è ancora molta strada da percorrere, ma la creazione di regole e quadri proattivi aiuterà a mitigare i rischi etici.

5 passaggi per mantenere l'etica dell'IA all'interno dei team

Ecco cinque passaggi che ti aiuteranno a guidare il tuo piano per mitigare i rischi etici dell’IA:

1. Stabilire regole e responsabilità interne per l’uso dell’IA

Prendi in considerazione la creazione di un team di etica dell'IA composto da esperti di etica, esperti legali, tecnici e leader per aiutare a stabilire le regole di base per la tua organizzazione. Ad esempio, utilizzare l’intelligenza artificiale generativa solo per bozze e brainstorming, ma non per contenuti pubblicati esternamente, è un’ottima regola di base.

Insieme a queste regole di base, definire il ruolo e le responsabilità di ciascun membro del team coinvolto nell’intelligenza artificiale, compreso il team etico. Stabilisci i tuoi obiettivi e valori anche per l'intelligenza artificiale. Ciò contribuirà a gettare le basi per la politica etica e le migliori pratiche relative all'IA.

2. Definire e verificare il ruolo dell'IA

L'intelligenza artificiale non può sostituire i creatori di contenuti, gli strateghi dei social media o qualsiasi ruolo nel marketing. Identifica le attività di intelligenza artificiale che richiedono la supervisione o l'intervento umano e individua gli obiettivi della tua politica etica sull'intelligenza artificiale per aiutare a creare processi per lo sviluppo, la gestione e la comunicazione sull'intelligenza artificiale.

Una volta identificati gli obiettivi della tua politica etica, identifica le lacune e le opportunità per l'intelligenza artificiale nella tua organizzazione. Considera le seguenti domande:

- In che modo l’organizzazione utilizza attualmente l’intelligenza artificiale e come vogliamo utilizzarla in futuro?

- Quali software e analisi possono aiutarci a mitigare i rischi aziendali?

- Quali lacune creano la tecnologia e l’analisi? Come li riempiamo?

- Quali test o esperimenti dobbiamo condurre?

- Quali soluzioni esistenti possiamo utilizzare con le migliori pratiche attuali per i nostri team di prodotto?

- Come utilizzerai dati e approfondimenti?

- Come stabiliremo il posizionamento e la messaggistica del nostro marchio per le tecnologie e l'etica dell'intelligenza artificiale?

3. Sviluppare un processo di valutazione dei fornitori ermetico

Collabora con i tuoi team IT e legali per esaminare adeguatamente tutti gli strumenti con funzionalità di intelligenza artificiale e stabilire un processo di rischio etico. La loro esperienza ti aiuterà a valutare nuove considerazioni come il set di dati su cui è addestrato uno strumento e i controlli messi in atto dai fornitori per mitigare i bias dell'IA. Un processo di due diligence per ogni strumento prima del lancio esterno o interno ti aiuterà a mitigare i rischi futuri.

4. Mantenere la trasparenza nelle informative

Collabora con i tuoi team legali e/o privacy per sviluppare messaggi esterni e/o dichiarazioni di non responsabilità per indicare dove e quando il tuo marchio fa affidamento sull'intelligenza artificiale. Questi messaggi possono essere utilizzati per contenuti, assistenza clienti, ecc. Ad esempio, TikTok ha aggiornato le linee guida della community per richiedere ai creatori di etichettare i contenuti generati dall'intelligenza artificiale. Comunicare i vostri standard etici e i vostri quadri per sostenere l’etica dell’IA aiuterà a guadagnare la fiducia di colleghi, potenziali clienti e clienti.

5. Continuare la formazione della leadership e dei team

L’intelligenza artificiale non è qualcosa in cui la leadership aziendale può precipitarsi. Come ogni nuova ondata di innovazione emergente, ci sarà una curva di apprendimento, oltre ai nuovi traguardi tecnologici. Contribuisci a garantire condizioni di parità organizzando corsi di formazione e workshop interni per educare tutti i membri del team, i leader e le parti interessate sull'etica dell'IA e su come costruirla in modo responsabile.

Fai la cosa giusta con l’etica dell’IA

Considerare l’etica non è solo la cosa giusta da fare: è una componente fondamentale per sfruttare la tecnologia dell’intelligenza artificiale nel mondo degli affari.

Scopri ulteriori punti di vista di leader ed esperti di marketing su come l'intelligenza artificiale avrà un impatto sul futuro dei social nel nostro webinar, insieme ad altri risultati del rapporto sullo stato dei social media del 2023 e suggerimenti per creare contenuti social di grande impatto.