AI の倫理: マーケティング担当者が責任を持ってイノベーションをどのように受け入れるか

公開: 2023-08-21人工知能 (AI) は、単なる SF 現象が現実になったものではなく、私たちの目の前で数十年かけて開発された技術の柱です。 AI は効率向上の夢を実現しており、多くのブランドが過去数年間ですでに AI マーケティングを活用しています。

興奮と熱狂を引き起こしましたが、AI の倫理を巡る懸念もあります。 多くのイノベーションと同様、テクノロジー業界のメタバースに対するビジョンには、Black Mirror や Snow Crash などのメディアと不気味な類似点がありました。 そして、文化的な時代精神の中にある『種をまく人、機械、ロボットの寓話』のような作品を考えると、SF ファン、研究者、技術者が同様に AI 倫理を無視することの危険性を警告するのも理解できます。

この記事では、AI 倫理とは何か、ブランドが懸念する必要がある理由、雇用の安定、誤った情報、アルゴリズムのバイアスなど、マーケターが直面する最も重要な倫理問題について定義します。 また、チーム内および組織全体で倫理的な AI 実践を維持するのに役立つ 5 つのステップも紹介します。

AIの倫理とは何ですか?

AI 倫理は、人工知能テクノロジーの開発と成果について責任を持って情報を提供するために使用される道徳原則と専門的実践の体系です。 また、AI の影響を最適化し、リスクや結果を軽減する方法の研究にも言及します。

大手テクノロジー企業、国連などの政府機関、研究およびデータサイエンスコミュニティは、倫理問題に対処するためのガイドラインの策定と発行に取り組んできました。 たとえば、国連教育科学文化機関 (ユネスコ) は、2021 年 11 月に AI 倫理に関する初の世界標準である「人工知能の倫理に関する勧告」を発行しました。

国および地方レベルでいくつかの AI 規制が実施されていますが、AI やその他の新興テクノロジーが成長するにつれて、企業は政府による規制の強化を期待する必要があります。 AI が私たちの生活にさらに統合されるにつれて、AI 倫理はデジタル リテラシーの重要な部分になります。

AI の倫理が重要な理由

企業はすでに AI に投資していますが、責任ある使用を確保することが難しいのです。

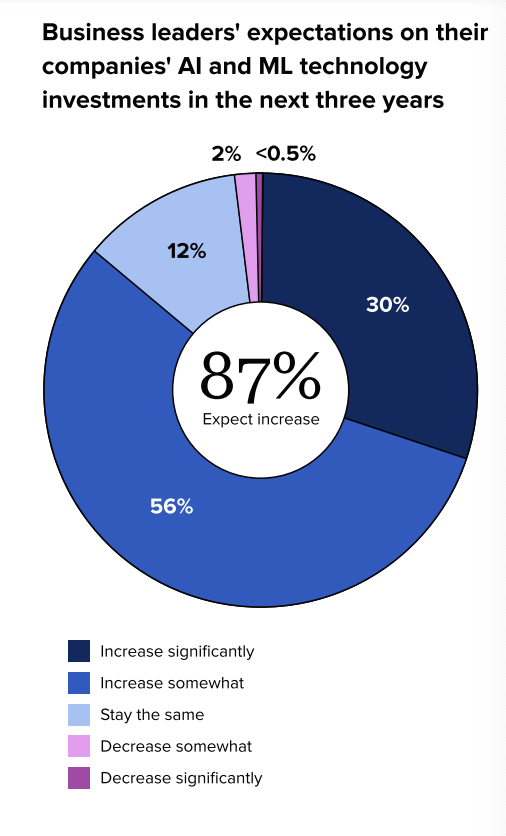

「2023 年のソーシャル メディアの現状: AI とデータ テイク センター ステージ」レポートによると、ビジネス リーダーは今後数年間で AI への投資が増加すると予想しています。 また、当社のレポートでは、ビジネス リーダーの 98% が、企業が長期的な成功のために AI および機械学習 (ML) テクノロジーの可能性をより深く理解する必要があることに同意していることもわかりました。

AI はパフォーマンスを向上させ、効率を高め、ビジネスにプラスの成果を生み出すことができますが、ブランドは AI の適用によって予期せぬ影響も経験しています。 これは、調査の不足や偏ったデータセットなどが原因である可能性があります。 AI の誤用や倫理的懸念の無視は、ブランドの評判の低下、製品の故障、訴訟や規制の問題につながる可能性があります。

組織内のチーム全体で倫理基準を維持するための最初のステップは、マーケティング担当者が直面している問題を理解することから始まり、これらのビジネス リスクを軽減し、ブランドを保護するための計画を立てることができます。

マーケターにとって AI の倫理問題は何ですか

テクノロジー業界には、次のような AI 倫理上のさまざまな懸念がありますが、これらに限定されません。

- 誤ったコンテンツの生成

- 説明可能性

- 社会的影響

- テクノロジーの悪用

- バイアス

- データの責任とプライバシー

- 公平性

- 堅牢性

- 透明性

- 環境の持続可能性

- ダイバーシティとインクルージョン

- 道徳的主体性と価値観の一致

- 信頼と説明責任

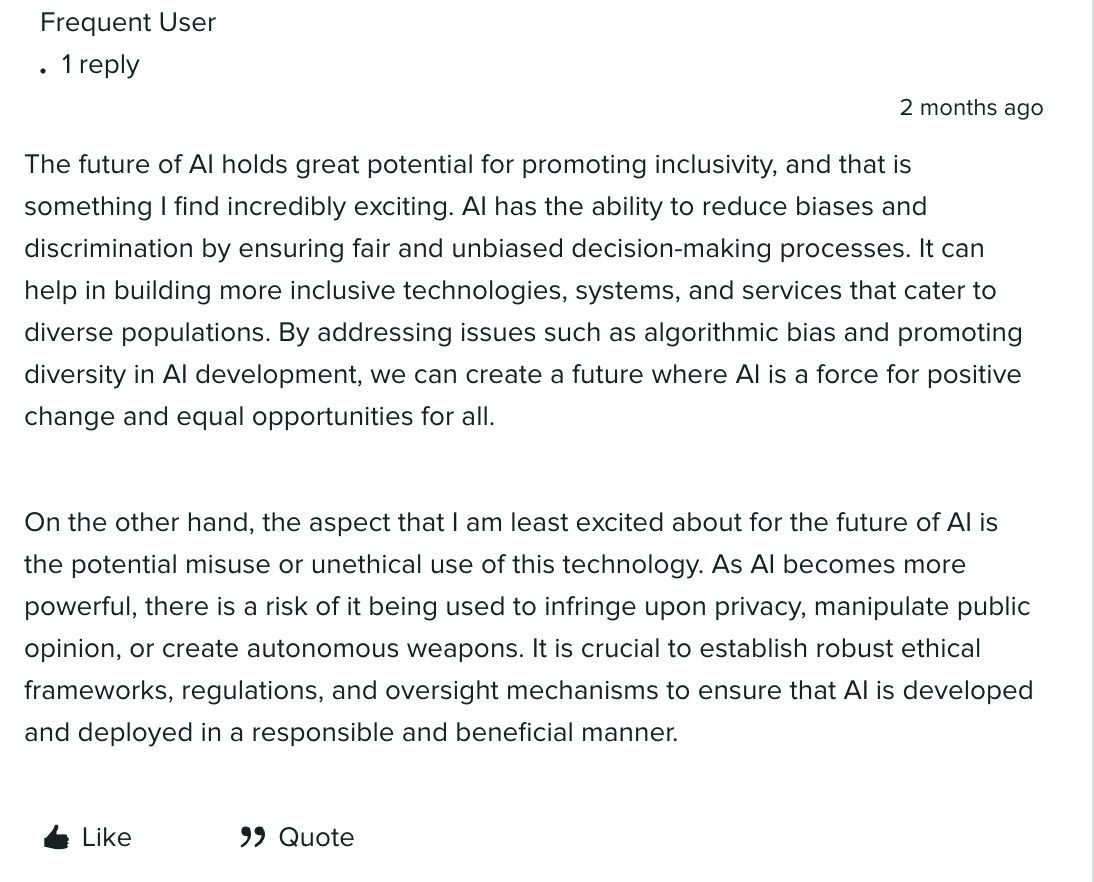

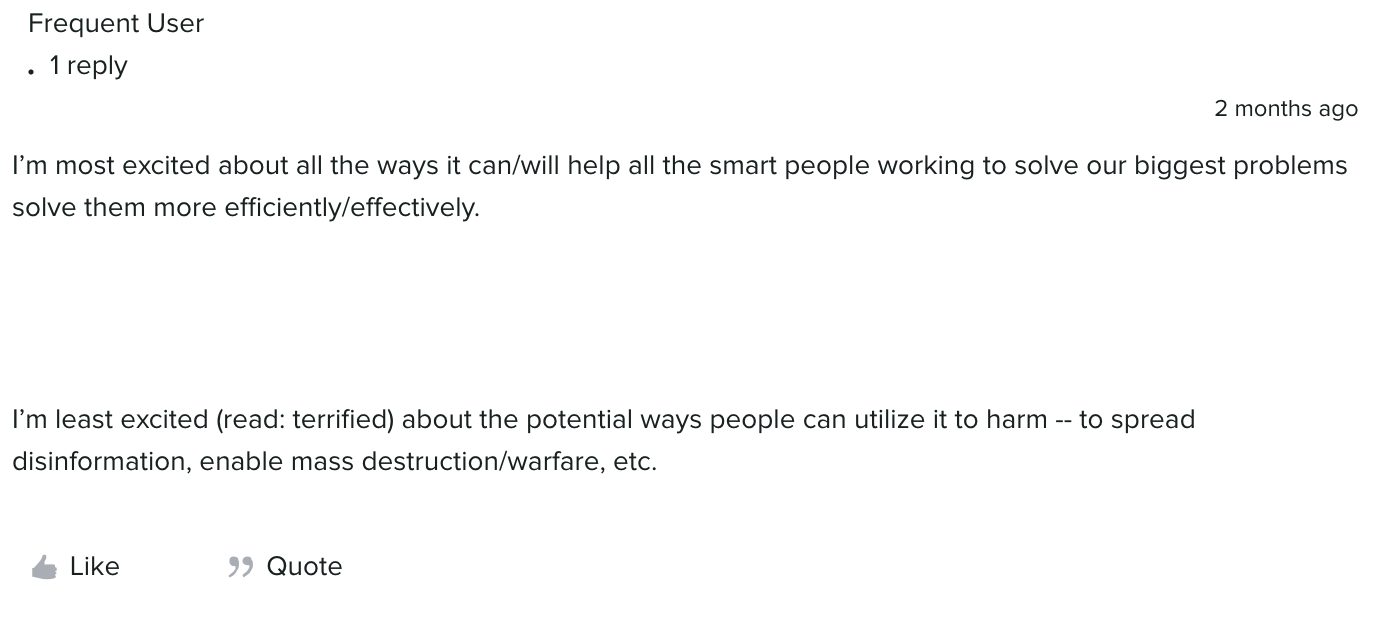

AI は、多様な人々に対応できる、より包括的なテクノロジー、システム、サービスの構築に役立つと信じている人もいます。 重要なのは、責任ある使用を保証するための倫理的な枠組み、規制、メカニズムを確立することです。

Sprout のコミュニティ フォーラムである Arboretum のメンバーは、AI には公平で偏りのない意思決定プロセスを確保することで包括性を促進し、偏見や差別を軽減する可能性があると指摘しました。 AI 開発におけるアルゴリズムのバイアスなどの問題に対処することで、AI が前向きな変化をもたらす未来を形作ることが可能になる可能性があります。

AI がより強力になるにつれて、前向きな変化の可能性とともに、AI の誤用や非倫理的な使用の機会も生じます。 私たちのコミュニティでは、プライバシー侵害、世論操作、自律型兵器などのいくつかのリスクについて議論しました。

このようなコメントは、業界全体にわたる倫理的懸念の表面をなぞっただけですが、マーケターにとっての最大の問題には、雇用の安全、プライバシー、偏見と差別、誤った情報と偽情報、知的財産/著作権の問題が含まれます。これらについては、次の記事で詳しく説明します。次のセクション。

雇用と離職への影響

ロボットが世界征服を確保することは、少なくとも現時点では私たちの心配の種ではありません。

それは、研究者や専門家がテクノロジーの特異点や、AI が人間の知性を超え、ソーシャル スキルなどの特性を再現するという考えに脅かされていないからです。 彼らは AI の限界と、仕事の代替による潜在的な影響を認識しています。

AI の研究と投資の目標は、人間に取って代わることではなく、より影響力のあることを行うために時間と労力を節約することです。 Flock Freight のソーシャル メディアおよびパートナーシップ担当ディレクター、ボブ ウルフリー氏は、AI について次のように素晴らしい例えを披露しました。「AI は、家庭における食器洗い機や洗濯機のようなものです。 食器や衣服を手洗いしないことで節約できる時間を常に考えてください。」

シリーズ「Unread」では、Sprout のマーケティングおよびクリエイティブ チームのメンバーが、パーソナライズされたショッピングの利用から、ソーシャル投稿のスケジュールを支援する ViralPost などの機能の使用まで、AI を現在どのように使用しているかについて話し合いました。 雇用の代替を含め、AI の利点と懸念についての彼らの熱い意見を聞くには、以下のビデオをご覧ください。

プライバシーの問題

データのプライバシー、保護、セキュリティに関する懸念は、ブランドにとって最優先事項です。 監視、ハッキング、サイバー攻撃の機会を回避しようとする企業にとって、セキュリティへの投資はますます優先事項になっています。 パーソナライゼーションの人気が高まるにつれ、ブランドは顧客や組織を保護するためにデータの収集、保存、分析に関するベスト プラクティスを導入しています。

アルゴリズムの偏見と差別

AI はデータから学習するため、構築またはトレーニングが不十分な AI は、過小評価されているデータのサブセットに対してバイアスを示す可能性があります。 AI によって生成されたアートワーク、チャットボット、顔認識ソフトウェア、アルゴリズム、雇用慣行用の AI ツールに関する大きな偏見の事例がいくつかありました。

たとえば、TikTok と Twitter [2023 年 7 月に X にブランド名変更] のユーザー数名が、銃で飾られた「#SouthSudan Barbie」を特集したスレッドを批判しました。これは、大量虐殺や難民危機などの社会政治的問題に取り組んでいる地域に関連付けられた否定的な固定観念です。 。

![Twitter スレッドで AI が生成した「#SouthSudan Barbie」の写真に対するユーザーの反応[2023 年 7 月現在、X にブランド名変更]。投稿には「私たちは皆さんに、このAIが生成したゴミには偏見が組み込まれていると言い続けています」と書かれている。](/uploads/article/221435/S1hZxuJ0KyrnC8ur.png)

このような AI の使用事例でバイアスがさらに危険にさらされる中、問題は、トレーニング データセットがバイアスになりやすい場合に、バイアスや差別にどのように対処するかということになります。

誤った情報と偽情報

人間と同じように、AI も完璧ではありません。 プロンプトに対する AI の応答は不正確になる可能性があり、人々が悪意を持って誤った情報を広める恐れがあります。 偽情報の脅威に加えて、特に適切な保護手段やプロトコルが整備されていない場合、ブランド危機や評判の低下が生じる可能性があります。

知的財産と著作権の問題

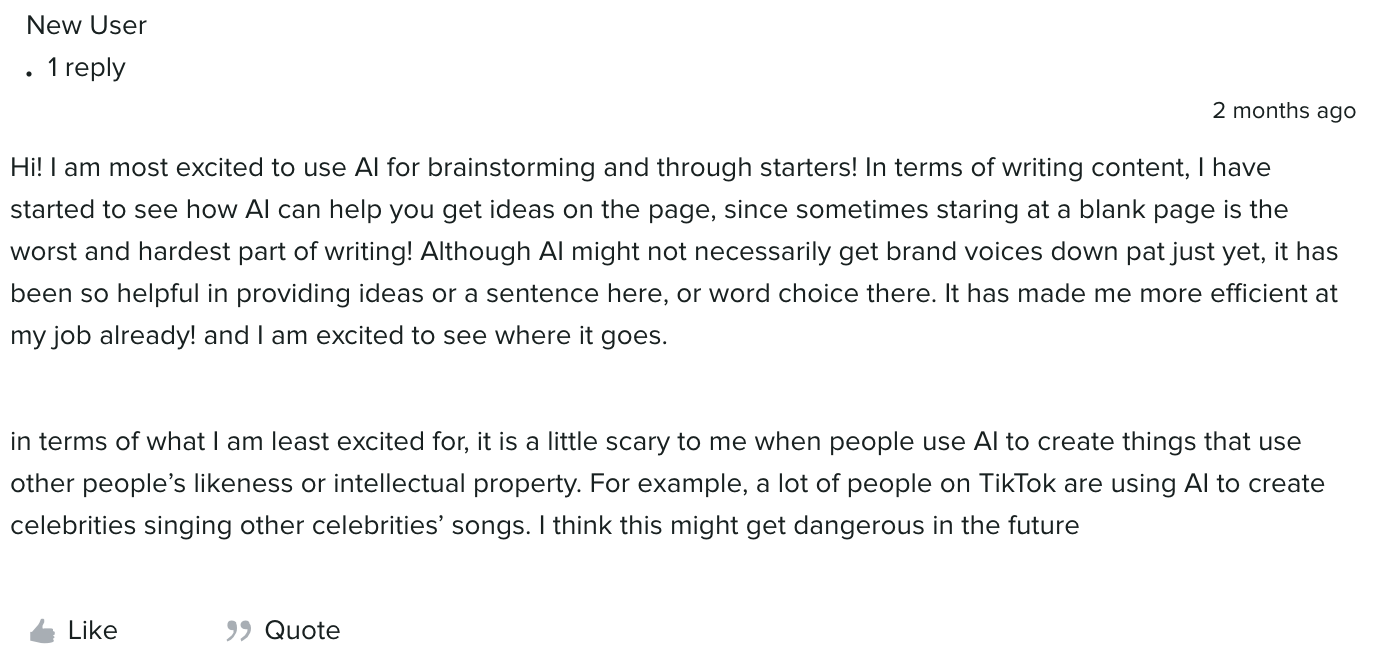

あなたはおそらく、ハリー・ポッターがウェス・アンダーソン映画の登場人物として出演したり、ビキニボトムの住民が人気曲の演奏を歌ったりしているのを見たことがあるでしょう。 これらは、人々のイメージや肖像、知的財産を使用するために AI を使用している人がどれだけいるかを示す例です。

AI はブレインストーミングやアウトラインの作成などの創造的なタスクの優れたスパーリング パートナーですが、出力の使用方法によっては、著作権侵害、盗作、知的財産権の侵害につながる可能性があります。 たとえば、アーティストのグループは、ツールが何百万ものアーティストの権利を侵害しているとして、2023年1月にMidjourneyとStability AIに対して訴訟を起こしました。 生成 AI は合法的な問題を解決し、カバーすべき余地はまだたくさんありますが、積極的なルールとフレームワークを作成することは、倫理的リスクを軽減するのに役立ちます。

チーム内で AI 倫理を維持するための 5 つのステップ

AI の倫理的リスクを軽減する計画の指針となる 5 つのステップを次に示します。

1. AI 使用に関する社内基本ルールと責任を設定する

組織の基本ルールを確立するために、倫理学者、法律専門家、技術者、リーダーからなる AI 倫理チームの設立を検討してください。 たとえば、生成 AI は下書きやブレインストーミングにのみ使用し、外部に公開されたコンテンツには使用しないことが優れた基本ルールです。

これらの基本ルールに加えて、倫理チームを含む AI に関与する各チーム メンバーの役割と責任を定義します。 AI に対する目標と価値観も設定します。 これは、AI 倫理ポリシーとベスト プラクティスの基礎を確立するのに役立ちます。

2. AI の役割を定義し監査する

AI は、コンテンツ クリエーター、ソーシャル メディア ストラテジスト、またはマーケティングにおけるあらゆる役割を置き換えることはできません。 人間の監視や介入が必要な AI タスクを特定し、AI の開発、管理、コミュニケーションのプロセスを作成するために役立つ AI 倫理ポリシーの目標を特定します。

倫理ポリシーの目標を特定したら、組織における AI のギャップと機会を特定します。 次の質問について考えてみましょう。

- 組織は現在 AI をどのように使用していますか?また、将来的にはどのように使用したいと考えていますか?

- ビジネスリスクの軽減に役立つソフトウェアと分析は何ですか?

- テクノロジーと分析はどのようなギャップを生み出しますか? それらをどのように埋めるのでしょうか?

- どのようなテストや実験を行う必要がありますか?

- 製品チームの現在のベスト プラクティスに合わせて使用できる既存のソリューションは何ですか?

- データと洞察をどのように活用しますか?

- AI テクノロジーと倫理に関するブランドのポジショニングとメッセージングをどのように確立するのでしょうか?

3. 厳重なベンダー評価プロセスを開発する

IT チームおよび法務チームと連携して、AI 機能を備えたツールを適切に検査し、倫理的リスク プロセスを確立します。 彼らの専門知識は、ツールがトレーニングされるデータセットや AI バイアスを軽減するためにベンダーが導入している制御など、新たな考慮事項を評価するのに役立ちます。 外部または内部で起動する前に、すべてのツールのデューデリジェンス プロセスを実行することは、将来のリスクを軽減するのに役立ちます。

4. 開示による透明性の維持

法務チームやプライバシー チームと協力して、ブランドがいつどこで AI に依存しているかを示す外部メッセージや免責事項を作成します。 これらのメッセージは、コンテンツや顧客ケアなどに使用できます。たとえば、TikTok はコミュニティ ガイドラインを更新し、AI が生成したコンテンツにラベルを付けることをクリエイターに義務付けました。 AI 倫理を擁護するための倫理基準とフレームワークを伝えることは、同僚、見込み客、顧客の信頼を獲得するのに役立ちます。

5. リーダーシップとチーム全体で教育を継続する

AI は企業リーダーが急いで導入できるものではありません。 新たなイノベーションの波と同様に、新たな技術的マイルストーンの上に学習曲線が存在します。 社内トレーニングやワークショップを開催して、すべてのチーム メンバー、リーダー、関係者に AI 倫理と責任を持って AI を構築する方法を教育することで、平等な競争条件を実現します。

AI 倫理に関して正しいことを行う

倫理を考慮することは単に正しいことであるというだけではなく、ビジネスで AI テクノロジーを活用する上で重要な要素です。

ウェビナーでは、AI がソーシャルの将来にどのような影響を与えるかについて、リーダーやマーケターからの視点をさらに学び、2023 年のソーシャル メディアの現状レポートのその他の調査結果や、影響力のあるソーシャル コンテンツを作成するためのヒントをご覧ください。