Etyka sztucznej inteligencji: jak marketerzy powinni odpowiedzialnie podchodzić do innowacji

Opublikowany: 2023-08-21Sztuczna inteligencja (AI) to nie tylko zjawisko science fiction, które stało się rzeczywistością — to filar technologii rozwijany przez dziesięciolecia tuż pod naszymi nosami. Sztuczna inteligencja urzeczywistniła marzenia o zwiększonej wydajności, a wiele marek już w ciągu ostatnich kilku lat korzystało z marketingu AI.

Chociaż wywołało to podekscytowanie i entuzjazm, istnieją obawy dotyczące etyki sztucznej inteligencji. Podobnie jak wiele innowacji, wizja metaświata przedstawiona przez branżę technologiczną była niesamowicie podobna do wizji mediów takich jak Black Mirror i Snow Crash . A w przypadku dzieł takich jak Przypowieść o siewcy, maszynie i ja, robocie wpisanych w kulturowego ducha czasu zrozumiałe jest, dlaczego fani science fiction, badacze i technolodzy ostrzegają przed niebezpieczeństwami wynikającymi z ignorowania etyki sztucznej inteligencji.

W tym artykule zdefiniujemy, czym jest etyka sztucznej inteligencji, dlaczego marki powinny się martwić i jakie są najważniejsze problemy etyczne stojące przed marketerami, w tym bezpieczeństwo pracy, dezinformacja i stronniczość algorytmiczna. Podzielimy się również pięcioma krokami, które pomogą Ci utrzymać etyczne praktyki sztucznej inteligencji w zespołach i całej organizacji.

Czym jest etyka AI?

Etyka sztucznej inteligencji to system zasad moralnych i praktyk zawodowych stosowanych w celu odpowiedzialnego informowania o rozwoju i wynikach technologii sztucznej inteligencji. Odnosi się również do badania nad optymalizacją wpływu i ograniczaniem ryzyka i/lub konsekwencji sztucznej inteligencji.

Wiodące firmy technologiczne, podmioty rządowe, takie jak Organizacja Narodów Zjednoczonych, oraz społeczności badawcze i zajmujące się nauką o danych pracowały nad opracowaniem i opublikowaniem wytycznych dotyczących rozwiązywania problemów etycznych. Na przykład Organizacja Narodów Zjednoczonych ds. Oświaty, Nauki i Kultury (UNESCO) opublikowała w listopadzie 2021 r. pierwszy światowy standard dotyczący etyki sztucznej inteligencji: Zalecenie w sprawie etyki sztucznej inteligencji.

Na poziomie krajowym i lokalnym obowiązują pewne regulacje dotyczące sztucznej inteligencji, ale w miarę rozwoju sztucznej inteligencji i innych nowych technologii firmy powinny spodziewać się większej liczby regulacji rządowych. W miarę jak sztuczna inteligencja coraz bardziej integruje się z naszym życiem, etyka sztucznej inteligencji staje się kluczową częścią umiejętności cyfrowych.

Dlaczego etyka sztucznej inteligencji ma znaczenie

Firmy już inwestują w sztuczną inteligencję, ale trudnością jest zapewnienie odpowiedzialnego jej wykorzystania.

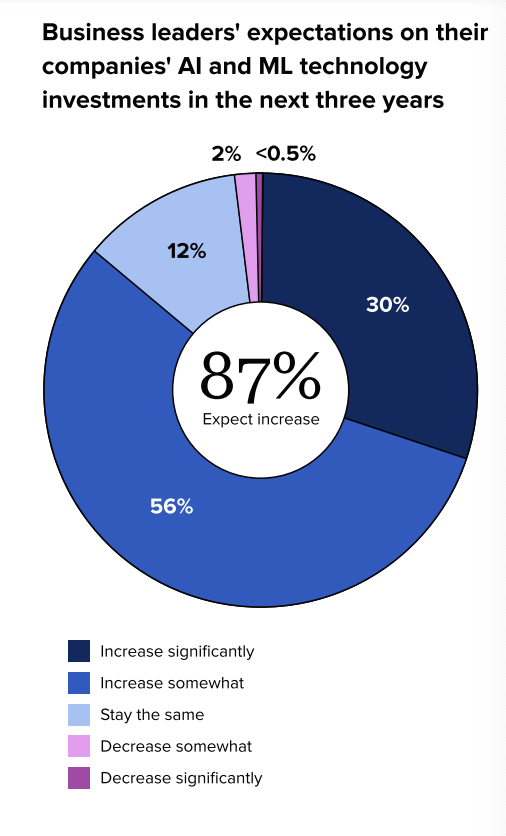

Jak wynika z raportu The 2023 State of Social Media: AI and Data Take Center Stage, liderzy biznesu spodziewają się w ciągu najbliższych kilku lat zwiększonych inwestycji w sztuczną inteligencję. Z naszego raportu wynika również, że 98% liderów biznesu zgadza się, że firmy muszą lepiej rozumieć potencjał sztucznej inteligencji i technologii uczenia maszynowego (ML), aby osiągnąć długoterminowy sukces.

Chociaż sztuczna inteligencja może poprawić wydajność, zwiększyć efektywność i generować pozytywne wyniki biznesowe, marki również doświadczają nieprzewidzianych konsekwencji jej zastosowania. Może to wynikać między innymi z braku badań lub stronniczych zbiorów danych. Niewłaściwe wykorzystanie sztucznej inteligencji lub zaniedbanie kwestii etycznych może skutkować szkodą dla reputacji marki, awariami produktów, sporami sądowymi i problemami regulacyjnymi.

Pierwszy krok w kierunku przestrzegania standardów etycznych we wszystkich zespołach w organizacji rozpoczyna się od zrozumienia problemów, z jakimi borykają się marketerzy, co umożliwi opracowanie planu minimalizującego te ryzyka biznesowe i chroniącego markę.

Jakie kwestie etyczne dotyczące sztucznej inteligencji są najważniejsze dla marketerów?

W branży technologicznej istnieje wiele problemów etycznych związanych ze sztuczną inteligencją, w tym między innymi:

- Fałszywe generowanie treści

- Wyjaśnialność

- Wpływ społeczny

- Nadużycie technologii

- Stronniczość

- Odpowiedzialność za dane i prywatność

- Uczciwość

- Krzepkość

- Przezroczystość

- Zrównoważony rozwój środowiska

- Różnorodność i integracja

- Moralna agencja i wyrównanie wartości

- Zaufanie i odpowiedzialność

Niektórzy uważają, że sztuczna inteligencja może pomóc w tworzeniu bardziej włączających technologii, systemów i usług, które będą dostosowane do zróżnicowanych populacji. Kluczem jest ustanowienie ram etycznych, przepisów i mechanizmów zapewniających odpowiedzialne użytkowanie.

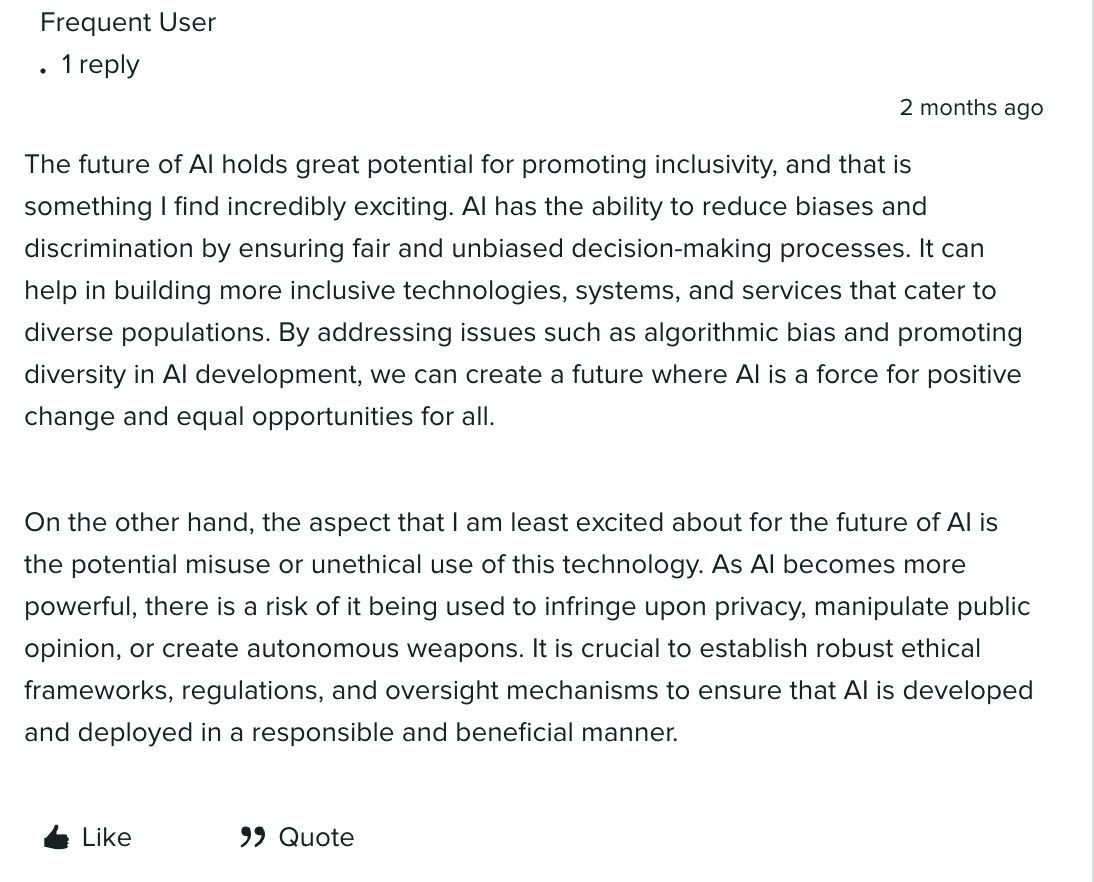

Członek Arboretum, forum społeczności Sprout, zauważył, że sztuczna inteligencja może promować włączenie i ograniczać uprzedzenia/dyskryminację poprzez zapewnienie sprawiedliwych i bezstronnych procesów decyzyjnych. Zajmując się takimi kwestiami, jak stronniczość algorytmiczna w rozwoju sztucznej inteligencji, możliwe byłoby ukształtowanie przyszłości, w której sztuczna inteligencja będzie pozytywną siłą zmian.

Oprócz potencjału pozytywnych zmian istnieją również możliwości niewłaściwego lub nieetycznego wykorzystania sztucznej inteligencji w miarę jej zwiększania się. Nasza społeczność omówiła kilka zagrożeń, w tym naruszenie prywatności, manipulację opinią publiczną i broń autonomiczną.

Tego typu komentarze jedynie zarysowują powierzchnię obaw etycznych w różnych branżach, ale najważniejsze kwestie dla marketerów obejmują: bezpieczeństwo pracy, prywatność, uprzedzenia i dyskryminację, dezinformację i dezinformację oraz kwestie własności intelektualnej/praw autorskich, które szczegółowo omówimy w artykule następna sekcja.

Wpływ na miejsca pracy i zmiany miejsc pracy

Roboty zapewniające dominację nad światem to najmniejsze z naszych zmartwień — przynajmniej na razie.

A to dlatego, że naukowcom i ekspertom nie zagraża osobliwość technologii ani pomysł, że sztuczna inteligencja przewyższy ludzką inteligencję i powieli cechy, takie jak umiejętności społeczne. Są świadomi ograniczeń sztucznej inteligencji i potencjalnych konsekwencji zmiany pracy.

Celem badań nad sztuczną inteligencją i inwestowania w nią nie jest zastąpienie ludzi — ma ona pomóc nam zaoszczędzić czas i wysiłek, aby robić bardziej znaczące rzeczy. Dyrektor ds. mediów społecznościowych i partnerstw Flock Freight, Bob Wolfley, podzielił się świetną analogią do sztucznej inteligencji: „AI jest jak zmywarka do naczyń lub pralka w naszych domach. Pomyśl o całym czasie, który zaoszczędzisz, nie zmywając ręcznie naczyń ani ubrań”.

W naszej serii Nieprzeczytane członkowie zespołu marketingowego i kreatywnego Sprout omawiali, w jaki sposób obecnie wykorzystują sztuczną inteligencję, od oddawania się spersonalizowanym zakupom po korzystanie z funkcji takich jak ViralPost do planowania postów w mediach społecznościowych. Obejrzyj poniższy film, aby usłyszeć gorące opinie na temat korzyści i obaw związanych ze sztuczną inteligencją, w tym zmiany pracy:

Obawy dotyczące prywatności

Obawy związane z prywatnością, ochroną i bezpieczeństwem danych są najważniejsze dla marek. Inwestycje w bezpieczeństwo stają się coraz ważniejszym priorytetem dla firm, które starają się unikać wszelkich okazji do inwigilacji, hakowania i cyberataków. W miarę jak personalizacja staje się coraz bardziej popularna, marki wdrażają najlepsze praktyki gromadzenia, przechowywania i analizowania danych w celu ochrony klientów i organizacji.

Błąd algorytmiczny i dyskryminacja

Ponieważ uczy się na podstawie danych, źle skonstruowana lub wyszkolona sztuczna inteligencja może wykazywać stronniczość wobec niedostatecznie reprezentowanych podzbiorów danych. Było kilka dużych przypadków stronniczości w przypadku grafiki generowanej przez sztuczną inteligencję, chatbotów, oprogramowania do rozpoznawania twarzy, algorytmów i narzędzi sztucznej inteligencji w praktykach zatrudniania.

Na przykład kilku użytkowników TikTok i Twittera [przemianowanych na X od lipca 2023 r.] wywołało wątek przedstawiający „#SouthSudan Barbie” ozdobioną bronią, co jest negatywnym stereotypem związanym z regionem borykającym się z problemami społeczno-politycznymi, takimi jak ludobójstwo i kryzys uchodźczy .

![Odpowiedź użytkownika na wygenerowane przez sztuczną inteligencję zdjęcie „#SouthSudan Barbie” w wątku na Twitterze [przemianowane na X od lipca 2023 r.]. Post brzmi: „Wciąż powtarzamy wszystkim, że uprzedzenia są wbudowane w te śmieci generowane przez sztuczną inteligencję”.](/uploads/article/221435/S1hZxuJ0KyrnC8ur.png)

Kiedy stronniczość wkracza na jeszcze niższe stawki, sztuczna inteligencja wykorzystuje takie przypadki, pytanie brzmi: jak przeciwdziałać uprzedzeniom i dyskryminacji, skoro zestawy danych szkoleniowych mogą być podatne na stronniczość?

Dezinformacja i dezinformacja

Podobnie jak ludzie, sztuczna inteligencja nie jest doskonała. Odpowiedzi sztucznej inteligencji na monity mogą być niedokładne i istnieją obawy, że ludzie rozpowszechniają dezinformację w złych zamiarach. Wraz z groźbami dezinformacji istnieje możliwość kryzysu marki i utraty reputacji, zwłaszcza bez odpowiednich zabezpieczeń i protokołów.

Kwestie własności intelektualnej i praw autorskich

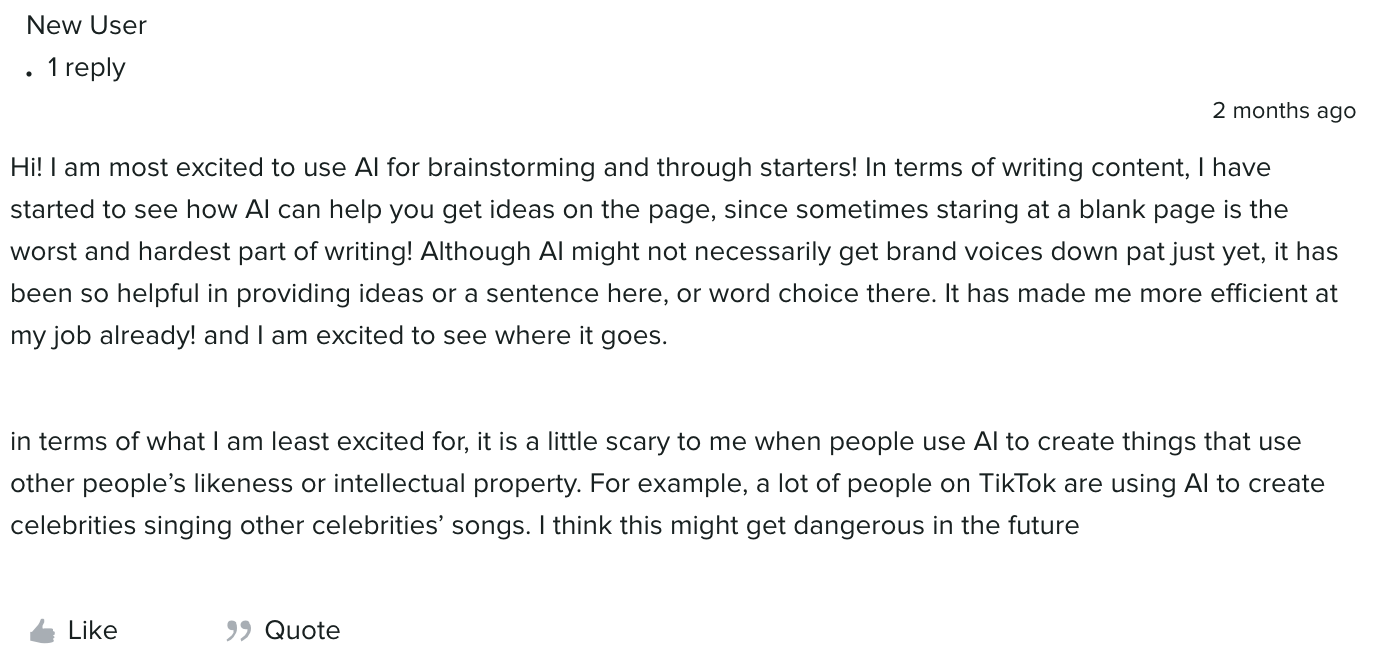

Prawdopodobnie widziałeś Harry'ego Pottera w roli postaci w filmie Wesa Andersona lub mieszkańców Bikini Bottom śpiewających wersje popularnych piosenek. Są to przykłady tego, jak wiele osób wykorzystuje sztuczną inteligencję do wykorzystywania wizerunku i podobieństwa ludzi lub własności intelektualnej.

Sztuczna inteligencja jest doskonałym partnerem sparingowym do zadań kreatywnych, takich jak burza mózgów i tworzenie konspektów, ale w zależności od sposobu wykorzystania danych wyjściowych może prowadzić do naruszenia praw autorskich, plagiatu i praw własności intelektualnej. Na przykład grupa artystów złożyła pozew przeciwko Midjourney i Stability AI w styczniu 2023 r., twierdząc, że narzędzia naruszyły prawa milionów artystów. Generatywna sztuczna inteligencja otwiera legalną puszkę robaków i wciąż jest wiele do pokonania, ale tworzenie proaktywnych zasad i ram pomoże złagodzić ryzyko etyczne.

5 kroków do utrzymania etyki AI w zespołach

Oto pięć kroków, które pomogą Ci zaplanować plan ograniczania ryzyka etycznego związanego ze sztuczną inteligencją:

1. Ustal wewnętrzne podstawowe zasady i obowiązki związane z wykorzystaniem sztucznej inteligencji

Rozważ utworzenie zespołu ds. etyki AI składającego się z etyków, ekspertów prawnych, technologów i liderów, który pomoże ustalić podstawowe zasady obowiązujące w Twojej organizacji. Na przykład używanie generatywnej sztucznej inteligencji tylko do szkiców i burzy mózgów, ale nie do treści publikowanych zewnętrznie, jest doskonałą podstawową zasadą.

Wraz z tymi podstawowymi zasadami zdefiniuj rolę i obowiązki każdego członka zespołu zaangażowanego w sztuczną inteligencję, w tym zespołu ds. etyki. Ustaw swoje cele i wartości również dla AI. Pomoże to stworzyć podstawy dla Twojej polityki etycznej i najlepszych praktyk związanych ze sztuczną inteligencją.

2. Zdefiniuj i skontroluj rolę AI

Sztuczna inteligencja nie może zastąpić twórców treści, strategów mediów społecznościowych ani żadnej innej roli w marketingu. Zidentyfikuj zadania sztucznej inteligencji wymagające nadzoru lub interwencji człowieka i określ cele swojej polityki etycznej dotyczącej sztucznej inteligencji, aby pomóc w opracowaniu procesów rozwijania sztucznej inteligencji, zarządzania nią i komunikowania się na jej temat.

Po określeniu celów swojej polityki etycznej zidentyfikuj luki i możliwości związane ze sztuczną inteligencją w swojej organizacji. Rozważ następujące pytania:

- W jaki sposób organizacja obecnie wykorzystuje AI i jak chcemy ją wykorzystać w przyszłości?

- Jakie oprogramowanie i analizy mogą pomóc nam ograniczyć ryzyko biznesowe?

- Jakie luki tworzą technologia i analiza? Jak je wypełniamy?

- Jakie testy lub eksperymenty musimy przeprowadzić?

- Jakich istniejących rozwiązań możemy użyć z aktualnymi najlepszymi praktykami dla naszych zespołów produktowych?

- Jak wykorzystasz dane i spostrzeżenia?

- W jaki sposób ustalimy pozycjonowanie naszej marki i przekaz w zakresie technologii AI i etyki?

3. Opracuj hermetyczny proces oceny dostawców

Współpracuj ze swoimi zespołami IT i prawnymi, aby odpowiednio zweryfikować wszelkie narzędzia z możliwościami sztucznej inteligencji i ustanowić proces ryzyka etycznego. Ich wiedza specjalistyczna pomoże Ci ocenić nowe kwestie, takie jak zbiór danych, na którym narzędzie jest szkolone, oraz mechanizmy kontrolne stosowane przez dostawców w celu ograniczenia stronniczości sztucznej inteligencji. Proces należytej staranności dla każdego narzędzia przed wprowadzeniem go na rynek zewnętrzny lub wewnętrzny pomoże ograniczyć przyszłe ryzyko.

4. Zachowaj przejrzystość dzięki ujawnieniom

Współpracuj ze swoimi zespołami prawnymi i/lub ds. prywatności, aby opracować zewnętrzne komunikaty i/lub zastrzeżenia, aby wskazać, gdzie i kiedy Twoja marka opiera się na sztucznej inteligencji. Wiadomości te można wykorzystać do celów obsługi klienta itp. Na przykład TikTok zaktualizował swoje wytyczne dla społeczności, wymagając od twórców oznaczania treści generowanych przez sztuczną inteligencję. Przekazywanie standardów etycznych i ram promowania etyki AI pomoże zdobyć zaufanie współpracowników, potencjalnych klientów i klientów.

5. Kontynuuj edukację liderów i zespołów

Sztuczna inteligencja nie jest czymś, do czego kierownictwo biznesowe może się spieszyć. Jak każda nowa fala pojawiających się innowacji, oprócz nowych technologicznych kamieni milowych będzie następowała krzywa uczenia się. Pomóż wyrównać szanse, organizując wewnętrzne szkolenia i warsztaty, aby edukować wszystkich członków zespołu, liderów i interesariuszy na temat etyki sztucznej inteligencji i tego, jak ją budować w sposób odpowiedzialny.

Postępuj właściwie, przestrzegając etyki AI

Uwzględnianie etyki to nie tylko właściwa rzecz — to kluczowy element wykorzystania technologii sztucznej inteligencji w biznesie.

Podczas naszego seminarium internetowego poznasz więcej punktów widzenia liderów i marketerów na temat wpływu sztucznej inteligencji na przyszłość mediów społecznościowych, a także inne wnioski z raportu o stanie mediów społecznościowych na rok 2023 i wskazówki dotyczące tworzenia wpływowych treści społecznościowych.