7 poważnych zagrożeń, na jakie narażasz się, stosując sztuczną inteligencję w marketingu

Opublikowany: 2023-07-06Kilka lat temu większość z nas, marketerów, nie miała zielonego pojęcia, jak wykorzystać sztuczną inteligencję w marketingu. Nagle piszemy posty na LinkedIn o najlepszych zachętach do szeptania do ucha ChatGPT.

Jest wiele powodów do świętowania w związku z nagłym wprowadzeniem sztucznej inteligencji do naszej pracy. McKenzie uważa, że sztuczna inteligencja odblokuje 2,6 biliona dolarów wartości dla marketerów.

Ale nasze szybkie przyjęcie sztucznej inteligencji może wyprzedzać ważne kwestie etyczne, prawne i operacyjne – co narazi marketerów na ryzyko, o którym nigdy wcześniej nie myśleliśmy (tj. czy możemy zostać pozwani za mówienie AI, aby „pisała jak Stephen King? ”).

W atmosferze marketingowej jest tona metryczna pyłu AI, który nie uspokoi się przez lata. Bez względu na to, jak bardzo się przymrużysz, nie dostrzeżesz wszystkich potencjalnych pułapek związanych z wykorzystaniem dużych modeli językowych i uczenia maszynowego do tworzenia treści i zarządzania reklamami.

Dlatego naszym celem w tym artykule jest przyjrzenie się siedmiu najważniejszym zagrożeniom związanym z wykorzystaniem sztucznej inteligencji w marketingu z bardzo wysokiego poziomu. Zebraliśmy porady ekspertów, aby pomóc złagodzić te zagrożenia. Dodaliśmy wiele zasobów, dzięki którym możesz zagłębić się w pytania, które Cię najbardziej dotyczą.

Ryzyko nr 1: Błąd uczenia maszynowego

Czasami algorytmy uczenia maszynowego dają wyniki, które niesprawiedliwie przemawiają na korzyść lub przeciw komuś lub czemuś. Nazywa się to błędem uczenia maszynowego lub błędem sztucznej inteligencji i jest to wszechobecny problem nawet w najbardziej zaawansowanych głębokich sieciach neuronowych.

To problem z danymi

Nie chodzi o to, że sieci AI są z natury bigoteryjne. Jest to problem z danymi, które są do nich wprowadzane.

Algorytmy uczenia maszynowego działają poprzez identyfikowanie wzorców w celu obliczenia prawdopodobieństwa wyniku, na przykład tego, czy określona grupa kupujących polubi Twój produkt.

Ale co, jeśli dane, na których trenuje sztuczna inteligencja, są ukierunkowane na określoną rasę, płeć lub grupę wiekową? Sztuczna inteligencja dojdzie do wniosku, że ci ludzie są lepiej dopasowani i odpowiednio dostosuje kreację reklamową lub miejsce docelowe.

edycja prania stronniczości pic.twitter.com/YQLRcq59lQ

— Janelle Shane (@JanelleCShane) 17 czerwca 2021 r

Oto przykład. Naukowcy niedawno przetestowali uprzedzenia ze względu na płeć w systemach kierowania reklam na Facebooku. Śledczy umieścili ogłoszenie o rekrutacji kierowców dostawczych dla Pizza Hut oraz podobne ogłoszenie z tymi samymi kwalifikacjami dla Instacart.

Istniejąca pula kierowców Pizza Hut wypacza mężczyzn, więc Facebook wyświetlał te reklamy nieproporcjonalnie mężczyznom. Instacart ma więcej kobiet-kierowców, więc reklamy ich pracy zostały umieszczone przed większą liczbą kobiet. Ale nie ma nieodłącznego powodu, dla którego kobiety nie chciałyby wiedzieć o pracy w Pizza Hut, więc jest to duży błąd w kierowaniu reklam.

Stronniczość AI jest powszechna

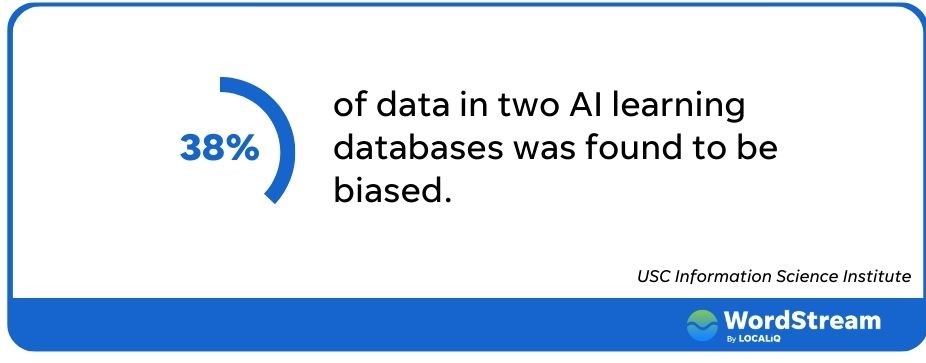

Problem wykracza daleko poza Facebooka. Naukowcy z USC przyjrzeli się dwóm dużym bazom danych AI i stwierdzili, że ponad 38% zawartych w nich danych było stronniczych. Dokumentacja ChatGPT ostrzega nawet, że ich algorytm może kojarzyć „negatywne stereotypy z czarnymi kobietami”.

Stronniczość uczenia maszynowego ma kilka implikacji dla marketerów; najmniejszym z nich jest słaba skuteczność reklamy. Jeśli chcesz dotrzeć do jak największej liczby potencjalnych klientów, platforma kierowania reklam, która wyklucza duże części populacji, nie jest idealna.

Oczywiście istnieją większe konsekwencje, jeśli nasze reklamy są niesprawiedliwie kierowane lub wykluczają określone grupy. Jeśli Twoja reklama nieruchomości dyskryminuje chronione mniejszości, możesz wylądować na niewłaściwym końcu ustawy Fair Housing Act i Federalnej Komisji Handlu. Nie wspominając już o całkowitym braku łodzi marketingowej obejmującej wszystkich.

Jak uniknąć stronniczości AI

Co więc robimy, gdy nasze narzędzia sztucznej inteligencji wpadają w amok? Istnieje kilka kroków, które możesz podjąć, aby Twoje reklamy traktowały wszystkich sprawiedliwie.

Przede wszystkim upewnij się, że ktoś przejrzy Twoje treści, pisze Alaura Weaver, starszy menedżer ds. treści i społeczności w Writer. „Chociaż technologia sztucznej inteligencji znacznie się rozwinęła, brakuje jej umiejętności krytycznego myślenia i podejmowania decyzji, które posiadają ludzie” — wyjaśnia. „Zlecając redaktorom przeglądanie i sprawdzanie faktów treści napisanych przez sztuczną inteligencję, mogą zapewnić, że są one wolne od uprzedzeń i zgodne ze standardami etycznymi”.

Nadzór ludzki zmniejszy ryzyko negatywnych skutków również w płatnych kampaniach reklamowych.

„Obecnie, a być może w nieskończoność, nie jest wskazane, aby sztuczna inteligencja całkowicie przejęła kampanie lub jakąkolwiek formę marketingu” — mówi Brett McHale, założyciel Empiric Marketing. „AI działa optymalnie, gdy otrzymuje dokładne dane wejściowe od inteligencji organicznej, która zgromadziła już ogromne ilości danych i doświadczeń”.

Ryzyko nr 2: Rzeczywiste błędy

Niedawno Google kosztowało swoją firmę macierzystą 100 miliardów dolarów wyceny, kiedy jej nowy chatbot AI, Bard, udzielił nieprawidłowej odpowiedzi w promocyjnym tweecie.

Bard to eksperymentalna konwersacyjna usługa sztucznej inteligencji obsługiwana przez LaMDA. Zbudowany przy użyciu naszych dużych modeli językowych i informacji z sieci, jest starterem dla ciekawości i może pomóc uprościć złożone tematy → https://t.co/fSp531xKy3 pic.twitter.com/JecHXVmt8l

— Google (@Google) 6 lutego 2023 r

Głupota Google podkreśla jedno z największych ograniczeń sztucznej inteligencji i jedno z największych zagrożeń dla korzystających z niej marketerów: sztuczna inteligencja nie zawsze mówi prawdę.

Sztuczna inteligencja ma halucynacje

Ethan Mollic, profesor z Wharton School of Business, niedawno opisał systemy oparte na sztucznej inteligencji, takie jak ChatGPT, jako „wszechwiedzącego, chętnego do zadowolenia stażystę, który czasami kłamie”.

Oczywiście AI nie jest świadoma, pomimo tego, co niektórzy mogą twierdzić. Nie ma zamiaru nas oszukać. Może jednak cierpieć z powodu „halucynacji”, które prowadzą go do wymyślania różnych rzeczy.

AI to maszyna do przewidywania. Wygląda na to, że wpiszesz następne słowo lub frazę, która odpowie na Twoje zapytanie. Ale to nie jest samoświadome; Sztuczna inteligencja nie ma logiki sprawdzania jelit, aby wiedzieć, czy to, co łączy, ma sens.

W przeciwieństwie do stronniczości, wydaje się, że nie jest to problem z danymi. Nawet jeśli sieć ma wszystkie właściwe informacje, nadal może powiedzieć nam coś złego.

Rozważmy ten przykład, w którym użytkownik zapytał ChatGPT „ile razy Argentyna wygrała mistrzostwa świata FIFA?” Powiedział raz i odniósł się do zwycięstwa zespołu w 1978 roku. Głośnik wysokotonowy zapytał następnie, która drużyna wygrała w 1986 roku.

Zapytany #ChatGPT o to, kto wygrał Mistrzostwa Świata FIFA w 2022 roku. Nie mógł odpowiedzieć. To oczekiwane. Wydaje się jednak, że podaje błędne informacje (przy pozostałych 2 wygranych), mimo że informacje te znajdują się w systemie. Jakieś #wyjaśnienia? pic.twitter.com/fvxe05N12p

— indranil sinharoy (@indranil_leo) 29 grudnia 2022 r.

Chatbot przyznał, że to Argentyna, bez wyjaśnienia swojej poprzedniej gafy.

Niepokojące jest to, że błędne odpowiedzi AI są często pisane tak pewnie, że wtapiają się w otaczający je tekst, sprawiając, że wydają się całkowicie wiarygodne. Mogą być również kompleksowe, jak szczegółowo opisano w pozwie złożonym przeciwko Open.ai, w którym ChatGPT rzekomo wymyślił całą historię defraudacji, którą następnie podzielił się dziennikarz.

Jak uniknąć halucynacji AI

Podczas gdy sztuczna inteligencja może sprowadzić Cię na manowce nawet przy odpowiedziach jednowyrazowych, bardziej prawdopodobne jest, że zboczy z torów podczas pisania dłuższych tekstów.

„Na podstawie jednego monitu sztuczna inteligencja może wygenerować bloga lub e-booka. Tak, to niesamowite – ale jest pewien haczyk” — ostrzega Weaver. „Im więcej generuje, tym więcej będziesz musiał edytować i sprawdzać fakty”.

Aby zmniejszyć szanse, że twoje narzędzie sztucznej inteligencji zacznie snuć halucynacyjne narracje, Weaver mówi, że najlepiej jest stworzyć zarys i pozwolić botowi zająć się nim po jednej sekcji na raz. A potem, oczywiście, poproś osobę o przejrzenie faktów i statystyk, które dodaje.

Ryzyko nr 3: Niewłaściwe zastosowanie narzędzi AI

Każdego ranka budzimy się z nowym zestawem narzędzi AI, które pozornie wyrosły z dnia na dzień jak grzyby po burzy.

Jednak nie każda platforma jest przystosowana do wszystkich funkcji marketingowych, a niektóre wyzwania marketingowe nie mogą (jeszcze) zostać rozwiązane przez sztuczną inteligencję.

Narzędzia AI mają ograniczenia

Świetnym przykładem jest ChatGPT. Piękno piłki AI jest fajne do zabawy (jak pisanie, jak wyjąć kanapkę z masłem orzechowym z magnetowidu w stylu Biblii Króla Jakuba). I może wytworzyć zaskakująco dobrze napisane krótkie odpowiedzi, które przełamują blokadę pisarską. Ale nie proś go o pomoc w badaniu słów kluczowych.

ChatGPT zawodzi ze względu na stosunkowo stary zestaw danych, który zawiera tylko informacje sprzed 2022 roku. Poproś go o zaoferowanie słów kluczowych dla „marketingu AI”, a jego odpowiedzi nie będą pasować do tego, co znajdziesz w innych narzędziach, takich jak Thinword lub Contextminds.

Podobnie zarówno Google, jak i Facebook mają nowe narzędzia oparte na sztucznej inteligencji, które pomagają marketerom tworzyć reklamy, optymalizować wydatki na reklamę i personalizować wrażenia z reklam. Chatbot nie może rozwiązać tych wyzwań.

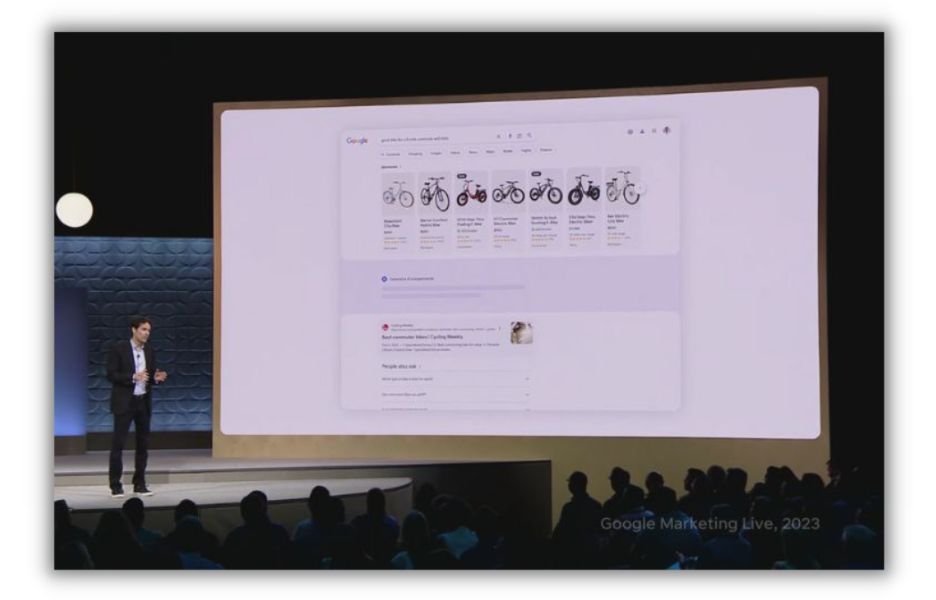

Podczas wydarzenia Google Marketing Live 2023 firma Google ogłosiła szereg aktualizacji sztucznej inteligencji w swoich produktach do wyszukiwania i zarządzania reklamami.

Możesz nadużywać AI

Jeśli przydzielisz narzędziu sztucznej inteligencji pojedyncze zadanie, może ono przeindeksować tylko jeden cel. Nick Abbene, ekspert ds. automatyzacji marketingu, widzi to często w firmach skupionych na poprawie SEO.

„Największym problemem, jaki widzę, jest ślepe używanie narzędzi SEO, nadmierna optymalizacja pod kątem wyszukiwarek i lekceważenie intencji wyszukiwania klientów” – mówi Abbene. „Narzędzia SEO świetnie nadają się do sygnalizowania wyszukiwarkom wysokiej jakości treści. Ale ostatecznie Google chce dopasować się do zapytania osoby wyszukującej”.

Jak uniknąć niewłaściwego zastosowania narzędzi AI

Klucz nie jest najlepszą opcją do wbijania gwoździ. Podobnie asystent pisania AI może nie nadawać się do tworzenia stron internetowych. Zanim zdecydujesz się na jakąkolwiek opcję sztucznej inteligencji, Abbene mówi, aby uzyskać informacje zwrotne od twórcy narzędzia i innych użytkowników.

„Aby uniknąć błędnego wyboru narzędzi AI, dowiedz się, czy inni marketerzy używają tego narzędzia w Twoim przypadku użycia” – mówi. „Możesz poprosić o wersję demonstracyjną produktu lub wypróbować go wraz z innymi narzędziami oferującymi tę samą funkcjonalność”.

Witryny takie jak Capterra umożliwiają szybkie porównanie wielu platform AI.

A kiedy już znajdziesz odpowiedni stos narzędzi AI, użyj go, aby wspomóc proces, a nie go przejąć. „Nie bój się używać narzędzi sztucznej inteligencji do usprawnienia przepływu pracy, ale używaj ich tylko do tego celu” — mówi Abbene. „Rozpocznij każdą treść od pierwszych zasad, z wysokiej jakości badaniem słów kluczowych i zrozumieniem intencji wyszukiwania”.

Ryzyko nr 4: jednorodna treść

Sztuczna inteligencja może napisać cały esej w około 10 sekund. Ale tak imponująca, jak stała się generatywna sztuczna inteligencja, brakuje jej niuansów, aby być naprawdę kreatywnym, przez co jej wyniki często wydają się, cóż, robotyczne.

„Chociaż sztuczna inteligencja jest świetna w tworzeniu treści informacyjnych, często brakuje jej kreatywnego talentu i zaangażowania, które ludzie wnoszą do stołu” — mówi Weaver.

Sztuczna inteligencja jest stworzona do naśladowania

Poproś generatywnego bota piszącego AI, aby napisał raport z twojej książki, a z łatwością wymyśli 500 słów, które kompetentnie wyjaśniają główny temat Buszującego w zbożu (zakładając, że nie ma halucynacji Holdena Caulfielda jako rabusia bankowego).

Może to zrobić, ponieważ pochłonął tysiące tekstów o arcydziele JD Salingera.

Teraz poproś swojego kumpla AI, aby napisał post na blogu, który wyjaśnia rdzeń koncepcji Twojej firmy w sposób, który zawiera w sobie Twoją markę, odbiorców i propozycję wartości. Możesz być rozczarowany. „Treści generowane przez sztuczną inteligencję nie zawsze uwzględniają niuanse osobowości i wartości marki i mogą tworzyć treści, które mijają się z celem”, mówi Weaver.

Innymi słowy, sztuczna inteligencja świetnie radzi sobie z trawieniem, łączeniem i rekonfiguracją tego, co już zostało stworzone. Tworzenie czegoś, co wyróżnia się na tle istniejących treści, nie jest dobre.

Narzędzia generatywnej sztucznej inteligencji również nie są dobre w tworzeniu angażujących treści. Z radością wyprodukują ogromne bloki słów bez obrazu, wykresu lub wypunktowania, aby dać odpocząć zmęczonym oczom. Nie będą wyciągać historii klientów ani hipotetycznych przykładów, aby uczynić punkt bardziej wiarygodnym. Trudno byłoby im połączyć wiadomości z Twojej branży z korzyścią, jaką zapewnia Twój produkt.

Jak uniknąć homogenicznej treści

Niektóre narzędzia sztucznej inteligencji, takie jak Writer, mają wbudowane funkcje pomagające pisarzom zachować spójną osobowość marki. Ale nadal będziesz potrzebować redaktora, który „przejrzy i zredaguje treść pod kątem głosu i tonu marki, aby upewnić się, że rezonuje ona z odbiorcami i wzmacnia przekaz i cele organizacji” — radzi Weaver.

Redaktorzy i autorzy mogą również zobaczyć artykuł tak, jak inni ludzie. Jeśli istnieje nieprzenikniony blok słów, będą tymi, którzy go rozbiją i dodadzą trochę wizualnego zhuzh.

Wykorzystaj zawartość AI jako punkt wyjścia — jako sposób na rozpoczęcie kreatywności i badań. Ale zawsze dodaj swój osobisty akcent.

Ryzyko nr 5: Utrata SEO

Stanowisko Google w sprawie treści AI było nieco mętne. Początkowo wydawało się, że wyszukiwarka będzie karać posty napisane za pomocą sztucznej inteligencji.

[Obraz: tweet od Johna Muellera na AI]

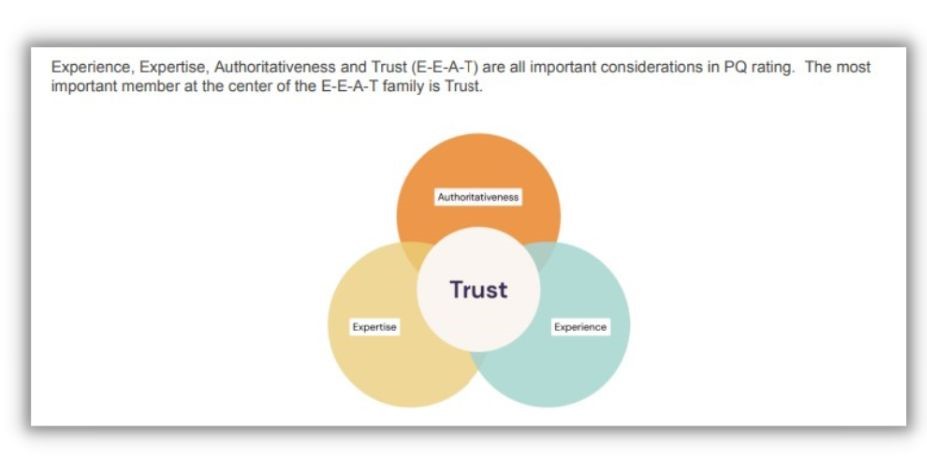

Niedawno blog programistów Google powiedział, że AI jest w porządku w ich książce. Ale z tym potwierdzeniem jest znaczące mrugnięcie. Tylko „treści, które demonstrują cechy tego, co nazywamy EEAT: wiedzę fachową, doświadczenie, autorytatywność i wiarygodność” zrobią wrażenie na osobach oceniających wyszukiwanie, które stale oceniają systemy rankingowe Google.

Zaufanie jest sprzęgłem dla SEO

Wśród EEAT firmy Google jedynym czynnikiem, który rządzi nimi wszystkimi, jest zaufanie.

[źródło]

Omówiliśmy już, że treści AI są podatne na błędy, przez co z natury nie są godne zaufania bez nadzoru człowieka. Nie spełnia również wymagań pomocniczych, ponieważ z natury nie jest napisany przez kogoś, kto ma wiedzę, autorytet lub doświadczenie w tym temacie.

Zrób post na blogu o pieczeniu chleba bananowego. Bot AI poda ci przepis w ciągu około dwóch sekund. Ale nie może woskować poezji w chłodne zimowe dni spędzane na pieczeniu dla swojej rodziny. Lub porozmawiaj o latach spędzonych na eksperymentowaniu z różnymi rodzajami mąki jako piekarz komercyjny. Te perspektywy są tym, czego szukają osoby oceniające wyszukiwanie w Google.

Wydaje się również, że ludzie też tego pragną. Dlatego tak wielu z nich zwraca się do prawdziwych ludzi na filmach TikTok, aby dowiedzieć się rzeczy, które kiedyś znajdowali w Google.

Jak uniknąć utraty SEO

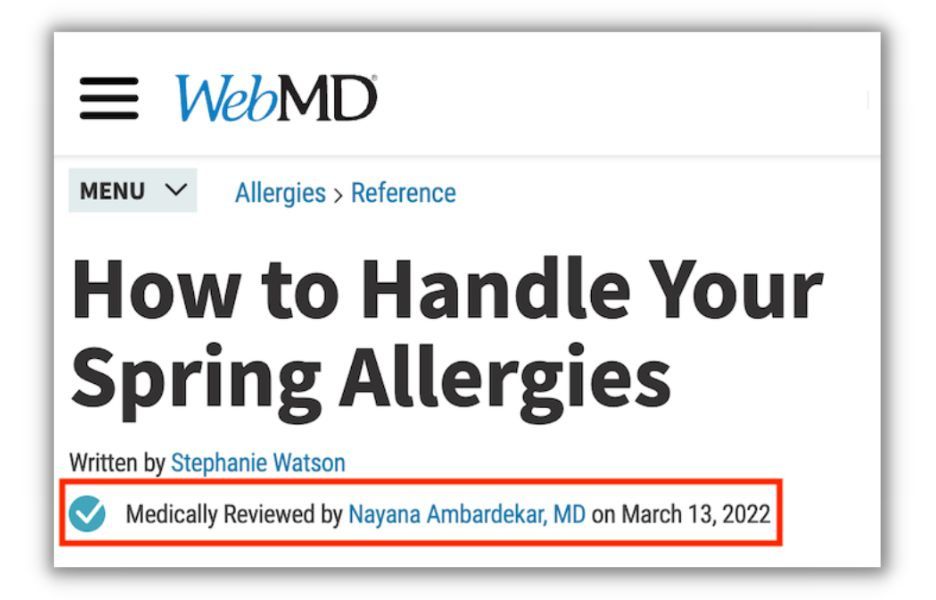

Wspaniałą rzeczą w sztucznej inteligencji jest to, że nie ma nic przeciwko udostępnianiu wierszy. Kiedy więc używasz chatbota do przyspieszenia tworzenia treści, upewnij się, że odwołujesz się do autora-człowieka z poświadczeniami.

Jest to szczególnie prawdziwe w przypadku drażliwych tematów, takich jak opieka zdrowotna i finanse osobiste, które Google nazywa tematami Twoje pieniądze, Twoje życie. „Jeśli działasz w branży YMYL, w swoich treściach traktuj priorytetowo autorytet, zaufanie i dokładność”, radzi Elisa Gabbert, dyrektor ds. treści i SEO w WordStream i LocaliQ.

Na przykład pisząc o opiece zdrowotnej, poproś o sprawdzenie swoich postów przez lekarza i odnieś się do nich w poście. To silny sygnał dla Google, że Twoje treści są godne zaufania, nawet jeśli zostały uruchomione w chatbocie.

Ryzyko nr 6: wyzwania prawne

Generatywna sztuczna inteligencja uczy się na podstawie pracy stworzonej przez ludzi, a następnie tworzy coś nowego (ish). Kwestia praw autorskich jest niejasna zarówno w przypadku danych wejściowych, jak i wyjściowych modelu treści AI.

Istniejąca praca jest prawdopodobnie uczciwą grą dla AI

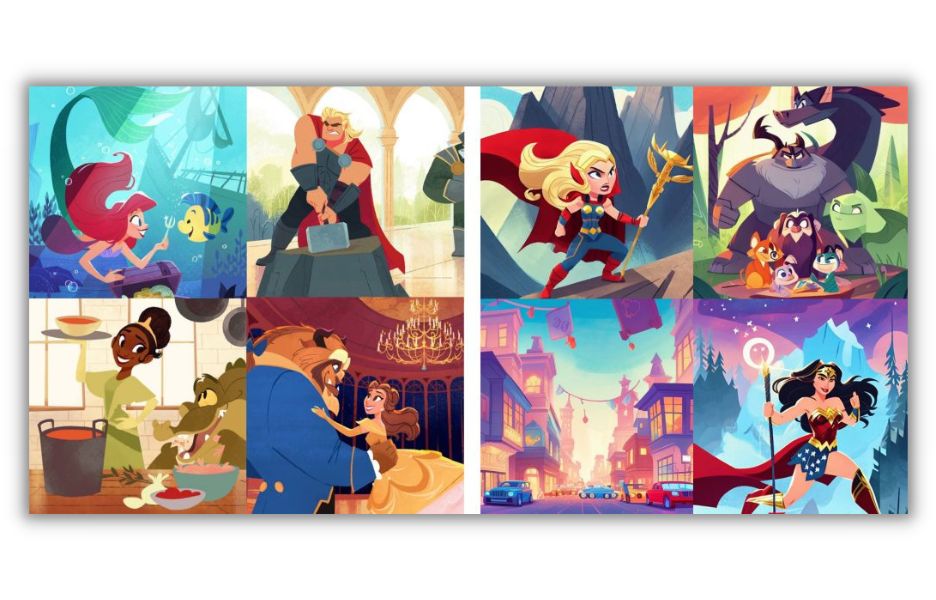

Aby zilustrować (zamierzona gra słów) kwestię praw autorskich w przypadku prac, które zasilają duże modele uczenia się, zwracamy się do przypadku zgłoszonego przez technologa Andy'ego Baio. Jak wyjaśnia Baio, artystka z Los Angeles, Hollie Mengert, dowiedziała się, że 32 jej ilustracje zostały wchłonięte przez model sztucznej inteligencji, a następnie udostępnione na otwartej licencji każdemu, kto chciał odtworzyć jej styl.

Podpis: zbiór ilustracji artystki Hollie Mengert (po lewej) w porównaniu z ilustracjami wygenerowanymi przez sztuczną inteligencję na podstawie jej stylu, których kuratorem jest Andy Baio .

Historia komplikuje się, gdy dowiadujesz się, że stworzyła wiele swoich obrazów dla klientów takich jak Disney, którzy faktycznie posiadają do nich prawa.

Czy ilustratorzy (lub pisarze lub programiści), którzy znajdują się w tym samym miejscu co Mengert, mogą skutecznie pozwać o naruszenie praw autorskich?

Nie ma jeszcze jasnej odpowiedzi na pytanie. „Widzę ludzi po obu stronach niezwykle pewnych siebie na swoich stanowiskach, ale rzeczywistość jest taka, że nikt nie wie” – powiedział Baio The Verge. „A każdy, kto twierdzi, że wie z całą pewnością, jak to rozegra się w sądzie, jest w błędzie”.

Jeśli sztuczna inteligencja, której używasz do tworzenia obrazu lub artykułu, została przeszkolona na tysiącach dzieł wielu twórców, prawdopodobnie nie przegrasz sprawy sądowej. Ale jeśli nakarmisz maszynę dziesięcioma książkami Stephena Kinga i każesz botowi napisać nową w tym stylu, możesz mieć kłopoty.

Zastrzeżenie: Nie jesteśmy prawnikami, więc jeśli nie masz pewności, zasięgnij porady prawnej.

Twoja zawartość AI może również nie być chroniona

A co z treściami, które tworzysz za pomocą chatbota, czy są one objęte prawami autorskimi? W większości przypadków nie, chyba że wykonałeś znaczną pracę, aby go edytować. Co oznacza, że nie będziesz miał możliwości odwołania się, jeśli ktoś zmieni przeznaczenie (czytaj: ukradnie) Twoje posty na własny blog.

W przypadku chronionych treści to programista sztucznej inteligencji, a nie Ty, może posiadać prawa. W wielu krajach twórcą narzędzia, które stworzyło dzieło, jest jego twórca, a nie osoba, która wpisała monit.

Jak uniknąć wyzwań prawnych

Zacznij od korzystania z renomowanego narzędzia do tworzenia treści AI. Znajdź taki, który ma wiele pozytywnych recenzji wydanych przez firmę, która jasno określa swoje stanowisko w sprawie praw autorskich.

Kieruj się też zdrowym rozsądkiem, aby zdecydować, czy celowo kopiujesz dzieło twórcy, czy po prostu używasz sztucznej inteligencji do ulepszania własnego.

A jeśli chcesz mieć szansę na walkę w sądzie, aby chronić to, co produkujesz, wprowadź wiele istotnych zmian. Lub użyj sztucznej inteligencji do stworzenia konspektu, ale większość słów napisz samodzielnie.

Ryzyko nr 7: naruszenia bezpieczeństwa i prywatności

Narzędzia sztucznej inteligencji przedstawiają marketerom szeroki zakres potencjalnych zagrożeń dla bezpieczeństwa ich systemów i prywatności danych. Niektóre z nich to bezpośrednie ataki złośliwych aktorów. Inni to po prostu użytkownicy, którzy nieświadomie przekazują poufne informacje systemowi zaprojektowanemu do ich udostępniania.

Zagrożenia bezpieczeństwa związane z narzędziami sztucznej inteligencji

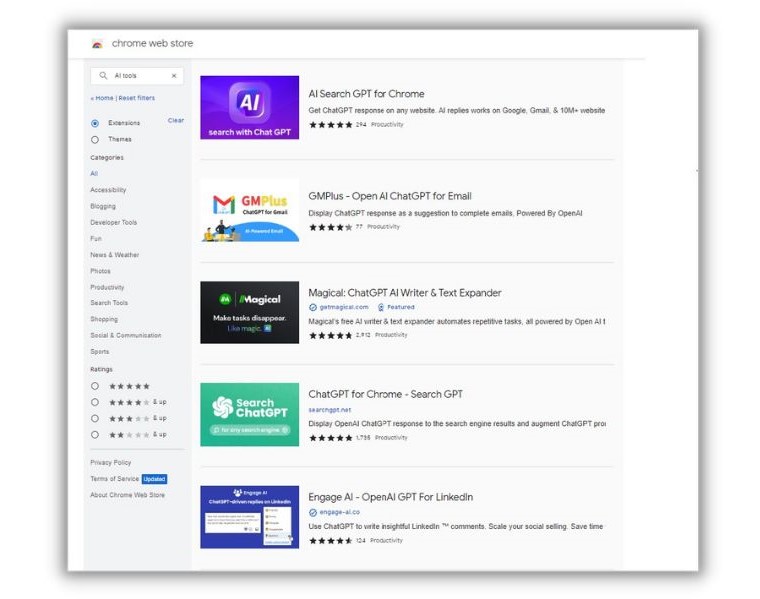

„Istnieje wiele produktów, które wyglądają, działają i zachowują się jak legalne narzędzia, ale w rzeczywistości są złośliwym oprogramowaniem” — powiedziała Elaine Atwell, starszy redaktor ds. marketingu treści w firmie Kolide, dostawcy zabezpieczeń punktów końcowych. „Niezwykle trudno je odróżnić od legalnych narzędzi, a teraz można je znaleźć w sklepie Chrome”.

Wpisz dowolną wersję „Narzędzi AI” w sklepie Google Chrome, a znajdziesz mnóstwo opcji.

Atwell napisał o tych zagrożeniach na blogu Kolide. W swoim artykule odniosła się do incydentu, w którym rozszerzenie Chrome o nazwie „Szybki dostęp do czatu GPT” było w rzeczywistości podstępem. Po pobraniu oprogramowanie przejmowało konta użytkowników na Facebooku i usuwało wszystkie pliki cookie ofiary — nawet te ze względów bezpieczeństwa. Ponad 2000 osób pobierało rozszerzenie każdego dnia, poinformował Atwell.

Prywatność niezabezpieczona

Atwell twierdzi, że nawet legalne narzędzie AI może stanowić zagrożenie dla bezpieczeństwa. „…w tej chwili większość firm nie ma nawet zasad oceny rodzajów i poziomów ryzyka, jakie stwarzają różne rozszerzenia. A wobec braku jasnych wskazówek ludzie na całym świecie instalują tych małych pomocników i dostarczają im poufnych danych”.

Załóżmy, że piszesz wewnętrzny raport finansowy, który chcesz udostępnić inwestorom. Pamiętaj, że sieci sztucznej inteligencji uczą się na podstawie tego, co otrzymują, aby generować dane wyjściowe dla innych użytkowników. Wszystkie dane, które umieszczasz w chatbocie AI, mogą być uczciwą grą dla osób spoza Twojej firmy. I może wyskoczyć, jeśli konkurent zapyta o Twoje wyniki finansowe.

Jak uniknąć zagrożeń związanych z prywatnością i bezpieczeństwem

Pierwszą linią obrony jest upewnienie się, że oprogramowanie jest tym, za co się podaje. Poza tym bądź ostrożny w korzystaniu z wybranych przez siebie narzędzi. „Jeśli zamierzasz korzystać z narzędzi sztucznej inteligencji (a one mają zastosowania!), nie podawaj im żadnych danych, które można by uznać za wrażliwe” — mówi Atwell.

Ponadto, podczas przeglądania narzędzi AI pod kątem użyteczności i stronniczości, zapytaj o ich politykę prywatności i bezpieczeństwa.

Ogranicz ryzyko związane z wykorzystaniem sztucznej inteligencji do celów marketingowych

Sztuczna inteligencja rozwija się w niesamowitym tempie. W niecały rok Chat GTP odnotował już znaczny wzrost swoich możliwości. Nie można przewidzieć, co będziemy w stanie zrobić ze sztuczną inteligencją nawet w ciągu najbliższych sześciu do dwunastu miesięcy. Nie możemy też przewidzieć potencjalnych problemów.

Oto kilka sposobów na poprawę wyników marketingu AI przy jednoczesnym uniknięciu niektórych z najczęstszych zagrożeń:

- Poproś redaktorów o sprawdzenie treści pod kątem jakości, czytelności i wizerunku marki

- Przeanalizuj każde używane narzędzie pod kątem bezpieczeństwa i możliwości

- Regularnie sprawdzaj kierowanie reklam kierowane przez sztuczną inteligencję pod kątem stronniczości

- Oceń kopię i obrazy pod kątem potencjalnego naruszenia praw autorskich

Chcielibyśmy podziękować Elain Attwell, Brettowi McHale, Nickowi Abenne i Alaura Weaver za wkład w ten post.

Podsumowując, przejrzyjmy naszą listę zagrożeń związanych z wykorzystaniem sztucznej inteligencji w marketingu:

- Błąd uczenia maszynowego

- Błędy merytoryczne

- Niewłaściwe zastosowanie narzędzi AI

- Jednorodna zawartość

- Utrata SEO

- Wyzwania prawne

- Naruszenia bezpieczeństwa i prywatności