Ética da IA: como os profissionais de marketing devem adotar a inovação com responsabilidade

Publicados: 2023-08-21A inteligência artificial (IA) não é apenas um fenómeno de ficção científica que se tornou realidade – é um pilar tecnológico, desenvolvido ao longo de décadas mesmo debaixo dos nossos narizes. A IA concretizou sonhos de maior eficiência, com muitas marcas já aproveitando o marketing de IA nos últimos anos.

Embora tenha despertado entusiasmo e entusiasmo, existem preocupações em torno da ética da IA. Como muitas inovações, a visão da indústria tecnológica para o metaverso tinha semelhanças assustadoras com mídias como Black Mirror e Snow Crash . E com obras como Parábola do Semeador, a Máquina e Eu, Robô dentro do zeitgeist cultural, é compreensível que fãs de ficção científica, investigadores e tecnólogos alertem para os perigos de ignorar a ética da IA.

Neste artigo definiremos o que é a ética da IA, por que as marcas devem se preocupar e as principais questões éticas enfrentadas pelos profissionais de marketing, incluindo segurança no emprego, desinformação e preconceito algorítmico. Também compartilharemos cinco etapas para ajudá-lo a manter práticas éticas de IA nas equipes e em toda a organização.

O que são éticas de IA?

A ética da IA é um sistema de princípios morais e práticas profissionais usados para informar de forma responsável o desenvolvimento e os resultados da tecnologia de inteligência artificial. Refere-se também ao estudo de como otimizar o impacto e reduzir os riscos e/ou consequências da IA.

As principais empresas tecnológicas, entidades governamentais como as Nações Unidas e comunidades de investigação e ciência de dados têm trabalhado para moldar e publicar diretrizes para abordar questões éticas. Por exemplo, a Organização das Nações Unidas para a Educação, a Ciência e a Cultura (UNESCO) publicou a primeira norma global sobre ética na IA em novembro de 2021: A Recomendação sobre a Ética da Inteligência Artificial.

Existem algumas regulamentações sobre IA em vigor nos níveis nacional e local, mas à medida que a IA e outras tecnologias emergentes crescem, as empresas devem esperar mais regulamentação governamental. À medida que a IA se integra cada vez mais nas nossas vidas, a ética da IA torna-se uma parte crítica da literacia digital.

Por que a ética da IA é importante

As empresas já investem em IA, mas a dificuldade é garantir o uso responsável.

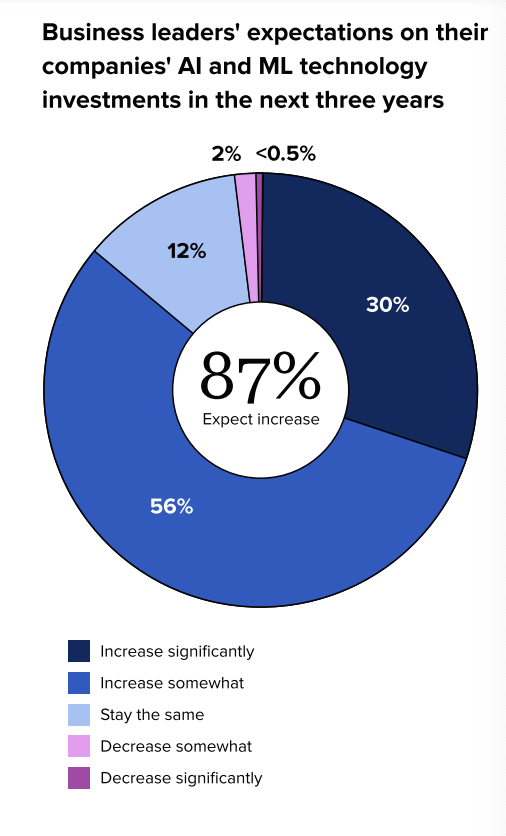

De acordo com o relatório The 2023 State of Social Media: AI and Data Take Center Stage, os líderes empresariais esperam maiores investimentos em IA nos próximos anos. Nosso relatório também descobriu que 98% dos líderes empresariais concordam que as empresas precisam compreender melhor o potencial da IA e da tecnologia de aprendizado de máquina (ML) para o sucesso a longo prazo.

Embora a IA possa melhorar o desempenho, aumentar a eficiência e gerar resultados comerciais positivos, as marcas também estão a sofrer consequências imprevistas da sua aplicação. Isso pode resultar da falta de pesquisas ou de conjuntos de dados tendenciosos, entre outros motivos. O uso indevido da IA ou a negligência de preocupações éticas podem resultar em danos à reputação da marca, falhas de produtos, litígios e questões regulatórias.

O primeiro passo para manter os padrões éticos entre as equipes da sua organização começa com a compreensão dos problemas que os profissionais de marketing enfrentam, para que você possa definir um plano para mitigar esses riscos de negócios e proteger sua marca.

Quais questões éticas de IA são as mais lembradas pelos profissionais de marketing

Há uma variedade de preocupações éticas sobre IA na indústria de tecnologia, incluindo, entre outras, as seguintes:

- Geração de conteúdo falso

- explicabilidade

- Impacto social

- Uso indevido de tecnologia

- Viés

- Responsabilidade e privacidade dos dados

- imparcialidade

- Robustez

- Transparência

- Sustentabilidade ambiental

- Diversidade e Inclusão

- Agência moral e alinhamento de valores

- Confiança e responsabilidade

Alguns acreditam que a IA pode ajudar a construir tecnologias, sistemas e serviços mais inclusivos que possam atender a diversas populações. A chave é estabelecer estruturas éticas, regulamentos e mecanismos para garantir o uso responsável.

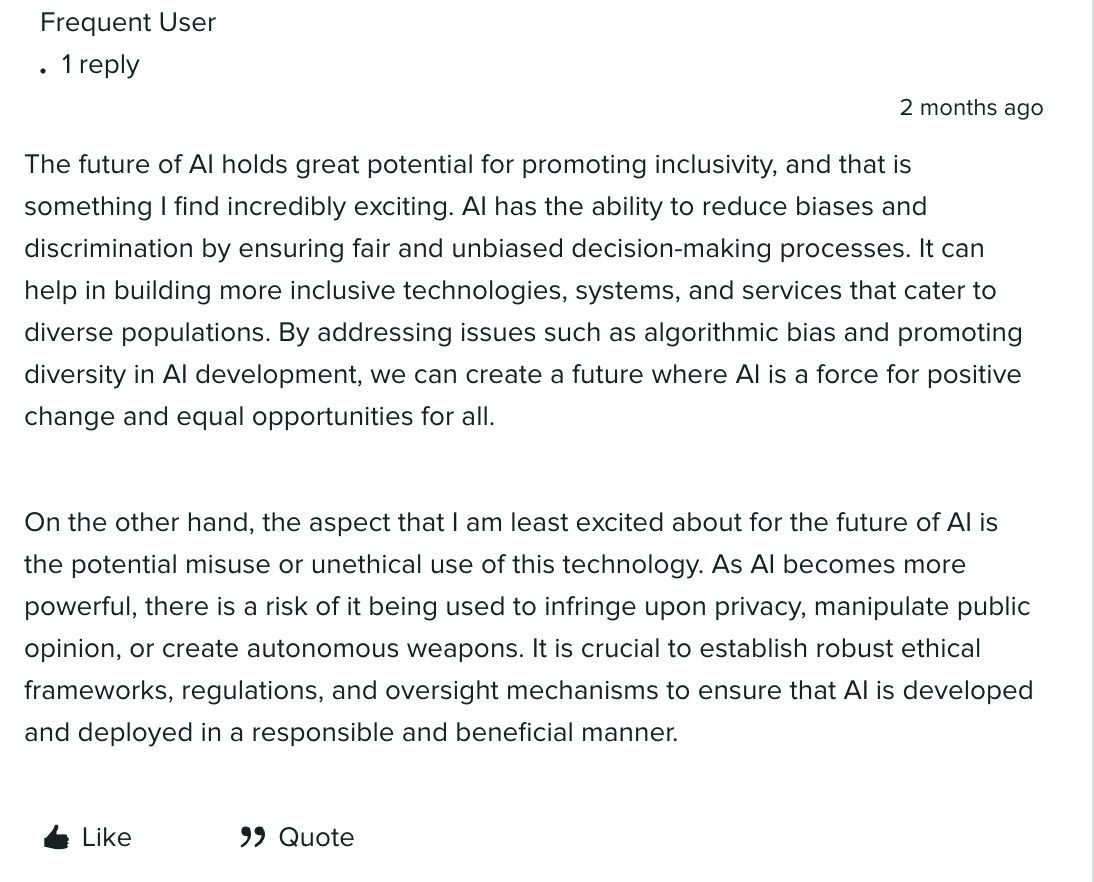

Um membro do Arboretum, fórum da comunidade do Sprout, observou que a IA tem o potencial de promover a inclusão e reduzir preconceitos/discriminação, garantindo processos de tomada de decisão justos e imparciais. Ao abordar questões como o preconceito algorítmico no desenvolvimento da IA, seria possível moldar um futuro onde a IA seja uma força positiva de mudança.

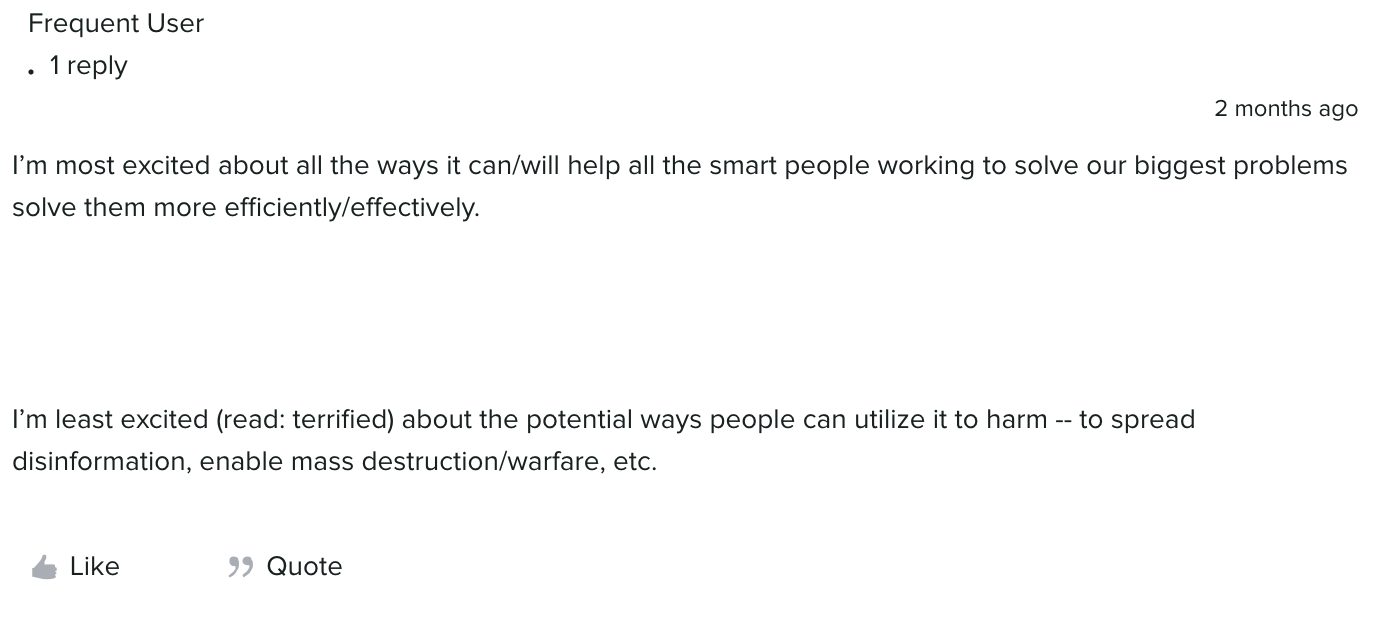

Juntamente com o potencial de mudança positiva, também há oportunidades para uso indevido ou antiético da IA à medida que ela se torna mais poderosa. Nossa comunidade discutiu vários riscos, incluindo violação de privacidade, manipulação da opinião pública e armas autônomas.

Comentários como esses apenas arranham a superfície das preocupações éticas em todos os setores, mas as principais questões para os profissionais de marketing incluem: segurança no emprego, privacidade, preconceito e discriminação, desinformação e desinformação e questões de propriedade intelectual/direitos autorais, que abordaremos detalhadamente no próxima seção.

Impacto nos empregos e no deslocamento de empregos

Robôs garantindo a dominação mundial é a menor das nossas preocupações – pelo menos por enquanto.

E isso porque pesquisadores e especialistas não se sentem ameaçados pela singularidade da tecnologia ou pela ideia de que a IA superará a inteligência humana e replicará características como habilidades sociais. Eles estão cientes das limitações da IA e das possíveis ramificações da substituição de empregos.

O objetivo de pesquisar e investir em IA não é substituir os humanos, mas nos ajudar a economizar tempo e esforço para fazer coisas mais impactantes. O diretor de mídias sociais e parcerias da Flock Freight, Bob Wolfley, compartilhou uma ótima analogia para a IA: “A IA é como a máquina de lavar louça ou roupa em nossas casas. Pense em todo o tempo que você economiza não lavando pratos ou roupas à mão.”

Em nossa série Unread, os membros da equipe criativa e de marketing do Sprout discutiram como eles usam IA atualmente, desde compras personalizadas até o uso de recursos como o ViralPost para ajudar a agendar postagens sociais. Assista ao vídeo abaixo para ouvir suas opiniões sobre os benefícios e os medos da IA, incluindo a substituição de empregos:

Preocupações com a privacidade

As preocupações em torno da privacidade, proteção e segurança dos dados são as principais preocupações das marcas. Os investimentos em segurança são uma prioridade cada vez maior para as empresas, pois buscam evitar oportunidades de vigilância, hacking e ataques cibernéticos. À medida que a personalização se torna mais popular, as marcas estão implementando as melhores práticas para coletar, armazenar e analisar dados para proteger clientes e organizações.

Viés algorítmico e discriminação

Como aprende com os dados, uma IA mal construída ou treinada pode demonstrar viés contra subconjuntos de dados sub-representados. Houve vários grandes casos de viés com arte gerada por IA, chatbots, software de reconhecimento facial, algoritmos e ferramentas de IA para práticas de contratação.

Por exemplo, vários usuários do TikTok e do Twitter [renomeado para X em julho de 2023] lançaram um tópico com “#SouthSudan Barbie” adornado com armas, um estereótipo negativo associado a uma região que luta com questões sociopolíticas, como genocídio e crises de refugiados .

![Uma resposta do usuário a uma foto gerada por IA de "#SouthSudan Barbie" em um tópico do Twitter [renomeado para X em julho de 2023]. A postagem diz: “Continuamos dizendo a vocês que o viés está embutido nesse lixo gerado por IA”.](/uploads/article/221435/S1hZxuJ0KyrnC8ur.png)

Com o viés entrando em apostas ainda mais baixas, a IA usa casos como esse, a questão é como trabalhar contra o viés e a discriminação quando os conjuntos de dados de treinamento podem se prestar ao viés?

Desinformação e desinformação

Tal como os humanos, a IA não é perfeita. As respostas da IA às solicitações podem ser imprecisas e há temores de que as pessoas espalhem informações incorretas com intenção maliciosa. Juntamente com as ameaças de desinformação, há potencial para crises de marca e danos à reputação, especialmente sem as proteções e protocolos apropriados em vigor.

Propriedade intelectual e questões de direitos autorais

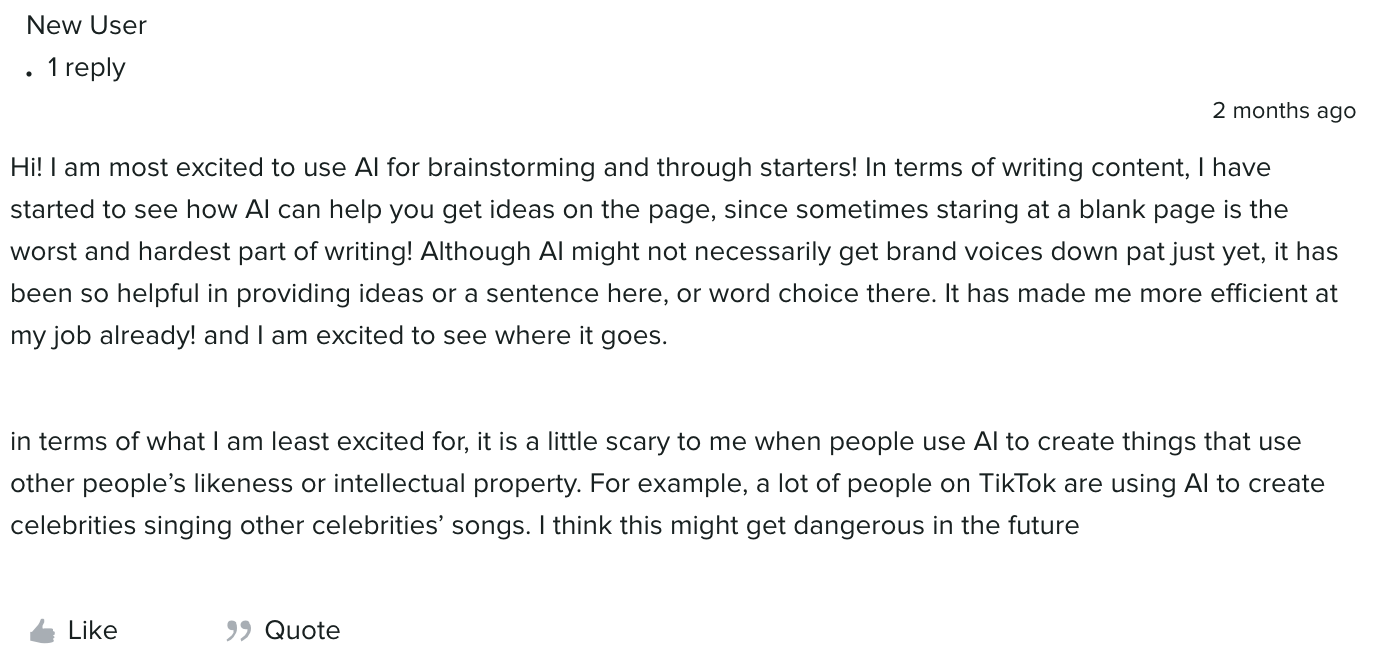

Você provavelmente já viu o elenco de Harry Potter como personagens em um filme de Wes Anderson ou os cidadãos da Fenda do Biquíni cantando interpretações de canções populares. Esses são exemplos de quantos estão usando IA para usar a imagem e semelhança das pessoas ou propriedade intelectual.

A IA é um excelente sparring para tarefas criativas, como brainstorming e criação de esboços, mas, dependendo de como os resultados são usados, pode levar à violação de direitos autorais, plágio e violações de propriedade intelectual. Por exemplo, um grupo de artistas entrou com uma ação contra Midjourney e Stability AI em janeiro de 2023, alegando que as ferramentas violavam os direitos de milhões de artistas. A IA generativa abre uma lata de vermes legal e ainda há muito terreno a cobrir, mas a criação de regras e estruturas proativas ajudará a mitigar os riscos éticos.

5 etapas para manter a ética da IA nas equipes

Aqui estão cinco etapas para ajudar a orientar seu plano para mitigar os riscos éticos da IA:

1. Definir regras básicas internas e responsabilidades para o uso de IA

Considere estabelecer uma equipe de ética em IA composta por especialistas em ética, especialistas jurídicos, tecnólogos e líderes para ajudar a estabelecer regras básicas para sua organização. Por exemplo, usar IA generativa apenas para rascunhos e brainstorming, mas não para conteúdo publicado externamente, é uma regra básica excelente.

Juntamente com estas regras básicas, defina o papel e as responsabilidades de cada membro da equipe envolvido em IA, incluindo a equipe de ética. Defina também seus objetivos e valores para IA. Isso ajudará a estabelecer a base para sua política de ética e práticas recomendadas de IA.

2. Definir e auditar o papel da IA

A IA não pode substituir criadores de conteúdo, estrategistas de mídia social ou qualquer função no marketing. Identifique as tarefas de IA que exigem supervisão ou intervenção humana e identifique os objetivos da sua política de ética em IA para ajudar a criar processos de desenvolvimento, gerenciamento e comunicação sobre IA.

Depois de identificar os objetivos da sua política de ética, identifique lacunas e oportunidades para IA na sua organização. Considere as seguintes questões:

- Como a organização utiliza atualmente a IA e como queremos utilizá-la no futuro?

- Que software e análise podem nos ajudar a mitigar os riscos comerciais?

- Que lacunas a tecnologia e a análise criam? Como os preenchemos?

- Que testes ou experimentos precisamos realizar?

- Quais soluções existentes podemos usar com as melhores práticas atuais para nossas equipes de produto?

- Como você usará dados e insights?

- Como estabeleceremos o posicionamento da nossa marca e mensagens para tecnologias e ética de IA?

3. Desenvolva um processo hermético de avaliação de fornecedores

Faça parceria com suas equipes jurídica e de TI para examinar adequadamente quaisquer ferramentas com recursos de IA e estabelecer um processo de risco ético. A experiência deles o ajudará a avaliar novas considerações, como o conjunto de dados no qual uma ferramenta é treinada e os controles que os fornecedores implementam para mitigar o viés da IA. Um processo de due diligence para cada ferramenta antes do lançamento externo ou interno ajudará você a mitigar riscos futuros.

4. Mantenha a transparência com divulgações

Colabore com suas equipes jurídicas e/ou de privacidade para desenvolver mensagens externas e/ou isenções de responsabilidade para indicar onde e quando sua marca depende de IA. Essas mensagens podem ser usadas para conteúdo, atendimento ao cliente, etc. Por exemplo, o TikTok atualizou suas diretrizes da comunidade para exigir que os criadores rotulem o conteúdo gerado por IA. Comunicar seus padrões e estruturas éticas para defender a ética da IA ajudará a ganhar a confiança de colegas, clientes potenciais e clientes.

5. Continue a educação entre lideranças e equipes

A IA não é algo em que a liderança empresarial possa se apressar. Como qualquer nova onda de inovação emergente, haverá uma curva de aprendizagem, além de novos marcos tecnológicos. Ajude a nivelar o campo de atuação organizando treinamentos e workshops internos para educar todos os membros da equipe, líderes e partes interessadas sobre a ética da IA e como construí-la de forma responsável.

Faça a coisa certa com a ética da IA

Considerar a ética não é apenas a coisa certa a fazer – é um componente crítico para alavancar a tecnologia de IA nos negócios.

Aprenda mais perspectivas de líderes e profissionais de marketing sobre como a IA impactará o futuro das redes sociais em nosso webinar, juntamente com outras descobertas do Relatório sobre o estado das mídias sociais de 2023 e dicas para a criação de conteúdo social impactante.