7 riscos sérios que você enfrenta ao usar IA para marketing

Publicados: 2023-07-06Alguns anos atrás, a maioria de nós, profissionais de marketing, não tinha a menor ideia de como usar a IA para marketing. De repente, estamos escrevendo postagens no LinkedIn sobre os melhores prompts para sussurrar no ouvido do ChatGPT.

Há muito o que comemorar sobre a súbita infusão de inteligência artificial em nosso trabalho. McKenzie calcula que a IA irá gerar US$ 2,6 trilhões em valor para os profissionais de marketing.

Mas nossa rápida adoção da IA pode estar se adiantando a questões éticas, legais e operacionais importantes – o que deixará os profissionais de marketing expostos a riscos sobre os quais nunca tivemos que pensar antes (ou seja, podemos ser processados por dizer à IA para “escrever como Stephen King? ”).

Há uma tonelada métrica de pó de IA na atmosfera de marketing que não se acomodará por anos. Não importa o quanto você aperte os olhos, você não descobrirá todas as possíveis armadilhas do uso de grandes modelos de linguagem e aprendizado de máquina para criar conteúdo e gerenciar anúncios.

Portanto, nosso objetivo neste artigo é ver sete dos riscos mais proeminentes do uso de IA para marketing de um ponto de vista muito elevado. Reunimos conselhos de especialistas para ajudar a mitigar esses riscos. E adicionamos muitos recursos para que você possa se aprofundar nas questões que mais o preocupam.

Risco nº 1: viés de aprendizado de máquina

Às vezes, os algoritmos de aprendizado de máquina fornecem resultados que são injustamente a favor ou contra alguém ou alguma coisa. É chamado de viés de aprendizado de máquina, ou viés de IA, e é um problema generalizado até mesmo com as redes neurais profundas mais avançadas.

É um problema de dados

Não é que as redes de IA sejam inerentemente fanáticas. É um problema com os dados que são alimentados neles.

Os algoritmos de aprendizado de máquina funcionam identificando padrões para calcular a probabilidade de um resultado, como se um determinado grupo de compradores gostará ou não do seu produto.

Mas e se os dados nos quais a IA treina forem distorcidos para uma determinada raça, gênero ou faixa etária? A IA chegará à conclusão de que essas pessoas são uma combinação melhor e distorcerá o criativo do anúncio ou o posicionamento de acordo.

edição de lavagem de viés pic.twitter.com/YQLRcq59lQ

— Janelle Shane (@JanelleCShane) 17 de junho de 2021

Aqui está um exemplo. Pesquisadores testaram recentemente o viés de gênero nos sistemas de segmentação de anúncios do Facebook. Os investigadores colocaram um anúncio para recrutar motoristas de entrega para a Pizza Hut e um anúncio semelhante com as mesmas qualificações para a Instacart.

O pool existente de motoristas da Pizza Hut é masculino, então o Facebook mostrou esses anúncios desproporcionalmente aos homens. A Instacart tem mais motoristas do sexo feminino, então os anúncios de seus empregos foram colocados na frente de mais mulheres. Mas não há nenhuma razão inerente para que as mulheres não queiram saber sobre os empregos da Pizza Hut, então isso é um grande passo em falso na segmentação de anúncios.

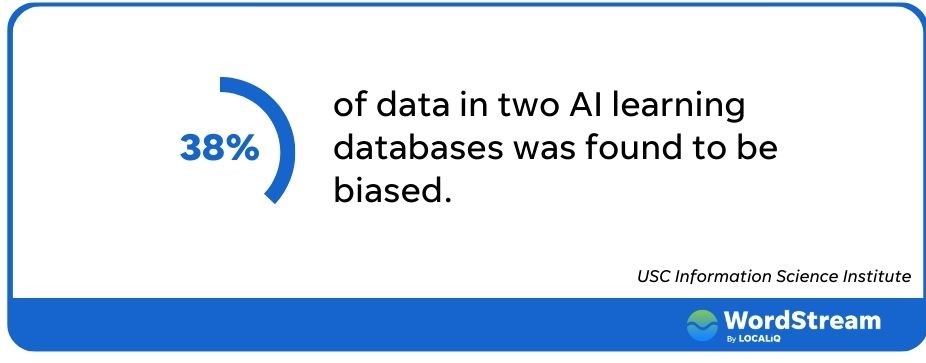

O viés de IA é comum

O problema se estende muito além do Facebook. Pesquisadores da USC analisaram dois grandes bancos de dados de IA e descobriram que mais de 38% dos dados neles eram tendenciosos. A documentação do ChatGPT até adverte que seu algoritmo pode associar “estereótipos negativos a mulheres negras”.

O viés de aprendizado de máquina apresenta várias implicações para os profissionais de marketing; a menor delas é o baixo desempenho do anúncio. Se você espera alcançar o maior número possível de clientes em potencial, uma plataforma de segmentação de anúncios que exclui grandes segmentos da população não é o ideal.

É claro que há ramificações maiores se nossos anúncios segmentarem ou excluirem determinados grupos de maneira injusta. Se o seu anúncio imobiliário discriminar minorias protegidas, você pode cair no lado errado da Fair Housing Act e da Federal Trade Commision. Sem falar na falta total do barco do marketing inclusivo.

Como evitar o viés da IA

Então, o que fazemos quando nossas ferramentas de IA ficam descontroladas? Há algumas etapas que você pode seguir para garantir que seus anúncios tratem todos de maneira igualitária.

Em primeiro lugar, certifique-se de que alguém revise seu conteúdo, escreve Alaura Weaver, gerente sênior de conteúdo e comunidade do Writer. “Embora a tecnologia de IA tenha avançado significativamente, ela carece do pensamento crítico e das habilidades de tomada de decisão que os humanos possuem”, explica ela. “Ao fazer com que editores humanos revisem e verifiquem o conteúdo escrito por IA, eles podem garantir que seja livre de preconceitos e siga os padrões éticos.”

A supervisão humana também reduzirá o risco de resultados negativos em campanhas de anúncios pagos.

“Atualmente, e talvez indefinidamente, não é aconselhável permitir que a IA assuma completamente as campanhas ou qualquer forma de marketing”, diz Brett McHale, fundador da Empiric Marketing. “A IA tem um desempenho ideal quando recebe informações precisas da inteligência orgânica que já acumulou grandes quantidades de dados e experiências.”

Risco nº 2: falácias factuais

O Google recentemente custou à sua controladora US$ 100 bilhões em avaliação quando seu novo chatbot de IA, Bard, deu uma resposta incorreta em um tweet promocional.

O Bard é um serviço experimental de IA de conversação, alimentado por LaMDA. Construído usando nossos grandes modelos de linguagem e com base em informações da web, é uma plataforma de lançamento para curiosidade e pode ajudar a simplificar tópicos complexos → https://t.co/fSp531xKy3 pic.twitter.com/JecHXVmt8l

— Google (@Google) 6 de fevereiro de 2023

A bobagem do Google destaca uma das maiores limitações da IA e um dos maiores riscos para os profissionais de marketing que a utilizam: a IA nem sempre diz a verdade.

IA alucina

Ethan Mollic, professor da Wharton School of Business, descreveu recentemente sistemas baseados em IA como o ChatGPT como um “estagiário onisciente e ansioso para agradar que às vezes mente”.

Claro, a IA não é senciente, apesar do que alguns possam alegar. Não pretende nos enganar. Pode, no entanto, sofrer de “alucinações” que o levam a apenas inventar coisas.

A IA é uma máquina de previsão. Ele parece preencher a próxima palavra ou frase que responderá à sua consulta. Mas não é autoconsciente; A IA não tem lógica de verificação instintiva para saber se o que está reunindo faz sentido.

Ao contrário do viés, isso não parece ser um problema de dados. Mesmo quando a rede tem todas as informações certas, ela ainda pode nos dizer a coisa errada.

Considere este exemplo em que um usuário perguntou ao ChatGPT “quantas vezes a Argentina venceu a copa do mundo da FIFA?” Dizia uma vez e fazia referência à vitória do time em 1978. O tweeter então perguntou qual time venceu em 1986.

Perguntou #ChatGPT sobre quem ganhou a copa do mundo da FIFA em 2022. Não soube responder. Isso é esperado. No entanto, parece fornecer informações erradas (sobre as outras 2 vitórias), embora as informações estejam no sistema. Alguma #Explicação? pic.twitter.com/fvxe05N12p

— indranil sinharoy (@indranil_leo) 29 de dezembro de 2022

O chatbot admitiu que era a Argentina sem nenhuma explicação para sua antiga gafe.

A parte preocupante é que as respostas errôneas da IA costumam ser escritas com tanta confiança que se misturam ao texto ao seu redor, fazendo com que pareçam completamente plausíveis. Eles também podem ser abrangentes, conforme detalhado em um processo movido contra a Open.ai, onde o ChatGPT supostamente inventou toda uma história de peculato que foi compartilhada por um jornalista.

Como evitar as alucinações da IA

Embora a IA possa desviá-lo até mesmo com respostas de uma única palavra, é mais provável que saia dos trilhos ao escrever textos mais longos.

“A partir de um único prompt, a IA pode gerar um blog ou um eBook. Sim, isso é incrível – mas há um porém,” adverte Weaver. “Quanto mais gerar, mais edição e verificação de fatos você terá que fazer.”

Para reduzir as chances de sua ferramenta de IA começar a girar narrativas alucinatórias, Weaver diz que é melhor criar um esboço e fazer com que o bot o lide com uma seção de cada vez. E então, é claro, peça a uma pessoa que revise os fatos e as estatísticas que ele adiciona.

Risco nº 3: aplicação incorreta de ferramentas de IA

Todas as manhãs, acordamos com uma nova safra de ferramentas de IA que aparentemente brotaram durante a noite como cogumelos após uma tempestade.

Mas nem toda plataforma é construída para todas as funções de marketing, e alguns desafios de marketing (ainda) não podem ser resolvidos pela IA.

As ferramentas de IA têm limitações

O ChatGPT é um ótimo exemplo. É divertido brincar com a beleza da bola de IA (como escrever como remover um sanduíche de manteiga de amendoim de um videocassete no estilo da Bíblia King James). E pode produzir algumas respostas curtas surpreendentemente bem escritas que acabam com o bloqueio do escritor. Mas não peça para ajudá-lo a fazer pesquisas de palavras-chave.

O ChatGPT falha devido ao seu conjunto de dados relativamente antigo, que inclui apenas informações anteriores a 2022. Peça a ele para oferecer palavras-chave para “marketing de IA” e suas respostas não combinarão com o que você encontra em outras ferramentas como Thinword ou Contextminds.

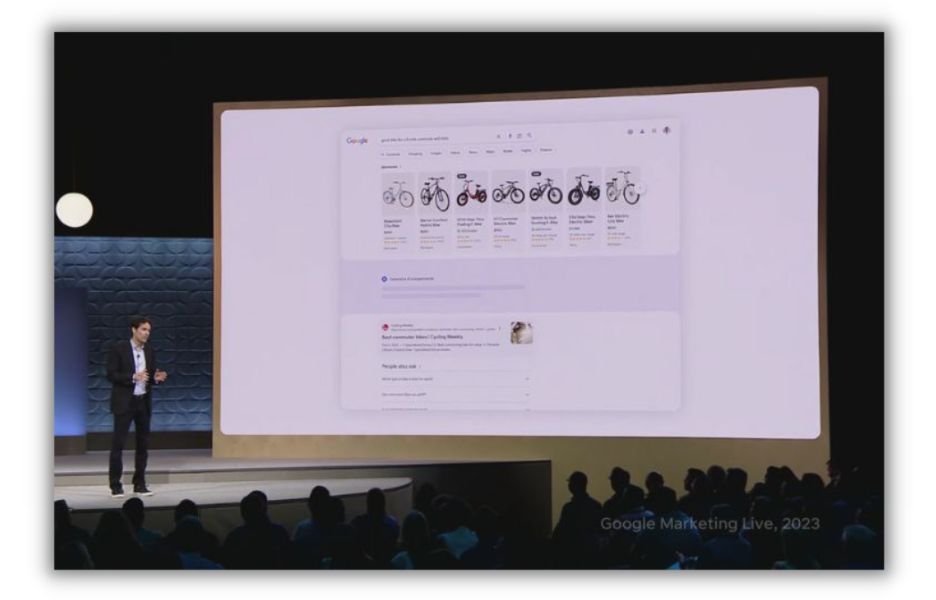

Da mesma forma, tanto o Google quanto o Facebook têm novas ferramentas com inteligência artificial para ajudar os profissionais de marketing a criar anúncios, otimizar gastos com anúncios e personalizar a experiência do anúncio. Um chatbot não pode resolver esses desafios.

O Google anunciou uma série de atualizações de IA para seus produtos de gerenciamento de pesquisa e anúncios no evento Google Marketing Live de 2023.

Você pode abusar da IA

Se você der uma tarefa singular a uma ferramenta de IA, ela poderá superindexar em apenas um objetivo. Nick Abbene, um especialista em automação de marketing, vê isso frequentemente com empresas focadas em melhorar seu SEO.

“O maior problema que vejo é usar ferramentas de SEO cegamente, otimizar demais para mecanismos de pesquisa e desconsiderar a intenção de pesquisa do cliente”, diz Abbene. “Ferramentas de SEO são ótimas para sinalizar aos mecanismos de busca conteúdo de qualidade. Mas, em última análise, o Google quer corresponder à pergunta do pesquisador.”

Como evitar a aplicação incorreta de ferramentas de IA

Uma chave inglesa não é a melhor opção para martelar pregos. Da mesma forma, um assistente de escrita AI pode não ser bom para criar páginas da web. Antes de apostar em qualquer opção de IA, Abbene diz para obter feedback do criador da ferramenta e de outros usuários.

“Para evitar a seleção incorreta de ferramentas de IA, entenda se outros profissionais de marketing estão usando a ferramenta para o seu caso de uso”, diz ele. “Sinta-se à vontade para solicitar uma demonstração do produto ou experimentá-lo junto com outras ferramentas que oferecem a mesma funcionalidade.”

Sites como o Capterra permitem que você compare rapidamente várias plataformas de IA.

E depois de encontrar a pilha de ferramentas de IA certa, use-a para auxiliar no processo, não assuma o controle. “Não tenha medo de usar ferramentas de IA para aumentar seu fluxo de trabalho, mas use-as apenas para isso”, diz Abbene. “Comece cada parte do conteúdo a partir dos primeiros princípios, com pesquisa de palavras-chave de qualidade e compreensão da intenção de pesquisa.”

Risco nº 4: conteúdo homogêneo

AI pode escrever um ensaio inteiro em cerca de 10 segundos. Mas, por mais impressionante que a IA generativa tenha se tornado, ela carece de nuances para ser verdadeiramente criativa, deixando sua produção muitas vezes parecendo, bem, robótica.

“Embora a IA seja ótima para produzir conteúdo informativo, muitas vezes falta o talento criativo e o envolvimento que os humanos trazem para a mesa”, diz Weaver.

IA é feita para imitar

Peça a um bot de escrita de IA generativo para escrever o relatório do seu livro e ele criará facilmente 500 palavras que explicam com competência o tema principal de O apanhador no campo de centeio (supondo que não alucine Holden Caulfield como um ladrão de banco).

Ele pode fazer isso porque absorveu milhares de textos sobre a obra-prima de JD Salinger.

Agora peça ao seu amigo de IA para escrever uma postagem de blog que explique um conceito básico para o seu negócio de uma forma que englobe sua marca, público e proposta de valor. Você pode ficar desapontado. “O conteúdo gerado por IA nem sempre leva em conta as nuances da personalidade e dos valores de uma marca e pode produzir conteúdo que erra o alvo”, diz Weaver.

Em outras palavras, a IA é ótima para digerir, combinar e reconfigurar o que já foi criado. Não é ótimo para criar algo que se destaca em relação ao conteúdo existente.

As ferramentas generativas de IA também não são boas para tornar o conteúdo atraente. Eles produzirão alegremente enormes blocos de palavras sem nenhuma imagem, gráfico ou marcador para dar um descanso aos olhos cansados. Eles não vão puxar histórias de clientes ou exemplos hipotéticos para tornar um ponto mais relacionável. E eles lutam para conectar uma notícia de sua indústria a um benefício que seu produto oferece.

Como evitar conteúdo homogêneo

Algumas ferramentas de IA, como o Writer, possuem recursos integrados para ajudar os escritores a manter uma personalidade de marca consistente. Mas você ainda precisará de um editor para “revisar e editar o conteúdo da voz e do tom da marca para garantir que ressoe com o público e reforce a mensagem e os objetivos da organização”, aconselha Weaver.

Editores e escritores também podem ver um artigo como outros humanos. Se houver um bloco impenetrável de palavras, serão eles que o quebrarão e adicionarão um pouco de zhuzh visual.

Use o conteúdo de IA como ponto de partida - como uma forma de ajudar a impulsionar sua criatividade e pesquisa. Mas sempre adicione seu próprio toque pessoal.

Risco nº 5: Perda de SEO

A posição do Google sobre o conteúdo de IA tem sido um pouco obscura. A princípio, parecia que o mecanismo de busca penalizaria postagens escritas com IA.

[Imagem: tweet de John Mueller sobre IA]

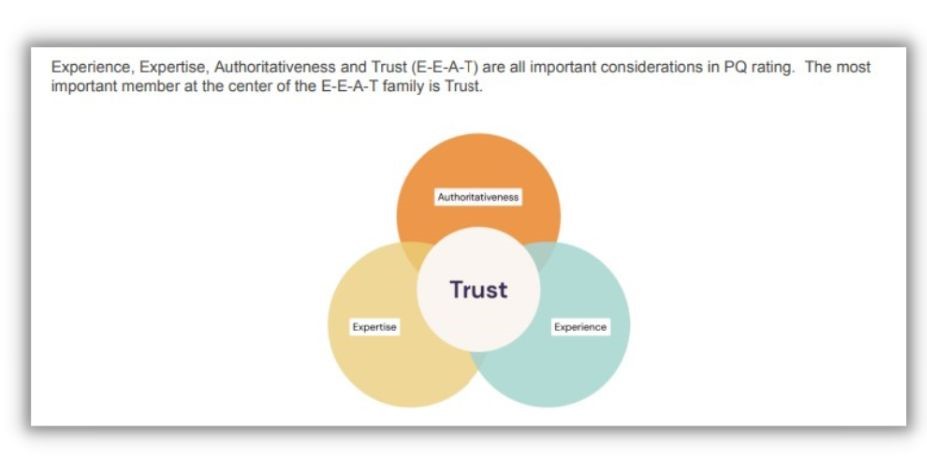

Mais recentemente, o blog do desenvolvedor do Google disse que a IA está OK em seu livro. Mas há uma piscadela significativa com essa confirmação. Somente “conteúdo que demonstre as qualidades do que chamamos de EEAT: especialidade, experiência, autoridade e confiabilidade” impressionará os avaliadores de pesquisa humana que avaliam continuamente os sistemas de classificação do Google.

Confiança é embreagem para SEO

Entre os EEAT do Google, o único fator que os governa é a confiança.

[fonte]

Já discutimos que o conteúdo de IA é propenso a falácias, tornando-o inerentemente não confiável sem supervisão humana. Ele também não atende aos requisitos de suporte porque, por natureza, não foi escrito por alguém com conhecimento, autoridade ou experiência no assunto.

Faça uma postagem no blog sobre assar pão de banana. Um bot AI lhe dará uma receita em cerca de dois segundos. Mas não pode ser poético nos dias frios de inverno passados assando para sua família. Ou fale sobre os anos que passou experimentando vários tipos de farinha como padeiro comercial. Essas perspectivas são o que os avaliadores de pesquisa do Google procuram.

Também parece ser o que as pessoas desejam também. É por isso que muitos deles estão recorrendo a pessoas reais nos vídeos do TikTok para aprender coisas que costumavam encontrar no Google.

Como evitar a perda de SEO

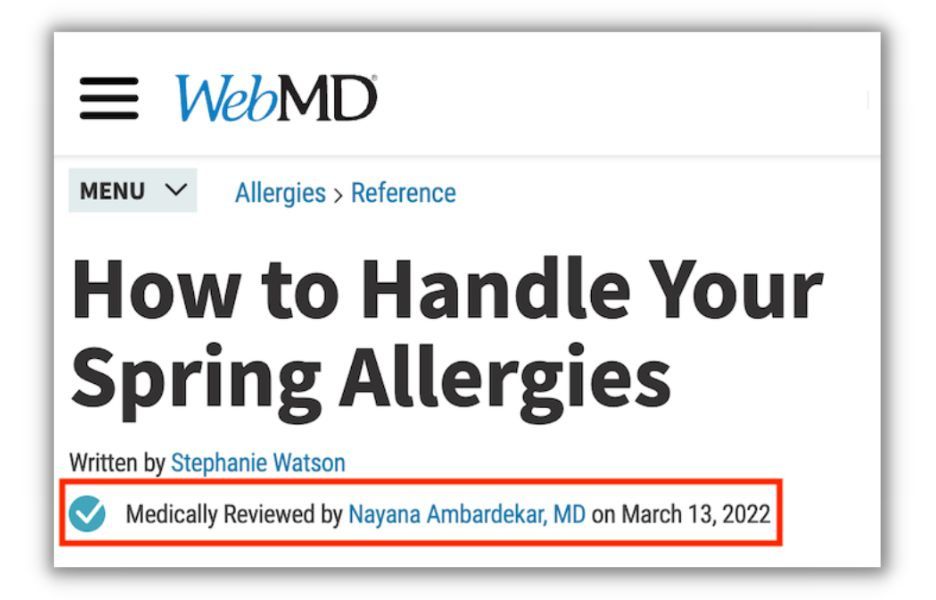

O melhor da IA é que ela não se importa em compartilhar assinaturas. Portanto, quando você usar um chatbot para acelerar a produção de conteúdo, certifique-se de fazer referência a um autor humano com credenciais.

Isso é especialmente verdadeiro para assuntos delicados, como saúde e finanças pessoais, que o Google chama de tópicos Your Money, Your Life. “Se você está em uma vertical YMYL, priorize autoridade, confiança e precisão acima de tudo em seu conteúdo”, aconselha Elisa Gabbert, Diretora de Conteúdo e SEO para WordStream e LocaliQ.

Ao escrever sobre saúde, por exemplo, faça com que suas postagens sejam revisadas por um profissional médico e faça referência a elas na postagem. Esse é um forte sinal para o Google de que seu conteúdo é confiável, mesmo que tenha sido iniciado em um chatbot.

Risco nº 6: Desafios legais

A IA generativa aprende com o trabalho criado por humanos e, em seguida, cria algo novo (ish). A questão dos direitos autorais não é clara tanto para a entrada quanto para a saída do modelo de conteúdo de IA.

O trabalho existente provavelmente é um jogo justo para a IA

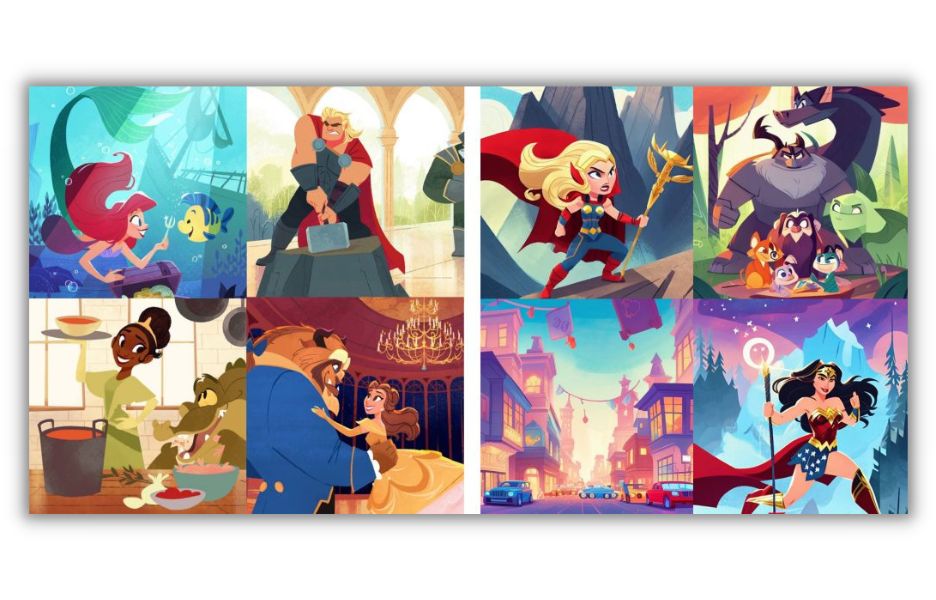

Para ilustrar (trocadilhos) a questão dos direitos autorais de obras que alimentam grandes modelos de aprendizagem, recorremos a um caso relatado pelo tecnólogo Andy Baio. Como explica Baio, uma artista de Los Angeles chamada Hollie Mengert descobriu que 32 de suas ilustrações foram absorvidas por um modelo de IA e depois oferecidas por meio de licença aberta a qualquer pessoa que quisesse recriar seu estilo.

Legenda: uma coleção de ilustrações da artista Hollie Mengert (à esquerda) em comparação com ilustrações geradas por IA com base em seu estilo, com curadoria de Andy Baio .

A história fica mais complicada quando você descobre que ela criou muitas de suas imagens para clientes como a Disney, que na verdade possuem os direitos sobre elas.

Os ilustradores (ou escritores ou codificadores) que se encontram no mesmo lugar que Mengert podem processar com sucesso por violação de direitos autorais?

Ainda não há uma resposta clara para a pergunta. “Vejo pessoas de ambos os lados extremamente confiantes em suas posições, mas a realidade é que ninguém sabe”, disse Baio ao The Verge. “E qualquer um que diga que sabe com certeza como isso vai se desenrolar no tribunal está errado.”

Se a IA que você usa para criar uma imagem ou artigo foi treinada em milhares de obras de muitos criadores, provavelmente você não perderá um processo judicial. Mas se você alimentar a máquina com dez livros de Stephen King e disser ao bot para escrever um novo nesse estilo, você pode ter problemas.

Isenção de responsabilidade: não somos advogados, portanto, obtenha aconselhamento jurídico se não tiver certeza.

Seu conteúdo de IA também pode não estar protegido

E o conteúdo que você cria usando um chatbot, ele é coberto por leis de direitos autorais? Na maioria das vezes, não é, a menos que você tenha feito um trabalho considerável para editá-lo. O que significa que você teria poucos recursos se alguém redirecionasse (leia-se: roubasse) suas postagens para o próprio blog.

Para o conteúdo protegido, pode ser o programador da IA, não você, que detém os direitos. Muitos países consideram o fabricante da ferramenta que produziu um trabalho como seu criador, não a pessoa que digitou o prompt.

Como evitar desafios legais

Comece usando uma ferramenta respeitável de criação de conteúdo de IA. Encontre um com muitas críticas positivas produzidas por uma empresa que aborda claramente sua posição sobre as leis de direitos autorais.

Além disso, use seu bom senso para decidir se está copiando intencionalmente o trabalho de um criador ou simplesmente usando IA para aprimorar o seu.

E se você quiser uma chance de lutar no tribunal para proteger o que produz, faça muitas mudanças substanciais. Ou use a IA para ajudar a criar um esboço, mas escreva a maioria das palavras você mesmo.

Risco nº 7: Violações de segurança e privacidade

As ferramentas de IA apresentam aos profissionais de marketing uma ampla gama de ameaças potenciais à segurança de seus sistemas e à privacidade dos dados. Alguns são ataques diretos de atores mal-intencionados. Outros são simplesmente usuários que fornecem involuntariamente informações confidenciais a um sistema projetado para compartilhá-las.

Riscos de segurança de ferramentas de IA

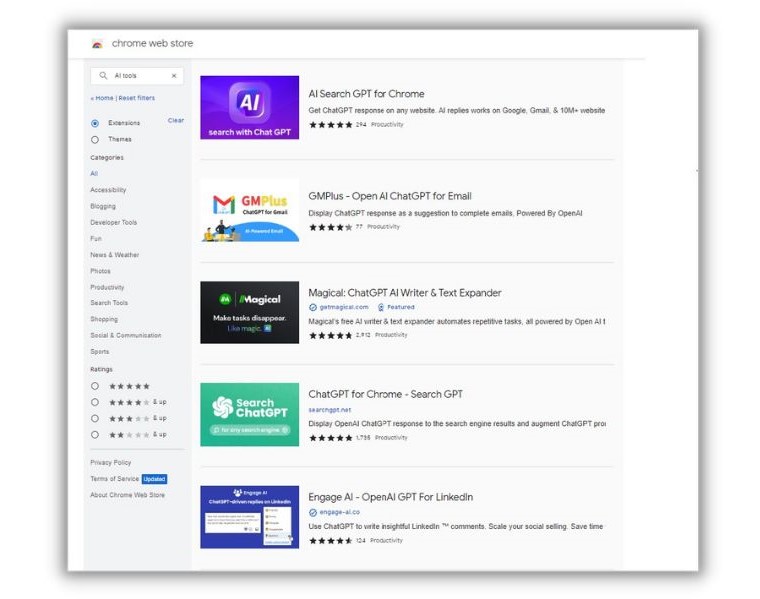

“Existem muitos produtos por aí que parecem, funcionam e se comportam como ferramentas legítimas, mas na verdade são malware”, disse Elaine Atwell, editora sênior de marketing de conteúdo do provedor de segurança de endpoint Kolide. “Eles são extremamente difíceis de diferenciar das ferramentas legítimas e você pode encontrá-los na Chrome Store agora.”

Digite qualquer versão de “ferramentas de IA” na loja do Google Chrome e não faltarão opções.

Atwell escreveu sobre esses riscos no blog Kolide. Em seu artigo, ela fez referência a um incidente em que uma extensão do Chrome chamada “Acesso rápido ao Chat GPT” era na verdade um estratagema. Depois de baixado, o software sequestrava as contas do Facebook dos usuários e roubava todos os cookies da vítima – até mesmo os de segurança. Mais de 2.000 pessoas baixaram a extensão todos os dias, informou Atwell.

Privacidade desprotegida

Atwell diz que mesmo uma ferramenta legítima de IA pode apresentar um risco de segurança. “…no momento, a maioria das empresas nem mesmo possui políticas para avaliar os tipos e níveis de risco representados por diferentes extensões. E na ausência de uma orientação clara, pessoas de todo o mundo estão instalando esses pequenos ajudantes e alimentando-os com dados confidenciais.”

Digamos que você esteja escrevendo um relatório financeiro interno para ser compartilhado com os investidores. Lembre-se de que as redes de IA aprendem com o que recebem para produzir saídas para outros usuários. Todos os dados que você coloca no chatbot de IA podem ser um jogo justo para pessoas de fora da sua empresa. E pode aparecer se um concorrente perguntar sobre sua linha de fundo.

Como evitar riscos de privacidade e segurança

A primeira linha de defesa é garantir que um software seja o que afirma ser. Além disso, seja cauteloso sobre como você usa as ferramentas que você escolher. “Se você for usar ferramentas de IA (e elas têm usos!) Não alimente-as com dados que possam ser considerados confidenciais”, diz Atwell.

Além disso, enquanto você analisa as ferramentas de IA quanto à utilidade e viés, pergunte sobre suas políticas de privacidade e segurança.

Mitigar os riscos do uso de IA para marketing

A IA está avançando a um ritmo incrível. Em menos de um ano, o Chat GTP já viu aumentos significativos em suas capacidades. É impossível saber o que seremos capazes de fazer com a IA mesmo nos próximos seis a doze meses. Também não podemos antecipar os problemas potenciais.

Aqui estão várias maneiras de melhorar seus resultados de marketing de IA, evitando alguns dos riscos mais comuns:

- Faça com que editores humanos revisem o conteúdo quanto à qualidade, legibilidade e voz da marca

- Examine cada ferramenta que você usa para segurança e capacidade

- Revise regularmente a segmentação de anúncios direcionada por IA quanto a viés

- Avalie a cópia e as imagens para possíveis violações de direitos autorais

Gostaríamos de agradecer a Elain Attwell, Brett McHale, Nick Abenne e Alaura Weaver por contribuir com este post.

Para recapitular, vamos revisar nossa lista de riscos que acompanham o uso de IA para marketing:

- Viés de aprendizado de máquina

- falácias factuais

- Aplicação incorreta de ferramentas de IA

- conteúdo homogêneo

- Perda de SEO

- Desafios legais

- Violações de segurança e privacidade