7 riscuri serioase cu care vă confruntați folosind AI pentru marketing

Publicat: 2023-07-06În urmă cu câțiva ani, cei mai mulți dintre noi, profesioniștii în marketing, nu aveam cea mai vagă idee despre cum să folosească AI pentru marketing. Dintr-o dată, scriem postări pe LinkedIn despre cele mai bune solicitări pentru a-i șopti la ureche ChatGPT.

Sunt multe de sărbătorit despre infuzia bruscă a inteligenței artificiale în munca noastră. McKenzie consideră că AI va debloca 2,6 trilioane de dolari în valoare pentru marketeri.

Dar adoptarea noastră rapidă a inteligenței artificiale poate depăși întrebările etice, legale și operaționale importante – ceea ce îi va lăsa pe marketerii expuși la riscuri la care nu trebuia să ne gândim până acum (adică putem fi dați în judecată pentru că i-am spus AI să „scrie ca Stephen King? ”).

Există o tonă metrică de praf de inteligență artificială în atmosfera de marketing care nu se va așeza de ani de zile. Indiferent de cât de tare ai miji din ochi, nu vei descoperi toate capcanele potențiale ale utilizării modelelor de limbaj mari și a învățării automate pentru a crea conținut și a gestiona reclamele.

Prin urmare, scopul nostru în acest articol este să vedem șapte dintre cele mai importante riscuri ale utilizării AI pentru marketing de la un nivel foarte înalt. Am adunat sfaturi de la experți pentru a ajuta la atenuarea acestor riscuri. Și am adăugat o mulțime de resurse, astfel încât să puteți săpa mai adânc în întrebările care vă preocupă cel mai mult.

Riscul nr. 1: părtinire de învățare automată

Uneori, algoritmii de învățare automată dau rezultate care sunt pe nedrept în favoarea sau împotriva cuiva sau a ceva. Se numește prejudecată de învățare automată sau prejudecată AI și este o problemă generalizată chiar și cu cele mai avansate rețele neuronale profunde.

Este o problemă de date

Nu este că rețelele AI sunt în mod inerent bigot. Este o problemă cu datele care sunt introduse în ele.

Algoritmii de învățare automată funcționează prin identificarea modelelor pentru a calcula probabilitatea unui rezultat, cum ar fi dacă un anumit grup de cumpărători va aprecia sau nu produsul dvs.

Dar ce se întâmplă dacă datele pe care AI se antrenează sunt denaturate către o anumită rasă, gen sau grup de vârstă? Inteligența artificială va ajunge la concluzia că acei oameni se potrivesc mai bine și va denatura publicitatea sau plasarea în consecință.

ediție privind spălarea părtinitoare pic.twitter.com/YQLRcq59lQ

– Janelle Shane (@JanelleCShane) 17 iunie 2021

Iată un exemplu. Cercetătorii au testat recent prejudecățile de gen în sistemele de direcționare a reclamelor Facebook. Anchetatorii au plasat un anunț pentru a recruta șoferi de livrare pentru Pizza Hut și un anunț similar cu aceleași calificări pentru Instacart.

Grupul existent de șoferi Pizza Hut declină bărbații, așa că Facebook a arătat acele reclame în mod disproporționat bărbaților. Instacart are mai multe șoferi femei, așa că anunțurile pentru jobul lor au fost plasate în fața mai multor femei. Dar nu există niciun motiv inerent pentru care femeile nu ar dori să știe despre locurile de muncă din Pizza Hut, așa că acesta este un mare pas greșit în direcționarea anunțurilor.

Prejudecățile IA sunt frecvente

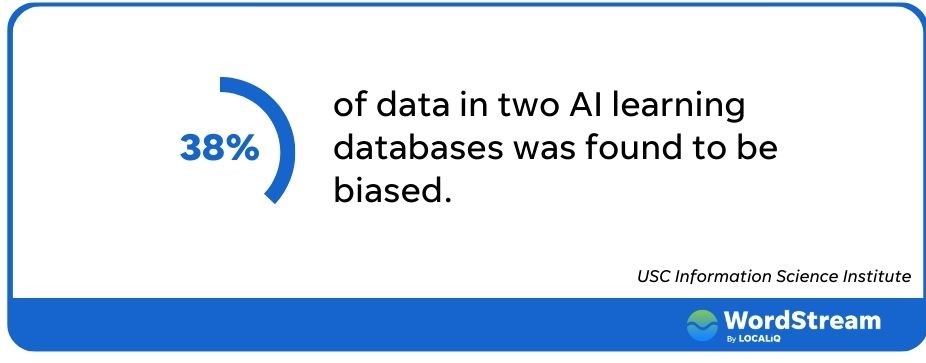

Problema se extinde cu mult dincolo de Facebook. Cercetătorii de la USC s-au uitat la două baze de date mari AI și au descoperit că peste 38% din datele din ele erau părtinitoare. Documentația ChatGPT chiar avertizează că algoritmul lor poate asocia „stereotipuri negative cu femeile de culoare”.

Prejudecățile învățării automate prezintă mai multe implicații pentru marketeri; dintre care cel mai mic este performanța slabă a reclamelor. Dacă sperați să ajungeți la cei mai mulți clienți potențiali posibil, o platformă de direcționare a anunțurilor care exclude părți mari din populație este mai puțin decât ideală.

Desigur, există ramificații mai mari dacă anunțurile noastre vizează sau exclud în mod incorect anumite grupuri. Dacă anunțul dvs. imobiliar discriminează minoritățile protejate, ați putea ajunge la capătul greșit al Legii privind locuințele echitabile și al Comisiei Federale pentru Comerț. Ca să nu mai vorbim că lipsește complet barca de marketing inclusiv.

Cum să evitați părtinirea AI

Deci, ce facem atunci când instrumentele noastre AI nu funcționează? Există câțiva pași pe care îi puteți lua pentru a vă asigura că anunțurile dvs. tratează pe toată lumea în mod echitabil.

În primul rând, asigurați-vă că cineva vă revizuiește conținutul, scrie Alaura Weaver, senior manager de conținut și comunitate la Writer. „Deși tehnologia AI a avansat semnificativ, îi lipsesc gândirea critică și abilitățile de luare a deciziilor pe care le au oamenii”, explică ea. „Prin editorii umani să revizuiască și să verifice faptele conținutul scris prin inteligență artificială, ei se pot asigura că este lipsit de părtiniri și că respectă standardele etice.”

Supravegherea umană va reduce riscul unor rezultate negative și în campaniile de anunțuri plătite.

„În prezent, și poate la infinit, nu este recomandabil să lăsăm AI să preia complet campaniile sau orice formă de marketing”, spune Brett McHale, fondatorul Empiric Marketing. „AI funcționează optim atunci când primește intrări precise de la inteligența organică care a acumulat deja cantități mari de date și experiențe.”

Riscul #2: Eșecuri faptice

Google a costat recent compania sa-mamă în valoare de 100 de miliarde de dolari, când noul său chatbot AI, Bard, a dat un răspuns incorect într-un tweet promoțional.

Bard este un serviciu AI conversațional experimental, alimentat de LaMDA. Construit folosind modelele noastre mari de limbaj și bazându-se pe informații de pe web, este o rampă de lansare pentru curiozitate și poate ajuta la simplificarea subiectelor complexe → https://t.co/fSp531xKy3 pic.twitter.com/JecHXVmt8l

— Google (@Google) 6 februarie 2023

Provocația Google evidențiază una dintre cele mai mari limitări ale AI și unul dintre cele mai mari riscuri pentru marketerii care o folosesc: AI nu spune întotdeauna adevărul.

AI halucinează

Ethan Mollic, profesor la Wharton School of Business, a descris recent sistemele bazate pe inteligență artificială, cum ar fi ChatGPT, drept „un stagiar omniscient, dornic de a te mulțumi, care uneori minte”.

Desigur, AI nu este sensibil, în ciuda a ceea ce unii ar putea pretinde. Nu intenționează să ne înșele. Poate, totuși, să sufere de „halucinații” care îl determină doar să inventeze lucruri.

AI este o mașină de predicție. Pare să completeze următorul cuvânt sau frază care va răspunde la întrebarea dvs. Dar nu este conștient de sine; AI nu are o logică de verificare pentru a ști dacă ceea ce leagă are sens.

Spre deosebire de părtinire, aceasta nu pare a fi o problemă de date. Chiar și atunci când rețeaua are toate informațiile potrivite, ne poate spune tot ceea ce este greșit.

Luați în considerare acest exemplu în care un utilizator a întrebat ChatGPT „de câte ori a câștigat Argentina Cupa Mondială FIFA?” A spus o dată și a făcut referire la victoria echipei din 1978. Tweeterul a întrebat apoi ce echipă a câștigat în 1986.

A întrebat #ChatGPT despre cine a câștigat Cupa Mondială FIFA în 2022. Nu a putut răspunde. Asta e de așteptat. Cu toate acestea, pare să furnizeze informații greșite (aproximativ celelalte 2 câștiguri) chiar dacă informațiile sunt acolo în sistem. Orice #explicații? pic.twitter.com/fvxe05N12p

— indranil sinharoy (@indranil_leo) 29 decembrie 2022

Chatbot-ul a recunoscut că este Argentina, fără nicio explicație pentru fosta sa gaffe.

Partea îngrijorătoare este că răspunsurile eronate ale AI sunt adesea scrise atât de sigur, încât se amestecă în textul din jurul lor, făcându-le să pară complet plauzibile. Ele pot fi, de asemenea, cuprinzătoare, așa cum se detaliază într-un proces intentat împotriva Open.ai, în care ChatGPT ar fi inventat o întreagă poveste de delapidare care a fost apoi împărtășită de un jurnalist.

Cum să eviți halucinațiile AI

În timp ce AI vă poate duce în rătăcire chiar și cu răspunsuri dintr-un singur cuvânt, este mai probabil să se destrame atunci când scrieți texte mai lungi.

„De la o singură solicitare, AI poate genera un blog sau o carte electronică. Da, este uimitor – dar există o captură”, avertizează Weaver. „Cu cât generează mai mult, cu atât mai multă editare și verificare a faptelor va trebui să faci.”

Pentru a reduce șansele ca instrumentul dvs. AI să înceapă să învârte narațiuni halucinatorii, Weaver spune că cel mai bine este să creați o schiță și ca botul să o abordeze o secțiune la un moment dat. Și apoi, desigur, cereți unei persoane să revizuiască faptele și statisticile pe care le adaugă.

Riscul #3: Aplicarea greșită a instrumentelor AI

În fiecare dimineață ne trezim cu o nouă recoltă de instrumente AI care aparent a încolțit peste noapte ca ciupercile după o furtună.

Dar nu fiecare platformă este construită pentru toate funcțiile de marketing, iar unele provocări de marketing nu pot (încă) fi rezolvate de AI.

Instrumentele AI au limitări

ChatGPT este un exemplu grozav. Frumusețea mingii AI este distractiv de jucat (cum ar fi să scrii cum să scoți un sandviș cu unt de arahide dintr-un VCR în stilul Bibliei King James). Și poate produce niște răspunsuri scurte surprinzător de bine scrise, care explodează blocajul scriitorului. Dar nu-i cereți să vă ajute să faceți cercetarea cuvintelor cheie.

ChatGPT eșuează din cauza setului său de date relativ vechi, care include doar informații de dinainte de 2022. Cereți-i să ofere cuvinte cheie pentru „marketing AI”, iar răspunsurile sale nu vor fi în concordanță cu ceea ce găsiți în alte instrumente precum Thinword sau Contextminds.

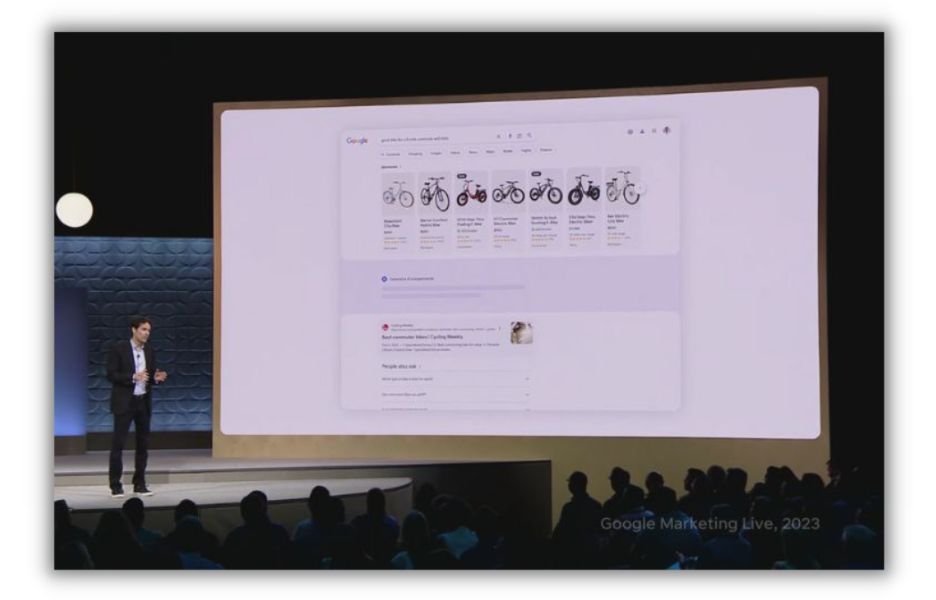

De asemenea, atât Google, cât și Facebook au noi instrumente bazate pe inteligență artificială pentru a ajuta agenții de marketing să creeze reclame, să optimizeze cheltuielile publicitare și să personalizeze experiența publicitară. Un chatbot nu poate rezolva aceste provocări.

Google a anunțat o serie de actualizări ale AI pentru produsele sale de căutare și de gestionare a reclamelor la evenimentul Google Marketing Live din 2023.

Puteți folosi în exces AI

Dacă oferiți unui instrument AI o sarcină singulară, acesta poate supraindexa doar pentru un singur obiectiv. Nick Abbene, un expert în automatizarea marketingului, vede acest lucru adesea cu companiile concentrate pe îmbunătățirea SEO.

„Cea mai mare problemă pe care o văd este utilizarea orbește a instrumentelor SEO, optimizarea excesivă pentru motoarele de căutare și ignorarea intenției de căutare a clienților”, spune Abbene. „Instrumentele SEO sunt excelente pentru a semnala motoarele de căutare conținut de calitate. Dar, în cele din urmă, Google vrea să se potrivească cu cererea celui care caută.”

Cum să evitați aplicarea greșită a instrumentelor AI

O cheie nu este cea mai bună opțiune pentru a lovi unghiile. De asemenea, un asistent de scriere AI poate să nu fie bun pentru a crea pagini web. Înainte de a intra în orice opțiune AI, Abbene spune să primiți feedback de la constructorul instrumentului și de la alți utilizatori.

„Pentru a evita alegerea greșită a instrumentelor AI, înțelegeți dacă alți agenți de marketing folosesc instrumentul pentru cazul dvs.”, spune el. „Nu ezitați să solicitați o demonstrație a produsului sau să-l încercați împreună cu alte instrumente care oferă aceeași funcționalitate.”

Site-urile web precum Capterra vă permit să comparați rapid mai multe platforme AI.

Și odată ce găsiți stiva potrivită de instrumente AI, utilizați-o pentru a ajuta procesul, nu o preluați. „Nu vă fie teamă să utilizați instrumente AI pentru a vă spori fluxul de lucru, ci folosiți-le doar pentru asta”, spune Abbene. „Începeți fiecare conținut de la primele principii, cu cercetare de calitate a cuvintelor cheie și înțelegerea intenției de căutare.”

Riscul #4: Conținut omogen

AI poate scrie un eseu întreg în aproximativ 10 secunde. Dar, oricât de impresionantă a devenit AI generativă, îi lipsește nuanța de a fi cu adevărat creativ, lăsând rezultatul său adesea simțit, ei bine, robotizat.

„În timp ce AI este excelentă la producerea de conținut informativ, adesea îi lipsește flerul creativ și implicarea pe care oamenii le aduc la masă”, spune Weaver.

AI este făcută pentru a imita

Cereți unui robot generativ de scriere AI să scrie raportul cărții dvs. și va învârti cu ușurință 500 de cuvinte care explică în mod competent tema principală a Catcher in the Rye (presupunând că nu-l halucinează pe Holden Caulfield ca un tâlhar de bănci).

Poate face asta pentru că a absorbit mii de texte despre capodopera lui JD Salinger.

Acum cereți-i prietenului dvs. AI să scrie o postare pe blog care să explice un concept de bază pentru afacerea dvs. într-un mod care să încapsuleze marca, publicul și propunerea de valoare. S-ar putea să fii dezamăgit. „Conținutul generat de inteligență artificială nu ține întotdeauna cont de nuanțele personalității și valorilor unui brand și poate produce conținut care nu atinge obiectivul”, spune Weaver.

Cu alte cuvinte, AI este excelentă la digerarea, combinarea și reconfigurarea a ceea ce a fost deja creat. Nu este grozav să creezi ceva care să iasă în evidență față de conținutul existent.

Instrumentele AI generative nu sunt, de asemenea, bune pentru a face conținutul captivant. Ei vor produce cu bucurie blocuri uriașe de cuvinte fără nicio imagine, grafic sau punct de marcare pentru a oferi ochilor obosiți să se odihnească. Nu vor atrage poveștile clienților sau exemple ipotetice pentru a face un punct mai ușor de identificat. Și s-ar lupta să conecteze o știre din industria dvs. cu un beneficiu oferit de produsul dvs.

Cum să evitați conținutul omogen

Unele instrumente AI, cum ar fi Writer, au funcții încorporate pentru a-i ajuta pe scriitori să mențină o personalitate consistentă a mărcii. Dar veți avea în continuare nevoie de un editor care să „revizeze și să editeze conținutul pentru vocea și tonul mărcii pentru a vă asigura că rezonează cu publicul și întărește mesajele și obiectivele organizației”, sfătuiește Weaver.

Editorii și scriitorii pot vedea, de asemenea, un articol la fel ca și alți oameni. Dacă există un bloc de cuvinte impenetrabil, ei vor fi cei care îl vor despărți și vor adăuga puțin zhuzh vizual.

Folosiți conținutul AI ca punct de plecare, ca o modalitate de a vă ajuta să vă declanșați creativitatea și cercetarea. Dar adăugați întotdeauna propria voastră notă personală.

Riscul #5: Pierderea SEO

Poziția Google cu privire la conținutul AI a fost puțin tulbure. La început, se părea că motorul de căutare va penaliza postările scrise cu AI.

[Imagine: tweet de la John Mueller pe AI]

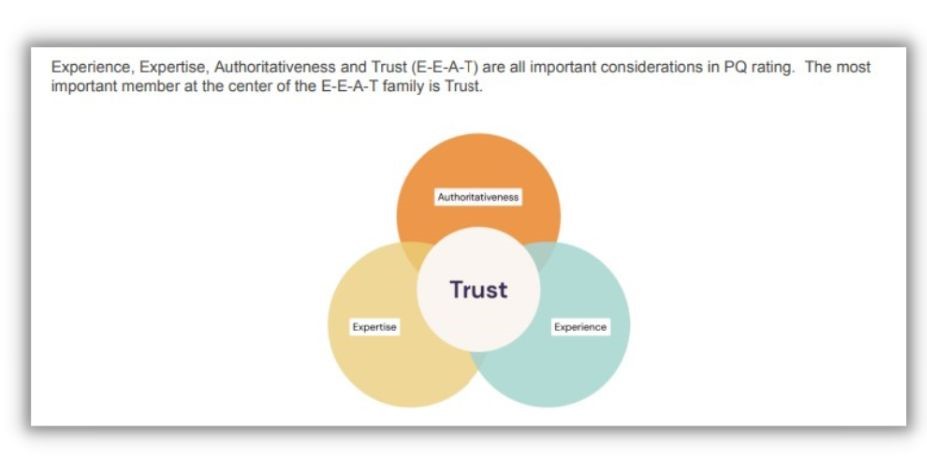

Mai recent, blogul dezvoltatorilor Google a spus că AI este OK în cartea lor. Dar există o clipă semnificativă cu această confirmare. Doar „conținutul care demonstrează calitățile a ceea ce numim EEAT: expertiză, experiență, autoritate și încredere” îi va impresiona pe evaluatorii de căutare umani care evaluează continuu sistemele de clasare ale Google.

Încrederea este clutch pentru SEO

Printre EEAT de la Google, singurul factor care îi guvernează pe toți este încrederea.

[sursă]

Am discutat deja că conținutul AI este predispus la erori, ceea ce îl face în mod inerent nedemn de încredere fără supraveghere umană. De asemenea, nu îndeplinește cerințele de susținere, deoarece, prin natura lor, nu este scris de cineva cu expertiză, autoritate sau experiență în domeniu.

Luați o postare pe blog despre coacerea pâinii cu banane. Un bot AI vă va oferi o rețetă în aproximativ două secunde. Dar nu poate deveni poetic în zilele reci de iarnă petrecute la copt pentru familia sa. Sau vorbiți despre anii petrecuți experimentând diverse tipuri de făină ca brutar comercial. Aceste perspective sunt ceea ce caută evaluatorii de căutare de la Google.

De asemenea, pare să fie ceea ce tânjește oamenii. De aceea, atât de mulți dintre ei apelează la oameni reali pe videoclipurile TikTok pentru a afla lucruri pe care le găseau pe Google.

Cum să evitați pierderea SEO

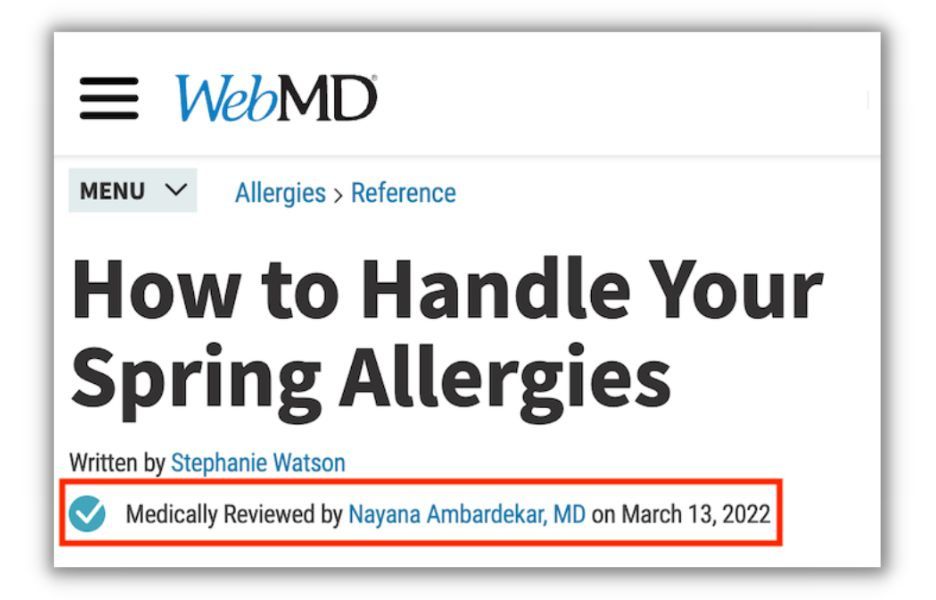

Lucrul grozav despre AI este că nu se deranjează să împărtășească liniile de bază. Deci, atunci când utilizați un chatbot pentru a accelera producția de conținut, asigurați-vă că faceți referire la un autor uman cu acreditări.

Acest lucru este valabil mai ales pentru subiecte sensibile, cum ar fi asistența medicală și finanțele personale, pe care Google le numește subiecte banii tăi, viața ta. „Dacă vă aflați într-o verticală YMYL, acordați prioritate autorității, încrederii și acurateței mai presus de orice altceva în conținutul dvs.”, sfătuiește Elisa Gabbert, director de conținut și SEO pentru WordStream și LocaliQ.

Când scrieți despre asistența medicală, de exemplu, solicitați-vă postările revizuite de un profesionist medical și trimiteți-le în postare. Acesta este un semnal puternic pentru Google că conținutul dvs. este de încredere, chiar dacă a fost început într-un chatbot.

Riscul #6: provocări legale

Inteligența artificială generativă învață din munca creată de oameni, apoi creează ceva nou. Problema drepturilor de autor este neclară atât pentru intrarea, cât și pentru ieșirea modelului de conținut AI.

Munca existentă este probabil un joc corect pentru AI

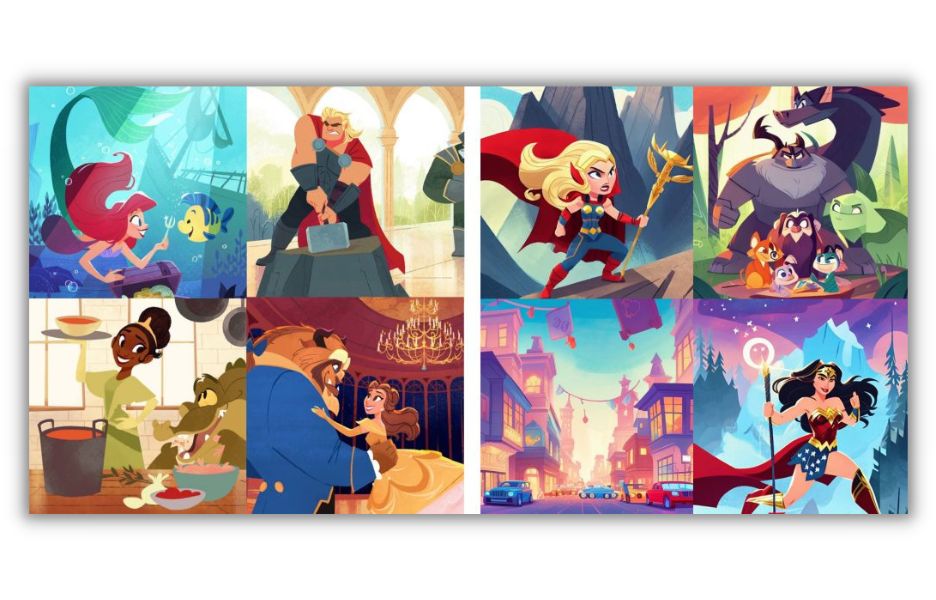

Pentru a ilustra (în sensul jocului de cuvinte) întrebarea privind drepturile de autor pentru lucrările care alimentează modele mari de învățare, ne întoarcem la un caz raportat de tehnologul Andy Baio. După cum explică Baio, o artistă din LA pe nume Hollie Mengert a aflat că 32 dintre ilustrațiile ei au fost absorbite într-un model AI, apoi oferite prin licență deschisă oricui dorea să-și recreeze stilul.

Legendă: o colecție de ilustrații ale artistei Hollie Mengert (stânga) în comparație cu ilustrații generate de inteligența artificială bazate pe stilul ei, curatoriată de Andy Baio .

Povestea devine mai complicată când afli că ea a creat multe dintre imaginile ei pentru clienți precum Disney, care dețin de fapt drepturile asupra acestora.

Pot ilustratorii (sau scriitorii sau programatorii) care se află în același loc cu Mengert să dea în judecată cu succes pentru încălcarea drepturilor de autor?

Nu există încă un răspuns clar la întrebare. „Văd oameni de ambele părți ale acestui lucru extrem de încrezători în pozițiile lor, dar realitatea este că nimeni nu știe”, a spus Baio pentru The Verge. „Și oricine spune că știe cu încredere cum se va desfășura asta în instanță greșește.”

Dacă inteligența artificială pe care o folosești pentru a crea o imagine sau un articol a fost instruită pe mii de lucrări de la mulți creatori, probabil că nu vei pierde un proces în instanță. Dar dacă alimentezi mașina cu zece cărți Stephen King și îi spui botului să scrie una nouă în acel stil, ai putea avea probleme.

Disclaimer: nu suntem avocați, așa că vă rugăm să obțineți consiliere juridică dacă nu sunteți sigur.

Este posibil ca nici conținutul dvs. AI să nu fie protejat

Dar conținutul pe care îl creați folosind un chatbot, este acoperit de legile privind drepturile de autor? În cea mai mare parte, nu numai dacă ați făcut o muncă considerabilă pentru a-l edita. Ceea ce înseamnă că ai avea puține soluții dacă cineva reapropie (a se citi: fură) postările tale pentru propriul blog.

Pentru conținutul care este protejat, poate fi programatorul AI, nu tu, cel care deține drepturile. Multe țări consideră că creatorul instrumentului care a produs o lucrare este creatorul acesteia, nu persoana care a introdus promptul.

Cum să evitați provocările legale

Începeți prin a utiliza un instrument reputat de creare de conținut AI. Găsiți unul cu o mulțime de recenzii pozitive produse de o companie care abordează în mod clar poziția sa cu privire la legile drepturilor de autor.

De asemenea, folosește-ți buna judecată pentru a decide dacă copiați în mod intenționat lucrarea unui creator sau pur și simplu folosiți AI pentru a o îmbunătăți pe a ta.

Și dacă doriți o șansă de luptă în instanță pentru a proteja ceea ce produceți, faceți multe schimbări substanțiale. Sau folosiți inteligența artificială pentru a crea un contur, dar scrieți singur majoritatea cuvintelor.

Riscul #7: încălcări ale securității și confidențialității

Instrumentele AI prezintă marketerilor o gamă largă de potențiale amenințări la adresa securității sistemului lor și a confidențialității datelor. Unele sunt atacuri directe din partea unor actori rău intenționați. Alții sunt pur și simplu utilizatori care oferă fără să vrea informații sensibile unui sistem conceput să le partajeze.

Riscuri de securitate din instrumentele AI

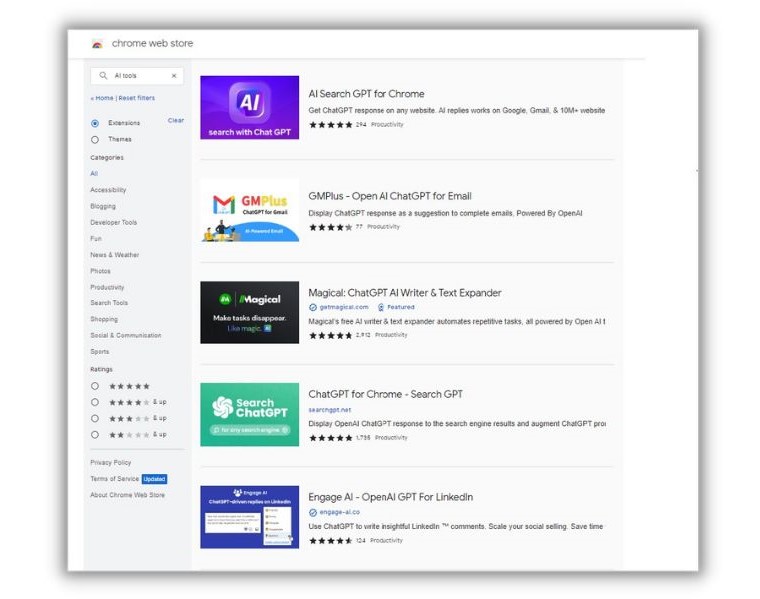

„Există o mulțime de produse care arată, simt și se comportă ca niște instrumente legitime, dar sunt de fapt malware”, ne-a spus Elaine Atwell, editor principal de marketing de conținut la furnizorul de securitate pentru terminale Kolide. „Sunt extrem de greu de diferențiat de instrumentele legitime și le puteți găsi chiar acum în magazinul Chrome.”

Introdu orice versiune de „instrumente AI” în magazinul Google Chrome și nu vei găsi lipsă de opțiuni.

Atwell a scris despre aceste riscuri pe blogul Kolide. În articolul ei, ea a făcut referire la un incident în care o extensie Chrome numită „Acces rapid la Chat GPT” a fost de fapt un șiretlic. Odată descărcat, software-ul a deturnat conturile de Facebook ale utilizatorilor și a trecut prin glisare toate modulele cookie ale victimei, chiar și cele pentru securitate. Peste 2.000 de persoane au descărcat extensia în fiecare zi, a raportat Atwell.

Confidențialitate neprotejată

Atwell spune că chiar și un instrument AI legitim poate prezenta un risc de securitate. „...în acest moment, majoritatea companiilor nici măcar nu au politici în vigoare pentru a evalua tipurile și nivelurile de risc prezentate de diferite extensii. Și în absența unei îndrumări clare, oamenii din întreaga lume instalează acești mici ajutoare și le furnizează date sensibile.”

Să presupunem că scrieți un raport financiar intern pentru a fi distribuit investitorilor. Amintiți-vă că rețelele AI învață din ceea ce li se oferă pentru a produce rezultate pentru alți utilizatori. Toate datele pe care le plasați în chatbot-ul AI ar putea fi un joc corect pentru oamenii din afara companiei dvs. Și poate apărea dacă un concurent vă întreabă despre rezultatul final.

Cum să evitați riscurile de confidențialitate și securitate

Prima linie de apărare este să vă asigurați că o bucată de software este ceea ce pretinde a fi. În plus, fiți atenți la modul în care utilizați instrumentele pe care le alegeți. „Dacă veți folosi instrumente AI (și au utilizări!), nu le furnizați date care ar putea fi considerate sensibile”, spune Atwell.

De asemenea, în timp ce examinați instrumentele AI pentru utilitate și părtinire, întrebați despre politicile lor de confidențialitate și securitate.

Reduceți riscurile utilizării AI pentru marketing

AI avansează într-un ritm incredibil. În mai puțin de un an, Chat GTP a cunoscut deja o creștere semnificativă a capacităților sale. Este imposibil să știm ce vom putea face cu AI chiar și în următoarele șase până la douăsprezece luni. Nici nu putem anticipa eventualele probleme.

Iată câteva moduri prin care vă puteți îmbunătăți rezultatele de marketing AI, evitând în același timp unele dintre cele mai comune riscuri:

- Rugați editorii umani să revizuiască conținutul pentru calitate, lizibilitate și vocea mărcii

- Analizați fiecare instrument pe care îl utilizați pentru securitate și capacitate

- Examinați în mod regulat direcționarea anunțurilor direcționate prin inteligență artificială pentru a detecta prejudecăți

- Evaluați copia și imaginile pentru posibile încălcări ale drepturilor de autor

Dorim să le mulțumim Elain Attwell, Brett McHale, Nick Abenne și Alaura Weaver pentru contribuția la această postare.

Pentru a recapitula, haideți să revizuim lista noastră de riscuri asociate utilizării inteligenței artificiale pentru marketing:

- Prejudecăți de învățare automată

- Erorile faptice

- Aplicarea greșită a instrumentelor AI

- Conținut omogen

- Pierderea SEO

- Provocări juridice

- Încălcări de securitate și confidențialitate