AI în SEO: Cum să navigați în provocările legale și să asigurați conformitatea

Publicat: 2023-09-26Inteligența artificială (AI) este pe cale să devină un instrument vital pentru mărcile care doresc să-și îmbunătățească prezența online.

Cu toate acestea, integrarea inteligenței artificiale în strategiile de marketing creează inevitabil considerente juridice și noi reglementări pe care agențiile trebuie să le parcurgă cu atenție.

În acest articol, vei descoperi:

- Cum companiile și agențiile de SEO și media pot minimiza riscurile legale ale implementării strategiilor îmbunătățite de IA.

- Instrumente utile pentru a reduce părtinirea AI și un proces la îndemână pentru a revizui calitatea conținutului generat de AI.

- Modul în care agențiile pot aborda principalele provocări de implementare a AI pentru a asigura eficiența și conformitatea pentru clienții lor.

Considerații privind conformitatea legală

Proprietatea intelectuală și dreptul de autor

O preocupare juridică crucială atunci când utilizați AI în SEO și media este respectarea legilor privind proprietatea intelectuală și drepturile de autor.

Sistemele de inteligență artificială răzuiesc și analizează adesea cantități mari de date, inclusiv materiale protejate prin drepturi de autor.

Există deja mai multe procese împotriva OpenAI pentru încălcarea drepturilor de autor și a confidențialității.

Compania se confruntă cu procese pentru utilizarea neautorizată a cărților protejate prin drepturi de autor pentru instruirea ChatGPT și colectarea ilegală de informații personale de la utilizatorii de internet folosind modelele lor de învățare automată.

Preocupările legate de confidențialitate cu privire la procesarea și salvarea de către OpenAI a datelor utilizatorilor au făcut ca Italia să blocheze complet utilizarea ChatGPT la sfârșitul lunii martie.

Interdicția a fost acum ridicată după ce compania a făcut modificări pentru a crește transparența în procesarea datelor utilizatorilor chatbot și pentru a adăuga o opțiune de a renunța la conversațiile ChatGPT utilizate pentru algoritmii de antrenament.

Cu toate acestea, odată cu lansarea GPTBot, crawler-ul OpenAI, este posibil să apară și alte considerente juridice.

Pentru a evita potențialele probleme juridice și reclamațiile de încălcare, agențiile trebuie să se asigure că orice model de IA este instruit pe surse de date autorizate și respectă restricțiile privind drepturile de autor:

- Asigurați-vă că datele au fost obținute în mod legal și că agenția are drepturile corespunzătoare pentru a le utiliza.

- Filtrați datele care nu au permisiunile legale necesare sau sunt de proastă calitate.

- Efectuați audituri regulate ale datelor și modelelor AI pentru a vă asigura că respectă drepturile și legile de utilizare a datelor.

- Organizați o consultare juridică a drepturilor asupra datelor și a confidențialității pentru a vă asigura că nimic nu intră în conflict cu politicile legale.

Atât echipele juridice ale agenției, cât și ale clienților vor trebui probabil implicate în discuțiile de mai sus înainte ca modelele AI să poată fi integrate în fluxurile de lucru și proiecte.

Confidențialitatea și protecția datelor

Tehnologiile AI se bazează în mare măsură pe date, care pot include informații personale sensibile.

Colectarea, stocarea și prelucrarea datelor utilizatorilor trebuie să se alinieze cu legile relevante privind confidențialitatea, cum ar fi Regulamentul general privind protecția datelor (GDPR) din Uniunea Europeană.

Mai mult, Actul UE AI, recent introdus, subliniază, de asemenea, abordarea preocupărilor legate de confidențialitatea datelor asociate cu sistemele AI.

Acest lucru nu este lipsit de merit. Marile corporații, cum ar fi Samsung, au interzis complet AI din cauza expunerii datelor confidențiale încărcate pe ChatGPT.

Prin urmare, dacă agențiile folosesc datele clienților împreună cu tehnologia AI, acestea ar trebui:

- Prioritizează transparența în colectarea datelor.

- Obțineți consimțământul utilizatorului.

- Implementați măsuri de securitate robuste pentru a proteja informațiile sensibile.

În aceste cazuri, agențiile pot acorda prioritate transparenței în colectarea datelor comunicând în mod clar utilizatorilor ce date vor fi colectate, cum vor fi utilizate și cine va avea acces la acestea.

Pentru a obține consimțământul utilizatorului, asigurați-vă că consimțământul este informat și dat liber prin formulare de consimțământ clare și ușor de înțeles care explică scopul și beneficiile colectării datelor.

În plus, măsurile de securitate robuste includ:

- Criptarea datelor.

- Controlul accesului.

- Anonimizarea datelor (acolo unde este posibil).

- Audituri și actualizări regulate.

De exemplu, politicile OpenAI se aliniază cu nevoia de confidențialitate și protecție a datelor și se concentrează pe promovarea transparenței, a consimțământului utilizatorilor și a securității datelor în aplicațiile AI.

Corectitudine și părtinire

Algoritmii AI utilizați în SEO și media au potențialul de a perpetua din greșeală prejudecățile sau de a discrimina anumite persoane sau grupuri.

Agențiile trebuie să fie proactive în identificarea și atenuarea părtinirii algoritmice. Acest lucru este deosebit de important în conformitate cu noul Act al UE AI, care interzice sistemelor AI să afecteze în mod nedrept comportamentul uman sau să manifeste un comportament discriminatoriu.

Pentru a atenua acest risc, agențiile ar trebui să se asigure că în proiectarea modelelor de IA sunt incluse diverse date și perspective și să monitorizeze continuu rezultatele pentru potențialele părtiniri și discriminare.

O modalitate de a realiza acest lucru este utilizarea unor instrumente care ajută la reducerea părtinirii, cum ar fi AI Fairness 360, IBM Watson Studio și Google What-If Tool.

Conținut fals sau înșelător

Instrumentele AI, inclusiv ChatGPT, pot genera conținut sintetic care poate fi inexact, înșelător sau fals.

De exemplu, inteligența artificială creează adesea recenzii online false pentru a promova anumite locuri sau produse. Acest lucru poate duce la consecințe negative pentru companiile care se bazează pe conținutul generat de inteligență artificială.

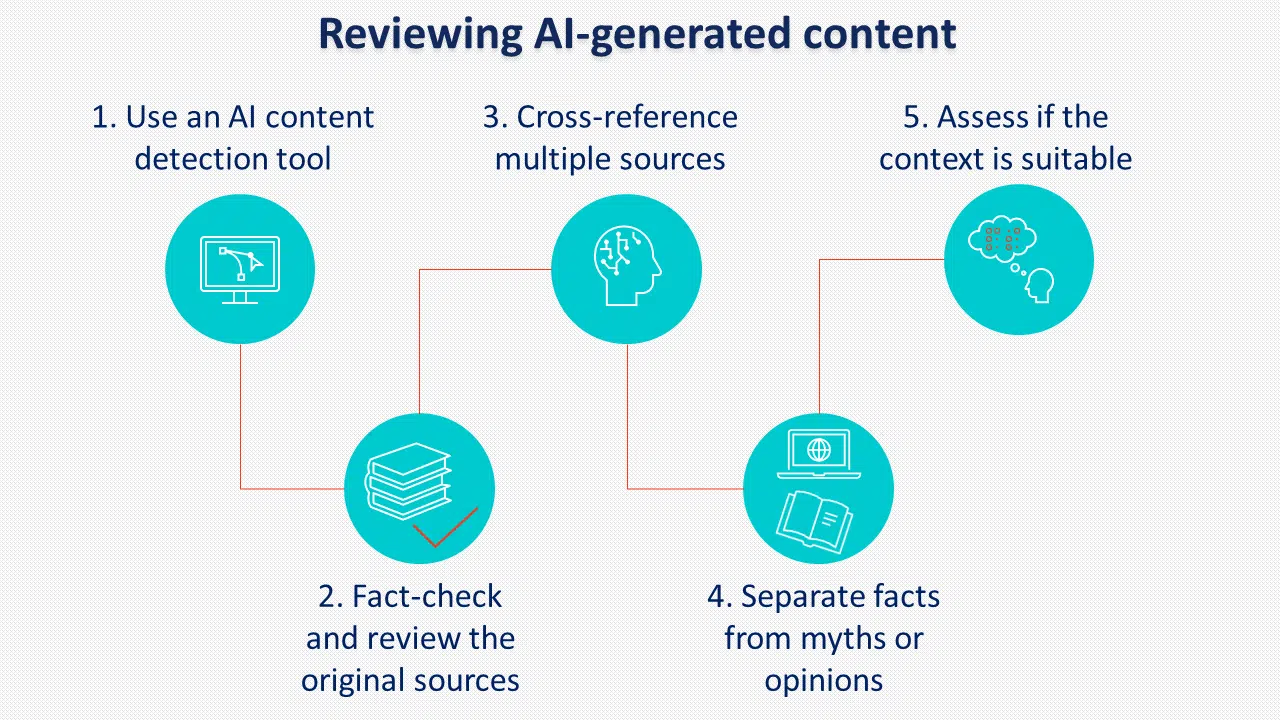

Implementarea politicilor și procedurilor clare pentru revizuirea conținutului generat de AI înainte de publicare este crucială pentru a preveni acest risc.

O altă practică de luat în considerare este etichetarea conținutului generat de AI. Deși Google pare să nu o impună, mulți factori de decizie susțin etichetarea AI.

Răspundere și răspundere

Pe măsură ce sistemele AI devin mai complexe, apar probleme de răspundere.

Agențiile care utilizează IA trebuie să fie pregătite să își asume responsabilitatea pentru orice consecințe neintenționate care rezultă din utilizarea acesteia, inclusiv:

- Prejudecăți și discriminare atunci când utilizați AI pentru a sorta candidații pentru angajare.

- Potențialul de a abuza de puterea AI în scopuri rău intenționate, cum ar fi atacurile cibernetice.

- Pierderea confidențialității dacă informațiile sunt colectate fără consimțământ.

Actul UE AI introduce noi dispoziții privind sistemele AI cu risc ridicat care pot afecta în mod semnificativ drepturile utilizatorilor, subliniind de ce agențiile și clienții trebuie să respecte termenii și politicile relevante atunci când folosesc tehnologiile AI.

Unii dintre cei mai importanți termeni și politici OpenAI se referă la conținutul oferit de utilizator, acuratețea răspunsurilor și prelucrarea datelor cu caracter personal.

Politica de conținut prevede că OpenAI atribuie utilizatorului drepturile conținutului generat. De asemenea, precizează că conținutul generat poate fi utilizat în orice scop, inclusiv comercial, cu condiția să respecte restricțiile legale.

Cu toate acestea, se afirmă, de asemenea, că rezultatul poate să nu fie complet unic și nici precis, ceea ce înseamnă că conținutul generat de AI ar trebui să fie întotdeauna revizuit amănunțit înainte de utilizare.

Pe o notă de date personale, OpenAI colectează toate informațiile introduse de utilizatori, inclusiv încărcările de fișiere.

Atunci când utilizează serviciul pentru prelucrarea datelor cu caracter personal, utilizatorii trebuie să furnizeze notificări de confidențialitate adecvate din punct de vedere legal și să completeze un formular pentru a solicita prelucrarea datelor.

Agențiile trebuie să abordeze în mod proactiv problemele de responsabilitate, să monitorizeze rezultatele AI și să pună în aplicare măsuri solide de control al calității pentru a atenua potențialele răspunderi legale.

Obțineți buletinele informative zilnice pe care se bazează marketerii.

Vezi termenii.

Provocări de implementare a IA pentru agenții

De când OpenAI a lansat ChatGPT anul trecut, au existat multe discuții despre modul în care AI generativă va schimba SEO ca profesie și impactul general asupra industriei media.

Deși schimbările vin cu o combinație de îmbunătățiri ale volumului de lucru zilnic, există câteva provocări pe care agențiile ar trebui să le ia în considerare atunci când implementează AI în strategiile clienților.

Educație și conștientizare

Este posibil ca mulți clienți să nu aibă o înțelegere cuprinzătoare a AI și a implicațiilor acesteia.

Prin urmare, agențiile se confruntă cu provocarea de a educa clienții cu privire la potențialele beneficii și riscuri asociate implementării AI.

Peisajul de reglementare în evoluție necesită o comunicare clară cu clienții cu privire la măsurile luate pentru a asigura conformitatea legală.

Pentru a realiza acest lucru, agențiile trebuie:

- Să aibă o înțelegere clară a obiectivelor clientului lor.

- Să fii capabil să explici beneficiile.

- Arată experiență în implementarea AI.

- Abordați provocările și riscurile.

O modalitate de a face acest lucru este prin a avea o fișă informativă pe care să o împărtășiți clienților, care să conțină toate informațiile necesare și, dacă este posibil, să furnizați studii de caz sau alte exemple despre modul în care aceștia pot beneficia de pe urma utilizării inteligenței artificiale.

Alocare resurselor

Integrarea inteligenței artificiale în strategiile SEO și media necesită resurse semnificative, inclusiv investiții financiare, personal calificat și îmbunătățiri ale infrastructurii.

Agențiile trebuie să evalueze cu atenție nevoile și capacitățile clienților lor pentru a determina fezabilitatea implementării soluțiilor AI în limitele lor bugetare, deoarece pot avea nevoie de specialiști AI, analiști de date, SEO și specialiști în conținut care pot colabora eficient împreună.

Nevoile de infrastructură pot include instrumente AI, platforme de procesare a datelor și de analiză pentru a extrage informații. Dacă furnizați servicii sau facilitați resurse externe depinde de capacitățile și bugetul existent al fiecărei agenții.

Externalizarea altor agenții ar putea duce la o implementare mai rapidă, în timp ce investiția în capabilități interne de inteligență artificială ar putea fi mai bună pentru controlul și personalizarea pe termen lung a serviciilor oferite.

Expertiza tehnica

Implementarea AI necesită cunoștințe tehnice și expertiză specializate.

Este posibil ca agențiile să fie nevoite să recruteze sau să își perfecționeze echipele pentru a dezvolta, implementa și gestiona în mod eficient sistemele AI în conformitate cu noile cerințe de reglementare.

Pentru a profita la maximum de AI, membrii echipei ar trebui să aibă:

- Cunoștințe bune de programare.

- Abilități de procesare și analiză a datelor pentru gestionarea unor cantități mari de date.

- Cunoștințe practice de învățare automată.

- Abilități excelente de rezolvare a problemelor.

Considerații etice

Agențiile trebuie să ia în considerare implicațiile etice ale utilizării AI pentru clienții lor.

Ar trebui stabilite cadre etice și orientări pentru a asigura practici responsabile de IA pe tot parcursul procesului, abordând preocupările ridicate în reglementările actualizate.

Acestea includ:

- Transparență, dezvăluire și responsabilitate atunci când AI este utilizată.

- Respectarea intimității utilizatorilor și a proprietății intelectuale.

- Obținerea consimțământului clientului pentru utilizarea inteligenței artificiale.

- Control uman asupra AI cu angajamentul continuu de a îmbunătăți și de a se adapta la tehnologiile AI emergente.

Responsabilitatea contează: Întâmpinarea provocărilor legale ale implementării AI

În timp ce AI prezintă oportunități interesante pentru îmbunătățirea SEO și practicile media, agențiile trebuie să treacă peste provocările legale și să adere la reglementările actualizate asociate cu implementarea acesteia.

Afacerile și agențiile pot minimiza riscurile legale prin:

- Asigurarea că datele au fost obținute în mod legal și agenția are drepturile corespunzătoare pentru a le utiliza.

- Filtrarea datelor care nu au permisiunile legale necesare sau sunt de proastă calitate.

- Efectuarea de audituri ale datelor și modelelor AI pentru a se asigura că acestea respectă drepturile și legile de utilizare a datelor.

- Organizarea unei consultări juridice cu privire la drepturile de date și la confidențialitate pentru a vă asigura că nimic nu intră în conflict cu politicile legale.

- Prioritizarea transparenței în colectarea datelor și obținerea consimțământului utilizatorului prin formulare de consimțământ clare și ușor de înțeles.

- Folosind instrumente care ajută la reducerea părtinirii, cum ar fi AI Fairness 360, IBM Watson Studio și Google What-If Tool.

- Implementarea de politici și proceduri clare pentru revizuirea calității conținutului generat de IA înainte de publicare.

Opiniile exprimate în acest articol sunt cele ale autorului invitat și nu neapărat Search Engine Land. Autorii personalului sunt enumerați aici.