7 ความเสี่ยงร้ายแรงที่คุณต้องเผชิญในการใช้ AI เพื่อการตลาด

เผยแพร่แล้ว: 2023-07-06สองสามปีที่ผ่านมา พวกเรานักการตลาดส่วนใหญ่ไม่มีความคิดที่คลุมเครือที่สุดเกี่ยวกับวิธีใช้ AI สำหรับการตลาด ทันใดนั้น เรากำลังเขียนโพสต์ LinkedIn เกี่ยวกับคำแนะนำที่ดีที่สุดเพื่อกระซิบใส่หูของ ChatGPT

มีเรื่องให้ชื่นชมมากมายเกี่ยวกับการนำปัญญาประดิษฐ์เข้ามาสู่งานของเราอย่างกะทันหัน McKenzie เชื่อว่า AI จะปลดล็อกมูลค่า 2.6 ล้านล้านดอลลาร์สำหรับนักการตลาด

แต่การนำ AI มาใช้อย่างรวดเร็วของเราอาจนำหน้าคำถามด้านจริยธรรม กฎหมาย และการปฏิบัติงานที่สำคัญ ซึ่งจะทำให้นักการตลาดต้องเผชิญกับความเสี่ยงที่เราไม่เคยต้องคิดมาก่อน (เช่น เราจะถูกฟ้องได้หรือไม่หากบอกให้ AI “เขียนเหมือน Stephen King? ”)

มีฝุ่น AI จำนวนมากในบรรยากาศทางการตลาดที่จะไม่สงบเป็นเวลาหลายปี ไม่ว่าคุณจะเหล่ตามองมากเพียงใด คุณก็มองไม่เห็นหลุมพรางที่อาจเกิดขึ้นจากการใช้โมเดลภาษาขนาดใหญ่และการเรียนรู้ของเครื่องเพื่อสร้างเนื้อหาและจัดการโฆษณา

ดังนั้น เป้าหมายของเราในบทความนี้คือการดูความเสี่ยงที่โดดเด่นที่สุด 7 ประการของการใช้ AI เพื่อการตลาดจากจุดที่สูงมาก เราได้รวบรวมคำแนะนำจากผู้เชี่ยวชาญเพื่อช่วยลดความเสี่ยงเหล่านี้ และเราได้เพิ่มแหล่งข้อมูลมากมายเพื่อให้คุณเจาะลึกลงไปในคำถามที่เกี่ยวข้องกับคุณมากที่สุด

ความเสี่ยง #1: อคติในการเรียนรู้ของเครื่อง

บางครั้งอัลกอริทึมการเรียนรู้ของเครื่องจะให้ผลลัพธ์ที่ไม่ยุติธรรมต่อบางคนหรือบางสิ่ง เรียกว่าความลำเอียงในการเรียนรู้ของเครื่องหรือความลำเอียงของ AI และเป็นปัญหาที่แพร่หลายแม้กระทั่งกับโครงข่ายประสาทเทียมเชิงลึกที่ก้าวหน้าที่สุด

มันเป็นปัญหาข้อมูล

ไม่ใช่ว่าเครือข่าย AI มีขนาดใหญ่โตโดยเนื้อแท้ มันเป็นปัญหากับข้อมูลที่ป้อนเข้ามา

อัลกอริทึมการเรียนรู้ของเครื่องทำงานโดยการระบุรูปแบบเพื่อคำนวณความน่าจะเป็นของผลลัพธ์ เช่น ผู้ซื้อกลุ่มใดกลุ่มหนึ่งจะชอบสินค้าของคุณหรือไม่

แต่จะเป็นอย่างไรหากข้อมูลที่ AI ฝึกฝนนั้นเบ้ไปทางเชื้อชาติ เพศ หรือกลุ่มอายุใดกลุ่มหนึ่ง AI จะสรุปว่าคนเหล่านั้นเหมาะสมกว่าและเอียงโฆษณาหรือตำแหน่งตามนั้น

ฉบับฟอกอคติ pic.twitter.com/YQLRcq59lQ

— Janelle Shane (@JanelleCShane) วันที่ 17 มิถุนายน 2021

นี่คือตัวอย่าง นักวิจัยเพิ่งทดสอบอคติทางเพศในระบบกำหนดเป้าหมายโฆษณาของ Facebook ผู้ตรวจสอบวางโฆษณาเพื่อรับสมัครคนขับรถส่งของสำหรับ Pizza Hut และโฆษณาที่คล้ายกันซึ่งมีคุณสมบัติเหมือนกันสำหรับ Instacart

กลุ่มคนขับพิซซ่าฮัทที่มีอยู่นั้นเบ้ผู้ชาย ดังนั้น Facebook จึงแสดงโฆษณาเหล่านั้นโดยไม่สมส่วนกับผู้ชาย Instacart มีคนขับรถที่เป็นผู้หญิงมากขึ้น ดังนั้นโฆษณาเกี่ยวกับงานของพวกเขาจึงปรากฏต่อหน้าผู้หญิงจำนวนมากขึ้น แต่ก็ไม่มีเหตุผลโดยธรรมชาติที่ผู้หญิงจะไม่ต้องการรู้เกี่ยวกับงานของ Pizza Hut นั่นจึงเป็นความผิดพลาดครั้งใหญ่ในการกำหนดเป้าหมายโฆษณา

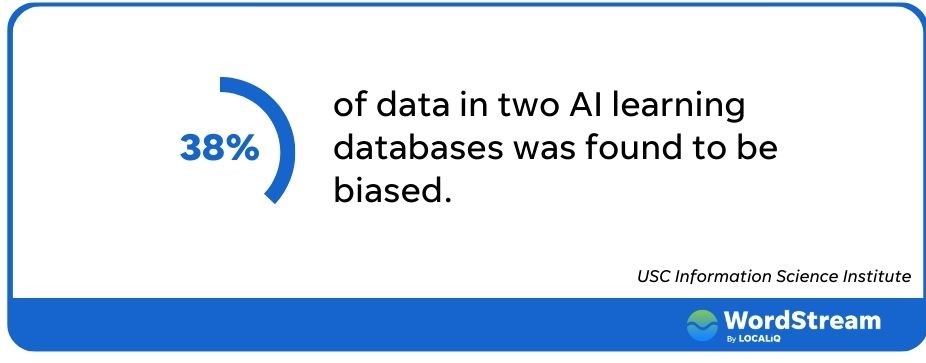

ความลำเอียงของ AI เป็นเรื่องปกติ

ปัญหาขยายไปไกลกว่า Facebook นักวิจัยจาก USC ตรวจสอบฐานข้อมูล AI ขนาดใหญ่ 2 ฐานข้อมูล และพบว่าข้อมูลในฐานข้อมูลมากกว่า 38% มีอคติ เอกสารของ ChatGPT ยังเตือนว่าอัลกอริทึมของพวกเขาอาจเชื่อมโยง "ทัศนคติเชิงลบกับผู้หญิงผิวดำ"

ความลำเอียงในการเรียนรู้ของเครื่องนำเสนอความหมายหลายประการสำหรับนักการตลาด อย่างน้อยที่สุดก็คือประสิทธิภาพโฆษณาที่ไม่ดี หากคุณหวังที่จะเข้าถึงผู้มีโอกาสเป็นลูกค้าให้ได้มากที่สุดเท่าที่จะเป็นไปได้ แพลตฟอร์มการกำหนดเป้าหมายโฆษณาที่ไม่รวมประชากรกลุ่มใหญ่นั้นไม่เหมาะ

แน่นอนว่ามีการแบ่งย่อยที่ใหญ่กว่าหากโฆษณาของเรากำหนดเป้าหมายหรือยกเว้นบางกลุ่มอย่างไม่เป็นธรรม หากโฆษณาอสังหาริมทรัพย์ของคุณเลือกปฏิบัติต่อชนกลุ่มน้อยที่ได้รับการคุ้มครอง คุณอาจเข้าข่ายความผิดตามกฎหมาย Fair Housing Act และ Federal Trade Commision ไม่ต้องพูดถึงเรือการตลาดแบบรวมที่ขาดหายไปโดยสิ้นเชิง

วิธีหลีกเลี่ยงอคติของ AI

แล้วเราจะทำอย่างไรเมื่อเครื่องมือ AI ของเราทำงานอาละวาด? มีสองขั้นตอนที่คุณสามารถทำได้เพื่อให้แน่ใจว่าโฆษณาของคุณปฏิบัติต่อทุกคนอย่างเท่าเทียมกัน

ก่อนอื่น ต้องแน่ใจว่ามีคนรีวิวเนื้อหาของคุณ เขียน Alaura Weaver ผู้จัดการอาวุโสด้านเนื้อหาและชุมชนของ Writer “ในขณะที่เทคโนโลยี AI ก้าวหน้าไปมาก แต่ก็ขาดความสามารถในการคิดเชิงวิพากษ์และการตัดสินใจที่มนุษย์มี” เธออธิบาย “การมีบรรณาธิการที่เป็นมนุษย์ตรวจสอบและตรวจสอบข้อเท็จจริงเนื้อหาที่เขียนโดย AI พวกเขาสามารถมั่นใจได้ว่าเนื้อหานั้นปราศจากอคติและเป็นไปตามมาตรฐานทางจริยธรรม”

การกำกับดูแลโดยมนุษย์จะช่วยลดความเสี่ยงของผลลัพธ์เชิงลบในแคมเปญโฆษณาที่เสียค่าใช้จ่ายด้วย

“ปัจจุบันและอาจไม่มีกำหนด ไม่แนะนำให้ AI เข้าควบคุมแคมเปญหรือรูปแบบการตลาดใดๆ โดยสิ้นเชิง” Brett McHale ผู้ก่อตั้ง Empiric Marketing กล่าว “AI ทำงานได้ดีที่สุดเมื่อได้รับอินพุตที่ถูกต้องจากหน่วยสืบราชการลับอินทรีย์ที่สะสมข้อมูลและประสบการณ์จำนวนมหาศาลไว้แล้ว”

ความเสี่ยง #2: ข้อเท็จจริงที่ผิดพลาด

เมื่อเร็วๆ นี้ Google ประเมินมูลค่าบริษัทแม่ด้วยเงิน 100,000 ล้านดอลลาร์ เมื่อ Bard แชทบอท AI ตัวใหม่ให้คำตอบที่ไม่ถูกต้องในทวีตส่งเสริมการขาย

Bard เป็นบริการ AI เชิงสนทนาเชิงทดลองที่ขับเคลื่อนโดย LaMDA สร้างขึ้นโดยใช้โมเดลภาษาขนาดใหญ่ของเราและดึงข้อมูลจากเว็บ เป็น Launchpad สำหรับความอยากรู้อยากเห็นและสามารถช่วยลดความซับซ้อนของหัวข้อที่ซับซ้อน → https://t.co/fSp531xKy3 pic.twitter.com/JecHXVmt8l

— Google (@Google) 6 กุมภาพันธ์ 2023

ความโง่เขลาของ Google เน้นย้ำถึงหนึ่งในข้อจำกัดที่ใหญ่ที่สุดของ AI และหนึ่งในความเสี่ยงที่ใหญ่ที่สุดสำหรับนักการตลาดที่ใช้มัน นั่นคือ AI ไม่ได้พูดความจริงเสมอไป

AI ประสาทหลอน

Ethan Mollic ศาสตราจารย์แห่ง Wharton School of Business อธิบายระบบที่ขับเคลื่อนด้วย AI เช่น ChatGPT ว่าเป็น "ผู้ฝึกงานที่รอบรู้ กระตือรือร้นที่จะเอาใจ ซึ่งบางครั้งก็โกหก"

แน่นอนว่า AI นั้นไม่มีความรู้สึกแม้ว่าบางคนอาจจะอ้างสิทธิ์ก็ตาม มันไม่ได้ตั้งใจที่จะหลอกลวงเรา อย่างไรก็ตาม มันสามารถทนทุกข์ทรมานจาก "ภาพหลอน" ที่นำไปสู่การสร้างสิ่งต่างๆ

AI เป็นเครื่องทำนาย ดูเหมือนจะเติมคำหรือวลีถัดไปที่จะตอบคำถามของคุณ แต่มันไม่ตระหนักรู้ในตนเอง AI ไม่มีตรรกะตรวจสอบลำไส้ที่จะรู้ว่าสิ่งที่รวมกันนั้นสมเหตุสมผลหรือไม่

ซึ่งแตกต่างจากอคติ ดูเหมือนจะไม่เป็นปัญหาด้านข้อมูล แม้ว่าเครือข่ายจะมีข้อมูลที่ถูกต้อง แต่ก็ยังสามารถบอกเราในสิ่งที่ผิดได้

ลองพิจารณาตัวอย่างนี้ที่ผู้ใช้ถาม ChatGPT ว่า "อาร์เจนตินาคว้าแชมป์ฟุตบอลโลกกี่ครั้ง" มันพูดครั้งเดียวและอ้างถึงชัยชนะของทีมในปี 1978 ทวีตเตอร์ถามว่าทีมใดชนะในปี 1986

ถาม #ChatGPT ว่าทีมไหนคว้าแชมป์ฟุตบอลโลกปี 2022 ก็ตอบไม่ได้ ที่คาดไว้ แต่ดูเหมือนให้ข้อมูลผิด (จากการชนะอีก 2 ครั้ง) ทั้งที่ข้อมูลก็มีอยู่ในระบบแล้ว #คำอธิบายใด ๆ ? pic.twitter.com/fvxe05N12p

— indranil sinharoy (@indranil_leo) วันที่ 29 ธันวาคม 2022

แชทบ็อตยอมรับว่าเป็นอาร์เจนตินาโดยไม่มีคำอธิบายใด ๆ เกี่ยวกับพฤติกรรมในอดีต

ส่วนที่น่าหนักใจคือคำตอบที่ผิดพลาดของ AI มักจะเขียนอย่างมั่นใจ พวกมันผสมผสานเข้ากับข้อความรอบตัว ทำให้ดูเหมือนเป็นไปได้อย่างสมบูรณ์ นอกจากนี้ยังสามารถครอบคลุมรายละเอียดในคดีที่ยื่นฟ้อง Open.ai ซึ่ง ChatGPT ถูกกล่าวหาว่าปรุงแต่งเรื่องราวทั้งหมดของการยักยอกเงินที่นักข่าวนำมาแบ่งปัน

วิธีหลีกเลี่ยงภาพหลอนของ AI

แม้ว่า AI สามารถทำให้คุณหลงทางได้แม้เพียงคำตอบเพียงคำเดียว แต่ก็มีแนวโน้มที่จะออกนอกลู่นอกทางเมื่อเขียนข้อความที่ยาวขึ้น

“จากคำสั่งเดียว AI สามารถสร้างบล็อกหรือ eBook ได้ ใช่ มันน่าทึ่งมาก แต่ก็มีจุดบกพร่องอยู่เหมือนกัน” วีเวอร์เตือน “ยิ่งสร้างมากเท่าไหร่ คุณก็ยิ่งต้องทำการแก้ไขและตรวจสอบข้อเท็จจริงมากขึ้นเท่านั้น”

เพื่อลดโอกาสที่เครื่องมือ AI ของคุณจะเริ่มสร้างเรื่องเล่าชวนหลอน Weaver กล่าวว่าวิธีที่ดีที่สุดคือสร้างโครงร่างและให้บอทจัดการกับมันทีละส่วน จากนั้นให้บุคคลตรวจสอบข้อเท็จจริงและสถิติที่เพิ่มเข้ามา

ความเสี่ยง #3: การใช้เครื่องมือ AI ในทางที่ผิด

ทุกเช้าเราตื่นขึ้นมาพร้อมกับเครื่องมือ AI ใหม่ที่ดูเหมือนจะงอกขึ้นในชั่วข้ามคืนราวกับดอกเห็ดหลังพายุฝน

แต่ไม่ใช่ว่าทุกแพลตฟอร์มจะถูกสร้างขึ้นสำหรับฟังก์ชันทางการตลาดทั้งหมด และความท้าทายทางการตลาดบางอย่าง (ยัง) ไม่สามารถแก้ไขได้ด้วย AI

เครื่องมือ AI มีข้อจำกัด

ChatGPT เป็นตัวอย่างที่ดี ลูกบอล AI เล่นสนุก (เหมือนเขียนวิธีเอาแซนวิชเนยถั่วออกจาก VCR ในสไตล์ของ King James Bible) และมันสามารถทำให้คำตอบสั้น ๆ ที่เขียนได้ดีอย่างน่าประหลาดใจซึ่งทำให้บล็อกของผู้เขียนแตก แต่อย่าขอให้ช่วยคุณทำวิจัยคำหลัก

ChatGPT ล้มเหลวเนื่องจากชุดข้อมูลที่ค่อนข้างเก่าซึ่งมีเฉพาะข้อมูลก่อนปี 2022 ขอให้เสนอคำหลักสำหรับ "การตลาด AI" และคำตอบจะไม่หลอกลวงกับสิ่งที่คุณพบในเครื่องมืออื่นๆ เช่น Thinword หรือ Contextminds

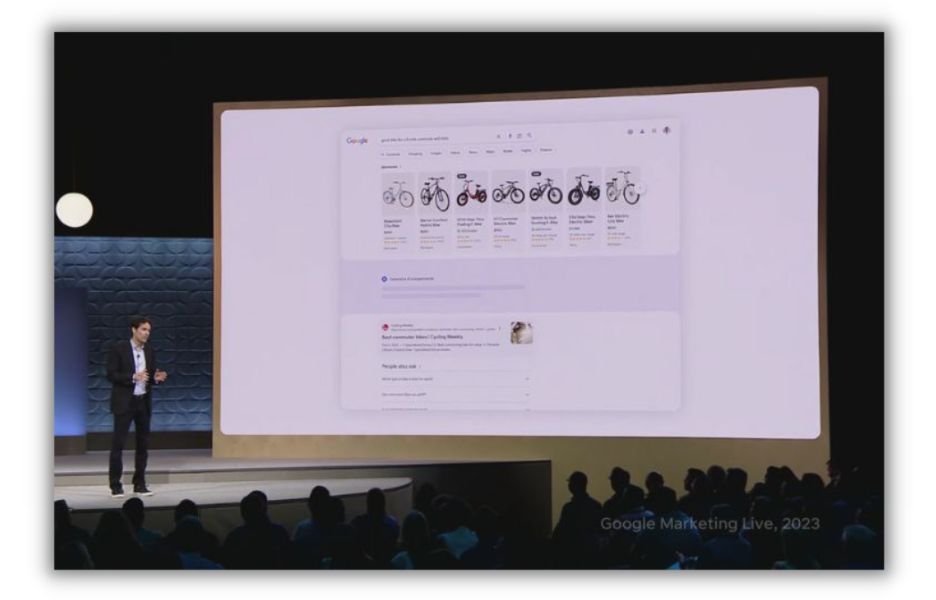

ในทำนองเดียวกัน ทั้ง Google และ Facebook ต่างมีเครื่องมือที่ขับเคลื่อนด้วย AI เพื่อช่วยให้นักการตลาดสร้างโฆษณา เพิ่มประสิทธิภาพการใช้จ่ายโฆษณา และปรับแต่งประสบการณ์โฆษณาในแบบของคุณ แชทบอทไม่สามารถแก้ปัญหาเหล่านั้นได้

Google ประกาศการอัปเกรด AI จำนวนมากสำหรับการค้นหาและผลิตภัณฑ์การจัดการโฆษณาในงาน Google Marketing Live ปี 2023

คุณสามารถใช้ AI มากเกินไป

หากคุณให้เครื่องมือ AI เป็นงานเดียว เครื่องมือนั้นสามารถจัดทำดัชนีเป้าหมายเพียงเป้าหมายเดียวได้ Nick Abbene ผู้เชี่ยวชาญด้านการตลาดอัตโนมัติ เห็นสิ่งนี้บ่อยครั้งกับบริษัทต่างๆ ที่ให้ความสำคัญกับการปรับปรุง SEO ของตน

“ปัญหาใหญ่ที่สุดที่ฉันเห็นคือการใช้เครื่องมือ SEO อย่างสุ่มสี่สุ่มห้า เพิ่มประสิทธิภาพมากเกินไปสำหรับเครื่องมือค้นหา และไม่คำนึงถึงความตั้งใจในการค้นหาของลูกค้า” Abbene กล่าว “เครื่องมือ SEO นั้นยอดเยี่ยมสำหรับการส่งสัญญาณไปยังเครื่องมือค้นหาเนื้อหาที่มีคุณภาพ แต่ท้ายที่สุดแล้ว Google ต้องการจับคู่คำขอของผู้ค้นหา”

วิธีหลีกเลี่ยงการใช้เครื่องมือ AI ในทางที่ผิด

ประแจไม่ใช่ตัวเลือกที่ดีที่สุดสำหรับการทุบตะปู ในทำนองเดียวกัน ผู้ช่วยเขียน AI อาจไม่ดีสำหรับการสร้างหน้าเว็บ ก่อนที่คุณจะเริ่มใช้ตัวเลือก AI ตัวใดตัวหนึ่ง Abbene กล่าวว่าให้รับข้อเสนอแนะจากผู้สร้างเครื่องมือและผู้ใช้รายอื่น

“เพื่อหลีกเลี่ยงการเลือกเครื่องมือ AI ผิดพลาด ให้ทำความเข้าใจว่านักการตลาดรายอื่นใช้เครื่องมือนี้กับกรณีการใช้งานของคุณหรือไม่” เขากล่าว “อย่าลังเลที่จะขอตัวอย่างผลิตภัณฑ์ หรือทดลองใช้ร่วมกับเครื่องมืออื่นๆ ที่มีฟังก์ชันการทำงานเดียวกัน”

เว็บไซต์เช่น Capterra ให้คุณเปรียบเทียบแพลตฟอร์ม AI ต่างๆ ได้อย่างรวดเร็ว

และเมื่อคุณพบกลุ่มเครื่องมือ AI ที่เหมาะสมแล้ว ให้ใช้มันเพื่อช่วยในกระบวนการ ไม่ใช่แทนที่ “อย่ากลัวที่จะใช้เครื่องมือ AI เพื่อเพิ่มขั้นตอนการทำงานของคุณ แต่ใช้เพื่อสิ่งนั้น” Abbene กล่าว “เริ่มเนื้อหาแต่ละชิ้นจากหลักการแรก ด้วยการค้นคว้าคำหลักที่มีคุณภาพและทำความเข้าใจจุดประสงค์ในการค้นหา”

ความเสี่ยง #4: เนื้อหาที่เป็นเนื้อเดียวกัน

AI สามารถเขียนเรียงความทั้งหมดได้ในเวลาประมาณ 10 วินาที แต่ในขณะที่ AI เจเนอเรทีฟกลายเป็นสิ่งที่น่าประทับใจ มันขาดความแตกต่างเล็กน้อยที่จะสร้างสรรค์อย่างแท้จริง ทำให้ผลลัพธ์ออกมามักจะให้ความรู้สึกเหมือนหุ่นยนต์

“ในขณะที่ AI นั้นยอดเยี่ยมในการผลิตเนื้อหาที่ให้ข้อมูล แต่ก็มักจะขาดความคิดสร้างสรรค์และการมีส่วนร่วมที่มนุษย์นำมาสู่โต๊ะ” Weaver กล่าว

AI ถูกสร้างมาเพื่อเลียนแบบ

ขอให้บอทการเขียน AI เชิงสร้างสรรค์เขียนรายงานหนังสือของคุณ และมันจะหมุนคำศัพท์ 500 คำที่อธิบายธีมหลักของ Catcher in the Rye ได้อย่างง่ายดาย (สมมติว่ามันไม่ได้ทำให้ภาพหลอนของ Holden Caulfield เป็นโจรปล้นธนาคาร)

ที่ทำเช่นนี้ได้เพราะได้รวบรวมข้อความเกี่ยวกับผลงานชิ้นเอกของ J.D. Salinger ไว้เป็นพันๆ เล่ม

ตอนนี้ ขอให้เพื่อน AI ของคุณเขียนบล็อกโพสต์ที่อธิบายแนวคิดหลักสำหรับธุรกิจของคุณในลักษณะที่สรุปแบรนด์ ผู้ชม และคุณค่าที่นำเสนอ คุณอาจจะผิดหวัง “เนื้อหาที่สร้างโดย AI ไม่ได้คำนึงถึงความแตกต่างของบุคลิกภาพและคุณค่าของแบรนด์เสมอไป และอาจสร้างเนื้อหาที่ขาดเครื่องหมาย” Weaver กล่าว

กล่าวอีกนัยหนึ่ง AI นั้นยอดเยี่ยมในการย่อย ผสมผสาน และกำหนดค่าใหม่ให้กับสิ่งที่สร้างขึ้นแล้ว การสร้างสิ่งที่โดดเด่นกว่าเนื้อหาที่มีอยู่นั้นไม่ดีนัก

เครื่องมือ Generative AI ยังทำได้ไม่ดีนักในการสร้างเนื้อหาให้มีส่วนร่วม พวกเขาจะปั่นคำศัพท์จำนวนมากอย่างมีความสุขโดยไม่ต้องใช้รูปภาพ กราฟ หรือสัญลักษณ์แสดงหัวข้อย่อยเพื่อให้ดวงตาที่เหนื่อยล้าได้พัก พวกเขาจะไม่ดึงเรื่องราวของลูกค้าหรือตัวอย่างสมมุติฐานมาเพื่อทำให้ประเด็นมีความเกี่ยวข้องมากขึ้น และพวกเขาต้องดิ้นรนเพื่อเชื่อมโยงข่าวจากอุตสาหกรรมของคุณกับผลประโยชน์ที่ผลิตภัณฑ์ของคุณมอบให้

วิธีหลีกเลี่ยงเนื้อหาที่เป็นเนื้อเดียวกัน

เครื่องมือ AI บางอย่าง เช่น Writer มีฟีเจอร์ในตัวเพื่อช่วยให้นักเขียนรักษาบุคลิกของแบรนด์ที่สอดคล้องกัน แต่คุณยังต้องการบรรณาธิการเพื่อ "ตรวจทานและแก้ไขเนื้อหาสำหรับเสียงและโทนของแบรนด์เพื่อให้แน่ใจว่าเนื้อหานั้นโดนใจผู้ชมและส่งเสริมข้อความและวัตถุประสงค์ขององค์กร" Weaver ให้คำแนะนำ

บรรณาธิการและนักเขียนยังสามารถดูบทความได้เหมือนกับที่คนอื่นเห็น หากมีกลุ่มคำที่เข้าไม่ถึง พวกเขาก็จะเป็นคนแยกมันออกและเพิ่ม zhuzh ที่มองเห็นได้เล็กน้อย

ใช้เนื้อหา AI เป็นจุดเริ่มต้น เพื่อช่วยกระตุ้นความคิดสร้างสรรค์และการวิจัยของคุณ แต่มักจะเพิ่มสัมผัสส่วนตัวของคุณเอง

ความเสี่ยง #5: การสูญเสีย SEO

จุดยืนของ Google เกี่ยวกับเนื้อหา AI ค่อนข้างคลุมเครือ ในตอนแรก ดูเหมือนว่าเครื่องมือค้นหาจะลงโทษโพสต์ที่เขียนด้วย AI

[ภาพ: ทวีตจาก John Mueller บน AI]

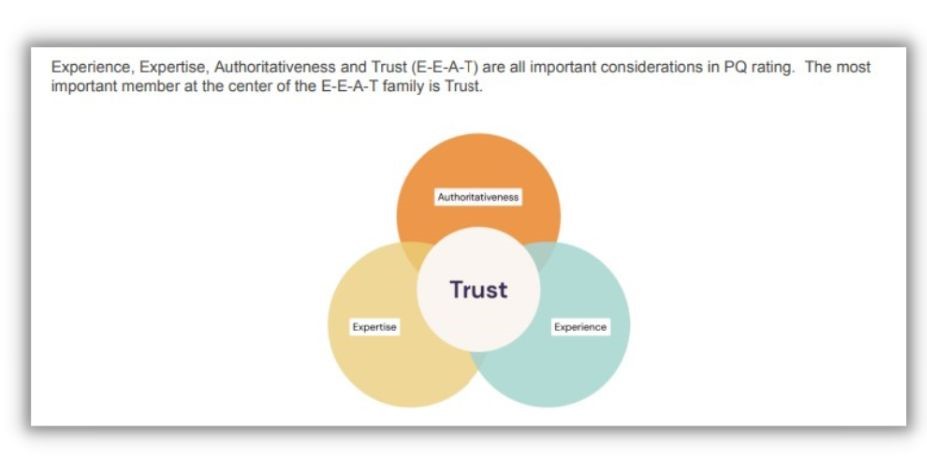

เมื่อเร็ว ๆ นี้ บล็อกนักพัฒนาของ Google กล่าวว่า AI นั้นใช้ได้ในหนังสือของพวกเขา แต่มีพริบตาที่สำคัญกับการยืนยันนั้น เฉพาะ "เนื้อหาที่แสดงให้เห็นถึงคุณสมบัติของสิ่งที่เราเรียกว่า EEAT: ความเชี่ยวชาญ ประสบการณ์ อำนาจ และความน่าเชื่อถือ" เท่านั้นที่จะสร้างความประทับใจให้กับผู้ประเมินการค้นหาโดยมนุษย์ที่ประเมินระบบการจัดอันดับของ Google อย่างต่อเนื่อง

ความน่าเชื่อถือคือกุญแจสำคัญสำหรับ SEO

ในบรรดา EEAT ของ Google ปัจจัยเดียวที่ควบคุมทั้งหมดคือความไว้วางใจ

[แหล่งที่มา]

เราได้พูดคุยกันแล้วว่าเนื้อหาของ AI มีแนวโน้มที่จะเข้าใจผิด ทำให้ไม่น่าเชื่อถือโดยเนื้อแท้หากไม่มีการดูแลจากมนุษย์ นอกจากนี้ยังไม่เป็นไปตามข้อกำหนดการสนับสนุนเนื่องจากโดยธรรมชาติแล้ว เนื้อหาดังกล่าวไม่ได้เขียนขึ้นโดยบุคคลที่มีความเชี่ยวชาญ มีอำนาจ หรือมีประสบการณ์ในหัวข้อนี้

ใช้โพสต์บล็อกเกี่ยวกับการอบขนมปังกล้วย บอท AI จะให้สูตรอาหารแก่คุณภายในสองวินาที แต่มันไม่สามารถเขียนบทกวีได้ในวันฤดูหนาวที่อากาศหนาวเย็นใช้เวลาทำขนมให้ครอบครัวของมัน หรือพูดคุยเกี่ยวกับเวลาหลายปีที่ทดลองใช้แป้งประเภทต่างๆ ในฐานะนักทำขนมปังเชิงพาณิชย์ มุมมองเหล่านี้คือสิ่งที่ผู้ให้คะแนนการค้นหาของ Google มองหา

ดูเหมือนว่าจะเป็นสิ่งที่ผู้คนปรารถนาเช่นกัน นั่นเป็นเหตุผลที่พวกเขาจำนวนมากหันไปหาคนจริงในวิดีโอ TikTok เพื่อเรียนรู้สิ่งที่พวกเขาเคยพบใน Google

ทำอย่างไรไม่ให้สูญเสีย SEO

สิ่งที่ยอดเยี่ยมเกี่ยวกับ AI คือมันไม่รังเกียจที่จะแชร์บรรทัดย่อย ดังนั้น เมื่อคุณใช้แชทบอทเพื่อเพิ่มความเร็วในการผลิตเนื้อหา ตรวจสอบให้แน่ใจว่าคุณอ้างอิงผู้เขียนที่เป็นมนุษย์ด้วยข้อมูลประจำตัว

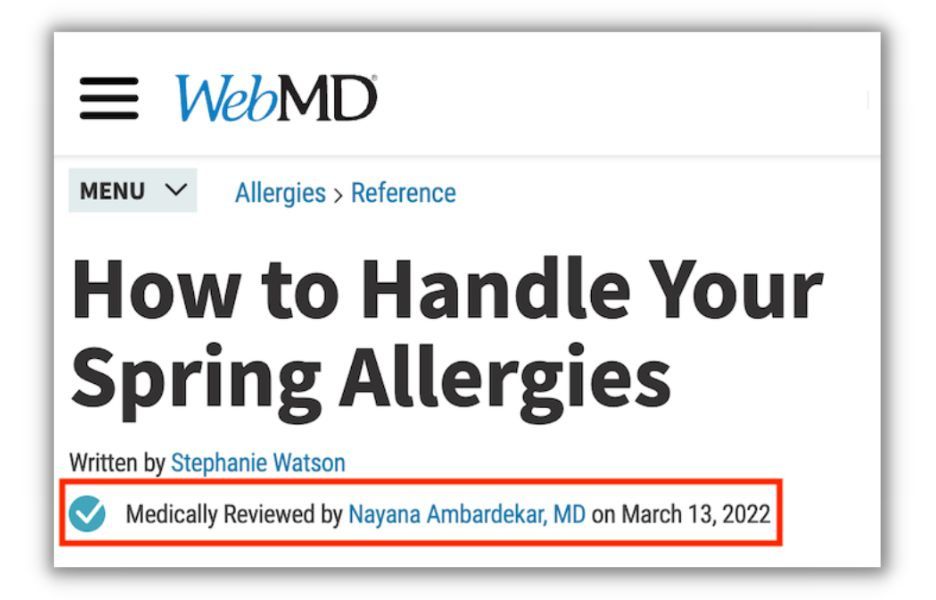

โดยเฉพาะอย่างยิ่งสำหรับหัวข้อที่ละเอียดอ่อน เช่น การดูแลสุขภาพและการเงินส่วนบุคคล ซึ่ง Google เรียกว่าหัวข้อ Your Money, Your Life “หากคุณอยู่ในประเภทธุรกิจประเภท YMYL ให้จัดลำดับความสำคัญของอำนาจ ความน่าเชื่อถือ และความถูกต้องเหนือสิ่งอื่นใดในเนื้อหาของคุณ” Elisa Gabbert ผู้อำนวยการฝ่ายเนื้อหาและ SEO ของ WordStream และ LocaliQ ให้คำแนะนำ

ตัวอย่างเช่น เมื่อเขียนเกี่ยวกับการดูแลสุขภาพ ให้โพสต์ของคุณตรวจสอบโดยผู้เชี่ยวชาญทางการแพทย์และอ้างอิงในโพสต์นั้น นั่นเป็นสัญญาณที่ชัดเจนสำหรับ Google ว่าเนื้อหาของคุณเชื่อถือได้ แม้ว่าจะเริ่มต้นจากแชทบอทก็ตาม

ความเสี่ยง #6: ความท้าทายทางกฎหมาย

Generative AI เรียนรู้จากงานที่มนุษย์สร้างขึ้น จากนั้นสร้างสิ่งใหม่ (ใช่) คำถามเกี่ยวกับลิขสิทธิ์นั้นไม่ชัดเจนสำหรับทั้งอินพุตและเอาต์พุตของโมเดลเนื้อหา AI

งานที่มีอยู่น่าจะเป็นเกมที่ยุติธรรมสำหรับ AI

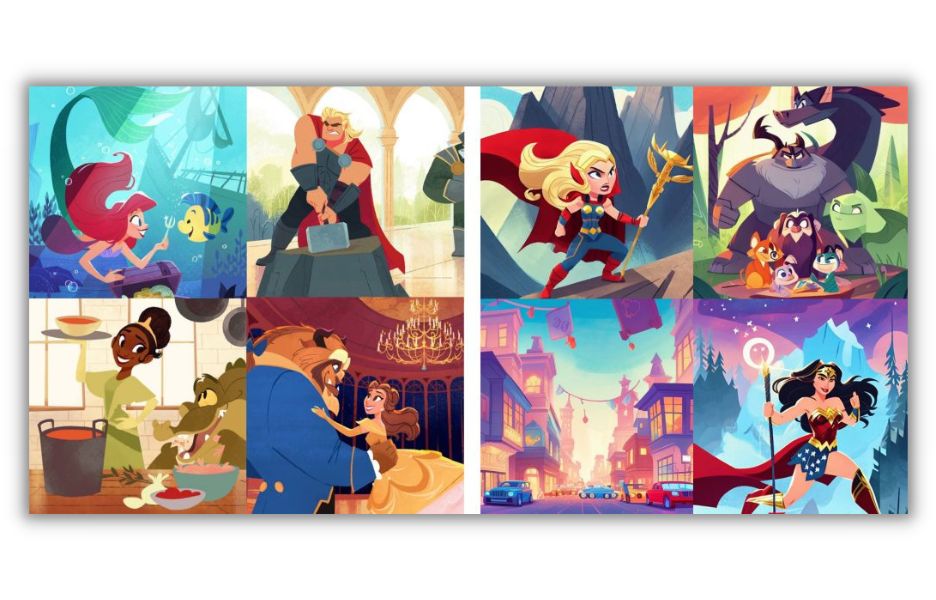

เพื่ออธิบาย (ตั้งใจเล่นสำนวน) คำถามเกี่ยวกับลิขสิทธิ์สำหรับผลงานที่ป้อนรูปแบบการเรียนรู้ขนาดใหญ่ เราหันไปดูกรณีที่รายงานโดยนักเทคโนโลยี Andy Baio ตามที่ Baio อธิบาย ศิลปินชื่อ Hollie Mengert จาก LA ได้เรียนรู้ว่าภาพวาดของเธอ 32 ภาพถูกดูดซึมเข้าสู่โมเดล AI จากนั้นจึงเสนอใบอนุญาตแบบเปิดให้กับใครก็ตามที่ต้องการสร้างสไตล์ของเธอขึ้นมาใหม่

คำอธิบายภาพ: คอลเลกชันภาพประกอบของศิลปิน Hollie Mengert (ซ้าย) เปรียบเทียบกับภาพประกอบที่สร้างโดย AI ตามสไตล์ของเธอ ซึ่งดูแลโดย Andy Baio

เรื่องราวซับซ้อนมากขึ้นเมื่อคุณรู้ว่าเธอสร้างภาพหลายภาพให้กับลูกค้าอย่างดิสนีย์ ซึ่งจริงๆ แล้วเป็นเจ้าของลิขสิทธิ์ภาพเหล่านั้น

นักวาดภาพประกอบ (หรือนักเขียนหรือผู้เขียนโค้ด) ที่พบว่าตัวเองอยู่ในจุดเดียวกับ Mengert สามารถฟ้องร้องการละเมิดลิขสิทธิ์ได้สำเร็จหรือไม่

ยังไม่มีคำตอบที่ชัดเจนสำหรับคำถาม “ฉันเห็นผู้คนจากทั้งสองฝ่ายมีความมั่นใจอย่างมากในตำแหน่งของพวกเขา แต่ความจริงก็คือไม่มีใครรู้” Baio กล่าวกับ The Verge “และใครก็ตามที่บอกว่าพวกเขารู้อย่างมั่นใจว่าเรื่องนี้จะจบลงอย่างไรในศาล ถือว่าผิด”

หาก AI ที่คุณใช้สร้างภาพหรือบทความได้รับการฝึกอบรมเกี่ยวกับผลงานหลายพันรายการจากผู้สร้างหลายคน คุณไม่น่าจะแพ้คดีในศาล แต่ถ้าคุณป้อนหนังสือสตีเฟน คิง 10 เล่มให้กับเครื่องและบอกให้บอทเขียนใหม่ในรูปแบบนั้น คุณอาจประสบปัญหา

ข้อจำกัดความรับผิดชอบ: เราไม่ใช่ทนายความ ดังนั้นโปรดขอคำแนะนำทางกฎหมายหากคุณไม่แน่ใจ

เนื้อหา AI ของคุณอาจไม่ได้รับการปกป้องเช่นกัน

แล้วเนื้อหาที่คุณสร้างโดยใช้แชทบอทนั้นอยู่ภายใต้กฎหมายลิขสิทธิ์หรือไม่? ส่วนใหญ่จะไม่เกิดขึ้นจนกว่าคุณจะทำงานแก้ไขได้มากพอ ซึ่งหมายความว่าคุณจะต้องขอความช่วยเหลือเพียงเล็กน้อยหากมีคนนำโพสต์ของคุณไปใช้ซ้ำ (อ่าน: ขโมย) สำหรับบล็อกของพวกเขาเอง

สำหรับเนื้อหาที่ได้รับการคุ้มครองนั้นอาจเป็นโปรแกรมเมอร์ของ AI ไม่ใช่คุณที่ถือสิทธิ์ หลายประเทศถือว่าผู้สร้างเครื่องมือที่ผลิตงานนั้นเป็นผู้สร้าง ไม่ใช่บุคคลที่พิมพ์ข้อความแจ้ง

วิธีหลีกเลี่ยงความท้าทายทางกฎหมาย

เริ่มต้นด้วยการใช้เครื่องมือสร้างเนื้อหา AI ที่มีชื่อเสียง ค้นหาบริษัทที่มีบทวิจารณ์เชิงบวกมากมายที่จัดทำโดยบริษัทที่แสดงจุดยืนอย่างชัดเจนเกี่ยวกับกฎหมายลิขสิทธิ์

นอกจากนี้ โปรดใช้วิจารณญาณของคุณเพื่อตัดสินใจว่าคุณจงใจคัดลอกงานของผู้สร้างหรือเพียงใช้ AI เพื่อเสริมแต่งผลงานของคุณเอง

และถ้าคุณต้องการโอกาสต่อสู้ในศาลเพื่อปกป้องสิ่งที่คุณผลิต ให้ทำการเปลี่ยนแปลงมากมาย หรือใช้ AI เพื่อช่วยสร้างโครงร่าง แต่เขียนคำศัพท์ส่วนใหญ่ด้วยตัวคุณเอง

ความเสี่ยง #7: การละเมิดความปลอดภัยและความเป็นส่วนตัว

เครื่องมือ AI นำเสนอนักการตลาดด้วยภัยคุกคามที่หลากหลายต่อความปลอดภัยของระบบและความเป็นส่วนตัวของข้อมูล บางส่วนเป็นการโจมตีโดยตรงจากผู้ไม่ประสงค์ดี คนอื่น ๆ เป็นเพียงผู้ใช้ที่ให้ข้อมูลที่สำคัญโดยไม่เจตนากับระบบที่ออกแบบมาเพื่อแบ่งปัน

ความเสี่ยงด้านความปลอดภัยจากเครื่องมือ AI

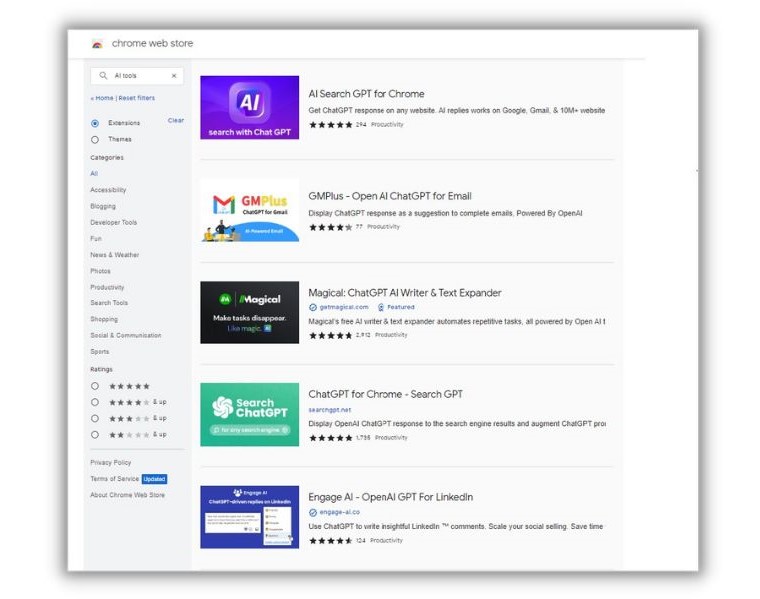

“มีผลิตภัณฑ์มากมายที่ดู ให้ความรู้สึก และทำงานเหมือนกับเครื่องมือที่ถูกกฎหมาย แต่แท้จริงแล้วเป็นมัลแวร์” Elaine Atwell บรรณาธิการอาวุโสฝ่ายการตลาดเนื้อหาของ Kolide ผู้ให้บริการรักษาความปลอดภัยปลายทางบอกกับเรา “มันยากมากที่จะแยกแยะความแตกต่างจากเครื่องมือที่ถูกกฎหมาย และคุณสามารถหาได้จาก Chrome Store ในตอนนี้”

พิมพ์ “เครื่องมือ AI” เวอร์ชันใดก็ได้ในร้านค้า Google Chrome แล้วคุณจะพบกับตัวเลือกมากมาย

Atwell เขียนเกี่ยวกับความเสี่ยงเหล่านี้ในบล็อก Kolide ในบทความของเธอ เธออ้างถึงเหตุการณ์ที่ส่วนขยายของ Chrome ที่ชื่อ “การเข้าถึงด่วนไปยัง Chat GPT” เป็นอุบายจริงๆ เมื่อดาวน์โหลดแล้ว ซอฟต์แวร์จะไฮแจ็กบัญชี Facebook ของผู้ใช้และรูดคุกกี้ของเหยื่อทั้งหมด แม้กระทั่งคุกกี้เพื่อความปลอดภัย มีคนดาวน์โหลดส่วนขยายมากกว่า 2,000 คนทุกวัน Atwell รายงาน

ความเป็นส่วนตัวไม่มีการป้องกัน

Atwell กล่าวว่าแม้แต่เครื่องมือ AI ที่ถูกต้องก็ยังมีความเสี่ยงด้านความปลอดภัย “…ตอนนี้ บริษัทส่วนใหญ่ยังไม่มีนโยบายในการประเมินประเภทและระดับของความเสี่ยงที่เกิดจากการขยายเวลาต่างๆ และหากไม่มีคำแนะนำที่ชัดเจน ผู้คนทั่วโลกกำลังติดตั้งตัวช่วยตัวน้อยเหล่านี้และให้ข้อมูลที่ละเอียดอ่อนแก่พวกเขา”

สมมติว่าคุณกำลังเขียนรายงานทางการเงินภายในเพื่อแบ่งปันกับนักลงทุน โปรดจำไว้ว่าเครือข่าย AI เรียนรู้จากสิ่งที่พวกเขาได้รับเพื่อสร้างผลลัพธ์สำหรับผู้ใช้รายอื่น ข้อมูลทั้งหมดที่คุณใส่ไว้ในแชทบอท AI อาจเป็นเกมที่ยุติธรรมสำหรับผู้คนภายนอกบริษัทของคุณ และอาจปรากฏขึ้นหากคู่แข่งถามถึงผลกำไรของคุณ

วิธีหลีกเลี่ยงความเสี่ยงด้านความเป็นส่วนตัวและความปลอดภัย

แนวป้องกันแรกคือต้องแน่ใจว่าซอฟต์แวร์ชิ้นหนึ่งเป็นสิ่งที่อ้างว่าเป็น นอกเหนือจากนั้น โปรดใช้ความระมัดระวังเกี่ยวกับวิธีการใช้เครื่องมือที่คุณเลือก “หากคุณกำลังจะใช้เครื่องมือ AI (และมันก็มีประโยชน์!) อย่าป้อนข้อมูลใด ๆ ที่อาจถือว่าละเอียดอ่อน” Atwell กล่าว

นอกจากนี้ ในขณะที่คุณตรวจสอบเครื่องมือ AI เพื่อประโยชน์และอคติ ให้ถามเกี่ยวกับนโยบายความเป็นส่วนตัวและความปลอดภัยของพวกเขา

ลดความเสี่ยงจากการใช้ AI เพื่อการตลาด

AI กำลังก้าวหน้าในอัตราที่เหลือเชื่อ ภายในเวลาไม่ถึงหนึ่งปี Chat GTP ได้เห็นความสามารถที่เพิ่มขึ้นอย่างมาก เป็นไปไม่ได้เลยที่จะรู้ว่าเราจะสามารถทำอะไรกับ AI ได้ในอีกหกถึงสิบสองเดือนข้างหน้า เราไม่สามารถคาดการณ์ถึงปัญหาที่อาจเกิดขึ้นได้

ต่อไปนี้เป็นหลายวิธีที่คุณสามารถปรับปรุงผลลัพธ์ทางการตลาด AI ของคุณในขณะที่หลีกเลี่ยงความเสี่ยงที่พบบ่อยที่สุด:

- ให้บรรณาธิการที่เป็นมนุษย์ตรวจสอบเนื้อหาในด้านคุณภาพ อ่านง่าย และแสดงความคิดเห็นเกี่ยวกับแบรนด์

- ตรวจสอบแต่ละเครื่องมือที่คุณใช้เพื่อความปลอดภัยและความสามารถ

- ตรวจสอบการกำหนดเป้าหมายโฆษณาที่กำกับโดย AI อย่างสม่ำเสมอเพื่อหาอคติ

- ประเมินสำเนาและภาพสำหรับการละเมิดลิขสิทธิ์ที่อาจเกิดขึ้น

เราขอขอบคุณ Elain Attwell, Brett McHale, Nick Abenne และ Alaura Weaver ที่มีส่วนร่วมในโพสต์นี้

สรุปคือ เรามาทบทวนรายการความเสี่ยงที่มาพร้อมกับการใช้ AI เพื่อการตลาด:

- อคติการเรียนรู้ของเครื่อง

- ข้อเท็จจริงที่ผิดพลาด

- การใช้เครื่องมือ AI ในทางที่ผิด

- เนื้อหาที่เป็นเนื้อเดียวกัน

- การสูญเสีย SEO

- ความท้าทายทางกฎหมาย

- การละเมิดความปลอดภัยและความเป็นส่วนตัว