SEO'da yapay zeka: Yasal zorlukların üstesinden nasıl gelinir ve uyumluluk nasıl sağlanır?

Yayınlanan: 2023-09-26Yapay zeka (AI), çevrimiçi varlıklarını geliştirmek isteyen markalar için hayati bir araç olmaya hazırlanıyor.

Ancak yapay zekanın pazarlama stratejilerine entegre edilmesi kaçınılmaz olarak yasal hususları ve ajansların dikkatli bir şekilde yönetmesi gereken yeni düzenlemeleri ortaya çıkarıyor.

Bu makalede şunları keşfedeceksiniz:

- İşletmeler, SEO ve medya ajansları, yapay zeka ile geliştirilmiş stratejilerin uygulanmasına ilişkin yasal riskleri nasıl en aza indirebilir?

- Yapay zeka önyargısını azaltacak faydalı araçlar ve yapay zeka tarafından oluşturulan içerik kalitesini incelemek için kullanışlı bir süreç.

- Ajanslar, müşterilerinin verimliliğini ve uyumluluğunu sağlamak için yapay zeka uygulama zorluklarının üstesinden nasıl gelebilir?

Yasal uyumluluk hususları

Fikri mülkiyet ve telif hakkı

Yapay zekayı SEO ve medyada kullanırken önemli bir hukuki husus, fikri mülkiyet ve telif hakkı yasalarına uymaktır.

Yapay zeka sistemleri genellikle telif hakkıyla korunan materyaller de dahil olmak üzere büyük miktarda veriyi toplayıp analiz eder.

Telif hakkı ve gizlilik ihlalleri nedeniyle OpenAI'ye karşı halihazırda çok sayıda dava var.

Şirket, telif hakkıyla korunan kitapların ChatGPT'yi eğitmek için izinsiz kullanıldığı ve makine öğrenimi modellerini kullanarak internet kullanıcılarından kişisel bilgilerin yasadışı bir şekilde toplandığı iddiasıyla davalarla karşı karşıya.

OpenAI'nin kullanıcı verilerini işlemesi ve kaydetmesiyle ilgili gizlilik endişeleri de İtalya'nın Mart ayı sonunda ChatGPT kullanımını tamamen engellemesine neden oldu.

Şirketin, chatbot'un kullanıcı verileri işlemesinde şeffaflığı artırmak ve ChatGPT'nin eğitim algoritmaları için kullanılan konuşmalarından vazgeçme seçeneği eklemek için değişiklikler yapmasının ardından yasak kaldırıldı.

Ancak OpenAI'nin tarayıcısı GPTBot'un piyasaya sürülmesiyle birlikte başka yasal hususların ortaya çıkması muhtemeldir.

Olası yasal sorunlardan ve ihlal iddialarından kaçınmak için ajanslar, tüm yapay zeka modellerinin yetkili veri kaynakları üzerinde eğitildiğinden ve telif hakkı kısıtlamalarına uyduğundan emin olmalıdır:

- Verilerin yasal olarak elde edildiğinden ve ajansın bunları kullanmak için uygun haklara sahip olduğundan emin olun.

- Gerekli yasal izinlere sahip olmayan veya kalitesiz verileri filtreleyin.

- Veri kullanım haklarına ve yasalara uygun olduklarından emin olmak için veri ve yapay zeka modellerini düzenli olarak denetleyin.

- Hiçbir şeyin yasal politikalarla çelişmediğinden emin olmak için veri hakları ve gizlilik konusunda hukuki danışmanlık yapın.

Yapay zeka modellerinin iş akışlarına ve projelere entegre edilebilmesi için hem ajansın hem de müşteri hukuk ekiplerinin muhtemelen yukarıdaki tartışmalara katılması gerekecektir.

Veri gizliliği ve koruması

Yapay zeka teknolojileri büyük ölçüde hassas kişisel bilgiler içerebilecek verilere dayanır.

Kullanıcı verilerinin toplanması, saklanması ve işlenmesi, Avrupa Birliği'ndeki Genel Veri Koruma Yönetmeliği (GDPR) gibi ilgili gizlilik yasalarına uygun olmalıdır.

Dahası, yakın zamanda tanıtılan AB Yapay Zeka Yasası, yapay zeka sistemleriyle ilişkili veri gizliliği endişelerinin ele alınmasını da vurguluyor.

Bu haksız değil. Samsung gibi büyük şirketler, ChatGPT'ye yüklenen gizli verilerin açığa çıkması nedeniyle yapay zekayı tamamen yasakladı.

Bu nedenle ajanslar müşteri verilerini yapay zeka teknolojisiyle birlikte kullanıyorsa şunları yapmalıdır:

- Veri toplamada şeffaflığa öncelik verin.

- Kullanıcının onayını alın.

- Hassas bilgileri korumak için sağlam güvenlik önlemleri uygulayın.

Bu durumlarda kurumlar, kullanıcılara hangi verilerin toplanacağını, nasıl kullanılacağını ve bu verilere kimlerin erişebileceğini açıkça bildirerek veri toplamada şeffaflığa öncelik verebilir.

Kullanıcı onayı almak için, veri toplamanın amacını ve faydalarını açıklayan, açık ve anlaşılması kolay onay formları aracılığıyla onayın bilgilendirildiğinden ve özgürce verildiğinden emin olun.

Ayrıca, sağlam güvenlik önlemleri şunları içerir:

- Veri şifreleme.

- Giriş kontrolu.

- Verilerin anonimleştirilmesi (mümkün olduğu durumlarda).

- Düzenli denetimler ve güncellemeler.

Örneğin, OpenAI'nin politikaları veri gizliliği ve koruma ihtiyacıyla uyumludur ve yapay zeka uygulamalarında şeffaflığı, kullanıcı rızasını ve veri güvenliğini teşvik etmeye odaklanır.

Adalet ve önyargı

SEO ve medyada kullanılan yapay zeka algoritmaları, yanlışlıkla önyargıları sürdürme veya belirli kişilere veya gruplara karşı ayrımcılık yapma potansiyeline sahiptir.

Ajansların algoritmik önyargıyı belirleme ve azaltma konusunda proaktif olmaları gerekir. Bu, yapay zeka sistemlerinin insan davranışını adil olmayan bir şekilde etkilemesini veya ayrımcı davranışlar sergilemesini yasaklayan yeni AB Yapay Zeka Yasası kapsamında özellikle önemlidir.

Bu riski azaltmak için kurumlar, yapay zeka modellerinin tasarımına farklı veri ve bakış açılarının dahil edilmesini sağlamalı ve potansiyel önyargı ve ayrımcılık açısından sonuçları sürekli olarak izlemelidir.

Bunu başarmanın bir yolu, AI Fairness 360, IBM Watson Studio ve Google'ın What-If Tool gibi önyargıyı azaltmaya yardımcı olan araçları kullanmaktır.

Yanlış veya yanıltıcı içerik

ChatGPT de dahil olmak üzere yapay zeka araçları, hatalı, yanıltıcı veya sahte olabilecek sentetik içerik üretebilir.

Örneğin yapay zeka, belirli yerleri veya ürünleri tanıtmak için sıklıkla sahte çevrimiçi incelemeler oluşturur. Bu, yapay zeka tarafından oluşturulan içeriğe güvenen işletmeler için olumsuz sonuçlara yol açabilir.

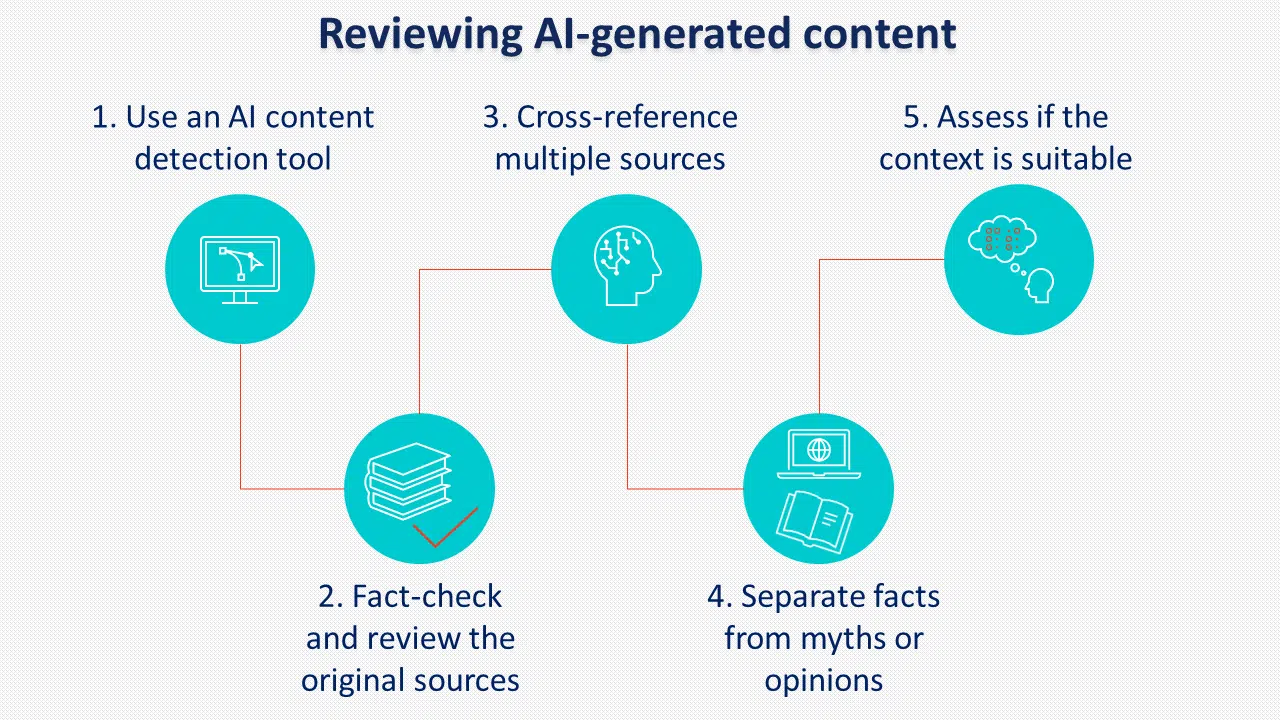

Yapay zeka tarafından oluşturulan içeriğin yayınlanmadan önce incelenmesine yönelik net politika ve prosedürlerin uygulanması, bu riski önlemek açısından çok önemlidir.

Göz önünde bulundurulması gereken diğer bir uygulama da yapay zeka tarafından oluşturulan içeriği etiketlemektir. Google bunu uygulamıyor gibi görünse de birçok politika yapıcı yapay zeka etiketlemeyi destekliyor.

Sorumluluk ve sorumluluk

Yapay zeka sistemleri karmaşıklaştıkça sorumluluk soruları da ortaya çıkıyor.

Yapay zekayı kullanan kurumlar, aşağıdakiler de dahil olmak üzere yapay zekanın kullanımından kaynaklanan her türlü istenmeyen sonucun sorumluluğunu almaya hazır olmalıdır:

- İşe alınacak adayları sıralamak için yapay zekayı kullanırken önyargı ve ayrımcılık.

- Yapay zekanın gücünü siber saldırılar gibi kötü amaçlarla kötüye kullanma potansiyeli.

- Bilgilerin izinsiz toplanması durumunda mahremiyet kaybı.

AB Yapay Zeka Yasası, kullanıcıların haklarını önemli ölçüde etkileyebilecek yüksek riskli yapay zeka sistemlerine ilişkin yeni hükümler getirerek kurumların ve müşterilerin yapay zeka teknolojilerini kullanırken neden ilgili şartlara ve politikalara uymaları gerektiğini vurguluyor.

OpenAI'nin en önemli şart ve politikalarından bazıları kullanıcı tarafından sağlanan içerik, yanıtların doğruluğu ve kişisel verilerin işlenmesiyle ilgilidir.

İçerik politikası, OpenAI'nin oluşturulan içeriğin haklarını kullanıcıya atadığını belirtir. Ayrıca oluşturulan içeriğin, yasal sınırlamalara uygun olması koşuluyla ticari amaç da dahil olmak üzere her türlü amaçla kullanılabileceğini de belirtiyor.

Ancak aynı zamanda çıktının ne tamamen benzersiz ne de doğru olmayabileceğini, yani yapay zeka tarafından oluşturulan içeriğin kullanımdan önce her zaman kapsamlı bir şekilde incelenmesi gerektiğini belirtiyor.

Kişisel veri notunda OpenAI, dosya yüklemeleri de dahil olmak üzere kullanıcıların girdiği tüm bilgileri toplar.

Kişisel verileri işlemek için hizmeti kullanırken, kullanıcılar yasal olarak yeterli gizlilik bildirimlerini sağlamalı ve veri işleme talebinde bulunmak için bir form doldurmalıdır.

Ajanslar, sorumluluk sorunlarını proaktif bir şekilde ele almalı, yapay zeka çıktılarını izlemeli ve olası yasal yükümlülükleri azaltmak için sağlam kalite kontrol önlemleri uygulamalıdır.

Pazarlamacıların güvendiği günlük haber bülteni aramasını alın.

Şartlara bakın.

Ajanslar için yapay zeka uygulama zorlukları

OpenAI geçen yıl ChatGPT'yi piyasaya sürdüğünden beri, üretken yapay zekanın bir meslek olarak SEO'yu ve bunun medya endüstrisi üzerindeki genel etkisini nasıl değiştireceği konusunda birçok konuşma yapıldı.

Değişiklikler günlük iş yükünde çeşitli iyileştirmelerle birlikte gelse de kurumların yapay zekayı müşterinin stratejilerine uygularken dikkate alması gereken bazı zorluklar var.

Eğitim ve farkındalık

Birçok müşteri, yapay zeka ve onun etkileri hakkında kapsamlı bir anlayışa sahip olmayabilir.

Bu nedenle ajanslar, müşterilerini yapay zeka uygulamasıyla ilgili potansiyel faydalar ve riskler konusunda eğitme zorluğuyla karşı karşıyadır.

Gelişen düzenleyici ortam, yasal uyumluluğun sağlanması için alınan önlemler konusunda müşterilerle net bir iletişim kurulmasını gerektirmektedir.

Bunu başarmak için ajansların şunları yapması gerekir:

- Müşterilerinin hedeflerini net bir şekilde anlayın.

- Faydalarını açıklayabileceksiniz.

- Yapay zekanın uygulanmasında uzmanlığınızı gösterin.

- Zorlukları ve riskleri ele alın.

Bunu yapmanın bir yolu, gerekli tüm bilgileri içeren bir bilgi notunun müşterilerle paylaşılması ve mümkünse yapay zekanın kullanımından nasıl yararlanabilecekleri konusunda vaka çalışmaları veya diğer örneklerin sağlanmasıdır.

Kaynak tahsisi

Yapay zekayı SEO ve medya stratejilerine entegre etmek; finansal yatırımlar, vasıflı personel ve altyapı yükseltmeleri dahil olmak üzere önemli kaynaklar gerektirir.

Ajanslar, birlikte etkili bir şekilde işbirliği yapabilen yapay zeka uzmanlarına, veri analistlerine, SEO ve içerik uzmanlarına ihtiyaç duyabilecekleri için, kendi bütçe kısıtlamaları dahilinde yapay zeka çözümlerini uygulamanın fizibilitesini belirlemek için müşterilerinin ihtiyaçlarını ve yeteneklerini dikkatli bir şekilde değerlendirmelidir.

Altyapı ihtiyaçları, içgörü elde etmek için yapay zeka araçlarını, veri işlemeyi ve analiz platformlarını içerebilir. Hizmet sağlamak mı yoksa dış kaynakları kolaylaştırmak mı her kurumun mevcut yeteneklerine ve bütçesine bağlıdır.

Diğer kurumlardan dış kaynak kullanmak, uygulamanın daha hızlı yapılmasını sağlayabilirken, şirket içi yapay zeka yeteneklerine yatırım yapmak, sunulan hizmetlerin uzun vadeli kontrolü ve özelleştirilmesi açısından daha iyi olabilir.

Teknik uzmanlık

Yapay zeka uygulaması özel teknik bilgi ve uzmanlık gerektirir.

Ajansların, yeni düzenleyici gerekliliklere uygun olarak yapay zeka sistemlerini etkili bir şekilde geliştirmek, dağıtmak ve yönetmek için ekiplerini işe alması veya becerilerini artırması gerekebilir.

Yapay zekadan en iyi şekilde yararlanmak için ekip üyelerinin aşağıdaki özelliklere sahip olması gerekir:

- İyi programlama bilgisi.

- Büyük miktarda veriyi yönetmek için veri işleme ve analitik beceriler.

- Makine öğrenmesine ilişkin pratik bilgiler.

- Mükemmel problem çözme becerileri.

Etik hususlar

Ajanslar, yapay zeka kullanımının müşterileri için etik sonuçlarını dikkate almalıdır.

Güncellenen düzenlemelerde dile getirilen endişeleri ele alarak, süreç boyunca sorumlu yapay zeka uygulamalarını sağlamak için etik çerçeveler ve yönergeler oluşturulmalıdır.

Bunlar şunları içerir:

- Yapay zeka kullanıldığında şeffaflık, açıklama ve hesap verebilirlik.

- Kullanıcı gizliliğine ve fikri mülkiyetine saygı duymak.

- Yapay zekanın kullanılması için müşteri onayının alınması.

- Yeni ortaya çıkan yapay zeka teknolojilerini iyileştirme ve bunlara uyum sağlamaya yönelik sürekli kararlılıkla yapay zeka üzerinde insan kontrolü.

Sorumluluk önemlidir: Yapay zeka uygulamasının yasal zorluklarının üstesinden gelmek

Yapay zeka, SEO ve medya uygulamalarını iyileştirmek için heyecan verici fırsatlar sunarken, ajansların yasal zorlukları aşması ve bunun uygulanmasıyla ilgili güncellenmiş düzenlemelere uyması gerekiyor.

İşletmeler ve ajanslar aşağıdakileri yaparak yasal riskleri en aza indirebilir:

- Verilerin yasal olarak elde edildiğinden ve kurumun bu verileri kullanmak için uygun haklara sahip olduğundan emin olmak.

- Gerekli yasal izinlere sahip olmayan veya kalitesiz verileri filtrelemek.

- Veri kullanım haklarına ve yasalara uygun olduklarından emin olmak için veri ve yapay zeka modellerinin denetimlerini gerçekleştirmek.

- Hiçbir şeyin yasal politikalarla çelişmediğinden emin olmak için veri hakları ve gizlilik konusunda hukuki danışmanlık yapmak.

- Veri toplamada şeffaflığın ön planda tutulması ve açık ve anlaşılması kolay onay formları ile kullanıcı onayının alınması.

- AI Fairness 360, IBM Watson Studio ve Google'ın What-If Tool gibi önyargıyı azaltmaya yardımcı olan araçları kullanmak.

- Yapay zeka tarafından oluşturulan içeriğin yayınlanmadan önce kalitesinin gözden geçirilmesi için net politikalar ve prosedürler uygulamak.

Bu makalede ifade edilen görüşler konuk yazara aittir ve mutlaka Search Engine Land değildir. Personel yazarları burada listelenir.