人工智能道德:营销人员应如何负责任地拥抱创新

已发表: 2023-08-21人工智能 (AI) 不仅仅是一个变成现实的科幻现象,它还是一种技术支柱,在我们眼皮子底下发展了数十年。 人工智能已经实现了提高效率的梦想,许多品牌在过去几年已经利用人工智能进行营销。

尽管它引发了人们的兴奋和热情,但人们仍然对人工智能的道德问题感到担忧。 与许多创新一样,科技行业对虚拟宇宙的愿景与《黑镜》和《雪崩》等媒体有着令人毛骨悚然的相似之处。 凭借《播种者的寓言》、《机器》和《我,机器人》等文化时代精神,科幻迷、研究人员和技术专家都警告忽视人工智能伦理的危险是可以理解的。

在本文中,我们将定义什么是人工智能道德、品牌为何应关注以及营销人员面临的首要道德问题,包括工作保障、错误信息和算法偏见。 我们还将分享五个步骤,帮助您在团队内和整个组织内维护道德的人工智能实践。

什么是人工智能道德?

人工智能伦理是一套道德原则和专业实践体系,用于负责任地告知人工智能技术的发展和成果。 它还指研究如何优化人工智能的影响并降低风险和/或后果。

领先的科技公司、联合国等政府实体以及研究和数据科学界一直致力于制定和发布解决道德问题的指导方针。 例如,联合国教育、科学及文化组织(教科文组织)于2021年11月发布了首个人工智能伦理全球标准:《人工智能伦理建议书》。

国家和地方层面制定了一些人工智能法规,但随着人工智能和其他新兴技术的发展,企业应该期待更多的政府监管。 随着人工智能进一步融入我们的生活,人工智能伦理成为数字素养的重要组成部分。

为什么人工智能道德很重要

公司已经在投资人工智能,但困难在于确保负责任地使用。

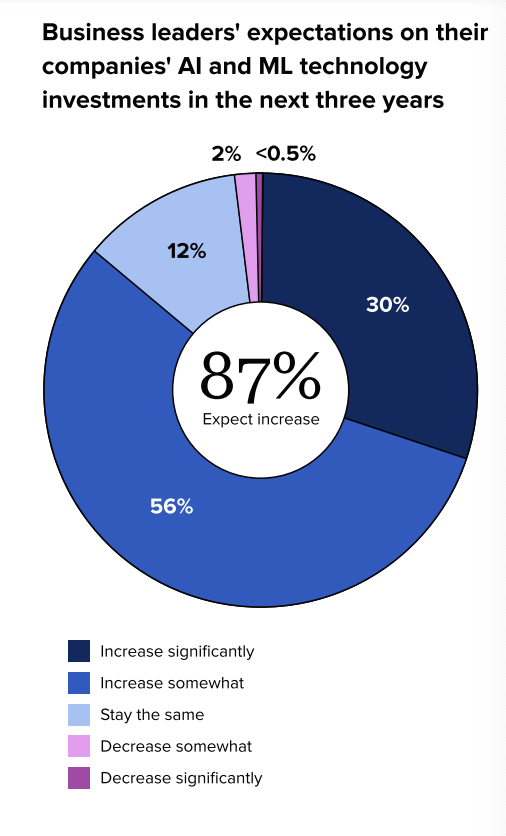

根据《2023 年社交媒体状况:人工智能和数据占据中心舞台》报告,企业领导者预计未来几年将增加对人工智能的投资。 我们的报告还发现,98% 的企业领导者认为,企业需要更好地了解人工智能和机器学习 (ML) 技术的潜力,才能取得长期成功。

虽然人工智能可以提高绩效、提高效率并产生积极的业务成果,但品牌也正在经历其应用带来的不可预见的后果。 这可能源于缺乏研究或有偏见的数据集等原因。 人工智能的滥用或忽视道德问题可能会导致品牌声誉受损、产品故障、诉讼和监管问题。

在组织内的各个团队中维护道德标准的第一步是了解营销人员面临的问题,以便您可以制定计划来减轻这些业务风险并保护您的品牌。

营销人员最关心的人工智能道德问题是什么

科技行业存在各种人工智能道德问题,包括但不限于以下内容:

- 虚假内容生成

- 可解释性

- 社会影响

- 技术滥用

- 偏见

- 数据责任和隐私

- 公平

- 稳健性

- 透明度

- 环境可持续性

- 多元化和包容性

- 道德主体和价值取向

- 信任和责任

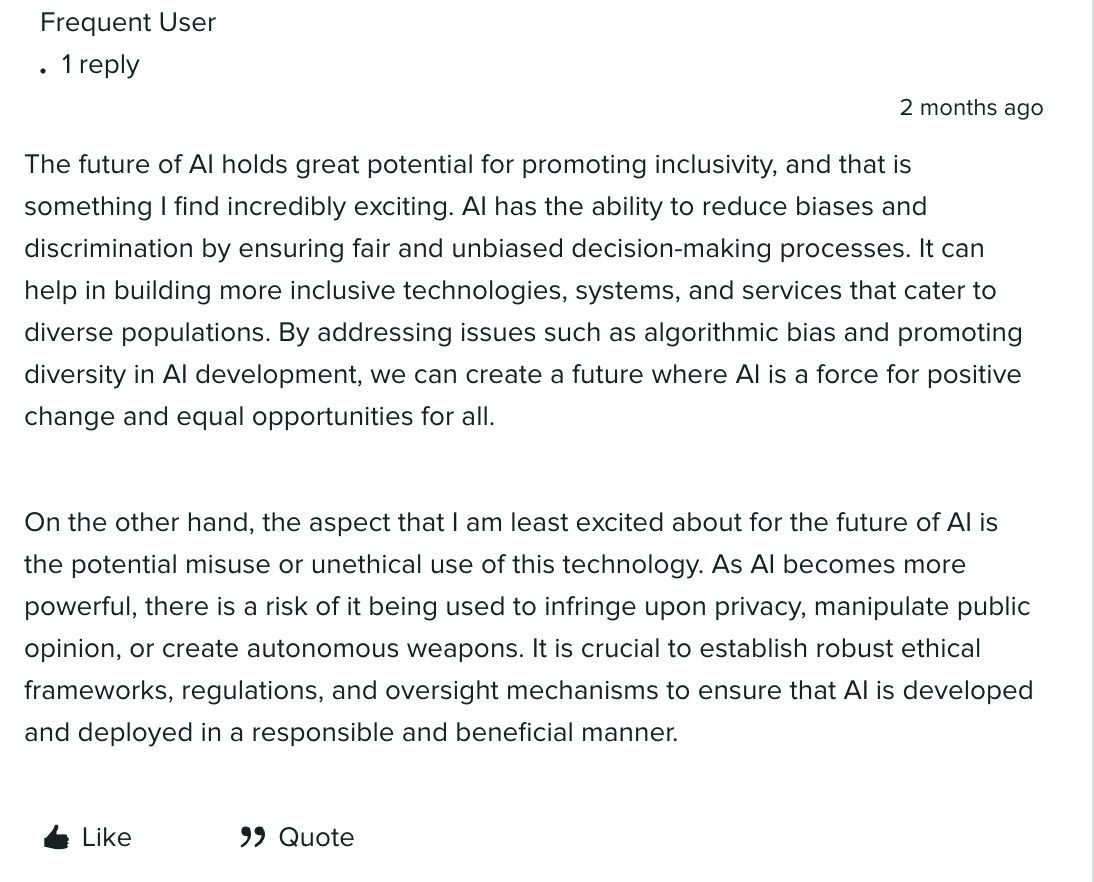

一些人认为人工智能可以帮助构建更具包容性的技术、系统和服务,以满足不同人群的需求。 关键是建立道德框架、法规和机制,以确保负责任的使用。

Sprout 社区论坛 Arboretum 的一名成员指出,人工智能有潜力通过确保公平、公正的决策过程来促进包容性并减少偏见/歧视。 通过解决人工智能开发中的算法偏差等问题,有可能塑造一个人工智能成为积极变革力量的未来。

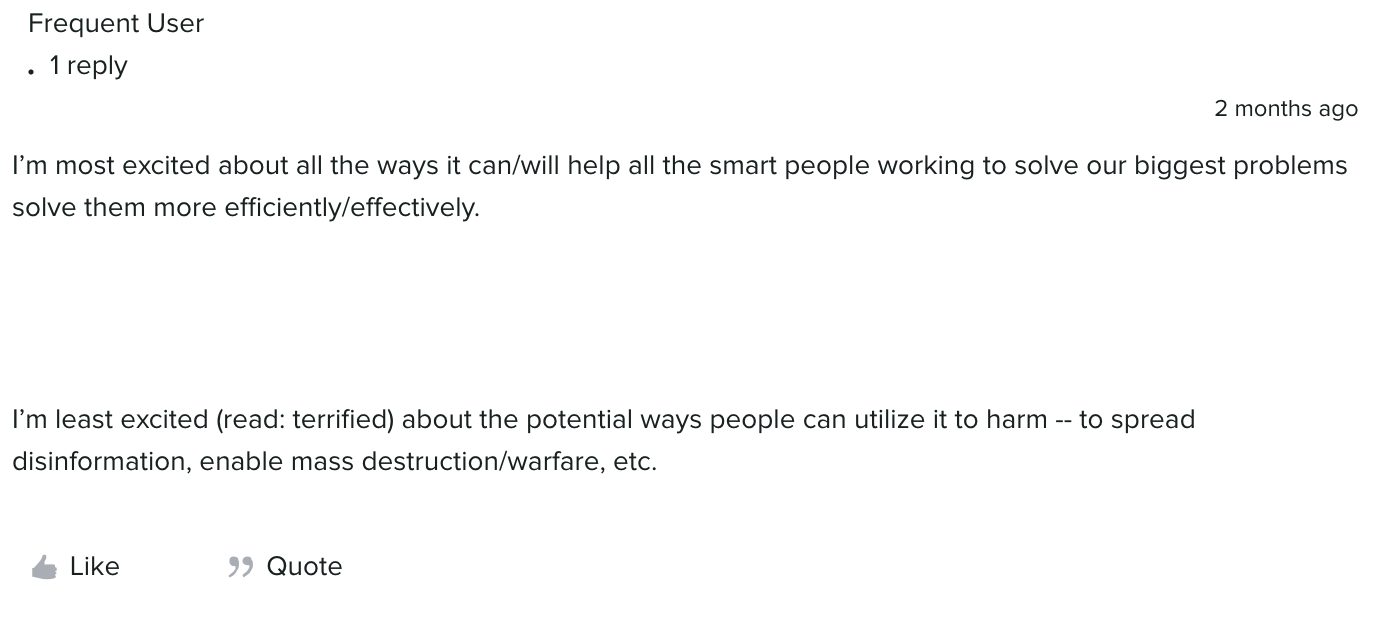

随着人工智能变得更加强大,除了积极变革的潜力之外,还存在滥用或不道德使用人工智能的机会。 我们的社区讨论了多种风险,包括侵犯隐私、操纵舆论和自主武器。

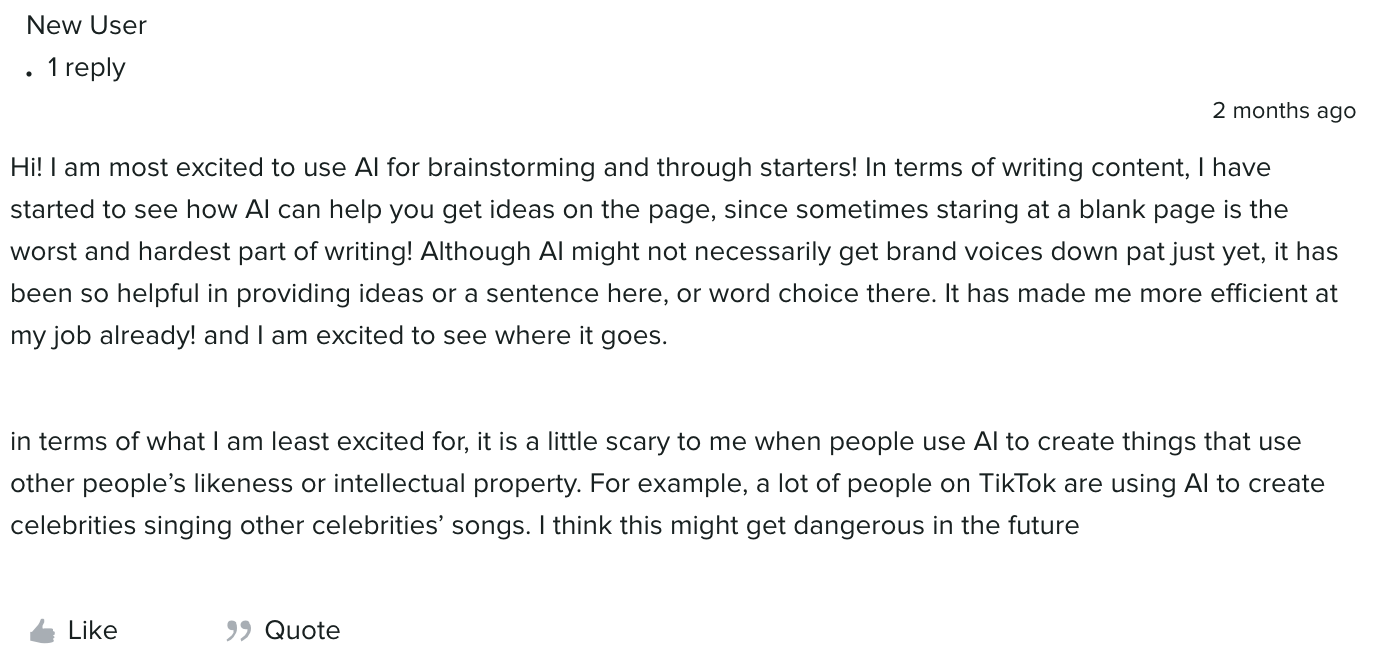

诸如此类的评论只是触及了各行业道德问题的表面,但营销人员面临的首要问题包括:工作保障、隐私、偏见和歧视、错误信息和虚假信息以及知识产权/版权问题,我们将在下一节。

对就业和工作流失的影响

机器人统治世界是我们最不担心的——至少目前是这样。

这是因为研究人员和专家不会受到技术奇点的威胁,也不会受到人工智能将超越人类智力并复制社交技能等特征的想法的威胁。 他们意识到人工智能的局限性以及工作替代的潜在影响。

研究和投资人工智能的目标不是取代人类,而是帮助我们节省时间和精力去做更有影响力的事情。 Flock Freight 的社交媒体和合作伙伴总监 Bob Wolfley 分享了一个关于人工智能的精彩类比:“人工智能就像我们家里的洗碗机或洗衣机。 想想你不用手工洗碗或洗衣服就能节省的时间。”

在我们的未读系列中,Sprout 营销和创意团队的成员讨论了他们目前如何使用人工智能,从沉迷于个性化购物到使用 ViralPost 等功能来帮助安排社交帖子。 观看下面的视频,了解他们对人工智能的好处和恐惧(包括工作替代)的热门看法:

隐私问题

围绕数据隐私、保护和安全的担忧是品牌最关心的问题。 安全投资对于企业来说越来越重要,因为他们试图避免任何监视、黑客和网络攻击的机会。 随着个性化变得越来越流行,品牌正在实施收集、存储和分析数据的最佳实践,以保护客户和组织。

算法偏见和歧视

由于它是从数据中学习的,因此构造或训练不当的人工智能可能会对代表性不足的数据子集表现出偏见。 人工智能生成的艺术品、聊天机器人、面部识别软件、算法和人工智能工具在招聘实践中存在几起偏见案例。

例如,一些 TikTok 和 Twitter [自 2023 年 7 月起更名为 X] 用户在一条帖子中发布了一条带有枪支的“#SouthSudan Barbie”主题,这是一种与该地区正在努力应对种族灭绝和难民危机等社会政治问题相关的负面刻板印象。 。

![用户在 Twitter 线程中对 AI 生成的“#SouthSudan Barbie”照片的响应[自 2023 年 7 月起更名为 X]。帖子中写道:“我们一直告诉你们,人工智能生成的垃圾中存在偏见。”](/uploads/article/221435/S1hZxuJ0KyrnC8ur.png)

随着偏见进入风险更低的人工智能使用案例,问题就变成了当训练数据集容易产生偏见时,我们如何消除偏见和歧视?

错误信息和虚假信息

和人类一样,人工智能并不完美。 人工智能对提示的反应可能不准确,而且人们担心人们恶意传播错误信息。 除了虚假信息的威胁之外,还可能导致品牌危机和声誉受损,尤其是在没有适当的保障措施和协议的情况下。

知识产权和版权问题

您可能见过韦斯·安德森电影中的哈利·波特演员或比基尼堡的居民演唱流行歌曲。 这些例子说明了有多少人正在利用人工智能来利用人们的形象和肖像或知识产权。

人工智能是集思广益和创建大纲等创造性任务的绝佳陪练伙伴,但根据输出的使用方式,它可能会导致版权侵权、抄袭和知识产权侵权。 例如,一群艺术家于 2023 年 1 月对 Midjourney 和 Stability AI 提起诉讼,声称这些工具侵犯了数百万艺术家的权利。 生成式人工智能打开了一个合法的蠕虫罐头,还有很多地方需要覆盖,但创建积极主动的规则和框架将有助于减轻道德风险。

维护团队内人工智能道德的 5 个步骤

以下五个步骤可帮助指导您制定降低人工智能道德风险的计划:

1. 制定人工智能使用的内部基本规则和责任

考虑建立一个由伦理学家、法律专家、技术专家和领导者组成的人工智能伦理团队,以帮助您的组织制定基本规则。 例如,仅使用生成式人工智能进行草稿和头脑风暴,而不使用外部发布的内容,这是一个很好的基本规则。

除了这些基本规则之外,还要定义参与人工智能的每个团队成员(包括道德团队)的角色和职责。 还要为人工智能设定目标和价值观。 这将有助于为您的人工智能道德政策和最佳实践奠定基础。

2. 定义和审核人工智能的作用

人工智能无法取代内容创作者、社交媒体策略师或营销中的任何角色。 确定需要人工监督或干预的人工智能任务,并确定人工智能道德政策的目标,以帮助制定人工智能开发、管理和沟通的流程。

一旦确定了道德政策的目标,就可以确定组织中人工智能的差距和机会。 考虑以下问题:

- 该组织目前如何使用人工智能以及我们未来希望如何使用它?

- 哪些软件和分析可以帮助我们降低业务风险?

- 技术和分析造成了哪些差距? 我们如何填充它们?

- 我们需要进行哪些测试或实验?

- 我们可以将哪些现有解决方案与产品团队当前的最佳实践结合使用?

- 您将如何使用数据和见解?

- 我们将如何建立人工智能技术和道德的品牌定位和信息传递?

3. 制定严密的供应商评估流程

与您的 IT 和法律团队合作,正确审查任何具有 AI 功能的工具并建立道德风险流程。 他们的专业知识将帮助您评估新的考虑因素,例如训练工具的数据集以及供应商为减轻人工智能偏差而采取的控制措施。 在外部或内部启动之前对每个工具进行尽职调查流程将帮助您减轻未来的风险。

4. 保持信息披露的透明度

与您的法律和/或隐私团队合作,开发外部消息传递和/或免责声明,以表明您的品牌在何时何地依赖人工智能。 这些消息可用于内容、客户服务等。例如,TikTok 更新了社区准则,要求创作者对人工智能生成的内容进行标记。 传达您倡导人工智能道德的道德标准和框架将有助于赢得同行、潜在客户和客户的信任。

5. 继续对领导层和团队进行教育

人工智能不是企业领导层可以仓促介入的领域。 就像任何新一波新兴创新一样,除了新的技术里程碑之外,还会有一个学习曲线。 通过举办内部培训和研讨会,对所有团队成员、领导者和利益相关者进行人工智能道德以及如何负责任地构建人工智能道德的教育,帮助创造公平的竞争环境。

遵循人工智能道德做正确的事

考虑道德不仅是正确的做法,也是在商业中利用人工智能技术的关键组成部分。

在我们的网络研讨会中了解领导者和营销人员关于人工智能将如何影响社交未来的更多观点,以及《2023 年社交媒体状况报告》的其他发现以及创建有影响力的社交内容的技巧。