人工智能道德:營銷人員應如何負責任地擁抱創新

已發表: 2023-08-21人工智能 (AI) 不僅僅是一個變成現實的科幻現象,它還是一種技術支柱,在我們眼皮子底下發展了數十年。 人工智能已經實現了提高效率的夢想,許多品牌在過去幾年已經利用人工智能進行營銷。

儘管它引發了人們的興奮和熱情,但人們仍然對人工智能的道德問題感到擔憂。 與許多創新一樣,科技行業對虛擬宇宙的願景與《黑鏡》和《雪崩》等媒體有著令人毛骨悚然的相似之處。 憑藉《播種者的寓言》、《機器》和《我,機器人》等文化時代精神,科幻迷、研究人員和技術專家都警告忽視人工智能倫理的危險是可以理解的。

在本文中,我們將定義什麼是人工智能道德、品牌為何應關注以及營銷人員面臨的首要道德問題,包括工作保障、錯誤信息和算法偏見。 我們還將分享五個步驟,幫助您在團隊內和整個組織內維護道德的人工智能實踐。

什麼是人工智能道德?

人工智能倫理是一套道德原則和專業實踐體系,用於負責任地告知人工智能技術的發展和成果。 它還指研究如何優化人工智能的影響並降低風險和/或後果。

領先的科技公司、聯合國等政府實體以及研究和數據科學界一直致力於製定和發布解決道德問題的指導方針。 例如,聯合國教育、科學及文化組織(教科文組織)於2021年11月發布了首個人工智能倫理全球標準:《人工智能倫理建議書》。

國家和地方層面製定了一些人工智能法規,但隨著人工智能和其他新興技術的發展,企業應該期待更多的政府監管。 隨著人工智能進一步融入我們的生活,人工智能倫理成為數字素養的重要組成部分。

為什麼人工智能道德很重要

公司已經在投資人工智能,但困難在於確保負責任地使用。

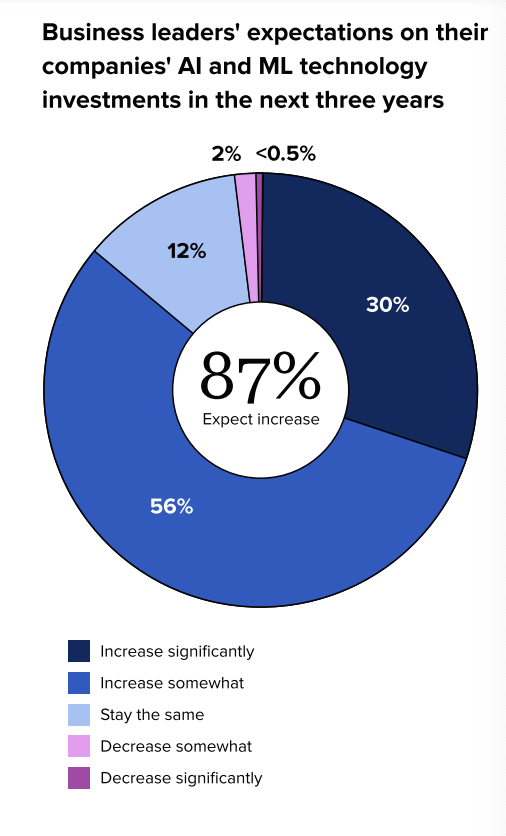

根據《2023 年社交媒體狀況:人工智能和數據佔據中心舞台》報告,企業領導者預計未來幾年將增加對人工智能的投資。 我們的報告還發現,98% 的企業領導者認為,企業需要更好地了解人工智能和機器學習 (ML) 技術的潛力,才能取得長期成功。

雖然人工智能可以提高績效、提高效率並產生積極的業務成果,但品牌也正在經歷其應用帶來的不可預見的後果。 這可能源於缺乏研究或有偏見的數據集等原因。 人工智能的濫用或忽視道德問題可能會導致品牌聲譽受損、產品故障、訴訟和監管問題。

在組織內的各個團隊中維護道德標準的第一步是了解營銷人員面臨的問題,以便您可以製定計劃來減輕這些業務風險並保護您的品牌。

營銷人員最關心的人工智能道德問題是什麼

科技行業存在各種人工智能道德問題,包括但不限於以下內容:

- 虛假內容生成

- 可解釋性

- 社會影響

- 技術濫用

- 偏見

- 數據責任和隱私

- 公平

- 穩健性

- 透明度

- 環境可持續性

- 多元化和包容性

- 道德主體和價值取向

- 信任和責任

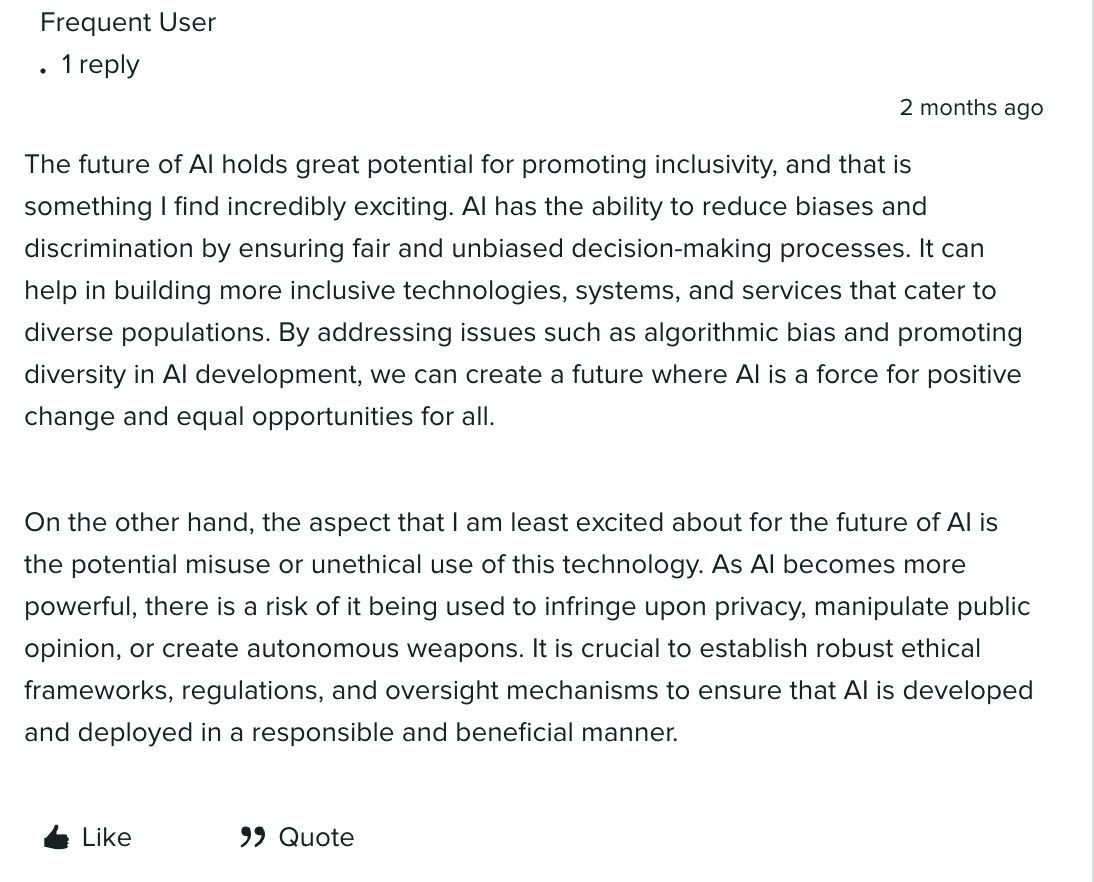

一些人認為人工智能可以幫助構建更具包容性的技術、系統和服務,以滿足不同人群的需求。 關鍵是建立道德框架、法規和機制,以確保負責任的使用。

Sprout 社區論壇 Arboretum 的一名成員指出,人工智能有潛力通過確保公平、公正的決策過程來促進包容性並減少偏見/歧視。 通過解決人工智能開發中的算法偏差等問題,有可能塑造一個人工智能成為積極變革力量的未來。

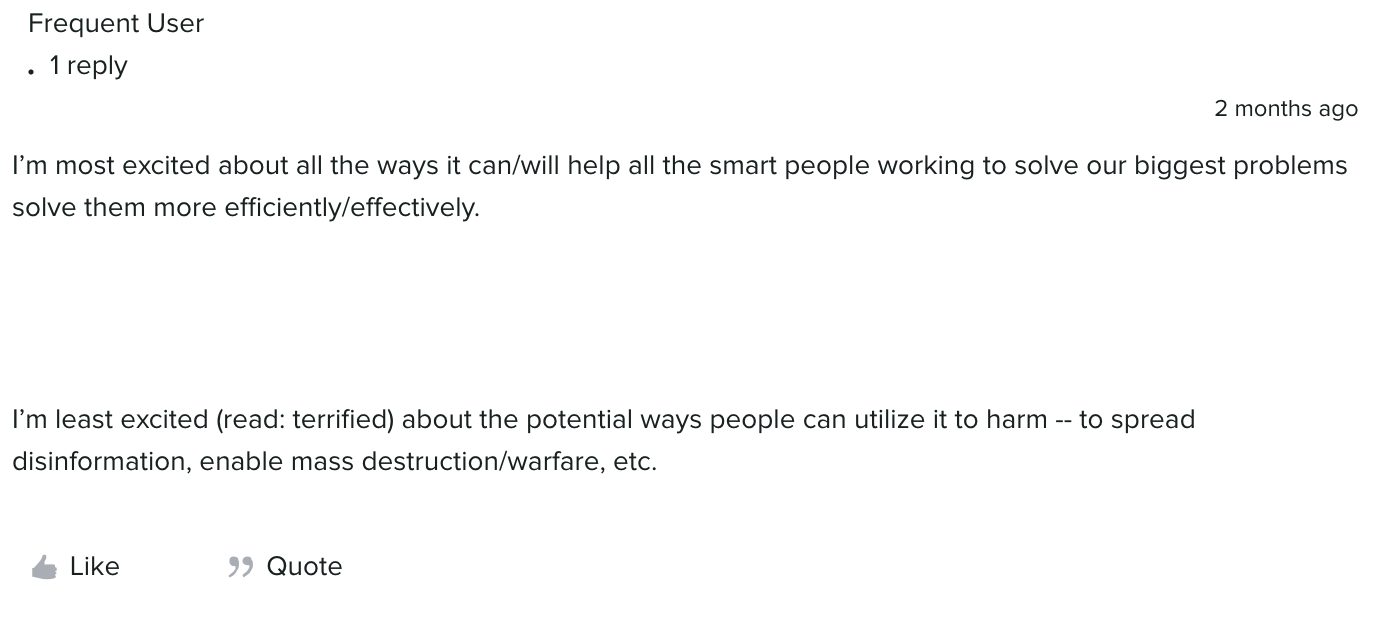

隨著人工智能變得更加強大,除了積極變革的潛力之外,還存在濫用或不道德使用人工智能的機會。 我們的社區討論了多種風險,包括侵犯隱私、操縱輿論和自主武器。

諸如此類的評論只是觸及了各行業道德問題的表面,但營銷人員面臨的首要問題包括:工作保障、隱私、偏見和歧視、錯誤信息和虛假信息以及知識產權/版權問題,我們將在下一節。

對就業和工作流失的影響

機器人統治世界是我們最不擔心的——至少目前是這樣。

這是因為研究人員和專家不會受到技術奇點的威脅,也不會受到人工智能將超越人類智力並複制社交技能等特徵的想法的威脅。 他們意識到人工智能的局限性以及工作替代的潛在影響。

研究和投資人工智能的目標不是取代人類,而是幫助我們節省時間和精力去做更有影響力的事情。 Flock Freight 的社交媒體和合作夥伴總監 Bob Wolfley 分享了一個關於人工智能的精彩類比:“人工智能就像我們家裡的洗碗機或洗衣機。 想想你不用手工洗碗或洗衣服就能節省的時間。”

在我們的未讀系列中,Sprout 營銷和創意團隊的成員討論了他們目前如何使用人工智能,從沉迷於個性化購物到使用 ViralPost 等功能來幫助安排社交帖子。 觀看下面的視頻,了解他們對人工智能的好處和恐懼(包括工作替代)的熱門看法:

隱私問題

圍繞數據隱私、保護和安全的擔憂是品牌最關心的問題。 安全投資對於企業來說越來越重要,因為他們試圖避免任何監視、黑客和網絡攻擊的機會。 隨著個性化變得越來越流行,品牌正在實施收集、存儲和分析數據的最佳實踐,以保護客戶和組織。

算法偏見和歧視

由於它是從數據中學習的,因此構造或訓練不當的人工智能可能會對代表性不足的數據子集表現出偏見。 人工智能生成的藝術品、聊天機器人、面部識別軟件、算法和人工智能工具在招聘實踐中存在幾起偏見案例。

例如,一些TikTok 和Twitter(自2023 年7 月起更名為X)用戶在一條帖子中發布了一條帶有槍支的“#SouthSudan Barbie”主題,這是一種與該地區正在努力解決種族滅絕和難民危機等社會政治問題相關的負面刻板印象。 。

![用戶在 Twitter 線程中對 AI 生成的“#SouthSudan Barbie”照片的響應[自 2023 年 7 月起更名為 X]。帖子中寫道:“我們一直告訴你們,人工智能生成的垃圾中存在偏見。”](/uploads/article/221435/S1hZxuJ0KyrnC8ur.png)

隨著偏見進入風險更低的人工智能使用案例,問題就變成了當訓練數據集容易產生偏見時,我們如何消除偏見和歧視?

錯誤信息和虛假信息

和人類一樣,人工智能並不完美。 人工智能對提示的反應可能不准確,而且人們擔心人們惡意傳播錯誤信息。 除了虛假信息的威脅之外,還可能出現品牌危機和聲譽受損,尤其是在沒有適當的保障措施和協議的情況下。

知識產權和版權問題

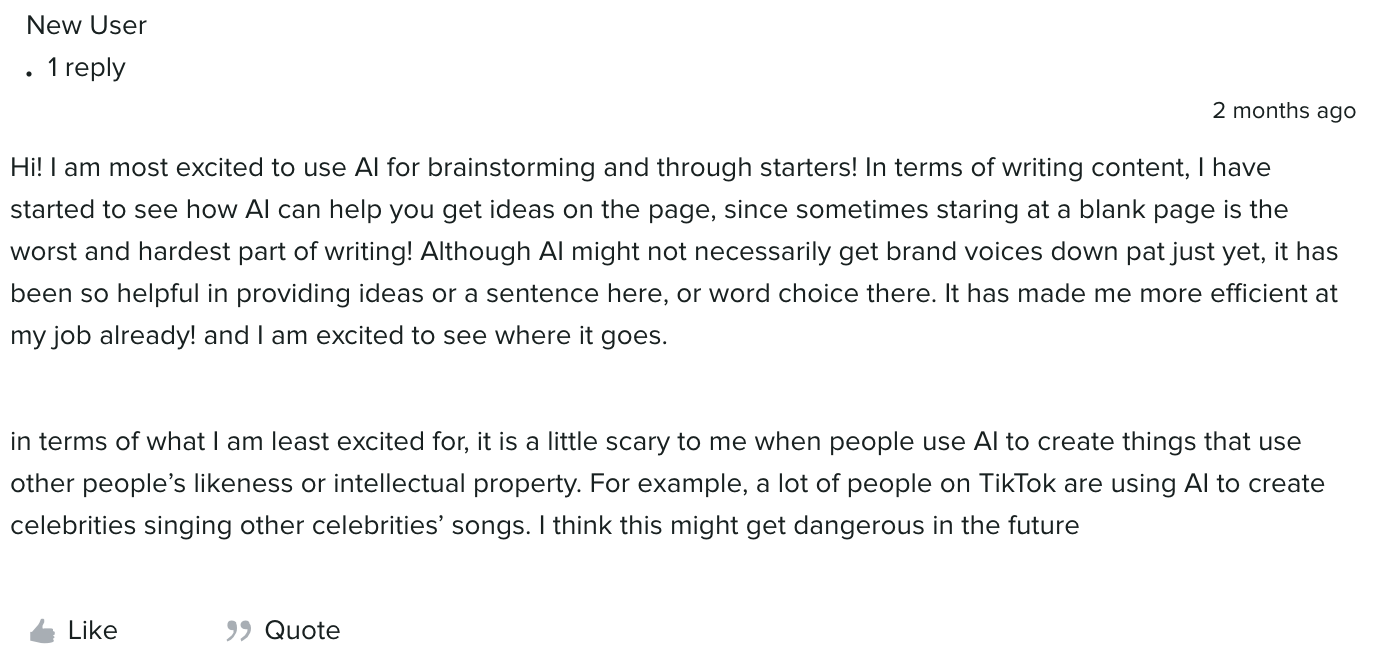

您可能見過韋斯·安德森電影中的哈利·波特演員或比基尼堡的居民演唱流行歌曲。 這些例子說明了有多少人正在利用人工智能來利用人們的形象和肖像或知識產權。

人工智能是集思廣益和創建大綱等創造性任務的絕佳陪練夥伴,但根據輸出的使用方式,它可能會導致版權侵權、抄襲和知識產權侵權。 例如,一群藝術家於 2023 年 1 月對 Midjourney 和 Stability AI 提起訴訟,聲稱這些工具侵犯了數百萬藝術家的權利。 生成式人工智能打開了一個合法的蠕蟲罐頭,還有很多地方需要覆蓋,但創建積極主動的規則和框架將有助於減輕道德風險。

維護團隊內人工智能道德的 5 個步驟

以下五個步驟可幫助指導您制定降低人工智能道德風險的計劃:

1. 制定人工智能使用的內部基本規則和責任

考慮建立一個由倫理學家、法律專家、技術專家和領導者組成的人工智能倫理團隊,以幫助您的組織製定基本規則。 例如,僅使用生成式人工智能進行草稿和頭腦風暴,而不使用外部發布的內容,這是一個很好的基本規則。

除了這些基本規則之外,還要定義參與人工智能的每個團隊成員(包括道德團隊)的角色和職責。 還要為人工智能設定目標和價值觀。 這將有助於為您的人工智能道德政策和最佳實踐奠定基礎。

2. 定義和審核人工智能的作用

人工智能無法取代內容創作者、社交媒體策略師或營銷中的任何角色。 確定需要人工監督或乾預的人工智能任務,並確定人工智能道德政策的目標,以幫助制定人工智能開發、管理和溝通的流程。

一旦確定了道德政策的目標,就可以確定組織中人工智能的差距和機會。 考慮以下問題:

- 該組織目前如何使用人工智能以及我們未來希望如何使用它?

- 哪些軟件和分析可以幫助我們降低業務風險?

- 技術和分析造成了哪些差距? 我們如何填充它們?

- 我們需要進行哪些測試或實驗?

- 我們可以將哪些現有解決方案與產品團隊當前的最佳實踐結合使用?

- 您將如何使用數據和見解?

- 我們將如何建立人工智能技術和道德的品牌定位和信息傳遞?

3. 制定嚴密的供應商評估流程

與您的 IT 和法律團隊合作,正確審查任何具有 AI 功能的工具並建立道德風險流程。 他們的專業知識將幫助您評估新的考慮因素,例如訓練工具的數據集以及供應商為減輕人工智能偏差而採取的控制措施。 在外部或內部啟動之前對每個工具進行盡職調查流程將幫助您減輕未來的風險。

4. 保持信息披露的透明度

與您的法律和/或隱私團隊合作,開發外部消息傳遞和/或免責聲明,以表明您的品牌在何時何地依賴人工智能。 這些消息可用於內容、客戶服務等。例如,TikTok 更新了社區準則,要求創作者對人工智能生成的內容進行標記。 傳達您倡導人工智能道德的道德標準和框架將有助於贏得同行、潛在客戶和客戶的信任。

5. 繼續對領導層和團隊進行教育

人工智能不是企業領導層可以倉促介入的領域。 就像任何新一波新興創新一樣,除了新的技術里程碑之外,還會有一個學習曲線。 通過舉辦內部培訓和研討會,對所有團隊成員、領導者和利益相關者進行人工智能道德以及如何負責任地構建人工智能道德的教育,幫助創造公平的競爭環境。

遵循人工智能道德做正確的事

考慮道德不僅是正確的做法,也是在商業中利用人工智能技術的關鍵組成部分。

在我們的網絡研討會中了解領導者和營銷人員關於人工智能將如何影響社交未來的更多觀點,以及《2023 年社交媒體狀況報告》的其他發現以及創建有影響力的社交內容的技巧。